Die DePIN (Dezentralisierte Physische Infrastruktur Netzwerke) und KI-Infrastruktur-Erzählungen entwickeln sich schnell weiter. Wir bewegen uns über die frühen Tage des einfachen Vermietens von zusätzlichen Festplatten hinaus und hin zu einem ausgeklügelten, vertikalisierten Stack.

Wenn man sich Akash ( $AKT ), Aethir ($ATH ), Flux ($FLUX ), SKALE ($SKL) und Fluence ($FLT) ansieht, zeigt sich ein klarer Trend: Die Trennung von Muskel und Gehirn.

🏗️ Der dezentrale Compute-Stack

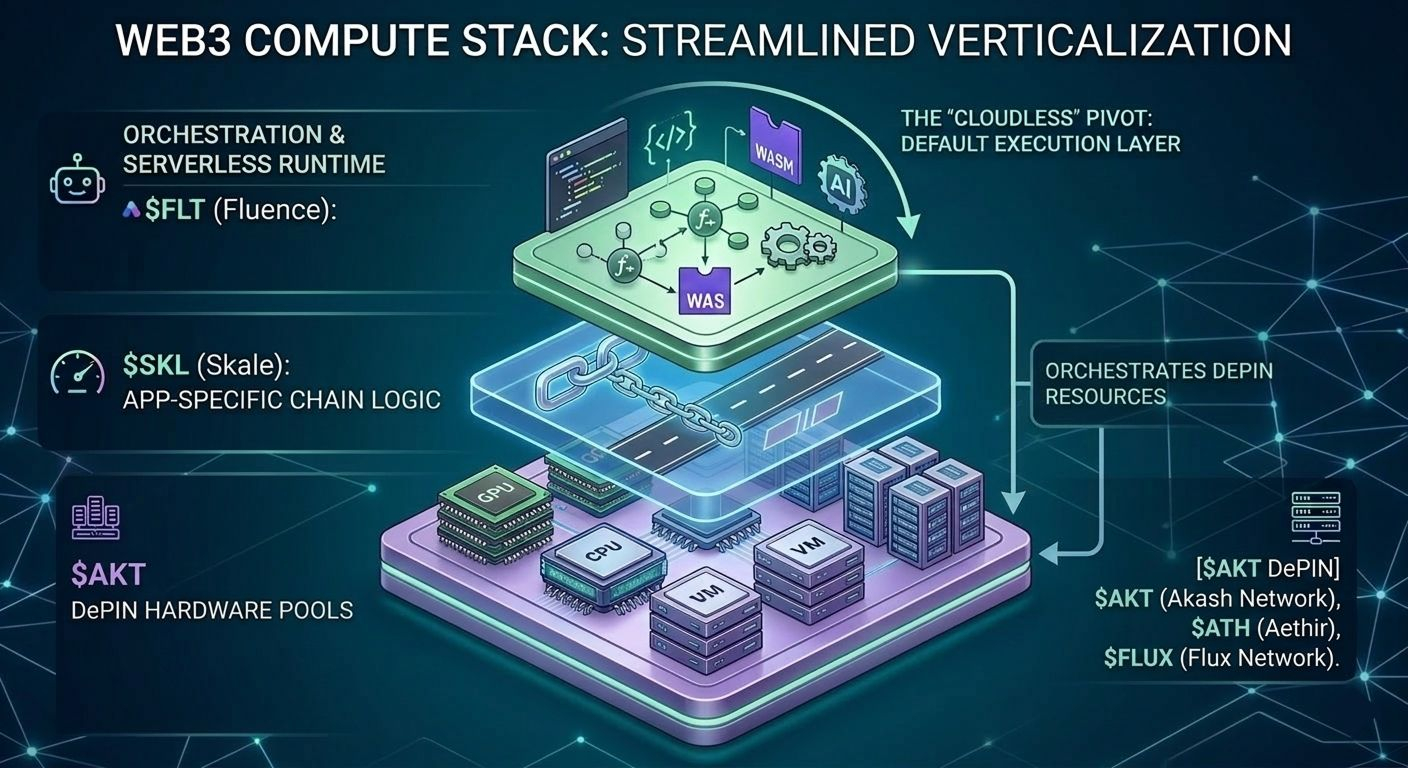

Um zu verstehen, wo der Wert fließt, müssen Sie sich die Schichten ansehen:

Die Muskulatur (Hardware-Ebene): Akash, Flux und Aethir sind die Schwergewichte. Sie monetarisieren Hardware direkt. Wenn Sie eine rohe GPU-Instanz für das KI-Training oder eine virtuelle Maschine (VM) benötigen, um einen Knoten zu hosten, sind dies Ihre bevorzugten Marktplätze. Aethir, speziell, schafft eine Nische in hochgradigen Unternehmens-GPUs für KI und Gaming.

Die Grundlage (Skalierungsebene): SKALE ist kein Rechenmarktplatz, sondern bietet die hochgeschwindigkeits, gasfreie Umgebung, in der die "Logik" dieser Anwendungen leben kann. Es ist die Autobahn, die dApps mit der Rechenleistung verbindet, die sie konsumieren.

Das Gehirn (Orchestrierungsebene): Hier hebt sich Fluence ab. Es sitzt "über" der Hardware. Anstatt Ihnen nur eine Maschine zu vermieten, bietet Fluence eine dezentrale serverlose Laufzeit.

💡 Warum Fluence ($FLT) der Kleber ist

Die Mission von Fluence ist es, ein cloudloses Internet, genehmigungsfreie Backends zu schaffen, die nicht von einem einzigen zentralisierten Anbieter wie AWS abhängen. Hier ist der Grund, warum es ein kritisches Stück des größeren Bildes ist:

Orchestrierung, nicht nur Kapazität: Während Aethir oder Akash das Metall (GPUs/CPUs) bereitstellen, bietet Fluence das Softwaregewebe, das diesen Ressourcen sagt, was sie tun sollen. Es verwendet WebAssembly (WASM), um Rechenaufgaben nahtlos über verschiedene Knoten zu komponieren und weiterzuleiten.

Der KI-Pipeline-Kleber: Echte KI-Anwendungen sind nicht nur eine einfache Anfrage. Es sind komplexe Pipelines: Datensammlung → Vorverarbeitung → Modellinferenz → Nachverarbeitung. Fluence kann im Herzen davon sitzen, eine GPU von Aethir und Daten aus einer anderen Quelle zu koordinieren, um ein Endergebnis zu liefern.

Entwicklererfahrung: Für einen Entwickler ist das Mieten einer VM (Akash/Flux) "Old School"-Cloud. Fluence bietet ein serverloses Modell. Sie verwalten den Server nicht; Sie setzen einfach die Funktion ein. Das ist die Zukunft, wie dezentrale KI-Agenten und Mikrodienste tatsächlich aufgebaut werden.

📉 Die Zusammenfassung: Von Hardware zur Ausführung

Der Markt verschiebt sich von "Wo kann ich eine GPU mieten?" zu "Wie kann ich einen komplexen KI-Agenten autonom betreiben?"

$AKT, $ATH und $FLUX sind Wetten auf die Versorgung mit dezentraler Hardware.

$SKL ist eine Wette auf die Koordination der On-Chain-Logik.

$FLT ist eine Wette auf die Ausführung und Orchestrierung der gesamten dezentralen Cloud.

Fluence ist im Wesentlichen das "Gehirn", das die "Muskulatur" der DePIN-Welt für die nächste Generation von KI-Apps nutzbar macht. Während der Raum reift, könnte der "Kleber", der diese dezentralen Ressourcen zusammenfügt, genauso wertvoll werden wie die Hardware selbst.