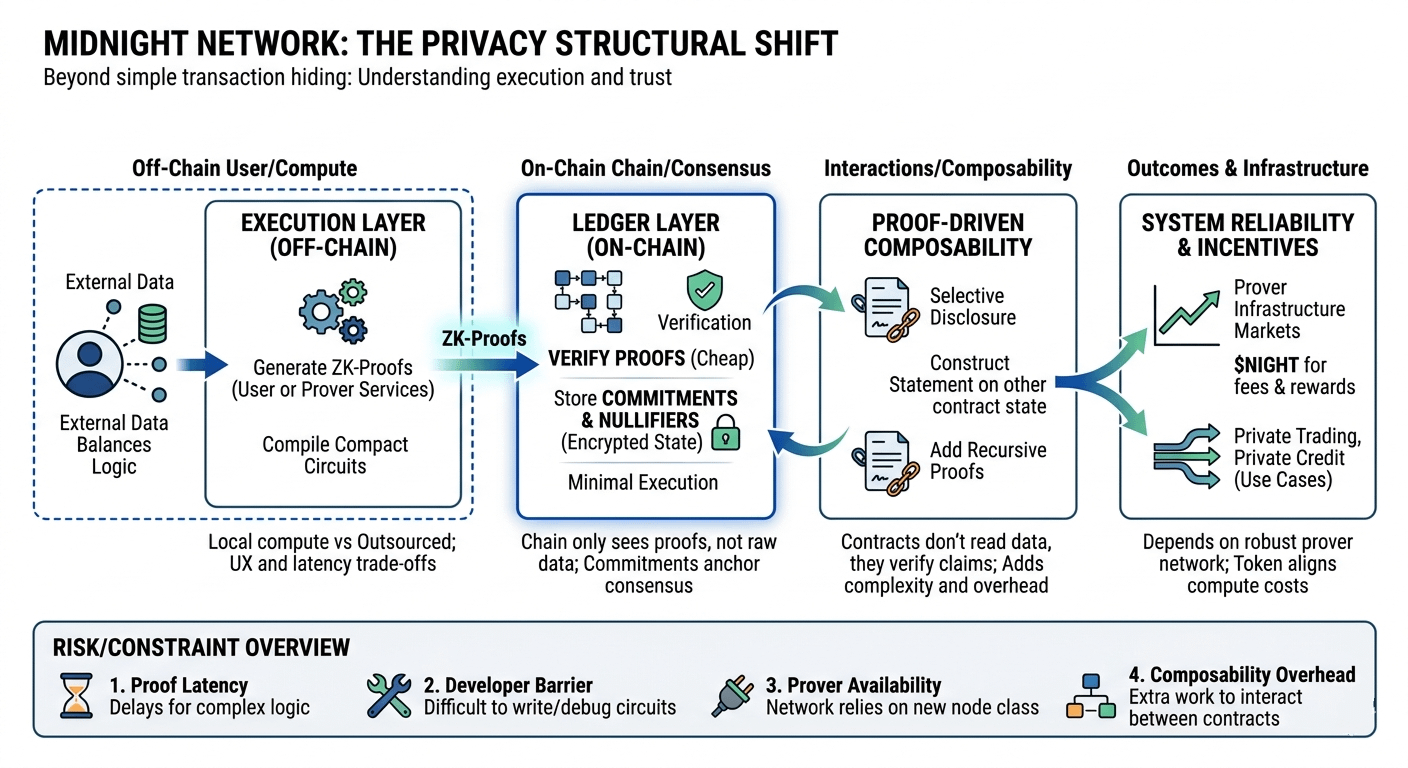

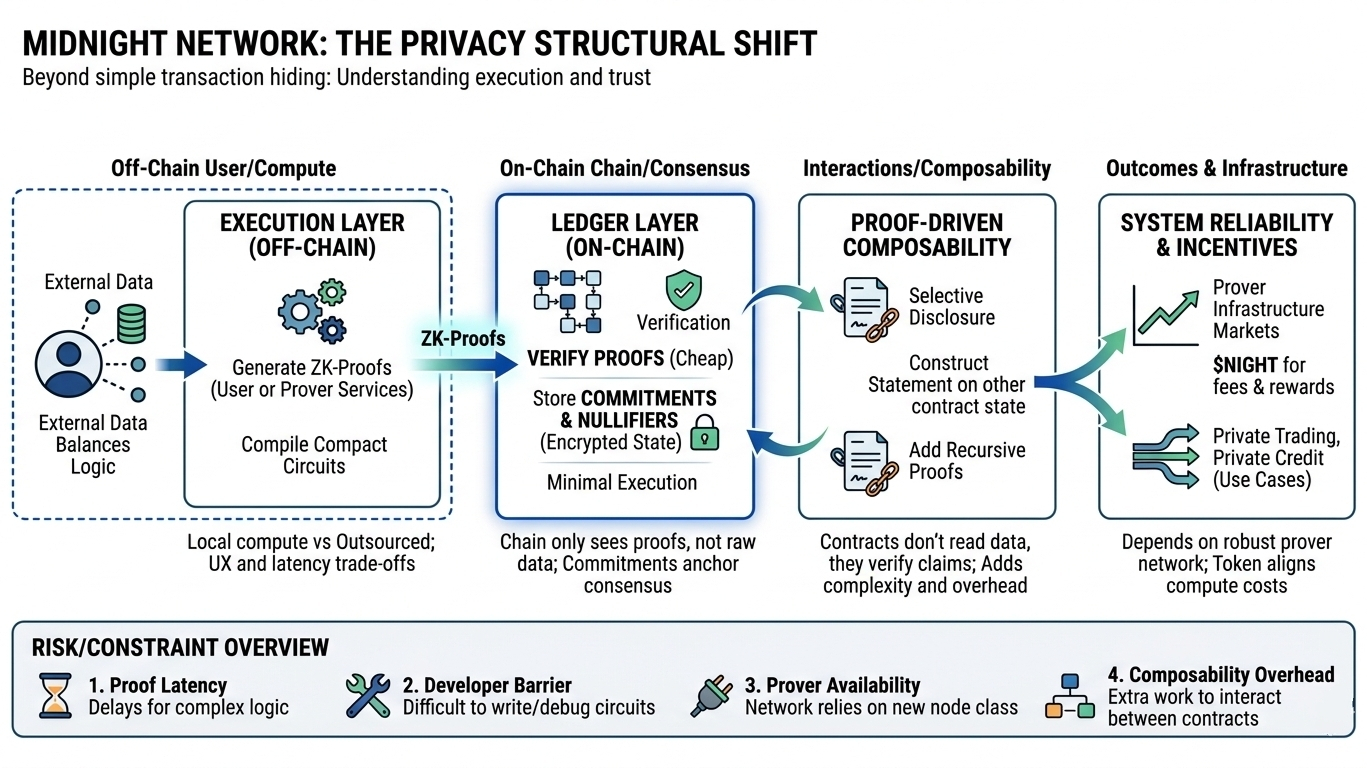

He estado revisando la arquitectura de midnight nuevamente, y sigo sintiendo que el encuadre habitual se queda corto. La mayoría de la gente lo reduce a “zk = cadena privada”, lo cual es conveniente, pero algo engañoso. Implica que el objetivo principal es ocultar transacciones. Lo que en realidad parece es que están tratando de mover la computación misma a un modelo restringido por zk, donde la cadena solo ve pruebas.

ese es un modelo mental bastante diferente.

Lo que captó mi atención es cómo se trata la ejecución. En lugar de que los validadores vuelvan a ejecutar transacciones, verifican pruebas zk de que alguna ejecución fuera de la cadena fue válida. Esta parte es real — está alineada con cómo están evolucionando los sistemas zk modernos. Pero midnight parece inclinarse más hacia esto, casi asumiendo que la ejecución en cadena se vuelve mínima con el tiempo. La cadena se convierte más en una capa de verificación que en una capa de computación.

entonces está el diseño del estado. por lo que puedo decir, dependen de compromisos en lugar de almacenamiento completamente transparente. así que la red acuerda hashes o representaciones encriptadas del estado, no el estado mismo. eso funciona, pero solo hasta cierto punto. el consenso aún necesita algo determinista a lo que anclarse. así que siempre hay esta pregunta: ¿qué tiene que permanecer visible para que el sistema funcione?

otro componente es la divulgación selectiva. en lugar de revelar datos en bruto, los usuarios demuestran afirmaciones sobre sus datos. como demostrar que un saldo excede un umbral sin mostrar la cantidad exacta. esto es técnicamente sólido, pero introduce una dependencia que parece fácil de pasar por alto: ¿de dónde provienen esos datos? si provienen de alguna fuente o emisor fuera de la cadena, entonces el modelo de confianza se desplaza hacia afuera. la cadena verifica la prueba, pero no necesariamente la verdad detrás de ella.

y aquí está la cosa… estas piezas no operan de manera independiente. se apilan unas sobre otras de maneras que crean restricciones ocultas.

la ejecución fuera de la cadena significa que alguien tiene que generar pruebas. si eso siempre es el usuario, entonces la experiencia del usuario sufre. si se delega a servicios de prueba, entonces has introducido efectivamente una nueva clase de actores: tal vez retransmisores, tal vez nodos especializados. de cualquier manera, se convierten en parte de la confiabilidad del sistema. si la disponibilidad del probador disminuye, ¿degrada la red de manera elegante o simplemente se detiene?

la composabilidad también se vuelve extraña aquí. en un sistema transparente, los contratos pueden leer el estado compartido directamente. en midnight, eso solo funciona si expones algo o proporcionas una prueba sobre ello. así que las interacciones también se vuelven impulsadas por pruebas. no se trata solo de “llamar a otro contrato”, se trata de “construir una declaración válida sobre el estado de otro contrato”. eso agrega sobrecarga, tanto computacional como conceptual.

lo que no se habla realmente es cuánto de este diseño asume mejoras en las herramientas zk. escribir circuitos hoy es aún incómodo. depurarlos es peor. si midnight espera una base amplia de desarrolladores, entonces las capas de abstracción necesitan madurar significativamente. de lo contrario, esto se limita a equipos con profunda experiencia en zk.

la latencia es otro problema silencioso. la generación de pruebas no es instantánea, especialmente para lógica compleja. así que o las aplicaciones aceptan retrasos, o dependen de flujos por lotes/asíncronos. ambos tienen compensaciones. por ejemplo, en algo como un sistema de comercio privado, las pruebas retrasadas podrían significar un estado obsoleto, lo que introduce riesgo.

sigo pensando en un caso de uso simple: un sistema de crédito privado. los usuarios demuestran su solvencia sin revelar su historial financiero. suena limpio. pero esas pruebas dependen de fuentes de datos externas, tal vez actualizadas periódicamente. si las actualizaciones se retrasan, el sistema opera con suposiciones desactualizadas. y si las pruebas son costosas, los usuarios pueden no actualizar con suficiente frecuencia.

también está el papel de $night. presumiblemente se usa para tarifas, tal vez incentivos para validadores, posiblemente incluso recompensas para los probadores. pero la estructura de costos aquí es diferente de las cadenas típicas. probar es costoso, la verificación es más barata. así que la pregunta es si el modelo de token se alinea con donde se encuentra la carga computacional real.

honestamente, parece que midnight se trata menos de ocultar todo y más de reestructurar cómo se expresa la confianza: reemplazando la visibilidad directa con afirmaciones demostrables. pero eso solo funciona si la infraestructura circundante se comporta de manera confiable.

observando:

* cómo emerge la infraestructura de prueba (local vs externalizada, incentivos en torno a ello)

* si el desarrollo de circuitos se vuelve accesible más allá de los equipos nativos de zk

* cómo manejan la composabilidad del estado sin filtrar demasiado

* rendimiento del mundo real bajo cargas de trabajo no triviales

no estoy seguro aún si esto se convierte en un sistema de propósito general o en algo más de nicho. tal vez la verdadera restricción no sea la tecnología, sino cuánto complejo están dispuestos a absorber los desarrolladores.

$NIGHT @MidnightNetwork #night