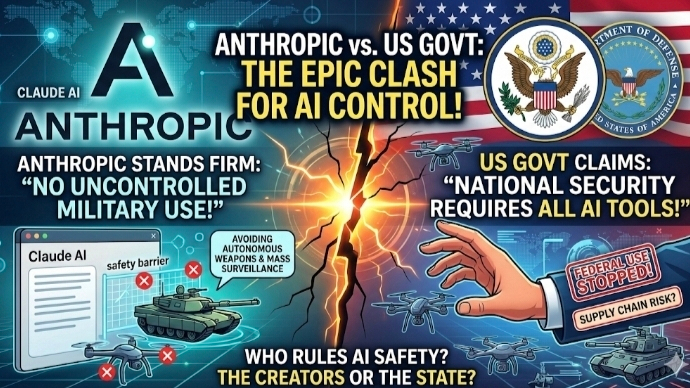

J'ai étudié cette situation attentivement et dans ma recherche, je commence à comprendre à quel point ce conflit est vraiment sérieux. Ce n'est pas juste un désaccord normal entre une entreprise et le gouvernement. Il s'agit de pouvoir, de contrôle, de sécurité et de l'avenir de l'intelligence artificielle dans le monde réel. L'entreprise impliquée est Anthropic, le fabricant du système d'IA appelé Claude. Ils construisent des outils d'IA avancés capables d'écrire, d'analyser et d'aider à des décisions complexes. Le gouvernement américain, en particulier les départements de la défense, souhaite également utiliser des systèmes d'IA puissants pour la sécurité nationale et des fins militaires. C'est à ce moment-là que les choses commencent à devenir compliquées.

D'après ce que je comprends, Anthropic a des règles strictes concernant l'utilisation de son IA. Ils disent que leur technologie ne devrait pas être utilisée pour certaines activités militaires, notamment des choses comme des armes autonomes ou une surveillance à grande échelle. Ils croient que l'IA actuelle n'est pas entièrement fiable et peut faire des erreurs. Si ces erreurs se produisent dans des domaines sensibles comme les décisions de guerre, les résultats pourraient être très dangereux. J'ai commencé à comprendre cela en lisant comment l'IA donne parfois de mauvaises réponses ou montre des biais. Si cela se produit dans une simple conversation, c'est acceptable. Mais si cela se produit dans des opérations militaires, cela devient un problème sérieux.

Le gouvernement américain le voit différemment. Ils croient que si la technologie de l'IA est disponible et légale, ils devraient pouvoir l'utiliser pour la défense nationale. Ils soutiennent que les menaces à la sécurité sont réelles et que des concurrents dans le monde entier développent leurs propres systèmes d'IA. De leur point de vue, limiter l'accès à des outils d'IA avancés pourrait affaiblir la force nationale. Ils estiment qu'une entreprise privée ne devrait pas décider de ce que le gouvernement peut ou ne peut pas faire dans des opérations militaires légales.

Ce désaccord est progressivement devenu plus important. Des rapports indiquent que le gouvernement a demandé à Anthropic de permettre une utilisation militaire plus large de son système d'IA. Anthropic a refusé de lever certaines restrictions. Ils ont maintenu leurs principes de sécurité. À cause de cela, les tensions ont augmenté. Finalement, le gouvernement a décidé d'empêcher les agences fédérales d'utiliser la technologie d'Anthropic. Cette décision a créé des ondes de choc dans le monde de la technologie.

J'ai approfondi mes recherches et j'ai découvert que le gouvernement a même qualifié l'entreprise de risque potentiel pour la chaîne d'approvisionnement. C'est une étiquette sérieuse car elle affecte non seulement les contrats gouvernementaux directs, mais aussi d'autres entreprises qui travaillent avec le gouvernement. Si elles dépendent de la technologie d'Anthropic, elles pourraient également avoir besoin de changer leurs systèmes. Cela montre à quel point de telles décisions peuvent devenir puissantes.

Du côté d'Anthropic, ils disent qu'ils ne sont pas contre le soutien à la sécurité nationale. Ils ont travaillé avec des agences gouvernementales auparavant. Mais ils croient qu'il doit y avoir des limites claires. Ils soutiennent que l'IA d'aujourd'hui n'est pas suffisamment avancée pour prendre des décisions de vie ou de mort sans un contrôle humain strict. Ils veulent éviter tout abus futur. De leur point de vue, un développement responsable est plus important qu'un déploiement illimité.

J'ai remarqué que ce conflit porte vraiment sur qui contrôle l'IA. Est-ce les créateurs qui la construisent, ou les gouvernements qui veulent l'utiliser ? À mesure que l'IA devient plus puissante, elle aura plus d'influence dans la défense, la santé, les finances et la vie quotidienne. Si les entreprises établissent des règles strictes, les gouvernements peuvent se sentir restreints. Si les gouvernements forcent les entreprises à lever les restrictions, les entreprises peuvent avoir l'impression que leurs valeurs éthiques sont ignorées.

Dans ma recherche, je commence à comprendre comment cet événement pourrait façonner l'avenir de la politique en matière d'IA. D'autres entreprises d'IA observent de près. Elles réfléchissent à ce qu'elles feront si elles sont confrontées à une pression similaire. Les investisseurs regardent aussi, car de tels conflits peuvent affecter la croissance des affaires et les partenariats.

Cette situation montre que l'intelligence artificielle n'est plus seulement un outil technologique. Elle est devenue un atout stratégique. Elle relie la politique, l'éthique, l'économie et la sécurité nationale. L'issue de ce conflit influencera probablement la manière dont les entreprises d'IA et les gouvernements collaborent à l'avenir. Cela pourrait mener à de nouvelles lois, des contrats plus clairs et des débats publics plus forts sur jusqu'où l'IA devrait aller.

En termes simples, il s'agit d'un combat pour la responsabilité et l'autorité. Anthropic croit que des limites de sécurité sont nécessaires. Le gouvernement croit qu'un accès à des outils avancés est nécessaire. Les deux camps pensent qu'ils protègent l'avenir. La vraie question est de savoir comment ils trouvent un équilibre, car l'IA ne cessera pas de croître. Elle deviendra plus puissante, et ces types de conflits pourraient devenir plus courants dans les années à venir.