Je pensais autrefois que la fiabilité de l'IA s'améliorerait naturellement avec le temps, il suffisait de rendre les modèles plus grands, de leur fournir plus de données, de les entraîner plus longtemps et le problème des hallucinations disparaîtrait lentement. La réalité est que cela ne fonctionne pas vraiment comme ça. Les modèles deviennent plus fluides, oui, mais la fluidité n'est pas la même chose que la vérité. C'est là que le Mira Network a attiré mon attention.

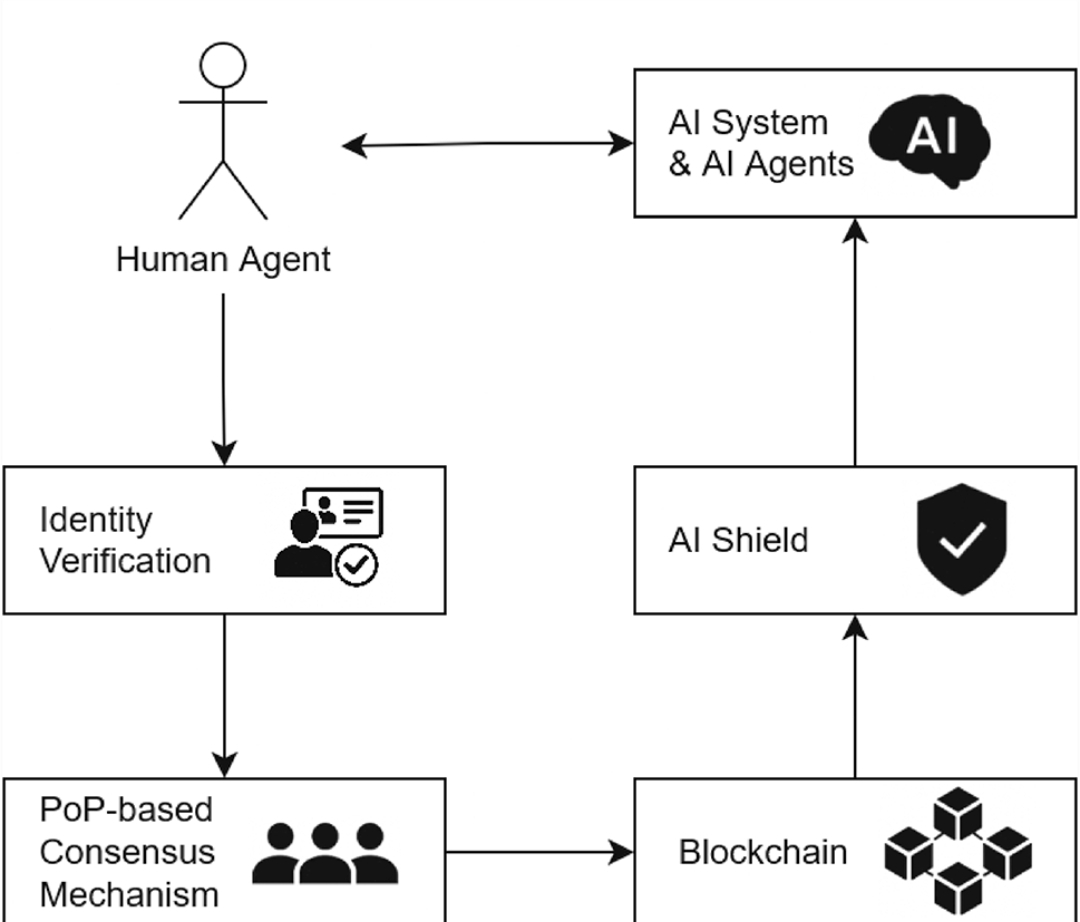

Mira n'essaie pas de rivaliser avec les grands laboratoires d'IA. Ce n'est pas un autre modèle promettant moins d'erreurs. Il est conçu comme une couche de vérification décentralisée qui se situe après que l'IA génère des résultats et avant que nous décidions de lui faire confiance. Cet emplacement est important. Au lieu de demander à un modèle d'être correct, Mira divise sa sortie en affirmations plus petites et répartit ces affirmations entre des validateurs indépendants. Ces validateurs, qui peuvent être des systèmes d'IA distincts, évaluent chaque affirmation et parviennent à un consensus en utilisant la coordination de la blockchain et des incitations économiques.

Ainsi, plutôt que de faire confiance à une seule réponse confiante, vous vous reposez sur un accord distribué. C'est un grand changement dans la façon dont nous pensons à la fiabilité de l'IA. Le registre blockchain enregistre les décisions de validation et la structure d'incitation encourage une évaluation honnête. Les validateurs ont un intérêt dans le processus, ce qui signifie que l'imprudence a des conséquences. La vérité devient quelque chose qui est imposé par des incitations, pas seulement par la réputation.

Ce qui rend cela pertinent maintenant, c'est l'essor des agents IA autonomes. Tant que les humains vérifient les résultats, les dommages causés par les hallucinations restent limités. Mais une fois que les systèmes IA commencent à exécuter des transactions financières, à approuver des flux de travail ou à générer des recherches utilisées pour des décisions sérieuses, la tolérance à l'erreur diminue. Vous avez besoin de résultats qui sont audités et vérifiables, pas seulement persuasifs.

Mira suppose que des hallucinations se produiront. Elle conçoit autour de ce fait au lieu de prétendre qu'elles disparaîtront. Cela semble réaliste. Bien sûr, il y a des questions ouvertes sur la scalabilité, la latence et la diversité des validateurs. Décomposer un raisonnement complexe en affirmations atomiques n'est pas trivial et les risques de collusion doivent être gérés avec soin.

Cependant, la direction est claire. L'intelligence sans vérification ne se développe pas en toute sécurité. Mira se positionne comme l'infrastructure de confiance pour l'IA transformant des résultats probabilistes en informations soutenues par consensus. Cela peut ne pas être flamboyant, mais si l'IA continue à s'intégrer dans des systèmes critiques, des couches de vérification comme celle-ci ne seront pas optionnelles, elles seront nécessaires.