En 2026, je vais cesser de voir l'IA de la même manière. Avant, je pensais que l'IA n'était qu'une machine. Mais maintenant, je la vois comme un ami, comme quelque chose qui peut m'aider, pas seulement au travail. Je me sens étrange, je me sens nouveau. Tout change un peu.

Ce n'est pas parce qu'elle est devenue plus intelligente.

Mais parce que j'ai réalisé que la plupart des systèmes d'IA s'attendent encore à ce que nous leur fassions confiance aveuglément.

En tant que quelqu'un d'actif dans la crypto, le trading et la recherche d'infrastructures, j'ai vu ce que la confiance aveugle peut coûter. C'est exactement pourquoi, lorsque j'ai commencé à explorer Mira plus sérieusement en 2026, son architecture a attiré mon attention d'une manière différente. Ce n'était pas juste un autre projet d'IA. Il essayait de résoudre quelque chose de plus profond — le problème de la confiance au sein même de l'IA.

Laissez-moi expliquer cela à partir de ma réelle expérience.

Mon expérience de 2026 : Quand « Précis » n'était pas suffisant

Plus tôt cette année, j'ai testé plusieurs outils d'analyse basés sur l'IA pour la recherche de marché. Certains d'entre eux ont donné des insights très confiants. Graphiques propres. Prédictions solides. Scores de « précision » élevés annoncés partout.

Mais quand j'ai comparé des sorties pendant des conditions de marché volatiles, j'ai remarqué quelque chose d'inconfortable. Deux outils différents ont donné des conclusions complètement différentes en utilisant des données similaires. Les deux ont revendiqué une haute précision.

C'est à ce moment-là que j'ai réalisé quelque chose d'important : les pourcentages de précision ne vous protègent pas dans des décisions en temps réel.

C'est ici que Mira a semblé différente.

Au lieu de se concentrer uniquement sur la performance du modèle, le système de Mira se concentre sur la vérification de chaque affirmation. Ce changement peut sembler technique, mais en pratique, cela change tout.

Pourquoi le consensus blockchain est important dans l'architecture de Mira

Dans la crypto, nous comprenons déjà le consensus blockchain. Des réseaux comme Ethereum ont prouvé que vous n'avez pas besoin d'une autorité centrale pour vous mettre d'accord sur les transactions. Plusieurs validateurs indépendants confirment ce qui est vrai.

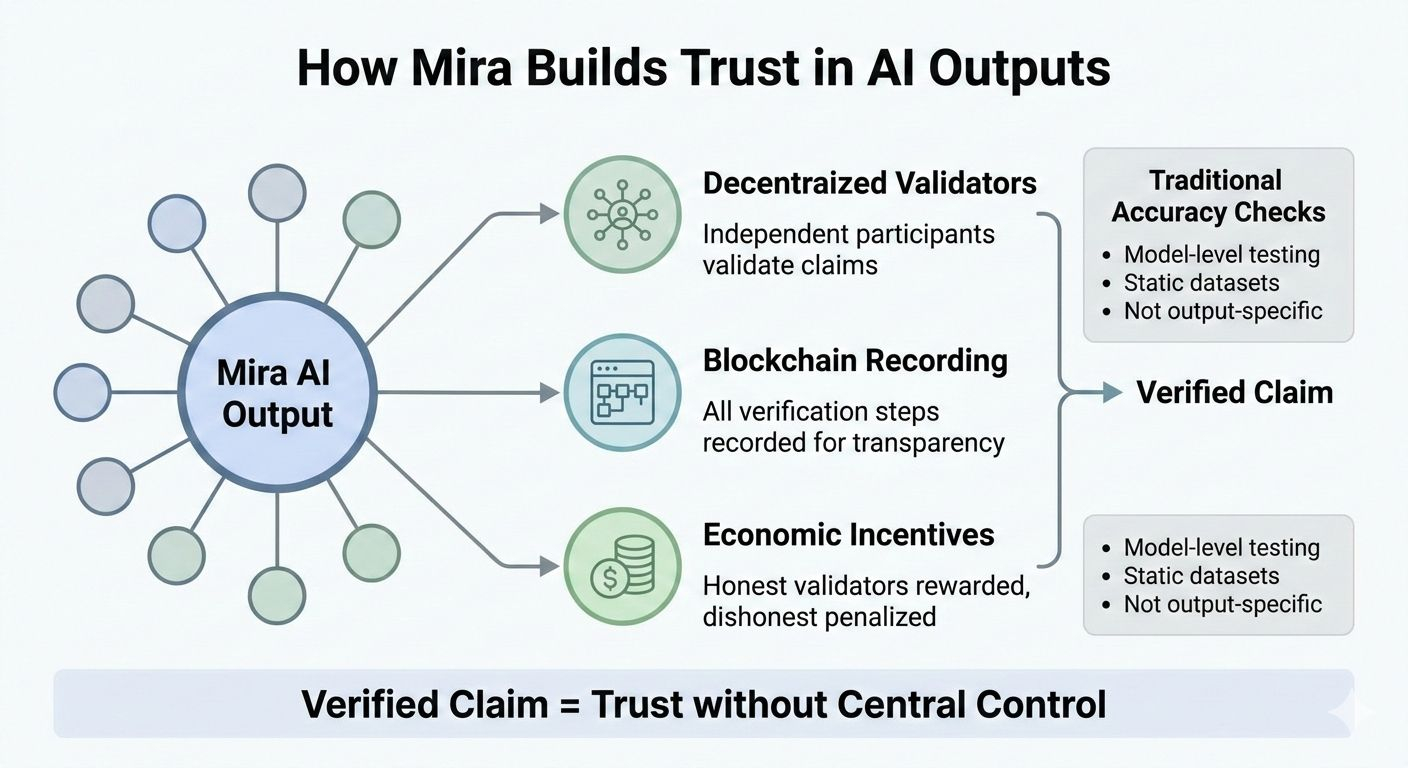

Mira applique ce même principe aux sorties d'IA.

En termes simples, au lieu qu'un système central dise : « Ce résultat d'IA est correct », Mira permet aux participants décentralisés de valider et de s'accorder sur le fait qu'une revendication répond aux normes de vérification.

En 2026, avec des outils d'IA partout — bots de trading, tableaux de bord de recherche, agents automatisés — cela compte plus que jamais.

Les modèles d'IA génèrent des sorties probabilistes. Ils prédisent des réponses probables. Ils ne garantissent pas de certitude.

Sans validation soutenue par le consensus, vous faites confiance à une boîte noire.

Avec l'architecture de Mira, la vérification est ancrée par un accord décentralisé. La revendication est évaluée, validée et enregistrée de manière transparente. Cela réduit le risque de point de défaillance unique.

Pour moi, en tant que créateur et investisseur en crypto, cela s'aligne parfaitement avec la philosophie de la blockchain : ne faites pas confiance, vérifiez.

La différence entre la vérification de Mira et les contrôles de précision traditionnels

La plupart des systèmes d'IA traditionnels reposent sur des tests de référence. Ils entraînent un modèle, le testent sur des ensembles de données connus, et publient un score de précision.

C'est utile — mais limité.

Dans les marchés réels, les conditions changent rapidement. De nouvelles données apparaissent. Des événements inattendus se produisent. L'exactitude historique ne garantit pas la justesse actuelle.

Mira déplace l'accent de l'exactitude générale à la vérification au niveau des revendications.

Au lieu de dire : « Ce modèle est 94 % précis dans l'ensemble », Mira évalue si une sortie spécifique peut être qualifiée de revendication vérifiable.

Cela signifie : – La sortie doit être structurée clairement.

– Elle doit être testable ou reproductible.

– Elle doit passer les normes de validation décentralisées.

Cette différence est critique.

L'IA traditionnelle dit : « Faites confiance à nos indicateurs de performance. »

Mira dit : « Vérifiez cette sortie spécifique. »

Lors de mes tests de 2026, cette distinction a changé ma manière d'évaluer les insights pilotés par l'IA. Je ne regarde plus seulement la réputation du modèle. Je regarde si le système fournit une preuve vérifiable pour chaque affirmation.

Comment Mira garantit la confiance sans contrôle centralisé

Un des plus grands risques dans la technologie est le contrôle centralisé.

Si une entreprise contrôle la validation, elle contrôle le récit. Elle peut filtrer les sorties, ajuster les résultats, ou devenir un goulot d'étranglement réglementaire. Même si les intentions sont bonnes, le risque demeure.

Mira supprime cette dépendance grâce à trois principes fondamentaux.

Premièrement, les validateurs décentralisés participent à la révision des revendications d'IA. Aucun validateur unique ne décide du résultat.

Deuxièmement, le processus de vérification est transparent et enregistré de manière à pouvoir être audité. Cela crée de la responsabilité.

Troisièmement, les incitations économiques alignent le comportement. Les participants sont récompensés pour une validation honnête et découragés de la manipulation. Cela est similaire à la manière dont les réseaux blockchain sécurisent des milliards de valeur aujourd'hui.

D'un point de vue infrastructurel, ce design est solide car il distribue la confiance au lieu de la concentrer.

Pourquoi cela compte pour les investisseurs en 2026

En 2026, l'IA n'est plus expérimentale. Elle est intégrée dans des systèmes de trading, des outils de gestion des risques, des plateformes de recherche et des agents automatisés.

À mesure que l'adoption augmente, le coût des mauvaises sorties augmente également.

Si les revendications générées par l'IA influencent les décisions financières, les contrats intelligents, ou les agents automatisés, alors la vérification devient une infrastructure critique — pas juste une fonctionnalité.

Mira ne construit pas simplement un autre modèle d'IA. Elle construit une couche de vérification.

D'un point de vue investissement, les couches d'infrastructure détiennent souvent une valeur à long terme. Tout comme le consensus blockchain est devenu fondamental pour la DeFi, la vérification de l'IA pourrait devenir fondamentale pour les économies pilotées par l'IA.

Les projets qui résolvent la confiance au niveau de base deviennent souvent profondément ancrés dans les écosystèmes.

C'est pourquoi je vois l'architecture de Mira comme plus qu'un battage médiatique. Elle aborde un réel écart structurel entre la capacité de l'IA et la responsabilité de l'IA.

Le plus grand changement : de l'autorité à la preuve

Ce que j'apprécie le plus chez Mira en 2026, c'est ce changement de mentalité.

Les systèmes d'IA traditionnels dépendent de l'autorité.

Les systèmes blockchain dépendent du consensus.

Mira fusionne ces mondes.

Au lieu de demander aux utilisateurs de faire confiance à un fournisseur central, elle construit des mécanismes où les sorties peuvent être validées collectivement.

C'est particulièrement important à mesure que les agents autonomes d'IA commencent à interagir avec les systèmes financiers et les contrats intelligents. Si ces agents opèrent sans sorties vérifiables, le risque systémique augmente rapidement.

En intégrant le consensus blockchain dans la vérification de l'IA, Mira introduit la responsabilité au niveau de la sortie.

Dernières réflexions

D'après mon expérience en 2026, la plus grande leçon est simple : l'IA est puissante, mais l'IA non vérifiée est risquée.

Le consensus blockchain à l'intérieur de l'architecture de Mira compte car il supprime les points de confiance uniques.

Son modèle de vérification compte car il valide des revendications spécifiques, pas seulement la réputation du modèle.

Et son design décentralisé compte car il construit la confiance sans s'appuyer sur un contrôle centralisé.

Alors que l'IA continue de façonner les marchés et les systèmes numériques, la vraie question devient claire.

Allons-nous construire l'avenir uniquement sur la confiance — ou sur un consensus vérifiable ?

Pour moi, la réponse est évidente.

\u003cm-254/\u003e \u003ct-256/\u003e\u003cc-257/\u003e