Je pensais autrefois que le problème d'hallucination dans l'intelligence artificielle était un défaut architectural permanent avec lequel nous devions simplement vivre, mais j'étais aveugle à la recherche. La norme commune dans l'industrie est de s'appuyer sur une supervision humaine pour chaque sortie critique, ce que la plupart des développeurs défendent comme le seul moyen d'assurer la sécurité. Je pensais que ce processus de vérification manuel et encombrant n'était qu'une taxe inévitable pour utiliser des modèles de langage de grande taille dans un travail professionnel. Nous avons été coincés dans un cycle ennuyeux où nous échangeons la vitesse contre la précision, ou la vie privée contre la performance, en supposant qu'un seul modèle centralisé pourrait finalement résoudre ses propres erreurs logiques par une simple échelle.

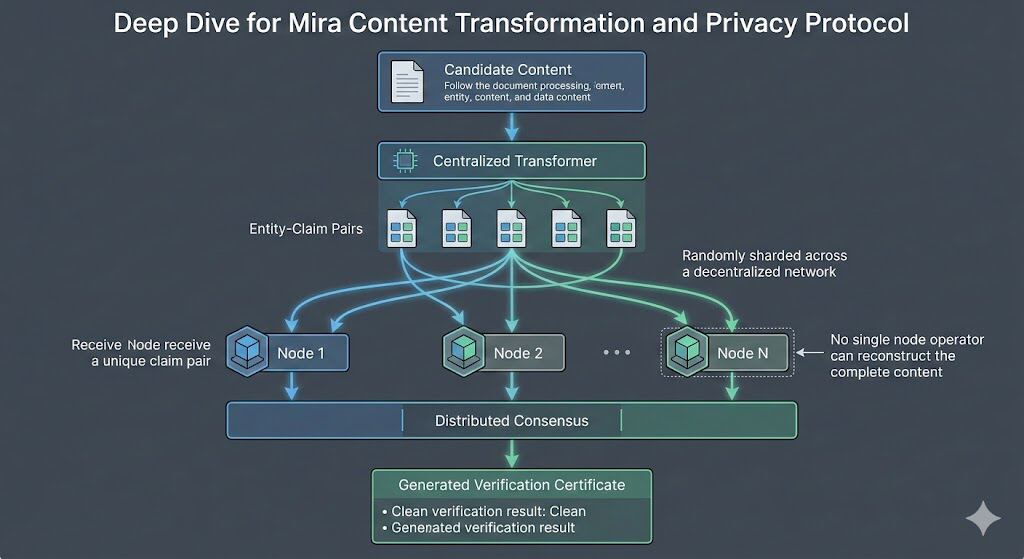

Mira prouve que cette théorie est fausse en mettant en œuvre ce qu'ils appellent la transformation de contenu décentralisée. Au lieu d'un seul modèle en boîte noire devinant la vérité, le réseau décompose le contenu complexe en paires entité-requête et les répartit à travers une carte de nœuds distribuée. Cela garantit qu'aucun opérateur unique ne voit l'ensemble du tableau, protégeant la vie privée pendant que le réseau collectif vérifie l'intégrité des données. C'est un pivot architectural astucieux qui garde les informations sensibles fragmentées pendant que le mécanisme de consensus gère la recherche de la vérité. En veillant à ce qu'aucun opérateur de nœud ne puisse reconstruire le contenu candidat complet, Mira protège la vie privée des clients tout en maintenant l'intégrité absolue du processus de vérification lui-même. C'est l'équivalent numérique d'un coffre-fort haute sécurité où trois personnes différentes détiennent trois clés différentes ; personne ne peut voler le coffre-fort seul, et les données ne bougent que lorsque toutes les clés sont présentes.

La raison pour laquelle c'est une si grande affaire est qu'elle tue enfin le compromis entre la vie privée et la précision. Je pense qu'il aurait été plus facile pour eux de simplement construire un autre filtre centralisé, mais à la place, ils se sont concentrés sur la réalité structurelle des données - que la vérification doit être privée pour être sécurisée. En gardant les réponses des nœuds cachées jusqu'à ce que le consensus soit atteint, le réseau empêche le type de fuite d'informations qui plague généralement le traitement des données collaboratives. Lorsque le consensus est atteint, le réseau génère des certificats contenant uniquement les détails de vérification nécessaires, pratiquant une forme de minimisation des données souvent ignorée dans le développement de l'IA moderne. Ce n'est pas juste un autre emballage de blockchain ; c'est une réécriture fondamentale de la façon dont les machines se parlent.

La décision de Mira de superposer cela directement à une structure d'incitation crypto-économique montre que la preuve d'inférence est plus précieuse que la preuve de travail traditionnelle. Au lieu de résoudre des énigmes arbitraires, les nœuds effectuent des calculs significatifs soutenus par une valeur mise en jeu. Cela signifie que le réseau ne devine pas simplement si une déclaration est vraie ; il crée une pénalité économique pour l'erreur. Cela établit un nouveau modèle pour convertir des données brutes et peu fiables en faits soutenus par la valeur. C'est la base de ce qu'ils appellent des faits économiquement sécurisés sur la blockchain, créant une base de connaissances vérifiées qui peut soutenir des systèmes de vérification de faits déterministes et des services d'oracle. Nous avons traité l'IA comme un narrateur fiable alors qu'elle est en réalité un moteur probabiliste ; Mira est le premier projet à traiter l'IA avec le scepticisme qu'elle mérite.

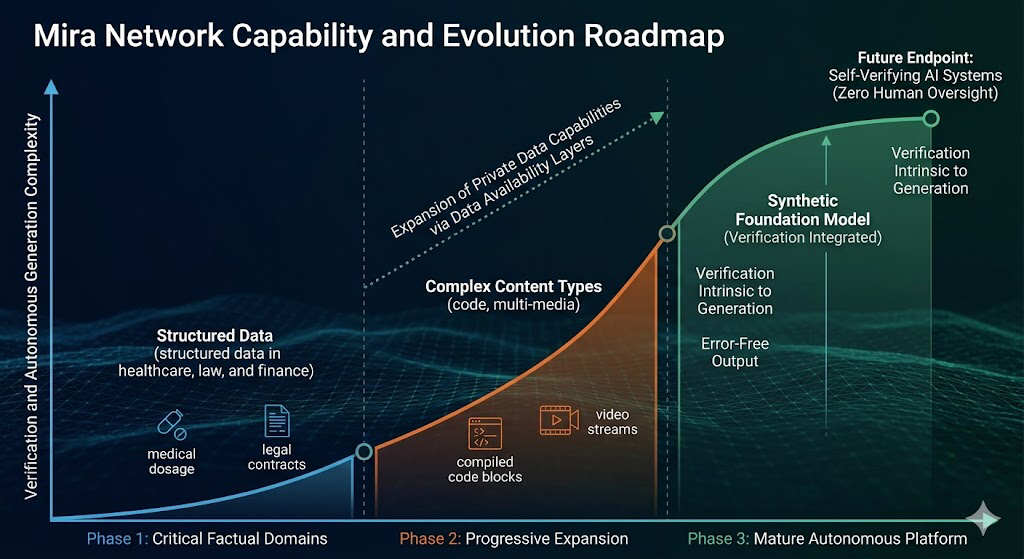

Je croyais autrefois que l'IA nécessiterait toujours un "superviseur humain" pour attraper ses erreurs, mais la progression de ce réseau suggère le contraire. La feuille de route passe de simples vérifications de validité à un système où la vérification est intrinsèque à la génération elle-même. Au départ, le réseau se concentre sur des domaines où la précision factuelle est critique et les risques de biais sont minimes, comme la santé, le droit et la finance. Imaginez une IA médicale vérifiant une recommandation de dosage contre un registre décentralisé de données évaluées par des pairs avant qu'elle n'atteigne l'écran d'un médecin - c'est le niveau de fiabilité dont nous parlons. Au fil du temps, il s'étend progressivement pour gérer des types de contenu de plus en plus complexes, y compris le code, les données structurées et le contenu multimédia. Ce n'est pas seulement une question de couverture plus large ; c'est un pas vers des systèmes d'IA plus sophistiqués et fiables qui peuvent réellement être dignes de confiance pour des décisions à enjeux élevés.

L'évolution culmine finalement dans un modèle fondamental synthétique qui élimine la distinction entre création et vérification. Il atteint des performances en temps réel sans sacrifier les normes rigoureuses requises par des secteurs sensibles. Cela représente une percée fondamentale car cela supprime la friction du "délai de vérification". En distribuant la vérification à travers un réseau décentralisé d'opérateurs incités, Mira crée une infrastructure qui est intrinsèquement résistante au contrôle centralisé. Cela empêche une seule entité de devenir l'arbitre de la vérité, ce qui constitue un risque significatif dans notre paysage actuel d'IA centralisée.

À l'avenir, je pense que cela deviendra l'infrastructure par défaut pour l'intelligence autonome. Nous cesserons de nous inquiéter de savoir si une IA "mente" ou "hallucine" car le réseau sous-jacent aura déjà vérifié la sortie contre une base de connaissances décentralisée. Cela représente un changement où nous cessons de gérer les erreurs de l'IA et commençons à nous concentrer sur les résultats de l'intelligence elle-même. Grâce à l'évolution continue des capacités techniques et des incitations économiques, le réseau permettra une nouvelle génération d'applications d'IA qui fonctionnent avec une fiabilité sans précédent.

Cela représente plus qu'une amélioration incrémentielle ; cela établit un nouveau paradigme où le fonctionnement sans erreur sans supervision humaine permet à l'IA de fonctionner enfin de manière autonome. Bien que les systèmes d'IA actuels excellent à générer des résultats créatifs et plausibles, ils échouent en matière de fiabilité. Mira aborde cela en rendant la manipulation à la fois techniquement et économiquement impraticable. En permettant aux systèmes d'IA de fonctionner sans supervision humaine, nous établissons la base d'une véritable intelligence artificielle - une étape cruciale vers le déblocage du potentiel transformateur de cette technologie dans toute la société. L'ancienne façon est morte. Nous avançons vers une réalité où la vérité n'est pas une suggestion, mais une certitude mathématique.

$MIRA @Mira - Trust Layer of AI #Mira