L'intelligence artificielle évolue plus rapidement que notre capacité à lui faire confiance.

Nous comptons désormais sur l'IA pour les signaux de trading, l'analyse des risques, la modération de contenu, les insights médicaux, et même les discussions sur la gouvernance. Mais voici la vérité inconfortable : la plupart des systèmes d'IA sont encore des boîtes noires. Vous obtenez une réponse. Vous ne savez pas pourquoi. Vous ne pouvez pas vérifier comment. Et vous ne pouvez certainement pas auditer ce qui s'est passé en coulisses.

Cet écart entre la sortie et la preuve est là où la prochaine narrative crypto se forme.

La crise de confiance dans l'IA

Dans la crypto, nous disons « ne faites pas confiance, vérifiez. »

Dans l'IA, nous faisons encore principalement confiance.

Cette contradiction devient critique.

Imaginez :

• Un modèle d'IA génère une stratégie de trading pour votre portefeuille.

• Un DAO utilise l'IA pour filtrer les propositions de subventions.

• Un protocole d'assurance Web3 s'appuie sur l'IA pour évaluer le risque.

Si cette IA est biaisée, manipulée ou mal configurée, qui est responsable ? Et plus important encore—comment quelqu'un peut-il vérifier indépendamment le résultat ?

C'est la faiblesse structurelle que Mira Network aborde.

Qu'est-ce que l'intelligence vérifiable ?

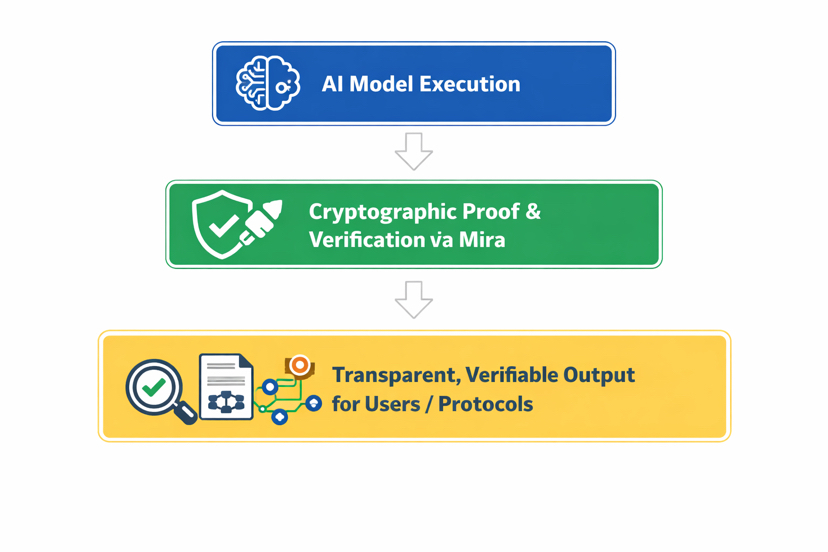

Mira Network introduit une idée simple mais puissante :

Les sorties de l'IA doivent être prouvables.

Au lieu de traiter l'IA comme un oracle mystérieux, Mira ajoute une couche de vérification qui permet de vérifier, valider et ancrer cryptographiquement les résultats des modèles. En termes pratiques, cela crée :

• Processus d'inférence transparents

• Résultats d'IA soutenus par des preuves

• Registres d'exécution résistants aux falsifications

• Validation minimisée en confiance

Ce n'est pas juste un marketing « IA + blockchain ». C'est une infrastructure conçue pour rendre l'IA responsable dans des systèmes décentralisés.

Scénario du monde réel : Pourquoi cela compte

Réduisons cela à la réalité.

Scénario 1 : Trading alimenté par l'IA

Une plateforme DeFi intègre l'IA pour générer des stratégies de rendement. Les utilisateurs déposent des capitaux en fonction des recommandations du modèle.

Sans vérification :

Vous faites confiance à l'affirmation de la plateforme selon laquelle « le modèle dit qu'il est optimal. »

Avec Mira :

La sortie de l'IA peut être validée. L'exécution peut être confirmée. Les paramètres peuvent être audités.

La différence est subtile—mais puissante. Elle passe d'une confiance aveugle à une preuve mesurable.

Scénario 2 : IA dans la gouvernance

Un DAO utilise l'IA pour résumer les propositions et les classer en fonction de l'évaluation de l'impact.

Sans intelligence vérifiable :

Les membres doivent faire confiance à l'algorithme de classement.

Avec Mira :

La logique de notation et les résultats d'inférence peuvent être vérifiés de manière indépendante, réduisant le risque de manipulation de la gouvernance.

C'est ici que l'IA rencontre les principes de la crypto.

Vision produit : La couche de confiance de l'IA

Mira Network se positionne comme une couche de confiance pour les systèmes d'IA. Pensez-y comme un middleware entre :

Modèles d'IA → Couche de vérification → Utilisateurs finaux

Cette architecture transforme l'IA d'un service centralisé en une utilité publique vérifiable.

Pourquoi ce récit est opportun

Nous entrons dans un cycle où les agents d'IA interagiront avec des contrats intelligents.

Bots de trading autonomes.

Gestion de liquidité pilotée par l'IA.

Notation de crédit sur chaîne.

Si ces systèmes fonctionnent sans preuve, ils introduisent un risque systémique.

L'intelligence vérifiable pourrait devenir aussi fondamentale que les audits de contrats intelligents l'étaient dans les débuts de DeFi.

Le marché commence à reconnaître que la prochaine vague n'est pas seulement une IA plus rapide—mais une IA digne de confiance.

Principes de partage d'esprit appliqués

1. Créativité : Redéfinir l'IA comme une infrastructure, pas seulement un logiciel

Mira reformule les sorties de l'IA comme des actifs nécessitant vérification. C'est un nouveau modèle mental.

Nous ne construisons pas seulement de meilleurs modèles.

Nous construisons une intelligence responsable.

Ce changement de cadre compte pour un positionnement à long terme.

2. Profondeur professionnelle : Résoudre un vrai problème technique

L'IA vérifiable n'est pas un récit superficiel. Elle touche :

• Systèmes de preuve cryptographique

• Validation décentralisée

• Environnements d'inférence sécurisés

• Calcul minimisé en confiance

Ce sont des domaines complexes. Les équipes qui résolvent cette intersection définiront comment l'IA s'intègre dans Web3 à grande échelle.

3. Pertinence : IA x Crypto est le méta actuel

Les jetons d'IA sont tendance.

Les agents d'IA sur chaîne émergent.

Les systèmes automatisés s'étendent dans la finance et la gouvernance.

Mais sans une couche de confiance, cette croissance devient fragile.

Le positionnement de Mira s'aligne directement avec ce besoin structurel.

Impact de la communauté et de l'écosystème

Pour les développeurs :

Vous obtenez un moyen de construire des dApps alimentées par l'IA sans obliger les utilisateurs à « simplement croire » votre modèle.

Pour les investisseurs :

Vous obtenez un cadre plus clair pour évaluer les projets d'infrastructure d'IA au-delà du battage médiatique.

Pour les utilisateurs :

Vous obtenez une visibilité sur la manière dont les décisions sont prises.

La confiance devient mesurable.

Et dans la crypto, la confiance mesurable s'accumule.

La plus grande question

La crypto a résolu la confiance dans l'argent.

Pouvons-nous maintenant résoudre la confiance dans l'intelligence ?

Si l'IA doit influencer les marchés, la gouvernance et l'identité dans Web3, la vérification doit-elle être optionnelle—ou obligatoire ?

L'intelligence vérifiable est-elle la prochaine couche fondamentale des systèmes décentralisés ?

@Mira - Trust Layer of AI #Mira #mira $MIRA