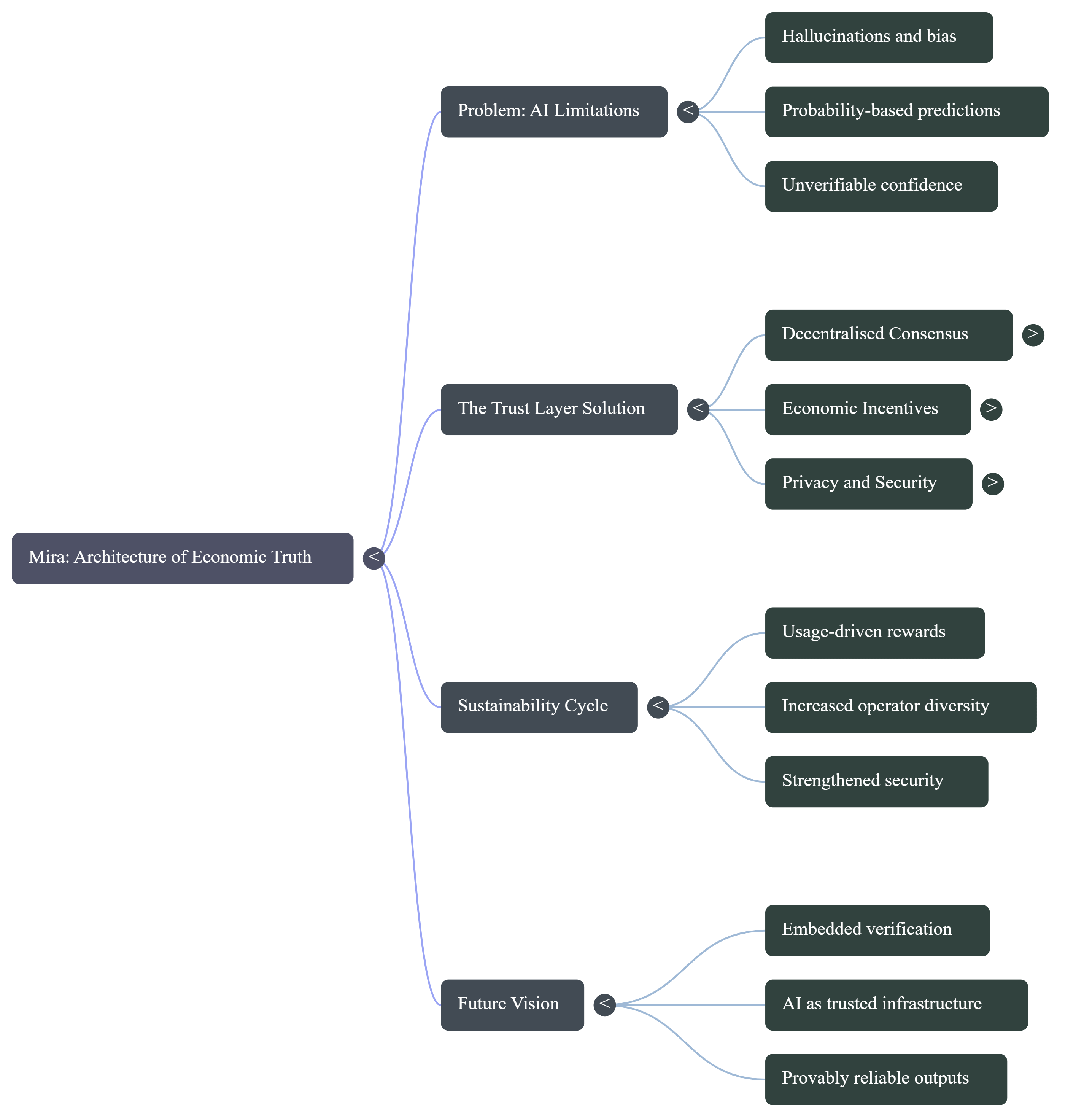

La plupart des systèmes d'IA aujourd'hui ont une faiblesse majeure.

Ils génèrent des réponses qui semblent confiantes, mais ils ne peuvent garantir qu'elles sont correctes. Les hallucinations et les biais ne sont pas des glitches rares. Ils proviennent de la façon dont de grands modèles sont construits. Ces systèmes prédisent des probabilités, pas des vérités vérifiées. Même lorsqu'ils sont ajustés, il semble qu'il y ait un taux d'erreur minimum qu'un seul modèle ne peut pas entièrement éliminer.

Mira commence avec une croyance différente.

Au lieu d'essayer de construire un modèle parfait, il construit un système où plusieurs modèles se vérifient mutuellement.

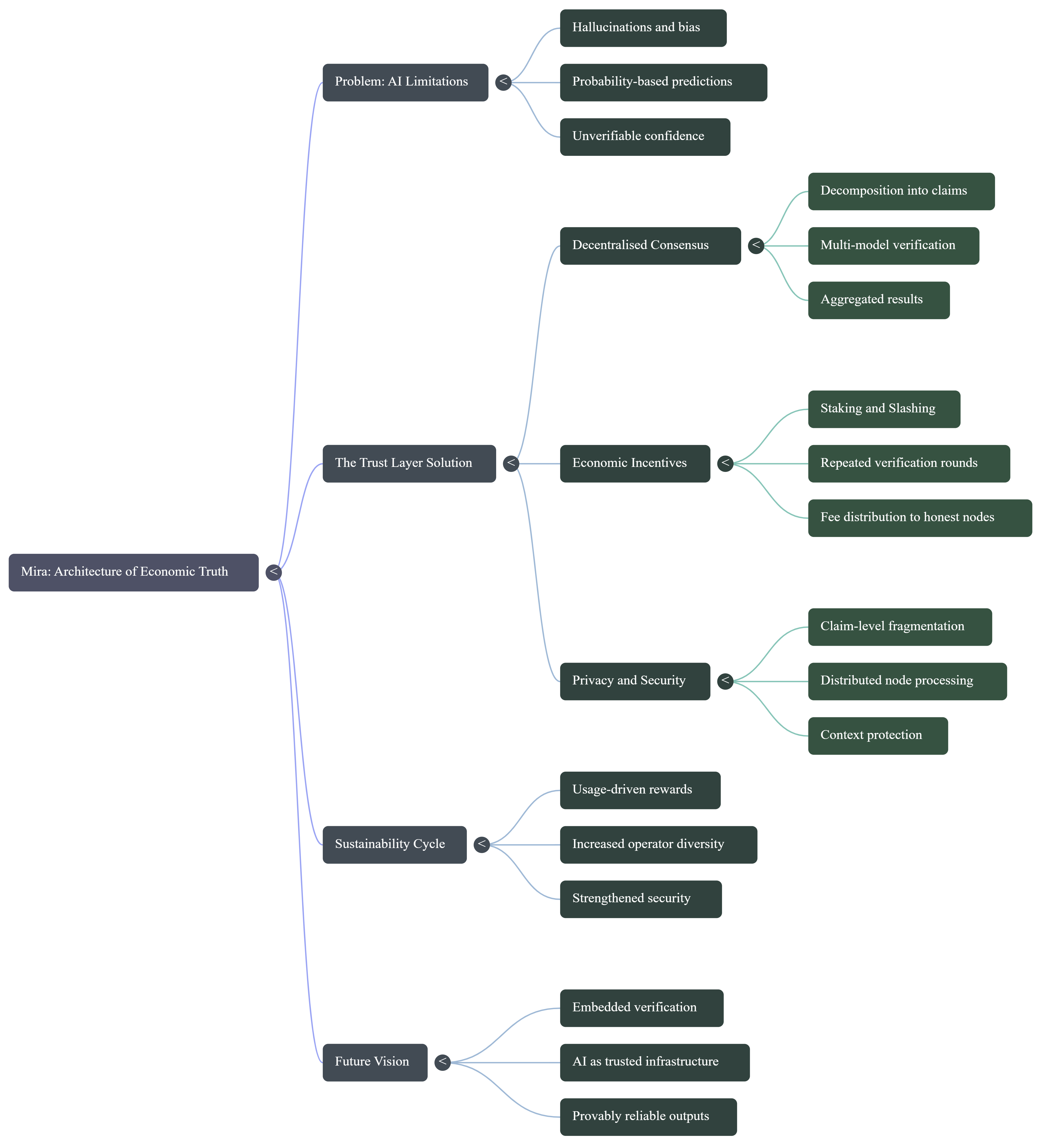

Selon le@Mira - Trust Layer of AI livre blanc, $MIRA transforme la sortie de l'IA en revendications plus petites et indépendantes. Par exemple, un long paragraphe est divisé en déclarations factuelles claires. Chaque déclaration est ensuite envoyée à différents nœuds vérificateurs. Ces nœuds exécutent leur propre inférence et soumettent un jugement. Le réseau agrège les réponses et produit un résultat de consensus.

Ce processus réduit à la fois l'hallucination et le biais, car aucun modèle unique ne contrôle le résultat.

Mais la vérification à elle seule ne suffit pas. Les incitations comptent.

$MIRA combine travail d'inférence et staking. Les validateurs doivent verrouiller de la valeur pour participer au réseau. S'ils essaient de manipuler le système en devinant des réponses ou en soumettant des réponses négligentes, ils risquent de perdre leur mise par le biais de la réduction.

Le livre blanc explique même pourquoi cela est nécessaire. Parce que les questions de vérification peuvent parfois ressembler à des tâches à choix multiples, il peut sembler attrayant de deviner au hasard. Mira aborde cela en exigeant des rondes de vérification répétées et des pénalités économiques. La probabilité de deviner correctement de manière cohérente chute fortement au fil des vérifications, rendant le comportement malhonnête statistiquement et économiquement irrationnel.

C'est ainsi que la durabilité est construite.

Les utilisateurs paient des frais pour des résultats vérifiés. Ces frais sont distribués aux opérateurs de nœuds honnêtes qui effectuent un véritable travail d'inférence. À mesure que l'utilisation augmente, les récompenses augmentent. À mesure que les récompenses augmentent, plus d'opérateurs rejoignent. À mesure que la diversité des opérateurs augmente, le biais diminue et la sécurité se renforce. Cela devient un cycle de renforcement.

Une autre couche importante est la confidentialité. Au lieu d'envoyer des documents complets à un seul validateur, le contenu est divisé en fragments au niveau des revendications et distribué à travers les nœuds. Aucun participant unique ne voit l'ensemble du contexte. Cela protège les informations sensibles tout en permettant toujours la vérification.

La vision à long terme va plus loin. Mira vise à passer de la vérification des résultats après génération à l'intégration de la vérification directement dans le processus de génération. Cela signifie construire des systèmes d'IA où la validation fait partie de la façon dont la réponse est créée, et non une réflexion secondaire.

En termes simples, Mira considère la vérité comme quelque chose qui doit être sécurisé économiquement.

Pas supposé.

Pas centralisé.

Mais vérifié par consensus décentralisé et incitations alignées.

Alors que l'IA devient une infrastructure pour la finance, la santé, le droit et l'automatisation, la confiance ne peut pas dépendre uniquement de la confiance elle-même. Elle doit dépendre de systèmes qui récompensent l'honnêteté et pénalisent la manipulation.

C'est la fondation que Mira essaie de construire.

Des systèmes comme $MIRA visent à construire la couche de confiance qui rend les sorties de l'IA non seulement convaincantes, mais également prouvablement fiables.

#Mira #MİRA #AIToken #cforcrypto