Les pistes d'audit de Mira pourraient être la solution. Dans un monde où la transparence et la responsabilité en IA sont incontournables, Mira permet aux organisations de suivre chaque décision, action et résultat, rendant possible la vérification et la confiance dans vos systèmes d'IA comme jamais auparavant. Imaginez un avenir où chaque choix algorithmique est ouvert à la révision et à l'amélioration ! Prêt à construire votre IA sur une base sur laquelle vous pouvez vous appuyer ? Découvrez pourquoi les pistes d'audit de Mira pourraient être la colonne vertébrale de l'IA vérifiable. Quelles questions avez-vous sur l'apport d'une véritable transparence à l'intelligence artificielle ?

Bien que la promesse de l'IA vérifiable continue de dominer le discours de l'industrie, peu de solutions offrent une approche pratique et transparente - c'est ici que Mira Audit prétend se démarquer. Pourtant, alors que les organisations se précipitent pour adopter des processus pilotés par l'IA, le besoin de pistes d'audit robustes n'a jamais été aussi urgent. Les pistes d'audit de Mira se positionnent comme des changeurs de jeu potentiels, mais leur adoption soulève des questions critiques.

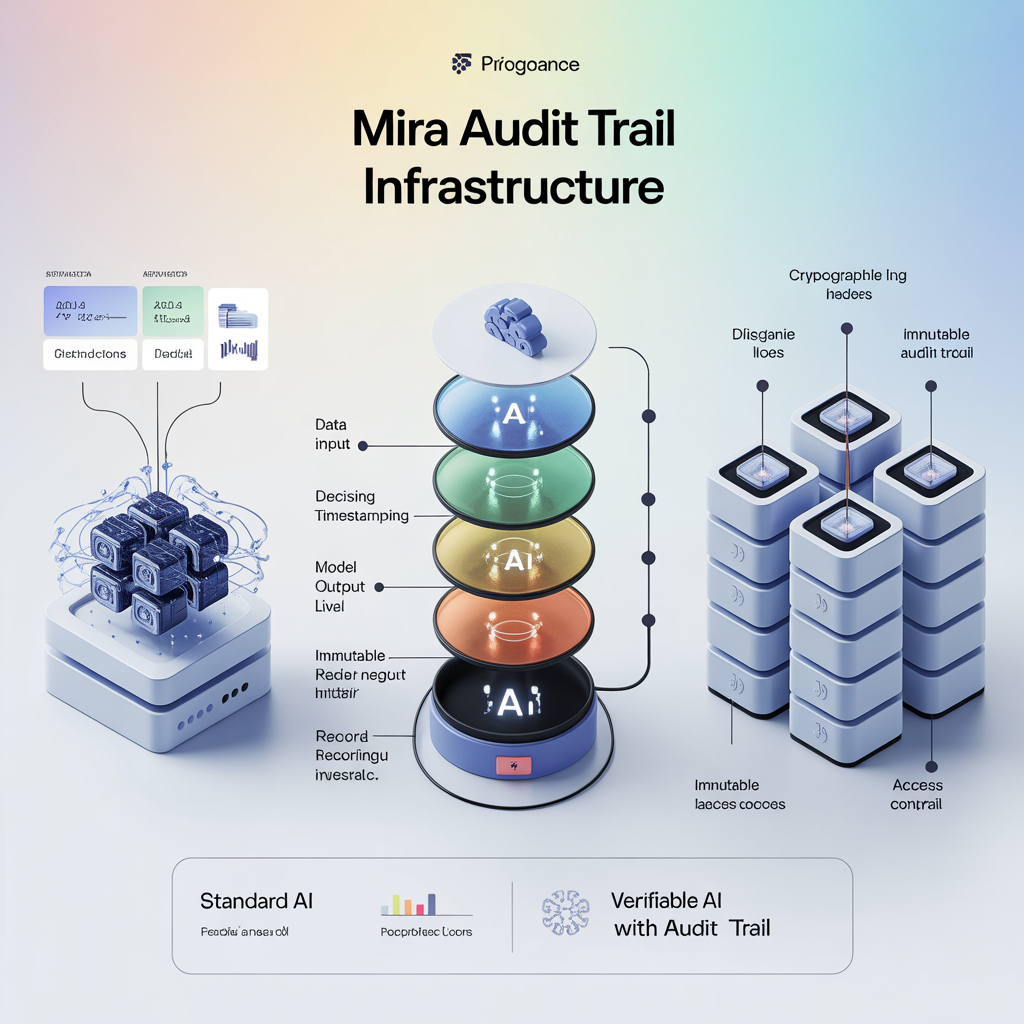

La force principale de Mira Audit réside dans sa tenue de dossiers détaillée et immuable : chaque décision prise par un système d'IA est enregistrée, horodatée et liée à des données d'entrée pertinentes. En théorie, cette transparence pourrait instaurer la confiance et permettre un examen indépendant. Cependant, les critiques soutiennent que le simple fait d'avoir une piste d'audit ne garantit pas automatiquement la responsabilité ou l'interprétabilité. Les organes de surveillance et les parties prenantes doivent encore naviguer dans une documentation technique complexe - un fardeau qui peut déplacer la responsabilité plutôt que de véritablement démocratiser l'accès.

De plus, bien que Mira Audit vante la traçabilité de bout en bout comme un pilier pour les systèmes d'IA vérifiables, il y a peu de contrôle public concernant la gestion de ces journaux d'audit ou qui contrôle l'accès aux dossiers sensibles. Le risque existe qu'un contrôle centralisé puisse compromettre l'objectivité et soulever de nouvelles préoccupations en matière de confidentialité.

En fin de compte, si l'IA vérifiable dépend de mécanismes d'audit dignes de confiance comme ceux offerts par Mira Audit Trails, l'industrie doit interroger rigoureusement non seulement ce qui est enregistré, mais aussi comment la transparence se traduit par une responsabilité significative pour toutes les parties impliquées.

#Mira @Mira - Trust Layer of AI $MIRA #MarketSentimentToday #MarketUpdate #UsaAttack #IranIsraelConflict