Après avoir utilisé des outils d'IA pendant un certain temps, j'ai constaté une chose : le problème n'est plus vraiment l'intelligence.

La plupart des systèmes modernes sont déjà suffisamment performants pour être utiles. Ils peuvent synthétiser des recherches, écrire du code, analyser des données et expliquer des concepts complexes en quelques secondes. Cette partie de la technologie progresse rapidement.

Le point qui reste encore à résoudre est celui de la fiabilité.

Les systèmes d'IA ont cette étrange habitude de paraître sûrs d'eux, même lorsqu'ils se trompent légèrement. La réponse peut sembler impeccable, structurée et convaincante, mais dès qu'on examine les détails, on découvre parfois de petites erreurs dissimulées sous la surface.

Cette expérience devient plus perceptible plus vous comptez sur ces outils.

Vous commencez à vérifier à deux fois les sorties importantes.

Vous comparez les résultats entre différents modèles.

Vous vérifiez les nombres avant de les utiliser.

Ce qui signifie que la responsabilité de la confiance repose toujours sur l'humain.

C'est le fossé où le Mira Network commence à avoir du sens.

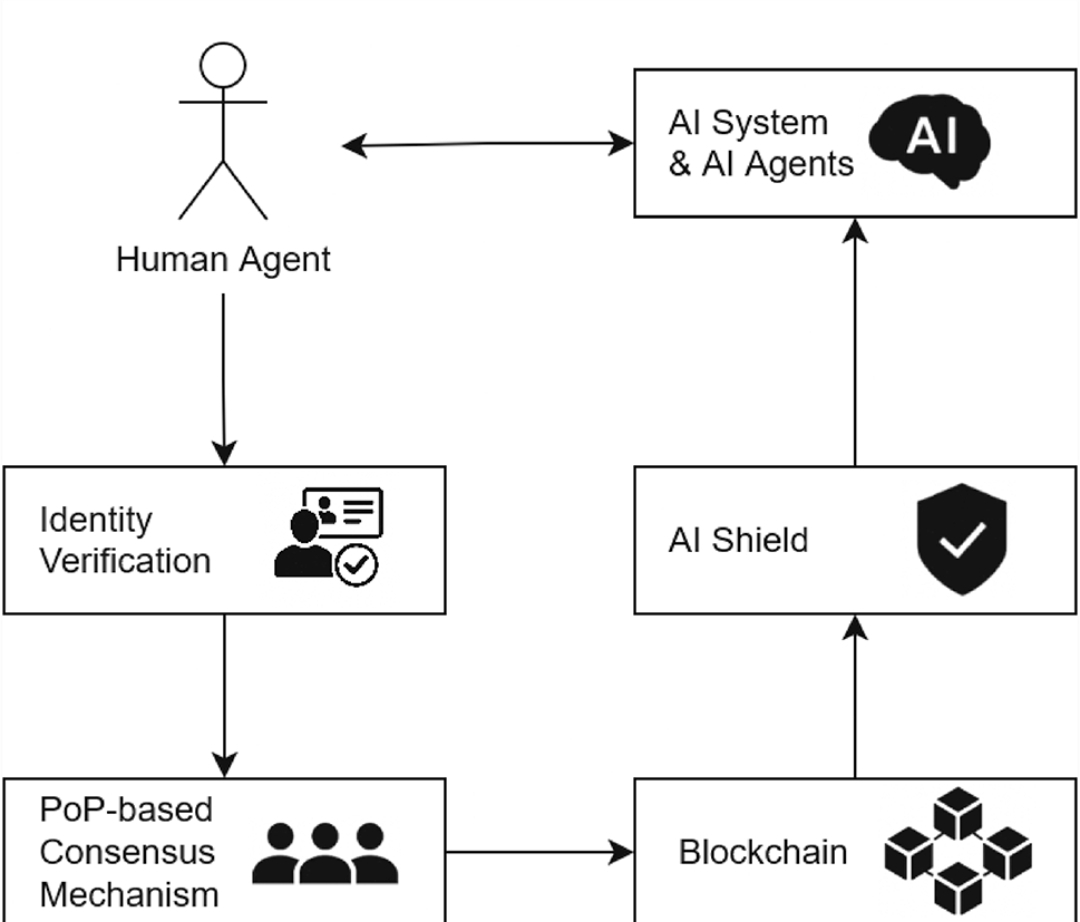

Mira n'essaie pas de rivaliser avec les entreprises construisant des modèles plus grands. Elle aborde le problème sous un angle différent. Au lieu de rendre les réponses de l'IA plus convaincantes, elle se concentre sur la vérification de la fiabilité de ces réponses.

L'idée derrière le protocole est assez simple une fois que l'on prend du recul.

Lorsqu'un système d'IA produit une réponse, Mira ne traite pas cette sortie comme un seul morceau d'information. Au lieu de cela, elle décompose la réponse en petites revendications qui peuvent être évaluées individuellement.

Ces revendications sont ensuite distribuées à travers un réseau de validateurs indépendants.

Chaque validateur — qui peut lui-même être un système d'IA — vérifie la revendication et soumet une évaluation. Le réseau parvient à un accord grâce à la coordination de la blockchain et aux incitations économiques.

Ainsi, au lieu de faire confiance à la confiance d'un modèle, le système s'appuie sur un consensus distribué.

Cette approche modifie considérablement le modèle de confiance.

En ce moment, la plupart des systèmes d'IA fonctionnent sous une vérification centralisée. Si quelque chose va mal, la responsabilité repose sur l'entreprise qui a construit le modèle. Mira remplace cette structure par un réseau où la validation se fait collectivement et de manière transparente.

Les incitations économiques jouent également un rôle.

Les validateurs sont récompensés pour une vérification précise et pénalisés pour une validation incorrecte. Cela crée un système où l'honnêteté est économiquement alignée avec la santé du réseau.

La conception devient particulièrement intéressante lorsque l'on pense à la direction que prend l'IA.

Aujourd'hui, l'IA assiste principalement les humains. Elle génère des brouillons, des idées et des suggestions que les gens examinent avant d'agir. Mais cette relation commence déjà à changer.

Les agents d'IA commencent à interagir avec les systèmes financiers.

Ils exécutent des tâches automatisées à travers des plateformes.

Ils traitent de grands volumes d'informations sans supervision humaine constante.

Dans ces environnements, 'probablement correct' n'est pas suffisant.

Si un système autonome prend des décisions ou déclenche des actions, les informations sur lesquelles il s'appuie nécessitent un standard de vérification plus élevé. C'est là qu'un protocole comme Mira commence à ressembler moins à une expérience et plus à une infrastructure.

Le système suppose que les hallucinations et les biais continueront d'exister dans les modèles d'IA. Au lieu de prétendre que ces problèmes disparaissent avec l'échelle, il construit un cadre qui peut vérifier les sorties après leur génération.

En d'autres termes, Mira considère l'intelligence et la vérification comme deux couches séparées.

Les modèles génèrent des idées.

Le réseau les vérifie.

Il reste encore des défis à relever. La décomposition des revendications doit être précise. La diversité des validateurs doit empêcher les biais partagés. La vérification doit rester suffisamment efficace pour être pratique.

Mais la direction semble logique.

À mesure que les systèmes d'IA se rapprochent d'une opération autonome, la question la plus importante peut ne plus être à quel point ils sont intelligents.

Il peut s'agir de savoir si leurs sorties peuvent réellement être fiables.

Et c'est exactement le problème que Mira Network essaie de résoudre.