J'ai observé l'évolution rapide de l'IA. Plus rapide que la plupart des industries ne peuvent l'absorber. Ce qui me dérange, ce n'est pas à quel point les modèles semblent intelligents. C'est à quel point l'idée de certitude est encore fragile.

Quand je regarde @Mira - Trust Layer of AI , je ne vois pas un autre projet d'IA poursuivant des références de performance. Je vois une tentative de réparer quelque chose de plus profond. La confiance.

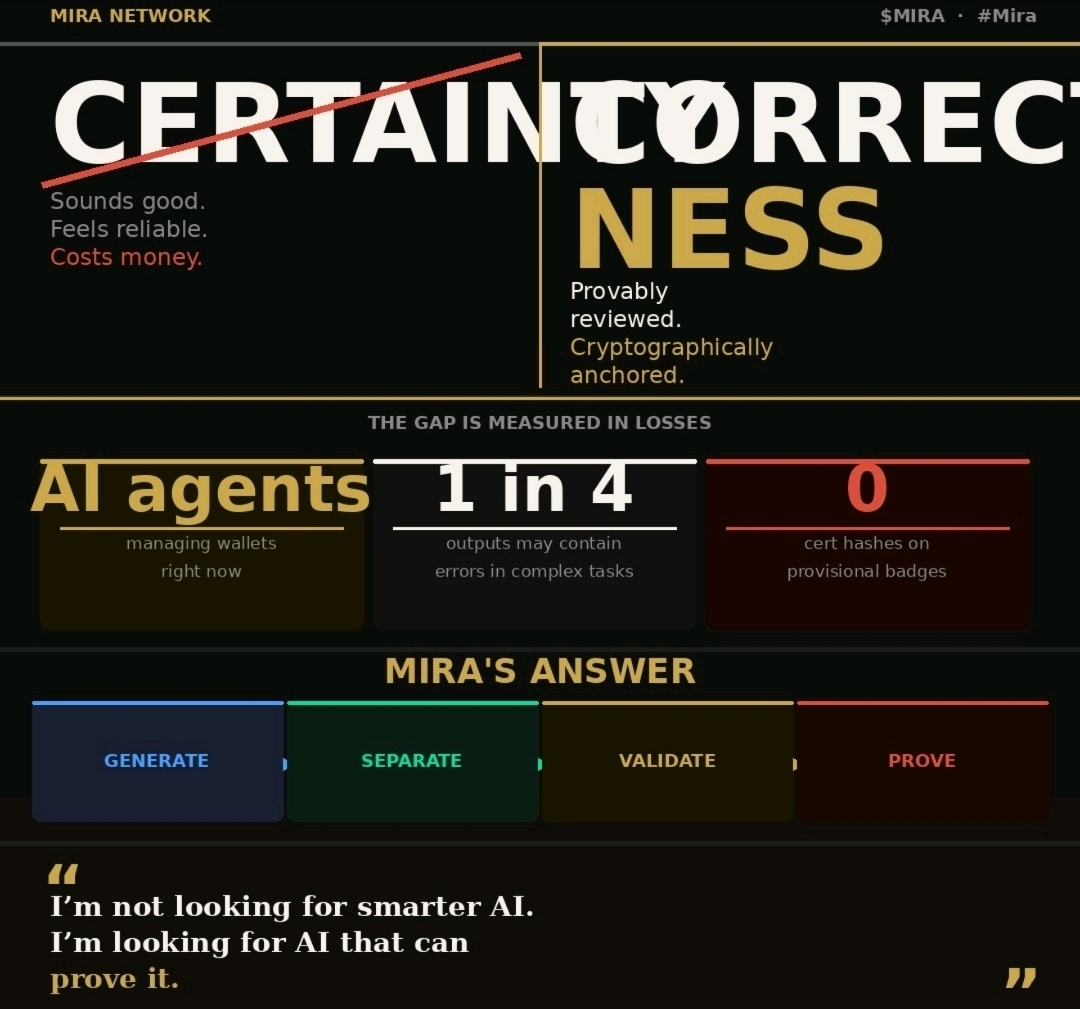

L'IA d'aujourd'hui fonctionne sur des probabilités. Elle prédit. Elle approxime. Elle génère des résultats qui semblent raffinés, structurés, confiants. Mais la probabilité n'est pas une preuve. Et dans des domaines comme la modélisation financière, la conformité, les données médicales — être proche n'est pas suffisant. J'ai appris cela à mes dépens dans la crypto. Être proche peut encore vous coûter cher.

Ce qui me frappe, c'est la façon dont Mira traite chaque sortie d'IA comme provisoire. Pas final. Pas sacré. Juste… un brouillon qui nécessite un examen. Au lieu d'avaliser une réponse dans son intégralité, le système la décompose en pièces logiques plus petites. Chaque pièce peut être testée individuellement. Cela semble plus honnête. Peut-être plus lent. Mais honnête.

Et la vérification ne vient pas d'une autorité centrale. Des nœuds validateurs indépendants interviennent. Différents participants. Différents modèles. Un genre de scepticisme distribué. J'aime cette idée. Accord par consensus, pas par hypothèse.

Il y a aussi la couche blockchain qui soutient la transparence. Enregistrements. Confirmations de validation. Journaux d'activité. Tous stockés dans un environnement de registre où la falsification n'est pas simple. Les contrats intelligents régissent le staking, le routage, les incitations. Pas de supervision manuelle nécessaire chaque seconde. Les règles s'exécutent d'elles-mêmes.

L'économie des jetons joue également un rôle. L'actif natif n'est pas seulement une décoration spéculative. Il est lié au staking, aux flux de transactions, à la gouvernance. Les participants engagent du capital. Cet engagement change le comportement. Lorsque les gens ont des enjeux, les incitations évoluent. La manipulation devient coûteuse.

Je trouve le modèle de sécurité hybride intéressant aussi. Un mélange de contribution computationnelle et de staking de capital. Éléments de Proof of Work. Éléments de Proof of Stake. C'est une tentative d'équilibrer la résilience avec l'alignement économique. Pas parfait. Mais délibéré.

Au-delà de la simple vérification, il y a une ambition de tokeniser la participation au monde réel. Gouvernance fractionnée. Représentation numérique structurée. Cela pousse Mira au-delà de la validation des logiciels vers le territoire des infrastructures. C'est là que les choses deviennent plus grandes.

Les cas d'utilisation sont évidents. Diagnostics de santé. Conformité réglementaire. Révision légale. Modélisation des risques d'entreprise. Dans tous ces domaines, l'exactitude des résultats a du poids. Poids financier. Poids légal. Parfois poids humain.

Pour moi, $MIRA ne concerne pas la construction d'une IA plus intelligente. Il s'agit de construire une IA qui peut résister à l'examen. Qui peut être contestée. Qui peut être auditée. L'intelligence seule accroît le risque. L'intelligence vérifiée accroît la confiance.

Et en ce moment, la confiance est ce qui manque le plus à l'écosystème IA.