L'intelligence artificielle est partout aujourd'hui. Elle écrit des articles, répond à des questions, crée des images, analyse des données et aide même les entreprises à prendre des décisions. L'IA semble puissante et excitante, et parfois presque magique. Mais il y a un problème caché que de nombreuses personnes commencent à remarquer.

L'IA peut sembler extrêmement confiante même lorsqu'elle a tort.

Ce problème crée un profond problème de confiance. Si l'intelligence artificielle doit aider à gérer des entreprises, guider la recherche, assister des médecins ou alimenter des systèmes autonomes, alors les gens doivent faire confiance aux réponses qu'elle fournit. Sans confiance, l'IA devient risquée.

C'est exactement le défi que le réseau Mira essaie de résoudre.

Le réseau Mira construit un système qui aide à transformer les réponses de l'IA en information vérifiée. Au lieu de faire confiance aveuglément à ce qu'un seul modèle d'IA dit, Mira introduit un réseau qui vérifie la réponse avant que quiconque ne s'y fie.

En termes simples, Mira veut devenir une couche de confiance pour l'intelligence artificielle.

Le grand problème avec l'IA moderne

Les modèles d'IA sont formés sur d'énormes quantités de données. Ils apprennent des modèles à partir de livres, de sites Web, d'articles et de conversations. Grâce à cela, ils peuvent générer des réponses qui semblent naturelles et intelligentes.

Mais l'IA ne comprend pas vraiment la vérité de la manière dont les humains le font.

Il prédit le mot suivant le plus probable en fonction des modèles. Parfois, ces modèles mènent à des réponses correctes. D'autres fois, ils mènent à des erreurs qui semblent crédibles.

Ceci est connu sous le nom d'hallucination de l'IA.

Une IA pourrait créer des faits qui n'ont jamais existé. Elle pourrait référencer des études qui sont complètement inventées. Elle pourrait expliquer quelque chose de manière confiante qui est en réalité incorrect.

Imaginez compter sur l'IA pour des conseils médicaux, des recherches juridiques ou des analyses financières et recevoir des informations incorrectes sans le réaliser. Les conséquences pourraient être graves.

C'est pourquoi de nombreux experts disent que le plus grand élément manquant dans l'IA aujourd'hui n'est pas l'intelligence mais la confiance.

Et c'est là que le réseau Mira entre en jeu.

L'idée derrière le réseau Mira

Le réseau Mira est conçu pour rendre l'IA plus fiable en vérifiant ses sorties.

Au lieu de faire confiance à un seul système d'IA, Mira crée un réseau où de nombreux modèles indépendants vérifient ensemble la réponse.

Pensez à cela comme demander à plusieurs experts la même question. Si tous arrivent à la même conclusion, la confiance dans la réponse devient beaucoup plus forte.

Mira applique cette idée en utilisant la technologie.

Lorsque l'IA génère une réponse, Mira ne l'accepte pas immédiatement comme vérité. Au lieu de cela, le système décompose la réponse en déclarations plus petites et les envoie à travers un réseau décentralisé où différents modèles d'IA les examinent.

Si suffisamment de modèles s'accordent à dire que l'information est correcte, le système marque la réponse comme vérifiée.

S'il y a désaccord, la réponse peut être signalée ou remise en question.

L'objectif est simple mais puissant. Transformer la sortie de l'IA de quelque chose d'incertain en quelque chose de vérifié par l'intelligence collective.

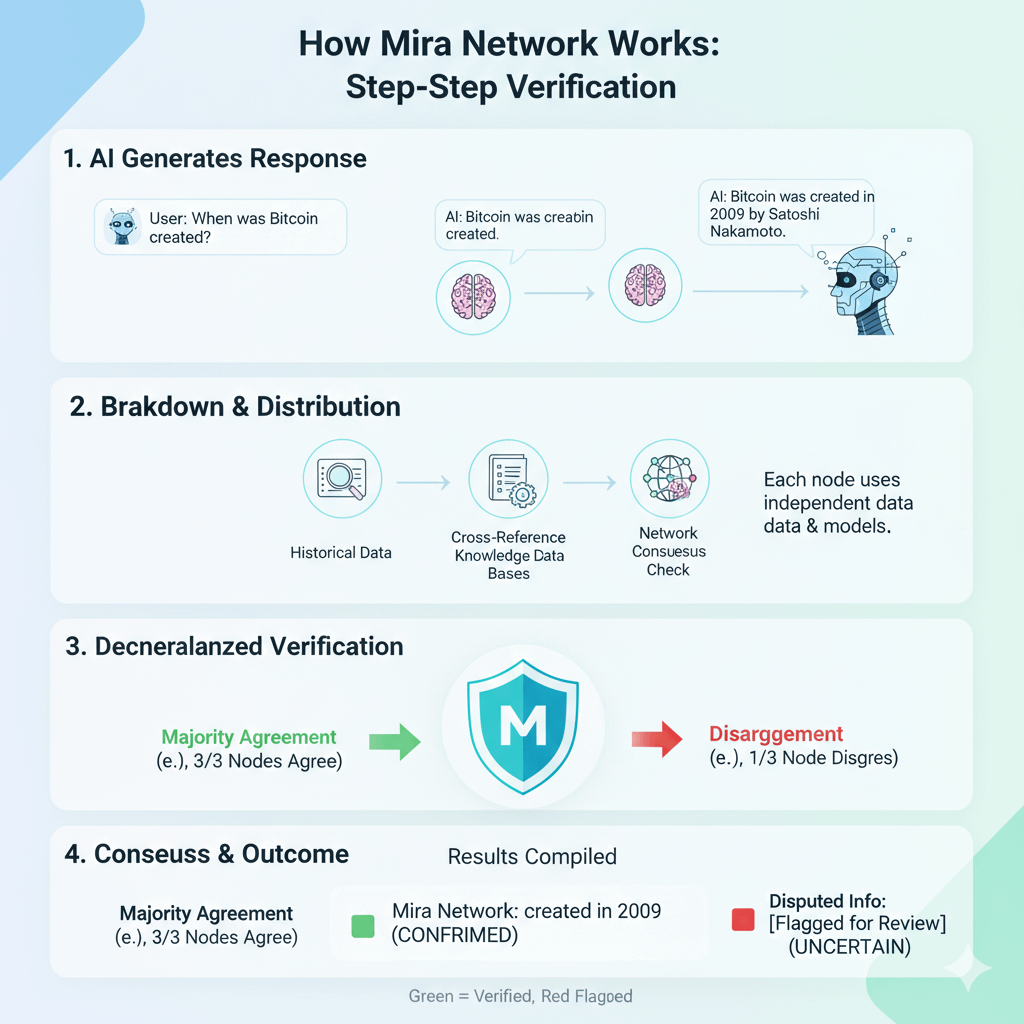

Comment fonctionne le réseau Mira

Pour comprendre comment le système fonctionne, imaginez poser une question simple à une IA.

Par exemple, quelqu'un demande quand Bitcoin a été créé.

L'IA pourrait répondre que Bitcoin a été créé en 2009 par Satoshi Nakamoto.

Au lieu de faire confiance à cette réponse immédiatement, Mira l'analyse.

Le système décompose la réponse en revendications plus petites.

Bitcoin a été créé en 2009

Bitcoin a été créé par Satoshi Nakamoto

Ces revendications individuelles sont ensuite envoyées à différents modèles de vérification à l'intérieur du réseau.

Chaque modèle évalue l'information en utilisant ses propres sources de données et son raisonnement. Certains modèles peuvent analyser des données historiques tandis que d'autres croisent les bases de connaissances.

Une fois le processus de vérification terminé, le réseau compare les résultats.

Si une forte majorité est d'accord, la revendication est marquée comme vérifiée.

S'il y a désaccord, le système reconnaît que l'information peut être incertaine.

Ce processus crée une couche de responsabilité autour des réponses de l'IA.

Au lieu d'une machine parlant seule, le réseau agit comme un groupe de penseurs indépendants examinant la réponse.

Pourquoi cela importe pour l'avenir de l'IA

Le monde se dirige lentement vers une ère où les systèmes d'IA fonctionneront de manière plus indépendante.

Les entreprises explorent déjà des agents d'IA autonomes qui peuvent gérer des tâches, analyser des marchés, générer des rapports et interagir avec des systèmes logiciels.

Mais il y a une préoccupation majeure.

Si ces systèmes font des erreurs, qui les attrapera

Sans une couche de vérification, les erreurs de l'IA pourraient se propager rapidement et créer de graves problèmes.

Imaginez un système d'IA gérant des transactions financières ou des données médicales tout en commettant des erreurs subtiles. Même de petites inexactitudes pourraient avoir de graves conséquences.

Un réseau de vérification comme Mira agit comme un filet de sécurité.

Cela ajoute une couche de confiance supplémentaire avant que les décisions ne soient prises.

Cela pourrait aider à débloquer la prochaine phase de l'adoption de l'IA dans les industries qui nécessitent fiabilité.

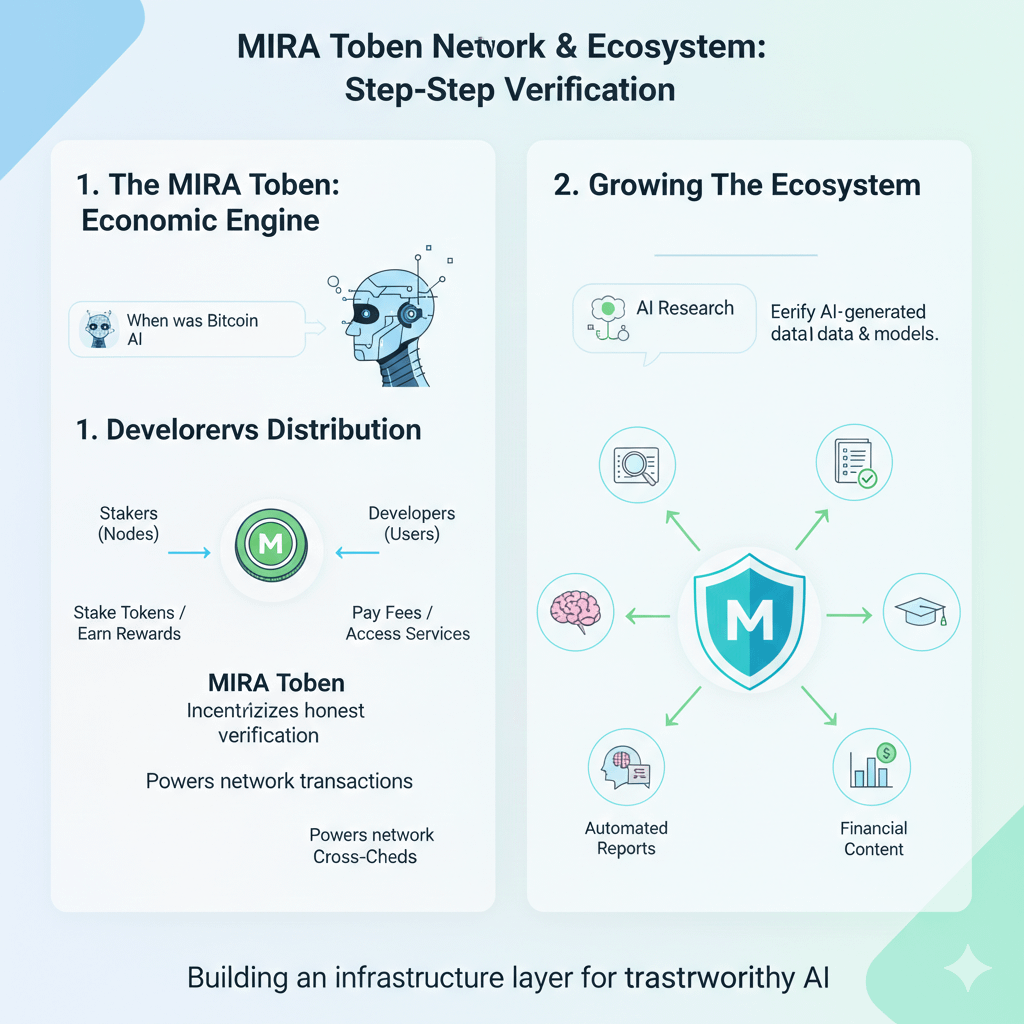

Le rôle du jeton MIRA

Chaque réseau décentralisé a besoin d'un système d'incitation qui encourage une participation honnête.

Mira utilise un jeton numérique natif appelé MIRA pour alimenter son écosystème.

Les participants qui aident à vérifier les sorties de l'IA peuvent gagner des récompenses en jetons MIRA. Ces récompenses motivent les personnes et les organisations à exécuter des nœuds de vérification et à contribuer à la puissance informatique.

Pour participer, les nœuds peuvent avoir besoin de miser des jetons, ce qui signifie les verrouiller dans le système. Si un participant agit de manière malhonnête ou essaie de manipuler les résultats, il risque de perdre une partie de sa mise.

Ce système crée une pression économique qui encourage l'exactitude.

Les développeurs qui souhaitent utiliser les services de vérification de Mira paient également des frais en utilisant le jeton. Ces frais sont distribués aux participants aidant à vérifier l'information.

Le jeton agit donc comme le carburant économique qui fait fonctionner le réseau.

L'écosystème Mira en pleine croissance

Un protocole devient précieux lorsque les développeurs commencent à construire des applications autour de lui.

Le réseau Mira est conçu pour s'intégrer avec différentes plateformes et outils d'IA.

Les développeurs peuvent utiliser Mira pour vérifier la recherche générée par l'IA, les rapports automatisés, le contenu éducatif ou l'analyse de données.

Imaginez une plateforme éducative où chaque explication générée par l'IA a été vérifiée par un réseau avant que les étudiants ne la lisent.

Ou un outil financier où les prédictions de l'IA sont vérifiées par plusieurs modèles avant que les investisseurs voient les résultats.

Ces types d'applications montrent comment la vérification pourrait transformer la façon dont les gens interagissent avec l'IA.

Au lieu de remettre en question chaque réponse, les utilisateurs pourraient compter sur un système qui a déjà examiné l'information avec soin.

La route à suivre

Le réseau Mira est encore en développement et en expansion de son écosystème.

Les premières étapes se concentrent sur le renforcement du protocole de vérification et la croissance du réseau de participants.

À mesure que plus de modèles et de nœuds rejoignent le réseau, le processus de vérification devient plus fort et plus fiable.

La vision à long terme est beaucoup plus grande.

L'équipe espère créer une couche d'infrastructure qui soutient une IA digne de confiance dans de nombreuses industries.

Si le système réussit, Mira pourrait devenir un composant clé de l'économie future de l'IA.

Tout comme les blockchains ont créé la confiance pour les transactions numériques, Mira vise à créer la confiance pour l'intelligence artificielle.

Défis qui ne peuvent être ignorés

Bien que la vision soit excitante, le parcours ne sera pas facile.

Vérifier les sorties de l'IA à grande échelle nécessite des ressources informatiques importantes. Traiter de grandes quantités de données à travers de nombreux modèles peut être techniquement complexe.

La technologie est également encore très nouvelle.

Les réseaux de vérification de l'IA sont un concept émergent et il faudra du temps pour prouver qu'ils fonctionnent efficacement à l'échelle mondiale.

L'adoption jouera également un rôle critique. Les développeurs et les entreprises doivent choisir d'intégrer des couches de vérification dans leurs applications.

Sans utilisation dans le monde réel, même le protocole le plus innovant ne peut pas réussir.

Pourquoi l'idée semble importante

Malgré les défis, l'idée derrière Mira touche à quelque chose de profondément important.

La technologie évolue rapidement, mais la confiance évolue lentement.

Les gens sont prêts à utiliser des outils puissants seulement quand ils se sentent confiants que ces outils ne les trahiront pas.

L'intelligence artificielle est l'une des technologies les plus transformatrices de l'histoire, mais elle lutte encore avec la fiabilité.

Si ce problème de confiance peut être résolu, l'impact potentiel devient énorme.

Le réseau Mira représente une tentative de combler ce fossé.

Il pose une question simple mais puissante.

Que se passerait-il si les réponses de l'IA pouvaient être vérifiées avant que nous y croyions