Quand j'entends des gens parler de réglementation dans la robotique, le ton sonne généralement défensif. Comme si les règles étaient des obstacles que l'innovation devait contourner. Ma réaction est différente, ce n'est pas l'excitation mais la reconnaissance. Parce que la véritable barrière à l'adoption à grande échelle de la robotique n'est plus la capacité, mais la coordination. Les machines peuvent bouger, voir, calculer et apprendre. Ce avec quoi elles ont du mal, c'est d'opérer à l'intérieur de systèmes qui exigent de la responsabilité et la responsabilité n'émerge pas automatiquement d'un meilleur matériel.

La plupart des conversations sur la robotique considèrent encore la réglementation comme une pression externe. Construisez le robot d'abord, inquiétez-vous de la conformité plus tard. Mais au moment où les robots commencent à interagir avec de vraies économies, des usines, des réseaux logistiques et des infrastructures publiques, cette approche s'effondre. La question ne devient plus : « le robot peut-il faire le travail ? » mais « qui est responsable quand il le fait ? »

C'est là que la direction de conception autour de la Fabric Foundation devient intéressante. Pas parce qu'elle construit elle-même des robots, mais parce qu'elle essaie de structurer comment les données des robots et la gouvernance interagissent dès le départ.

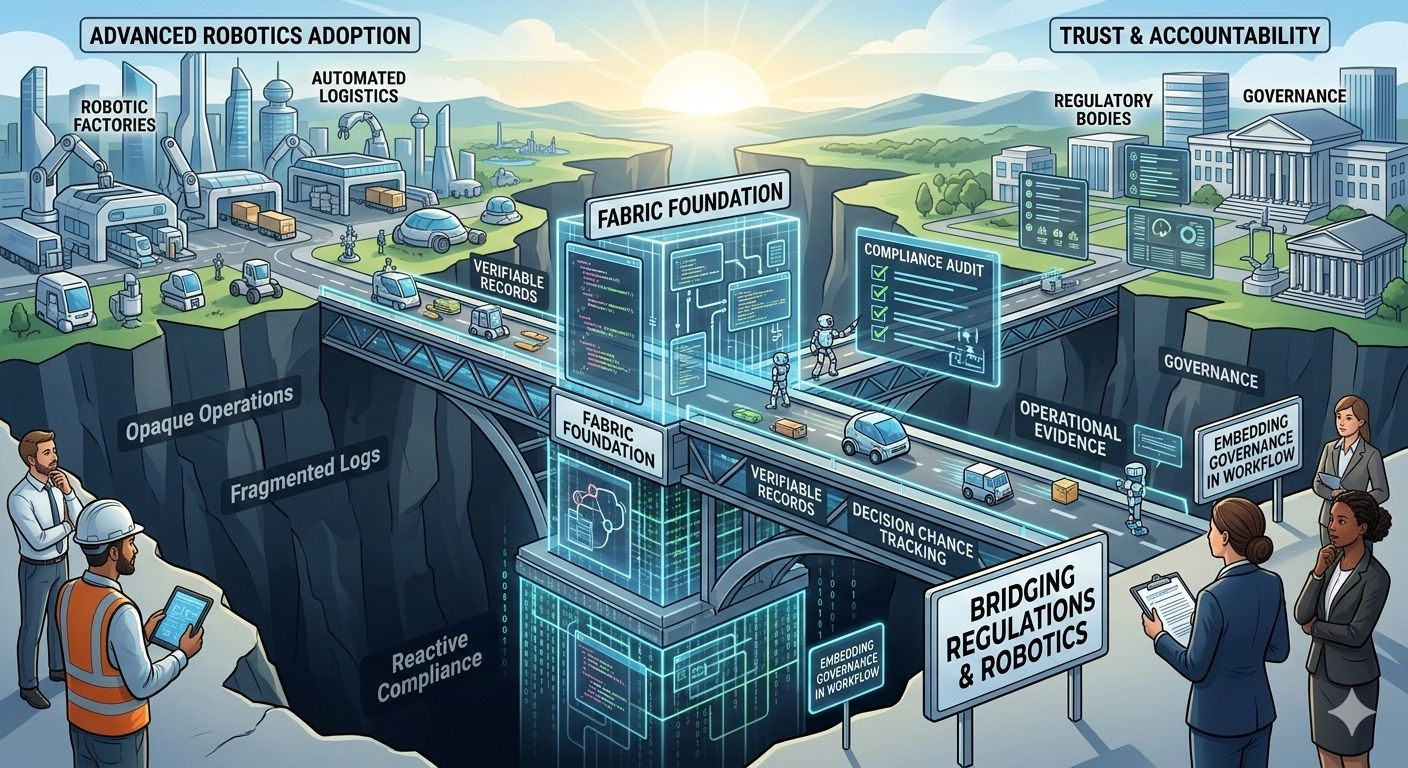

Dans le modèle traditionnel, les robots existent à l'intérieur de silos privés. Une entreprise déploie des machines, collecte des données et gère la conformité en interne. Si quelque chose ne va pas, la responsabilité se retrace à travers les systèmes de reporting d'entreprise, les journaux internes et toute documentation qui existe. Cela fonctionne pour des environnements contrôlés, mais cela ne se développe pas bien une fois que les machines commencent à fonctionner à travers des organisations ou des juridictions.

Le problème n'est pas seulement technique, il est structurel. Si un robot effectue une tâche qui implique plusieurs sources de données, plusieurs opérateurs et plusieurs modèles d'IA, vérifier ce qui s'est réellement passé devient très compliqué très rapidement. Qui a entraîné le modèle ? Quel ensemble de données a influencé la décision ? Quelle version du logiciel a exécuté l'action ? Ces questions comptent non seulement pour le débogage des systèmes, mais aussi pour les régulateurs qui essaient de déterminer la responsabilité. La plupart des infrastructures aujourd'hui ne notent pas cette chaîne d'événements d'une manière qui soit indépendamment vérifiable.

L'approche de Fabric renverse cette hypothèse. Au lieu de traiter la gouvernance comme quelque chose à ajouter après le déploiement, le système tente d'intégrer la vérifiabilité directement dans le flux de travail des machines. Les calculs, les saisies de données et les résultats peuvent être enregistrés et coordonnés à travers une couche d'infrastructure partagée. L'objectif n'est pas de contrôler les robots depuis une autorité centrale, mais de rendre leur activité lisible pour tous ceux qui doivent lui faire confiance.

Une fois que vous faites cela, la réglementation commence à ressembler moins à un obstacle et plus à une couche de coordination, car les régulateurs ne demandent pas réellement le contrôle des machines. Ce qu'ils veulent, c'est des preuves. Des preuves que les contraintes de sécurité ont été respectées. Des preuves que les décisions peuvent être retracées. Des preuves que les systèmes se comportent dans des limites définies. Lorsque cette preuve existe dans des journaux internes fragmentés, la supervision devient lente et antagoniste. Quand elle existe dans des dossiers vérifiables, la supervision devient procédurale. Cette différence compte plus que les gens ne le réalisent.

Dans la robotique d'aujourd'hui, la conformité est souvent réactive. Une machine échoue, un incident se produit et ensuite les enquêteurs reconstruisent ce qui s'est passé à partir d'informations incomplètes. Le processus est coûteux, lent et parfois inconclus. Intégrer un calcul vérifiable dans l'infrastructure change la séquence. Au lieu de reconstruire les événements après coup, les systèmes peuvent démontrer leur comportement au fur et à mesure qu'il se produit. Mais cela déplace aussi la responsabilité de manière subtile.

Une fois que les machines fonctionnent dans des cadres vérifiables, les opérateurs ne peuvent plus compter sur l'ambiguïté. Chaque entrée, exécution de modèle et chemin de décision devient partie d'un enregistrement observable. Cette transparence renforce la confiance, mais elle élève aussi la barre pour tous les impliqués : développeurs, opérateurs et organisations déployant les robots, et c'est là que le véritable acte d'équilibre commence.

Parce qu'une rigidité excessive peut ralentir l'innovation tout aussi facilement qu'un manque de supervision peut éroder la confiance. Les systèmes qui imposent la conformité de manière mécanique peuvent avoir du mal à s'adapter à de nouveaux types de machines ou à de nouveaux environnements réglementaires. D'un autre côté, les systèmes qui laissent tout flexible risquent de redevenir opaques. Le défi n'est pas simplement de construire une infrastructure. C'est de construire une infrastructure qui peut évoluer parallèlement à la technologie robotique et aux attentes réglementaires.

Une autre couche que les gens négligent souvent est l'interopérabilité. Les robots n'opèrent plus rarement seuls. Ils interagissent avec des services d'IA, des plateformes de chaîne d'approvisionnement, des logiciels industriels et de plus en plus avec d'autres agents autonomes. Chaque système porte ses propres politiques, permissions et seuils de risque. Coordonner tout cela nécessite plus que de simples protocoles de communication, cela nécessite des règles partagées sur la façon dont le travail des machines est vérifié et gouverné. Sans cette couche partagée, la collaboration entre systèmes autonomes devient fragile.

C'est pourquoi la conversation réglementaire autour de la robotique se déplace lentement des dispositifs individuels vers des cadres opérationnels. Les régulateurs se soucient moins d'un modèle de robot spécifique et plus de savoir si le système entourant ce robot peut démontrer de manière fiable la conformité. En d'autres termes, la gouvernance passe de la certification matérielle à la vérification des processus.

L'infrastructure conçue autour du calcul vérifiable s'adapte naturellement à cette direction. Bien sûr, rien de tout cela n'élimine le risque. Un système vérifiable peut toujours connaître des échecs, des incitations mal alignées ou des entrées défectueuses. Mais cela change où la confiance se trouve. Au lieu de faire confiance à des organisations individuelles pour rapporter avec précision, les participants font confiance à l'infrastructure qui enregistre et coordonne l'activité des machines.

C'est un changement subtil mais important, car une fois que la confiance se déplace dans l'infrastructure, des écosystèmes commencent à se former autour d'elle. Les développeurs construisent des outils qui supposent une exécution vérifiable. Les entreprises déploient des robots en sachant que les preuves de conformité sont automatiquement enregistrées. Les régulateurs évaluent le comportement à travers des données structurées plutôt que des rapports fragmentés.

Au fil du temps, cet alignement réduit la friction entre l'innovation et la supervision. La partie intéressante est que cela ne semble pas dramatique de l'extérieur. Il n'y a pas un seul moment où la robotique devient soudainement « réglementée correctement ». Au lieu de cela, le changement se produit discrètement à mesure que les systèmes qui intègrent la responsabilité deviennent plus faciles à utiliser que ceux qui ne le font pas. Et lorsque cela se produit, la gouvernance cesse de sembler être une contrainte externe et commence à fonctionner comme une partie de l'environnement opérationnel.

Donc, la vraie question n'est pas de savoir si la robotique sera soumise à une réglementation. Ce résultat est inévitable une fois que les machines entreront dans les économies réelles. La question la plus intéressante est de savoir quelles couches d'infrastructure rendent cette réglementation réalisable sans ralentir le progrès. Parce que relier la robotique et la réglementation ne consiste pas à rédiger des règles plus strictes. Il s'agit de concevoir des systèmes où prouver un comportement responsable est plus facile que de cacher un comportement irresponsable.

Et le succès à long terme d'approches comme celle qui émerge autour de Fabric dépendra probablement d'un test simple : lorsque les machines autonomes deviendront courantes dans les industries, leurs actions seront-elles suffisamment transparentes pour que les sociétés leur fassent confiance sans intervenir constamment ? C'est le pont qui compte.

@Fabric Foundation $ROBO #ROBO