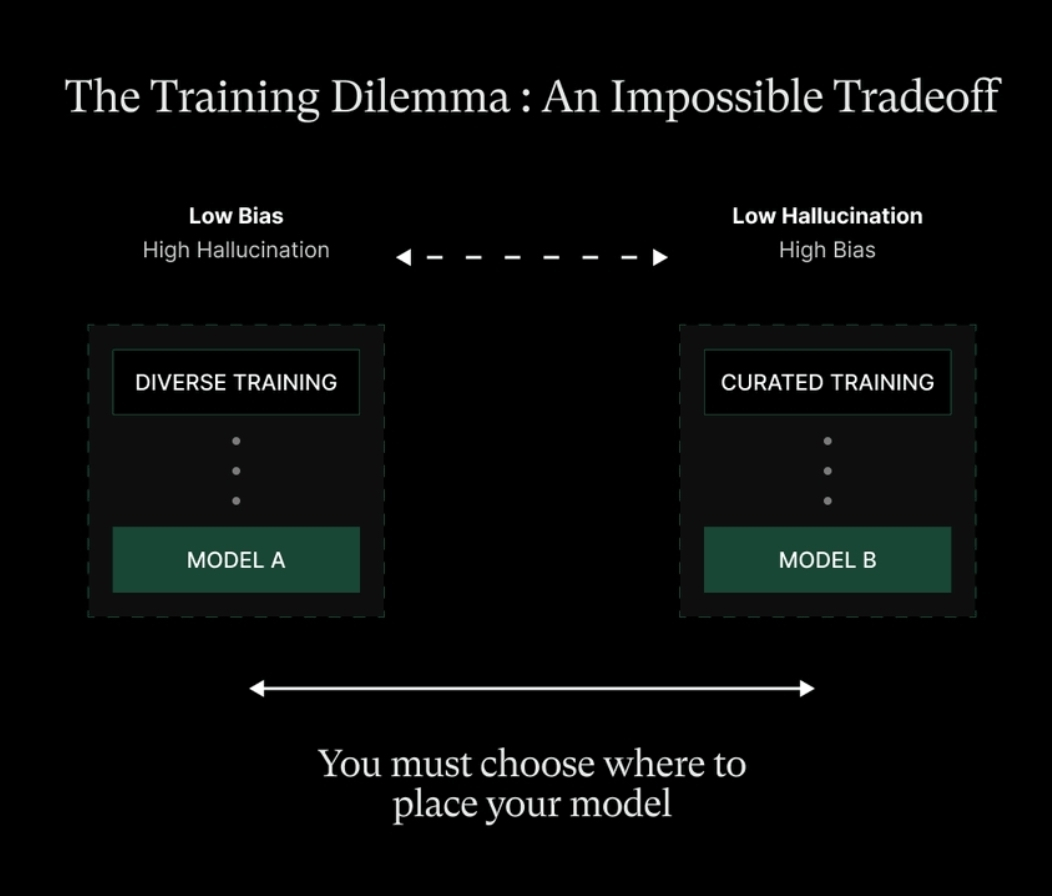

L'intelligence artificielle transforme les industries à un rythme incroyable, mais un problème majeur continue de limiter son adoption : la confiance. Les systèmes d'IA peuvent produire des réponses impressionnantes, mais ils peuvent aussi générer avec assurance des informations complètement fausses. Ces soi-disant "hallucinations d'IA" ne sont pas des bogues rares - elles sont le résultat naturel de la manière dont fonctionnent les grands modèles linguistiques.

Nous avons déjà vu des conséquences dans le monde réel. Les avocats ont soumis des documents judiciaires citant des affaires qui n'ont jamais existé parce qu'une IA les a générées. Les chercheurs ont publié des résumés basés sur des sorties incorrectes de l'IA. Lorsque l'IA devient partie intégrante d'environnements à enjeux élevés comme le droit, la finance, la santé et la recherche, la vérification devient critique.

C'est exactement le défi@Mira - Trust Layer of AI qu'essaie de résoudre.

Au lieu de s'appuyer sur un seul modèle d'IA pour déterminer la vérité, Mira introduit une couche de vérification décentralisée pour les résultats d'IA. Plusieurs modèles d'IA indépendants analysent la même revendication et comparent les résultats. Lorsqu'ils parviennent à un consensus, la probabilité d'exactitude augmente considérablement. Des recherches montrent que la validation multi-modèle peut réduire de manière spectaculaire les erreurs par rapport à une seule modèle.

Cependant, Mira va plus loin en ajoutant des incitations économiques grâce à $MIRA. Les validateurs doivent miser de la valeur pour participer au processus de vérification. S'ils agissent honnêtement et s'alignent sur le consensus, ils reçoivent des récompenses. S'ils agissent de manière malveillante ou essaient de manipuler le système, leur mise peut être réduite. Ce mécanisme garantit que l'honnêteté devient la stratégie la plus rentable.

Une autre fonctionnalité puissante de l'architecture de Mira est la transformation des revendications. Des déclarations complexes sont décomposées en revendications plus petites et vérifiables. Cela permet au réseau d'évaluer l'exactitude étape par étape, rendant la vérification à grande échelle à la fois plus rapide et plus fiable.

La vision à long terme de @Mira - Trust Layer of AI est beaucoup plus grande que la simple vérification des faits. À mesure que l'IA s'intègre dans les marchés financiers, les agents autonomes, les systèmes de recherche et l'infrastructure des entreprises, une vérification fiable deviendra essentielle. Un réseau de vérification décentralisé alimenté par $MIRA pourrait devenir la couche de confiance pour l'ensemble de l'économie de l'IA.

À l'avenir, les systèmes d'IA les plus précieux ne seront peut-être pas ceux qui génèrent le plus de contenu, mais ceux dont les résultats peuvent être prouvés fiables.

C'est l'avenir que construit Mira.