Quiconque passe du temps à utiliser des systèmes d'IA modernes remarque finalement un étrange motif. Les réponses semblent souvent confiantes, bien structurées et réfléchies. Pourtant, parfois, elles sont simplement fausses. Ces erreurs sont communément appelées hallucinations d'IA, où un modèle génère des informations qui semblent plausibles mais qui n'ont pas de base factuelle.

Le problème n'est pas seulement une question de précision. Il s'agit de confiance. À mesure que l'IA devient plus impliquée dans la recherche, la prise de décision et la collecte d'informations quotidiennes, la question devient simple : comment vérifions-nous ce qu'un système IA dit ?

C'est la question que le projet derrière @Mira - Trust Layer of AI essaie d'aborder sous un angle différent.

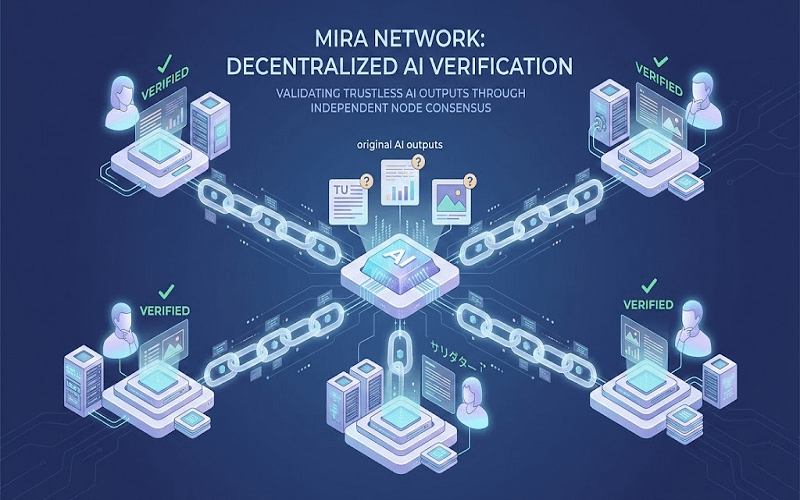

Mira Network est conçu comme une couche de vérification pour les sorties d'IA plutôt qu'un autre modèle d'IA essayant de produire de meilleures réponses. Au lieu de se concentrer uniquement sur la génération, le système se concentre sur la vérification. L'idée est simple. Lorsqu'une IA produit une réponse, Mira tente de vérifier si les déclarations à l'intérieur de cette réponse peuvent réellement être soutenues.

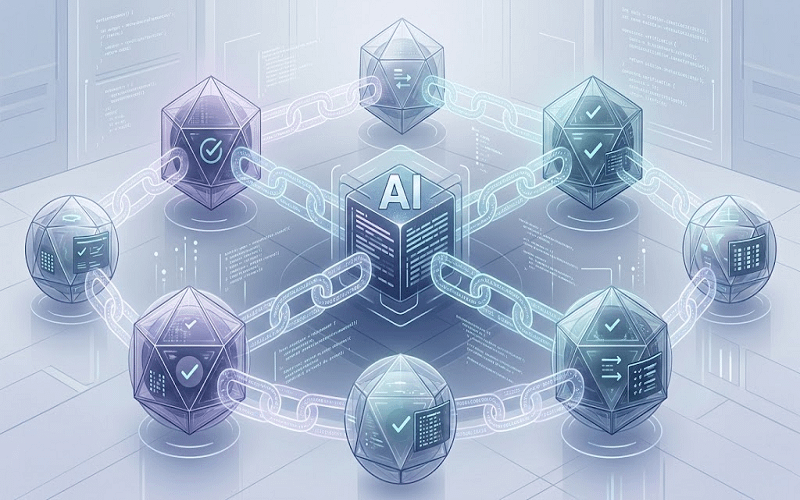

Le système fonctionne en séparant une sortie d'IA en déclarations factuelles plus petites. Un paragraphe écrit par un modèle peut contenir plusieurs déclarations, chacune pouvant être examinée indépendamment. Au lieu d'accepter la réponse entière comme une unité unique, Mira la décompose en parties qui peuvent être testées.

Une fois ces affirmations extraites, elles sont évaluées par plusieurs modèles d'IA indépendants. Chaque modèle agit comme un examinateur examinant la même déclaration de son propre point de vue. Si plusieurs modèles conviennent qu'une affirmation est cohérente avec des informations connues, le système augmente la confiance dans cette affirmation. Si un désaccord apparaît, l'affirmation est signalée comme incertaine ou potentiellement incorrecte.

Ce processus de vérification distribué est central à la manière dont #MiraNetwork aborde la fiabilité de l'IA. L'objectif n'est pas de supposer qu'un seul modèle est parfaitement précis, mais de traiter les modèles comme des participants à un processus d'évaluation collective.

La technologie blockchain joue un rôle différent ici. Au lieu de générer des connaissances, elle aide à enregistrer et à coordonner le processus de vérification. Lorsque différents validateurs exécutent des modèles et vérifient des affirmations, leurs résultats peuvent être enregistrés par consensus blockchain. Les preuves cryptographiques permettent à d'autres de confirmer que la vérification a effectivement eu lieu et n'a pas été modifiée par la suite.

C'est là que le jeton $MIRA entre dans le système. Il est lié à la structure économique qui encourage les participants à exécuter des tâches de vérification et à contribuer des ressources informatiques. En théorie, un réseau de validateurs indépendants peut vérifier les résultats de l'IA de manière transparente et traçable.

Le potentiel bénéfice de cette approche est simple. Les réponses de l'IA pourraient finalement être accompagnées d'une forme d'historique de vérification. Plutôt que de faire confiance à un modèle uniquement parce qu'il semble confiant, les utilisateurs pourraient voir si plusieurs évaluateurs étaient d'accord avec les affirmations sous-jacentes.

En même temps, le système ne résout pas tous les problèmes. Les modèles de vérification peuvent encore hériter des biais de leurs données d'entraînement. Certaines affirmations peuvent être difficiles à évaluer automatiquement, surtout si elles dépendent de l'interprétation ou de connaissances incomplètes. Et exécuter plusieurs vérifications à travers des systèmes distribués ajoute des coûts et de la complexité.

Même avec ces limitations, l'idée derrière #Mira est intéressante car elle traite les sorties d'IA plus comme des hypothèses scientifiques que comme des réponses finales. Au lieu de faire confiance à la première réponse, le réseau essaie de construire un processus pour la vérifier. Dans un monde où l'IA produit plus d'informations que jamais, ce genre de deuxième opinion peut devenir de plus en plus précieux.