Dans le monde en rapide évolution de l'intelligence artificielle, la plupart des projets poursuivent les mêmes objectifs : plus de rapidité, plus d'échelle et des résultats plus impressionnants. Mais Mira Network aborde le problème sous un angle très différent. Au lieu de se concentrer sur la puissance que l'IA peut atteindre, elle se concentre sur une question plus difficile et plus inconfortable : Que se passe-t-il lorsque les gens commencent à faire confiance aux réponses de l'IA trop facilement ?

Cette question est au centre de la philosophie de Mira.

Aujourd'hui, de nombreux systèmes d'IA sont jugés par la fluidité avec laquelle ils génèrent du langage. Si une réponse semble confiante, structurée et intelligente, les gens ont tendance à l'accepter. Le problème est que la fluidité n'est pas synonyme de fiabilité. Un modèle d'IA peut produire une explication soignée qui semble convaincante tout en contenant encore des erreurs subtiles, des interprétations erronées ou des conclusions exagérées.

Et une fois qu'une réponse semble complète, la plupart des utilisateurs s'arrêtent rarement pour la vérifier. Ils la lisent, l'acceptent et avancent. Ce comportement crée un risque silencieux mais sérieux : l'IA peut se tromper d'une manière très persuasive.

Mira Network semble mieux comprendre ce problème que la plupart des projets dans l'espace IA-crypto.

Au lieu d'essayer de rendre les sorties d'IA plus impressionnantes, Mira se concentre sur le fait de rendre la confiance plus difficile à accorder sans vérification. Cela déplace la conversation loin de la performance pure et vers quelque chose de plus important - le jugement et la responsabilité.

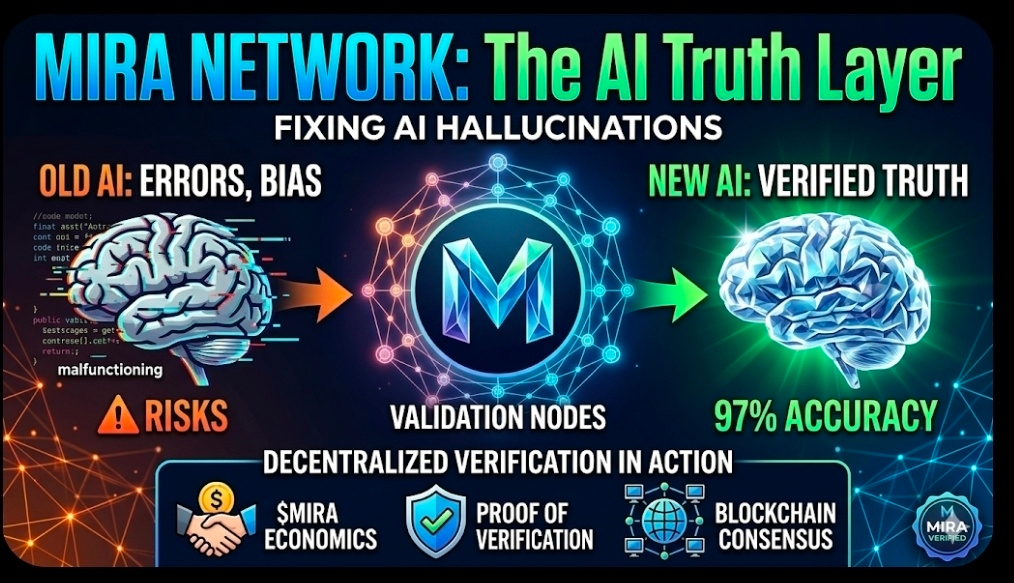

Au cœur de l'approche de Mira se trouve une idée simple mais puissante : les sorties d'IA ne devraient pas être dignes de confiance simplement parce qu'un système les a produites. Elles devraient être vérifiées.

Cela signifie que les revendications faites par un système d'IA doivent passer par un processus où elles sont vérifiées et validées avant d'être considérées comme fiables. La confiance doit venir après la vérification, pas avant.

Bien que ce concept semble évident, la plupart de l'écosystème IA actuel suppose encore que de meilleurs modèles résoudront éventuellement le problème de confiance par eux-mêmes. Un entraînement amélioré, des ensembles de données plus volumineux, des systèmes de récupération plus robustes et de meilleures interfaces peuvent réduire les erreurs - mais ils ne peuvent pas les éliminer entièrement.

Même le modèle le plus avancé peut encore produire une erreur convaincante.

Mira part d'une hypothèse plus disciplinée : le problème de confiance dans l'IA ne concerne pas seulement de meilleurs modèles - il s'agit de construire des systèmes qui vérifient les sorties.

Fait intéressant, cette philosophie s'aligne étroitement avec les principes de la technologie blockchain. La crypto a été à l'origine construite sur le scepticisme envers la confiance centralisée. Au lieu de compter sur une seule autorité, les systèmes blockchain utilisent la validation distribuée pour confirmer l'information.

Mira applique cette même mentalité à l'intelligence artificielle.

Plutôt que de supposer que l'intelligence mérite automatiquement la confiance, le projet tente de créer un cadre où les sorties d'IA doivent gagner leur crédibilité par la vérification.

Cela rend Mira moins axé sur la production d'IA et plus sur la responsabilité de l'IA.

Une autre raison pour laquelle le projet semble ancré est qu'il reflète le comportement réel des utilisateurs. En pratique, les gens vérifient rarement les réponses d'IA. La plupart des utilisateurs sont occupés et préfèrent des réponses rapides. Lorsqu'une réponse d'IA semble polie et complète, cela réduit naturellement l'envie de la remettre en question.

Mira semble conçue en tenant compte de cette réalité. Au lieu de s'attendre à ce que les utilisateurs deviennent des vérificateurs de faits parfaits, elle essaie d'intégrer la vérification directement dans le système.

Cette approche devient de plus en plus importante à mesure que l'IA commence à influencer les décisions plutôt qu'à simplement générer du texte.

La prochaine phase de l'IA ne concerne pas seulement la rédaction de résumés ou la réponse à des questions. Elle aidera de plus en plus les gens à interpréter les informations, évaluer les opportunités, analyser les risques et prendre des décisions.

Lorsque l'IA opère dans ces domaines, les erreurs ne sont plus inoffensives.

Une sortie défectueuse pourrait influencer les investissements, les décisions de gouvernance, les conclusions de recherche ou les stratégies commerciales. À ce stade, les conséquences de l'erreur deviennent réelles. Les erreurs d'IA cessent d'être des dysfonctionnements embarrassants - elles deviennent des risques opérationnels.

C'est là que la thèse de Mira commence à prendre de la force.

Le projet explore essentiellement si la confiance dans la sortie d'IA peut devenir une forme d'infrastructure, plutôt que quelque chose que les utilisateurs supposent simplement. Au lieu de demander aux systèmes d'IA de générer plus de réponses, Mira demande si l'environnement autour de ces réponses peut rendre la fausse confiance plus difficile à créer.

Peu de projets travaillent actuellement à ce niveau.

La plupart des plateformes d'IA rivalisent en capacité - qui peut générer des réponses plus rapidement, un texte plus intelligent ou une automatisation plus avancée. Mira, en revanche, essaie de rivaliser sur la crédibilité.

C'est un marché beaucoup plus difficile à construire. La vérification introduit des frictions. Elle peut ajouter du temps, du coût et de la complexité. Les développeurs et les utilisateurs n'accepteront ces compromis que si les avantages sont clairement visibles.

Cela devient le plus grand défi de Mira.

Le succès du projet dépendra de la nécessité pratique de la vérification, et non seulement de son attrait théorique. Si les gens admirent le concept mais évitent de l'utiliser parce qu'il semble peu pratique, Mira pourrait rester une idée forte sans adoption généralisée.

Cependant, si les sorties d'IA non vérifiées commencent à sembler risquées - surtout dans des environnements où les décisions ont de réelles conséquences - la vérification pourrait devenir essentielle.

Lorsque cela se produit, des systèmes comme Mira pourraient passer d'outils optionnels à une infrastructure de base, similaire aux couches de sécurité sur Internet.

Les systèmes invisibles deviennent souvent les plus importants une fois que la technologie mûrit. Lorsque la vérification fonctionne bien, les utilisateurs peuvent à peine la remarquer. Ils vivent simplement moins de sorties trompeuses en gagnant la confiance.

Cette absence d'erreur peut être difficile à commercialiser, mais sa valeur peut être énorme.

En fin de compte, Mira Network n'est pas simplement un autre projet d'IA lié à la technologie blockchain. Il représente une tentative de formaliser le scepticisme à une époque où les machines peuvent parler de manière convaincante.

Au lieu de faire confiance aux réponses parce qu'elles semblent intelligentes, Mira essaie de créer un processus où les réponses sont dignes de confiance parce qu'elles ont survécu à la vérification.

Cette ambition est plus étroite que de nombreux récits d'IA, mais elle est également plus profonde. Le projet ne poursuit pas l'histoire la plus large sur l'intelligence artificielle. Au lieu de cela, il explore un problème spécifique et de plus en plus important : comment construire la confiance dans l'information générée par l'IA.

À mesure que l'IA devient plus impliquée dans la manière dont les gens interprètent les données, évaluent les risques et prennent des décisions, ce problème ne fera que devenir plus pertinent.

Mira se positionne directement dans cet écart entre apparence et fiabilité.