Quand j'entends les gens parler de confiance dans les systèmes autonomes, la conversation passe généralement directement à la performance. Des robots plus rapides, des agents plus intelligents, de meilleurs modèles. Mais la première chose à laquelle je pense n'est pas la capacité. C'est la vérification. Parce que peu importe à quel point une machine devient avancée, la vraie question n'est pas ce qu'elle peut faire. C'est de savoir si quelqu'un peut prouver ce qu'elle a réellement fait.

Cet écart entre l'action et la vérification est devenu discrètement l'un des plus grands obstacles à l'automatisation dans le monde réel. Les systèmes autonomes génèrent des données, prennent des décisions et interagissent avec des environnements de manière de plus en plus difficile à auditer directement par les humains. Lorsque quelque chose ne va pas, nous nous appuyons souvent sur des journaux, des déclarations ou des dossiers internes qui ne peuvent pas être facilement vérifiés par des parties extérieures. Dans les systèmes qui fonctionnent à grande échelle, ce manque de vérification partagée devient rapidement un problème de confiance.

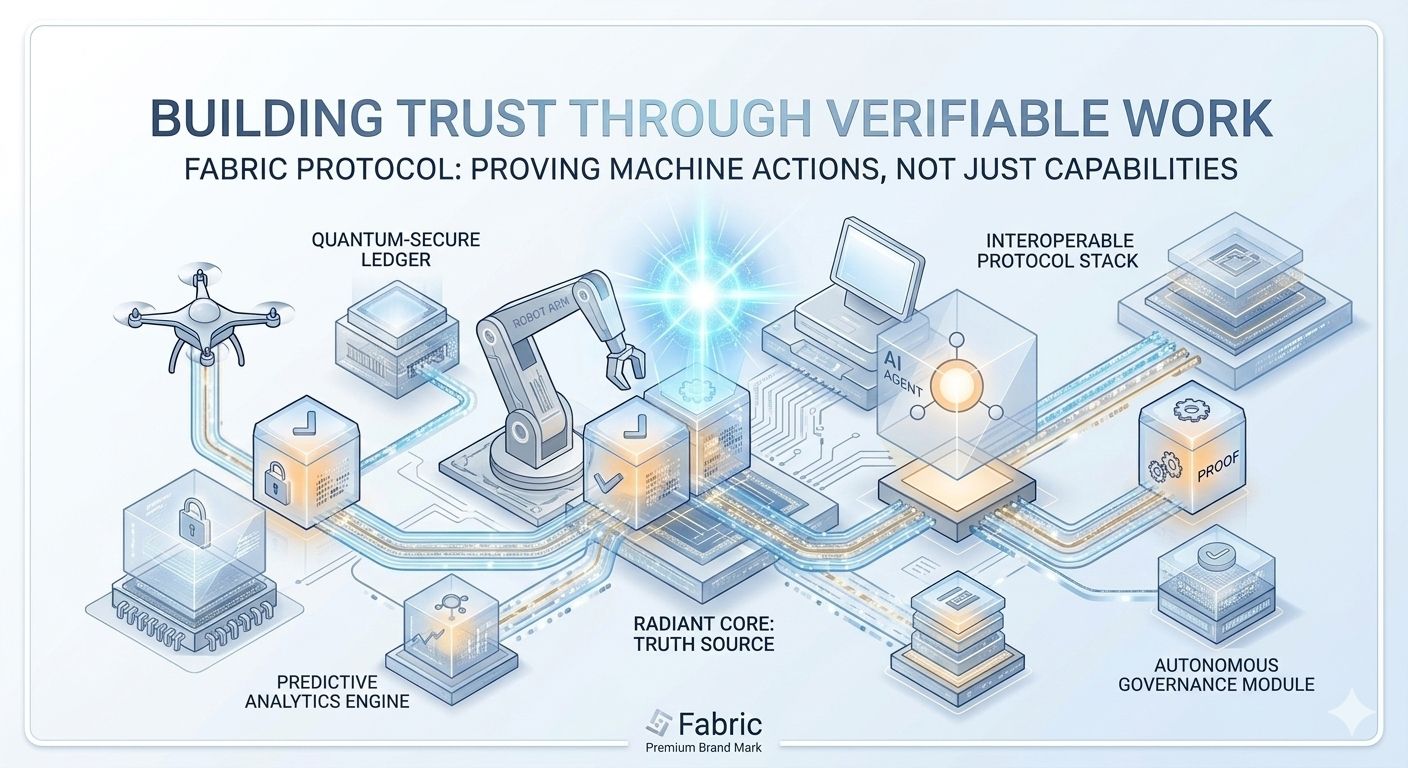

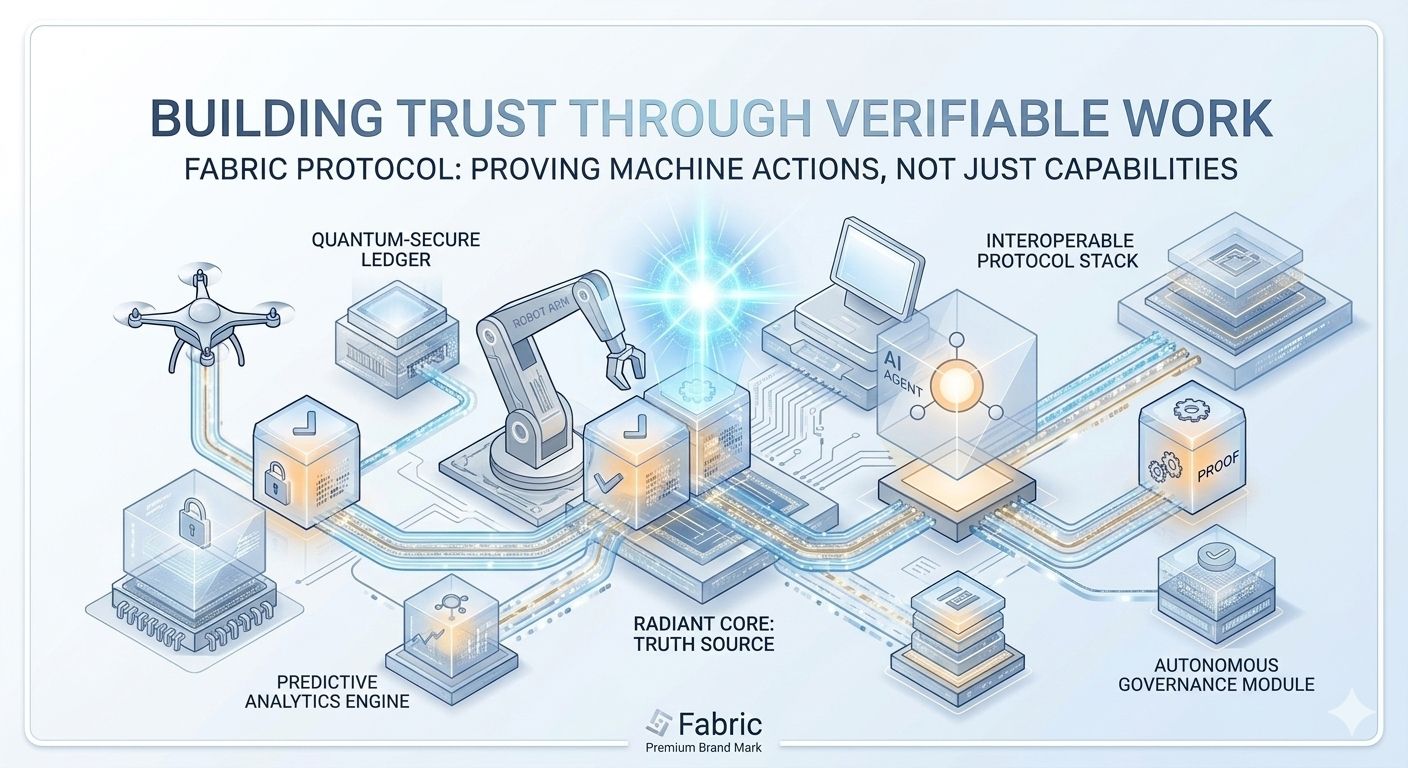

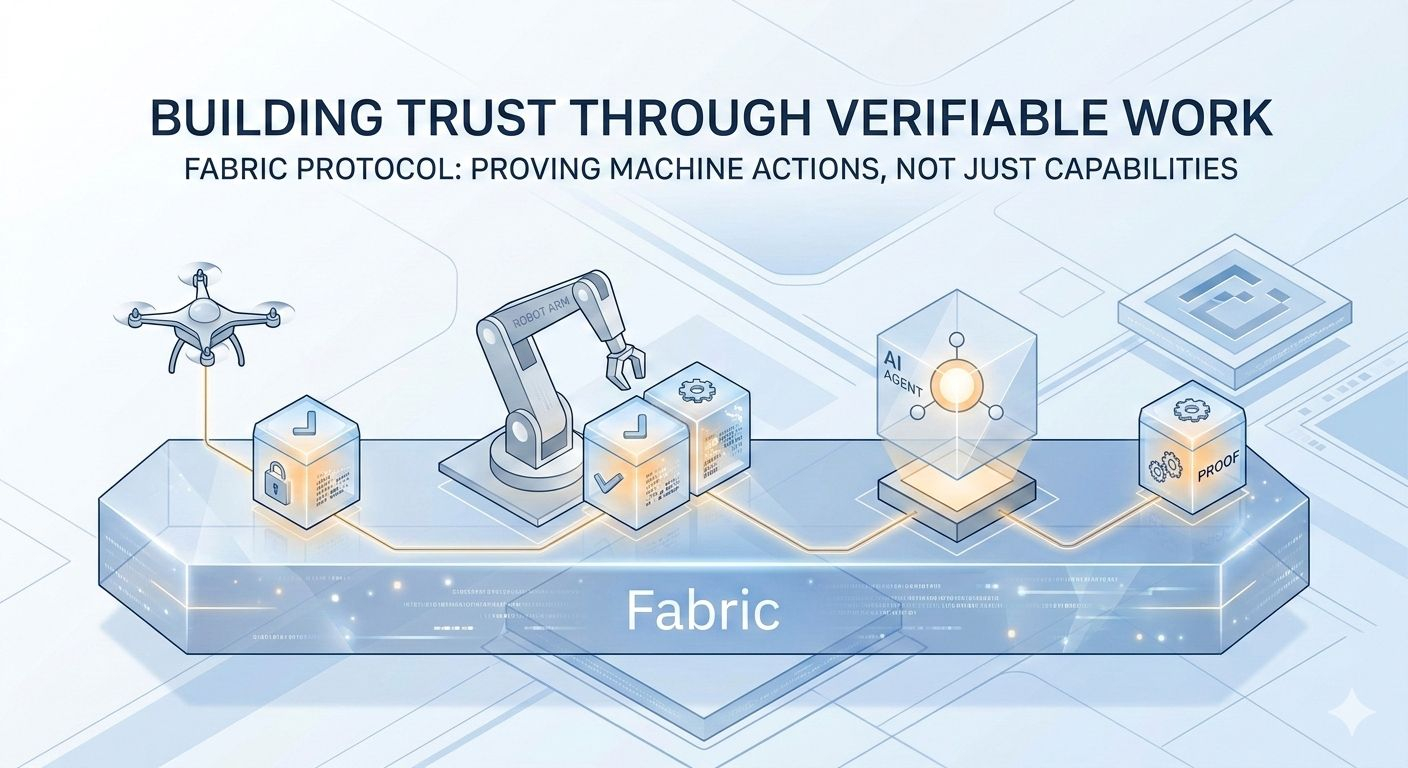

Le protocole Fabric aborde le problème sous un angle différent. Au lieu de demander aux utilisateurs de faire confiance aux machines, il se concentre sur la vérification par défaut du travail des machines. L'idée n'est pas seulement de coordonner des robots ou des agents d'IA. Il s'agit de coordonner les preuves autour de ce que ces systèmes produisent.

Dans la plupart des déploiements robotiques ou d'IA aujourd'hui, le pipeline de données est fragmenté. Les capteurs capturent des informations, le calcul se produit quelque part dans la pile, et les décisions sont exécutées dans le monde physique ou numérique. Mais la preuve de ces processus reste souvent à l'intérieur de systèmes privés. Même lorsque des enregistrements existent, ils sont rarement standardisés de manière à ce que plusieurs parties puissent les confirmer indépendamment.

L'architecture de Fabric déplace ces étapes dans une infrastructure partagée où le calcul, les données et la coordination peuvent être enregistrés et vérifiés. Au lieu de s'appuyer sur un seul opérateur pour rapporter les résultats, le réseau fournit un registre public où les actions des machines peuvent être ancrées et validées.

Ce changement peut sembler subtil, mais il modifie l'endroit où la responsabilité réside. Dans les déploiements traditionnels, l'opérateur agit effectivement en tant qu'autorité finale. Si un robot accomplit une tâche ou si un système d'IA produit un résultat, l'organisation gérant le système décide de la manière dont cette information est enregistrée et partagée. La vérification devient un processus interne.

Avec le protocole Fabric, la vérification devient partie intégrante de l'infrastructure elle-même. Le travail des machines peut être enregistré, validé et coordonné par des mécanismes décentralisés, ce qui signifie que le système ne dépend pas des enregistrements d'une seule partie pour établir ce qui s'est passé.

Bien sûr, la vérification ne supprime pas la complexité. Quelqu'un doit toujours collecter des données, traiter des calculs et gérer les interactions entre les machines et le réseau. Ce qui change, c'est la manière dont ces étapes sont structurées. Au lieu de pipelines opaques, le protocole introduit des points de contrôle vérifiables où les résultats peuvent être confirmés et partagés entre les participants.

Cela crée une couche économique intéressante autour du travail autonome. Lorsque les actions des machines sont vérifiables, elles deviennent plus faciles à coordonner entre organisations et applications. Un robot accomplissant une tâche, un modèle générant une analyse, ou un agent automatisé exécutant un service peuvent tous produire des résultats que d'autres systèmes peuvent confirmer indépendamment.

Une fois cela arrivé, la conversation passe de « faisons-nous confiance à cette machine ? » à « comment cette machine prouve-t-elle son travail ? »

La distinction est plus importante qu'elle n'en a l'air. Dans de nombreuses industries, l'adoption de l'automatisation n'est pas limitée par la capacité. Elle est limitée par la capacité à démontrer la fiabilité et la responsabilité. Si un robot logistique dirige mal des marchandises, si un système robotique dans la fabrication produit des composants défectueux, ou si un agent d'IA exécute une action financière de manière incorrecte, la question devient de savoir à quelle vitesse la cause peut être identifiée et vérifiée.

Les systèmes construits sur une infrastructure vérifiable rendent ces enquêtes beaucoup plus simples. Au lieu de s'appuyer sur des journaux internes fragmentés, les participants peuvent se référer à des enregistrements partagés qui capturent la séquence d'actions et de calculs impliqués.

Mais cela change également le profil de risque. Lorsque la vérification devient une infrastructure publique, la fiabilité de la couche de coordination est tout aussi importante que celle des machines elles-mêmes. Si le réseau qui enregistre et valide le travail des machines devient congestionné, mal configuré ou mal gouverné, les garanties de confiance qu'il promet peuvent s'affaiblir.

En d'autres termes, établir la confiance dans les systèmes autonomes ne concerne pas seulement les robots se comportant correctement. Cela concerne les systèmes qui documentent leur comportement et qui restent fiables dans des conditions du monde réel.

Il y a un autre changement subtil qui se produit également. Lorsque le travail des machines devient vérifiable, il devient plus facile d'intégrer des systèmes autonomes dans une activité économique plus large. Les résultats vérifiés peuvent agir comme des entrées pour d'autres processus, permettant aux réseaux d'agents et de machines de coordonner des tâches à travers une infrastructure partagée.

C'est là que la vision de Fabric commence à ressembler moins à une plateforme de robotique et plus à une couche de coordination pour les économies de machines. Au lieu de déploiements isolés, les systèmes autonomes peuvent participer à un environnement structuré où leurs actions sont enregistrées, validées et rendues interopérables avec d'autres participants.

Mais l'interopérabilité introduit ses propres responsabilités. Une fois que plusieurs acteurs s'appuient sur une vérification partagée, les normes pour la manière dont les données sont enregistrées, comment le calcul est validé, et comment les décisions de gouvernance sont prises deviennent critiques. Si ces règles ne sont pas conçues avec soin, l'infrastructure censée créer la confiance peut introduire de nouvelles formes de friction.

Donc, quand je pense à l'approche du protocole Fabric concernant les systèmes autonomes, je ne le cadre pas simplement comme une habilitation des robots ou des agents d'IA. De nombreuses technologies tentent déjà cela. L'ambition plus intéressante est de créer un environnement où le travail des machines peut être fiable car il peut être prouvé.

Dans des conditions calmes, presque tout système de coordination peut sembler fiable. Le véritable test survient lorsque les machines fonctionnent à grande échelle, lorsque de nombreux acteurs dépendent de la même infrastructure, et lorsque des erreurs ou un comportement adversarial surviennent inévitablement.

C'est alors que la question de la confiance devient pratique plutôt que théorique. Pas si les systèmes autonomes sont capables, mais si les réseaux qui les soutiennent peuvent vérifier, coordonner et gouverner leur travail de manière cohérente.

Parce qu'une fois que les machines commencent à fonctionner comme des participants dans de vraies économies, la confiance ne viendra pas des promesses sur ce pour quoi elles sont conçues. Elle viendra de la capacité à prouver ce qu'elles ont réellement fait.