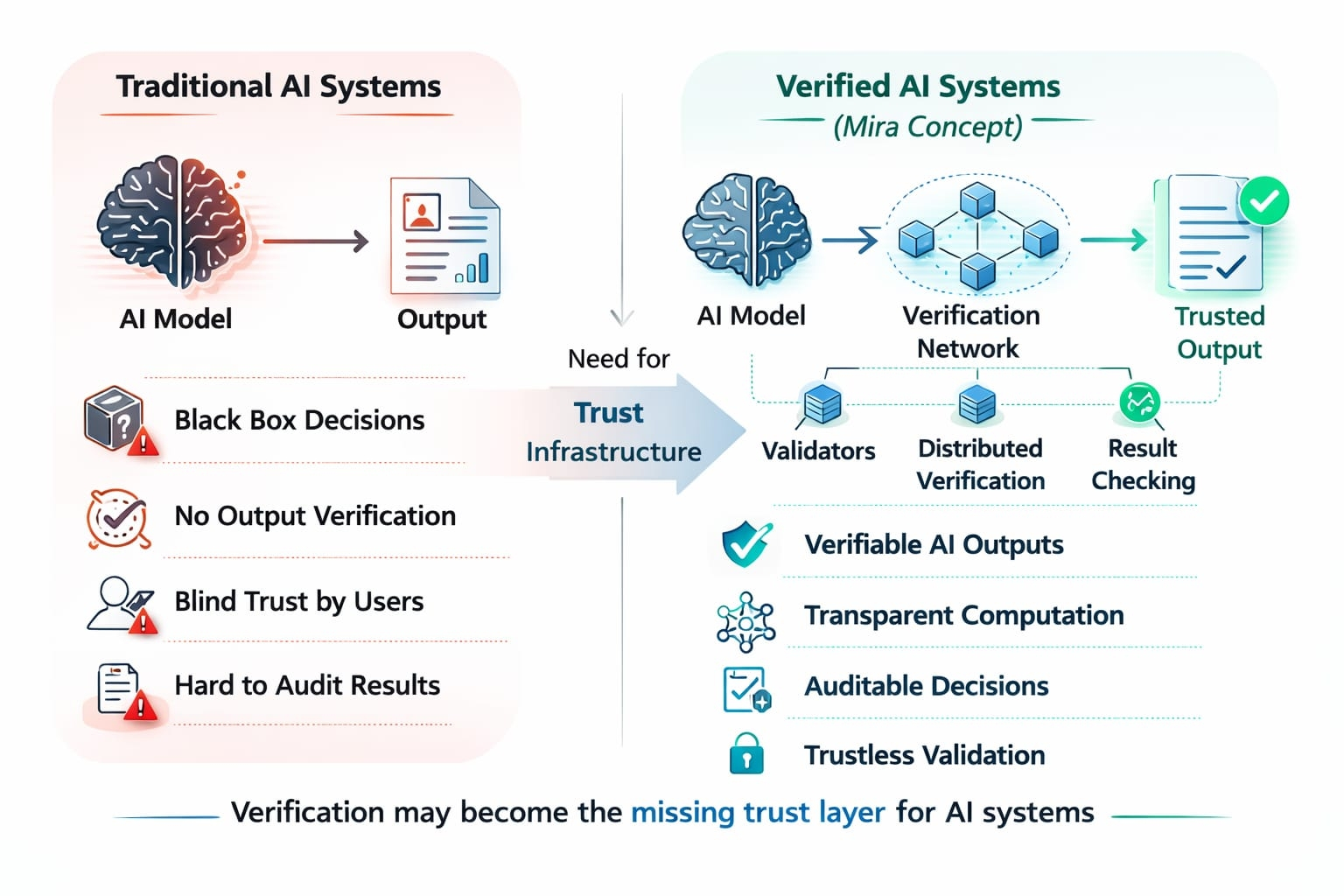

Il y a quelques mois, j'ai remarqué quelque chose d'intéressant en suivant différents projets d'IA et de blockchain. De nombreuses équipes se précipitaient pour construire des modèles plus grands, des systèmes d'inférence plus rapides et des agents d'IA plus intelligents. Mais très peu se posaient une question fondamentale : Comment vérifions-nous ce que produit l'IA ?

Cette question est celle où Mira commence à se démarquer.

Au lieu de se concentrer uniquement sur la construction de l'IA, Mira se concentre sur quelque chose qui pourrait devenir encore plus important à long terme : la vérification des résultats de l'IA. En termes simples, Mira construit une infrastructure qui aide à prouver si un résultat d'IA est fiable, reproductible et digne de confiance.

À première vue, cela peut sembler une petite couche technique. Mais quand vous pensez à la façon dont l'IA est utilisée aujourd'hui dans la finance, la recherche, l'automatisation et la prise de décision numérique, la vérification devient rapidement un défi sérieux.

Le problème croissant de la confiance dans l'IA

Aujourd'hui, les modèles d'IA génèrent des réponses, des prédictions et des décisions à une échelle incroyable. Mais les systèmes qui vérifient ces résultats sont souvent faibles ou complètement absents.

Par exemple, si un modèle d'IA génère une analyse de marché, des insights médicaux ou du code, les utilisateurs doivent souvent faire confiance à ce résultat aveuglément. Même les développeurs ne peuvent parfois pas expliquer pleinement comment un modèle est arrivé à son résultat.

Cela crée un écart de confiance.

Mira aborde ce problème en introduisant une couche de vérification pour les résultats d'IA, soutenue par une infrastructure décentralisée. Au lieu de compter sur un seul système pour confirmer les résultats, le réseau peut vérifier les calculs et les résultats grâce à des participants distribués.

Le résultat est un cadre où les résultats d'IA peuvent être vérifiés, validés et davantage dignes de confiance.

L'idée principale de Mira : intelligence vérifiable

L'idée centrale derrière Mira est ce que de nombreuses personnes décrivent comme l'intelligence vérifiable.

Plutôt que de traiter l'IA comme une boîte noire, Mira vise à rendre les résultats prouvables et auditable. Ce concept a des implications importantes pour les industries où la confiance et la précision comptent.

Par exemple :

• La recherche ou les rapports générés par l'IA pourraient être vérifiés par le réseau de Mira.

• Les modèles de trading automatisés pourraient avoir leur logique validée.

• Les agents d'IA interagissant avec des blockchains pourraient prouver leurs étapes d'exécution.

Cette approche est particulièrement pertinente dans les environnements Web3, où la transparence et la vérification sans confiance sont des principes fondamentaux.

À bien des égards, Mira essaie d'étendre ces principes dans le monde de l'IA.

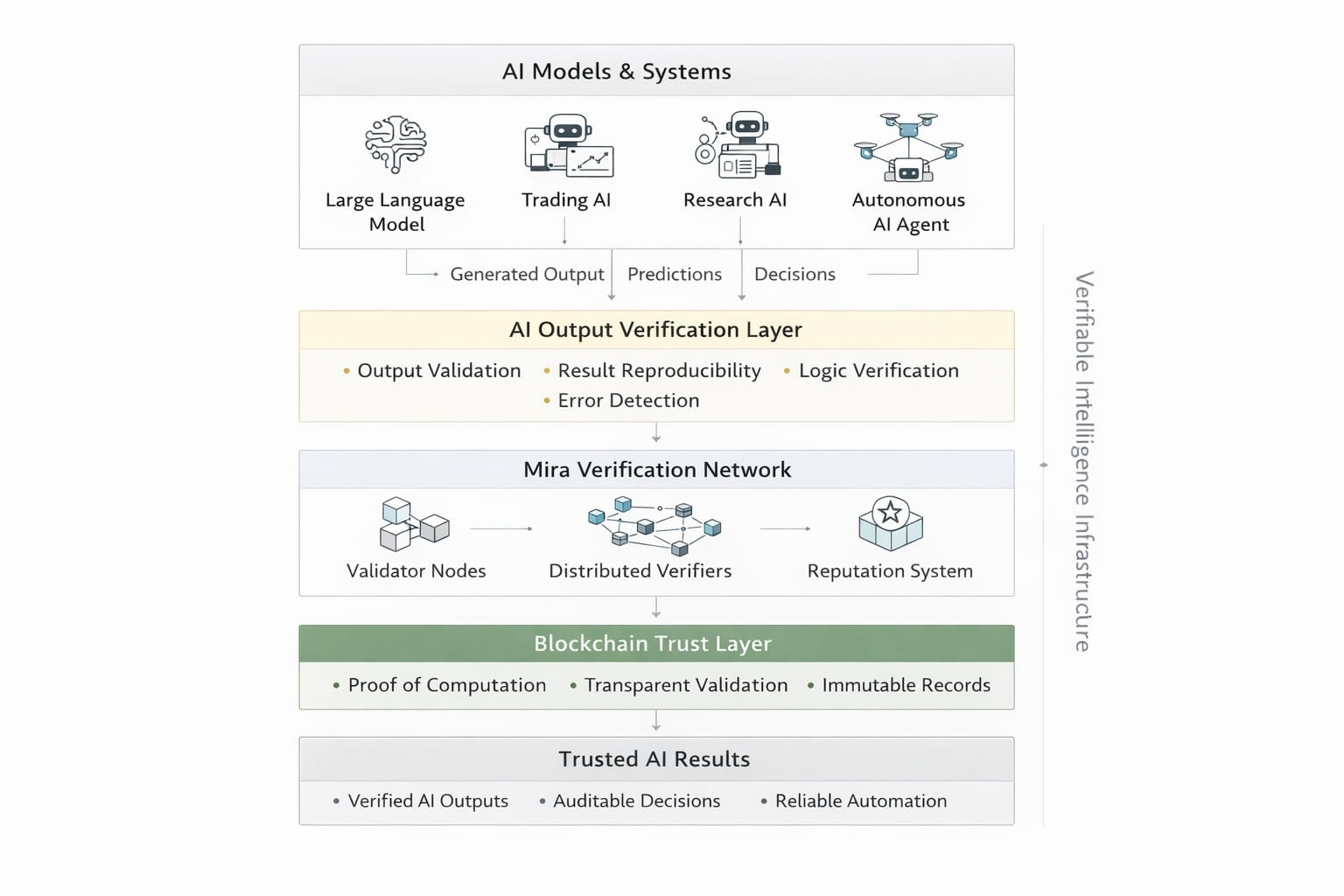

Infrastructure conçue pour la vérification de l'IA

Un des aspects intéressants de Mira est qu'il ne s'agit pas simplement d'un outil ou d'une application. Au lieu de cela, il est conçu comme une infrastructure sur laquelle d'autres projets et développeurs peuvent s'appuyer.

D'après ce que j'ai observé, l'architecture de Mira se concentre sur plusieurs composants clés :

1. Réseau de vérification

Mira introduit un réseau où les participants aident à vérifier les résultats d'IA. Au lieu d'une autorité centralisée validant les résultats, des nœuds distribués contribuent au processus de vérification.

Cela rend le système plus transparent et résistant à la manipulation.

2. Intégration avec les modèles d'IA

La plateforme est conçue pour se connecter à différents modèles et services d'IA. Cela signifie que les développeurs construisant des applications d'IA peuvent intégrer des mécanismes de vérification directement dans leurs flux de travail.

Avec le temps, cela pourrait créer un écosystème plus large de systèmes d'IA qui prouvent leurs résultats plutôt que de simplement les produire.

3. Incitations tokenisées

L'écosystème comprend également le $MIRA token, qui aide à coordonner la participation au sein du réseau. Les incitations peuvent être alignées pour que les validateurs, les développeurs et les participants contribuent au maintien de processus de vérification fiables.

Les systèmes basés sur des jetons sont courants dans Web3, mais dans ce cas, ils servent un but très spécifique : encourager la validation précise des résultats d'IA.

Pourquoi cette approche est importante

À mon avis, la partie la plus intéressante de Mira n'est pas seulement la technologie elle-même, mais le moment du problème qu'elle aborde.

L'IA se développe rapidement, et de nombreuses industries commencent à s'y fier pour des décisions importantes. Cependant, les systèmes qui garantissent que ces décisions sont correctes sont encore en développement.

Si l'IA devient une technologie fondamentale pour l'économie numérique, la vérification pourrait devenir tout aussi importante que le calcul.

Pensez à la façon dont fonctionne la blockchain. Les blockchains n'ont pas seulement introduit des actifs numériques, elles ont introduit des transactions vérifiables.

Mira explore si une idée similaire peut exister pour les résultats d'IA.

Cas d'utilisation potentiels

Plusieurs cas d'utilisation pourraient bénéficier de la couche de vérification de Mira.

Recherche en IA et analyse de données

Les chercheurs utilisent de plus en plus des outils d'IA pour analyser des données ou générer des insights. Mira pourrait aider à vérifier que ces résultats suivent une logique reproductible plutôt qu'une génération aléatoire.

Agents d'IA autonomes

Alors que les agents d'IA commencent à interagir avec des systèmes décentralisés, la vérification devient essentielle. Le réseau de Mira pourrait garantir que les agents exécutent des tâches correctement et de manière transparente.

Systèmes financiers et de trading

Dans les environnements financiers, les modèles d'IA font souvent des prédictions ou des décisions de trading. Des mécanismes de vérification pourraient fournir une confiance supplémentaire que ces résultats sont valides.

Applications d'IA décentralisées

Les développeurs construisant des applications d'IA Web3 peuvent utiliser Mira pour introduire des couches de confiance dans leurs systèmes, rendant leurs produits plus fiables.

Ces exemples mettent en évidence pourquoi la vérification pourrait devenir un élément important des futurs écosystèmes d'IA.

Mon point de vue personnel sur Mira

Lorsque j'ai d'abord examiné Mira, je l'ai initialement considérée comme un autre projet de blockchain lié à l'IA. Mais après avoir étudié le concept plus attentivement, j'ai commencé à le voir différemment.

De nombreux projets se concentrent sur le renforcement de l'IA.

Mira se concentre sur la responsabilisation de l'IA.

Cette distinction est subtile mais importante.

Si les systèmes d'IA continuent de s'étendre dans des domaines critiques comme la gouvernance, la finance et l'automatisation, les utilisateurs exigeront des garanties plus solides concernant les résultats qu'ils reçoivent. L'infrastructure de vérification pourrait jouer un rôle majeur pour répondre à cette demande.

Bien sûr, le succès d'un projet comme Mira dépendra de l'adoption, de la participation des développeurs et de la force de son écosystème. Les projets d'infrastructure prennent souvent du temps à mûrir.

Mais l'idée elle-même — construire une couche de vérification pour l'IA — semble à la fois pratique et tournée vers l'avenir.

Réflexions finales

L'avenir de l'IA pourrait ne pas être défini uniquement par la puissance des modèles, mais aussi par la fiabilité de leurs résultats.

Mira explore ce défi en construisant un système où les résultats d'IA peuvent être validés par des réseaux décentralisés plutôt que par une confiance aveugle.

À mon avis, cette direction mérite de l'attention. Alors que l'IA continue de s'intégrer dans les systèmes quotidiens, la capacité de vérifier ses décisions pourrait devenir l'un des éléments les plus importants de la pile technologique.

Des projets comme Mira tentent de construire cette couche manquante et s'ils réussissent, ils pourraient transformer silencieusement la façon dont nous faisons confiance aux machines intelligentes.

@Mira - Trust Layer of AI #Mira $MIRA