L'intelligence artificielle est devenue l'une des technologies les plus puissantes façonnant les systèmes numériques aujourd'hui.

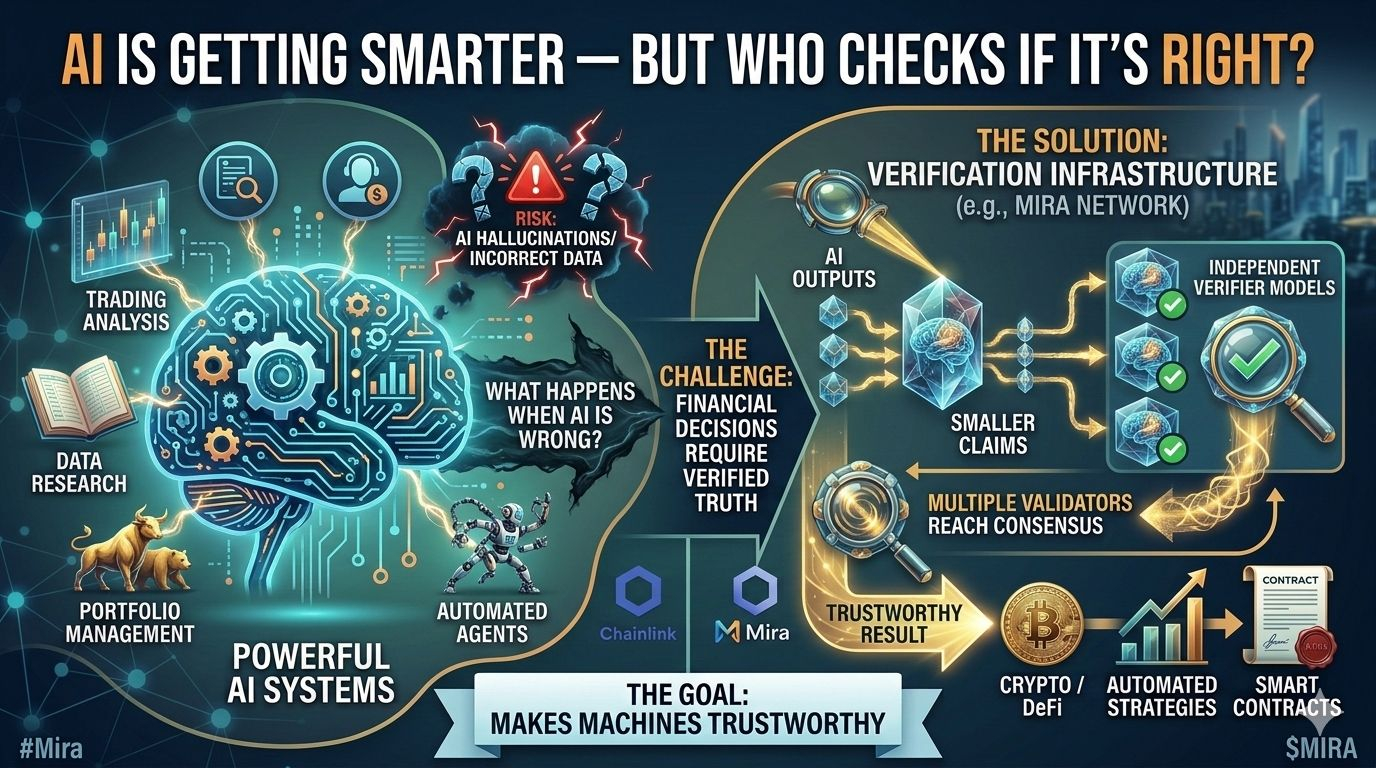

Dans la crypto seule, des outils d'IA sont déjà utilisés pour :

• analyse de trading

• recherche de données sur la chaîne

• gestion de portefeuille

• agents financiers automatisés

Mais en explorant l'architecture derrière $MIRA , une question ne cessait de revenir à l'esprit.

Que se passe-t-il lorsque l'IA se trompe ?

Pas parce que le modèle est cassé — mais parce que les systèmes d'IA génèrent naturellement des réponses basées sur la probabilité plutôt que sur la vérité vérifiée.

Dans de nombreuses situations, cela ne pose pas de problème sérieux.

Cependant, lorsque l'IA commence à influencer les décisions financières, les agents automatisés et l'infrastructure blockchain, la fiabilité de ces résultats devient soudainement extrêmement importante.

Le problème caché dans les systèmes d'IA

Les modèles d'IA peuvent produire des réponses extrêmement convaincantes même lorsque l'information est partiellement incorrecte.

Ce phénomène, communément appelé hallucination de l'IA, est l'un des plus grands défis dans le développement moderne de l'IA.

Par exemple :

Un assistant de trading IA analysant les marchés de la crypto pourrait générer un signal de trading confiant basé sur des données incomplètes.

Si les systèmes automatisés exécutent cette décision, les conséquences pourraient rapidement devenir coûteuses.

C'est pourquoi la prochaine phase de l'infrastructure de l'IA pourrait ne pas se concentrer uniquement sur le renforcement des modèles.

Elle peut se concentrer sur la vérifiabilité de leurs résultats.

Comment Mira aborde ce problème

Au lieu de construire un autre modèle d'IA, Mira Network se concentre sur l'infrastructure de vérification.

L'idée de base est simple mais puissante :

Les résultats de l'IA sont divisés en revendications plus petites et évalués par plusieurs modèles de vérification indépendants.

Chaque vérificateur vérifie si la revendication est logiquement cohérente et factuellement fiable.

Lorsque plusieurs validateurs parviennent à un consensus, le résultat devient beaucoup plus fiable que de se fier à la réponse d'un seul modèle.

Ce processus de validation décentralisé introduit une couche d'intégrité supplémentaire pour l'intelligence machine.

Pourquoi cela compte pour la crypto et DeFi

L'industrie de la crypto-monnaie évolue vers des systèmes de plus en plus automatisés.

Des exemples incluent :

• agents de trading pilotés par l'IA

• stratégies DeFi automatisées

• plateformes d'intelligence des données blockchain

À mesure que ces systèmes deviennent plus autonomes, garantir que les résultats de l'IA sont fiables devient critique.

L'infrastructure de vérification comme Mira pourrait aider à réduire les risques associés à la prise de décision automatisée.

Le tableau d'ensemble

Si nous regardons comment les systèmes numériques évoluent, les couches d'infrastructure deviennent souvent les composants les plus importants.

Par exemple :

Chainlink est devenu essentiel pour connecter les contrats intelligents avec des données du monde réel.

De même, les couches de vérification pourraient devenir essentielles pour garantir que les systèmes d'IA fonctionnent en toute sécurité au sein de l'infrastructure financière.

C'est la vision plus large que des projets comme @mira_network explorent.

Dernière pensée

La plupart des projets d'IA se concentrent sur le fait de rendre les machines plus intelligentes.

Mais à mesure que l'IA s'intègre dans les systèmes économiques réels, un autre défi apparaît :

s'assurer que ces machines sont correctes.

L'intelligence a rendu l'IA puissante.

La vérification pourrait être ce qui la rend digne de confiance.