Hier, je testais encore quelques prompts d'IA tout en travaillant sur des recherches et une réponse avait en fait l'air parfaite au début. Explication claire, ton confiant, même une référence à la fin.

Puis j'ai essayé d'ouvrir la source.

La citation n'existait pas.

Pas évidemment faux… juste légèrement erroné. Et c'est cela qui me dérange à propos de l'IA en ce moment. C'est incroyablement bon pour sembler correct même lorsque l'information est un peu fausse.

C'est essentiellement le problème autour duquel le "Mira Network" est construit.

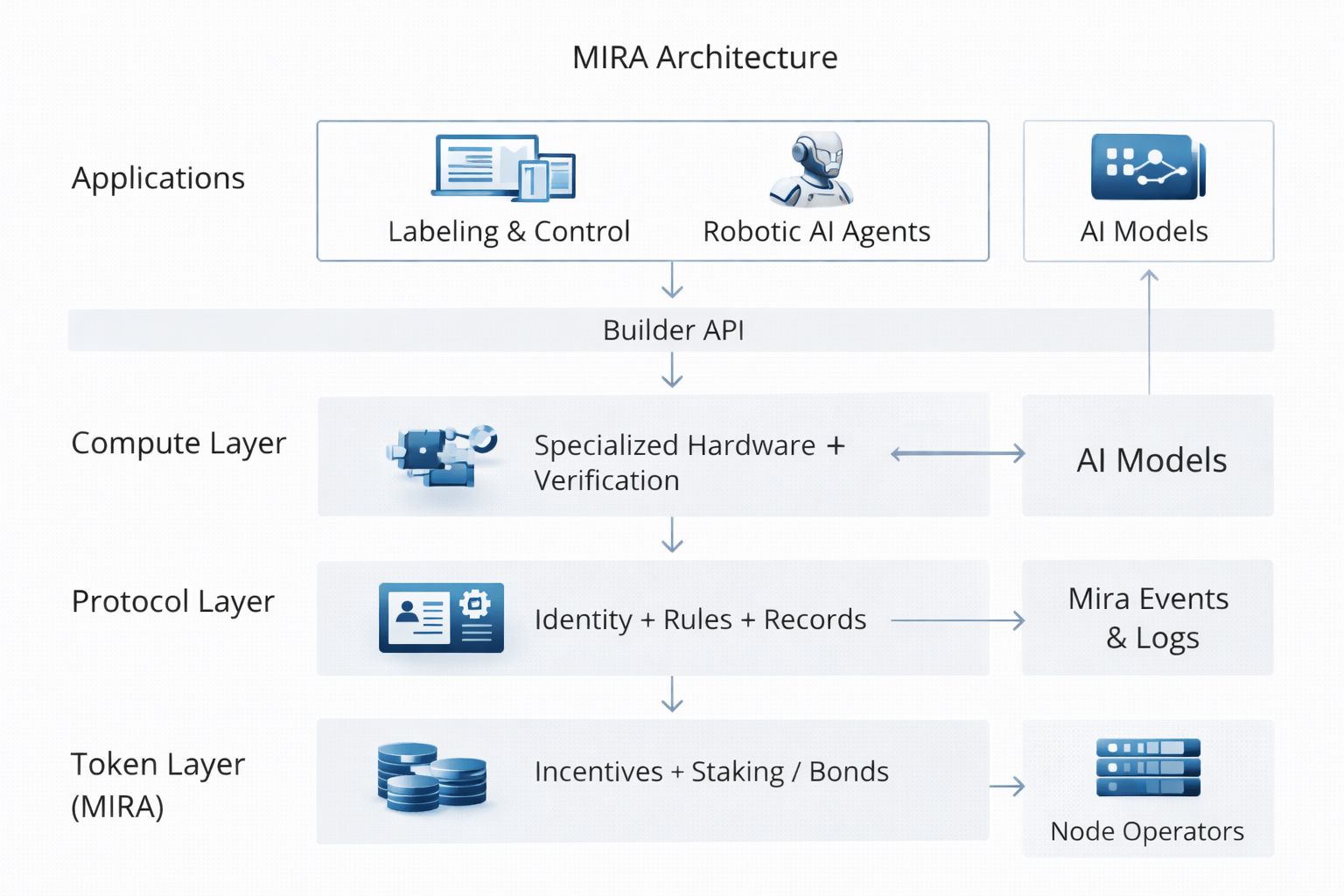

La plupart des projets d'IA se concentrent sur la rendre les modèles plus intelligents. Des modèles plus grands, plus de paramètres, de meilleures bases de données d'entraînement. Mais Mira adopte un angle différent. Au lieu de supposer que les modèles deviendront finalement parfaits, elle se concentre sur « la vérification des résultats produits par ces modèles ».

Et honnêtement... cette approche semble plus réaliste.

La façon dont Mira fonctionne est en fait assez intéressante. Lorsque l'IA génère une réponse, le protocole ne traite pas la réponse comme un bloc d'informations. Au lieu de cela, il divise la sortie en « affirmations individuelles ».

Une statistique.

Une déclaration.

Une référence.

Chaque affirmation peut ensuite être vérifiée séparément.

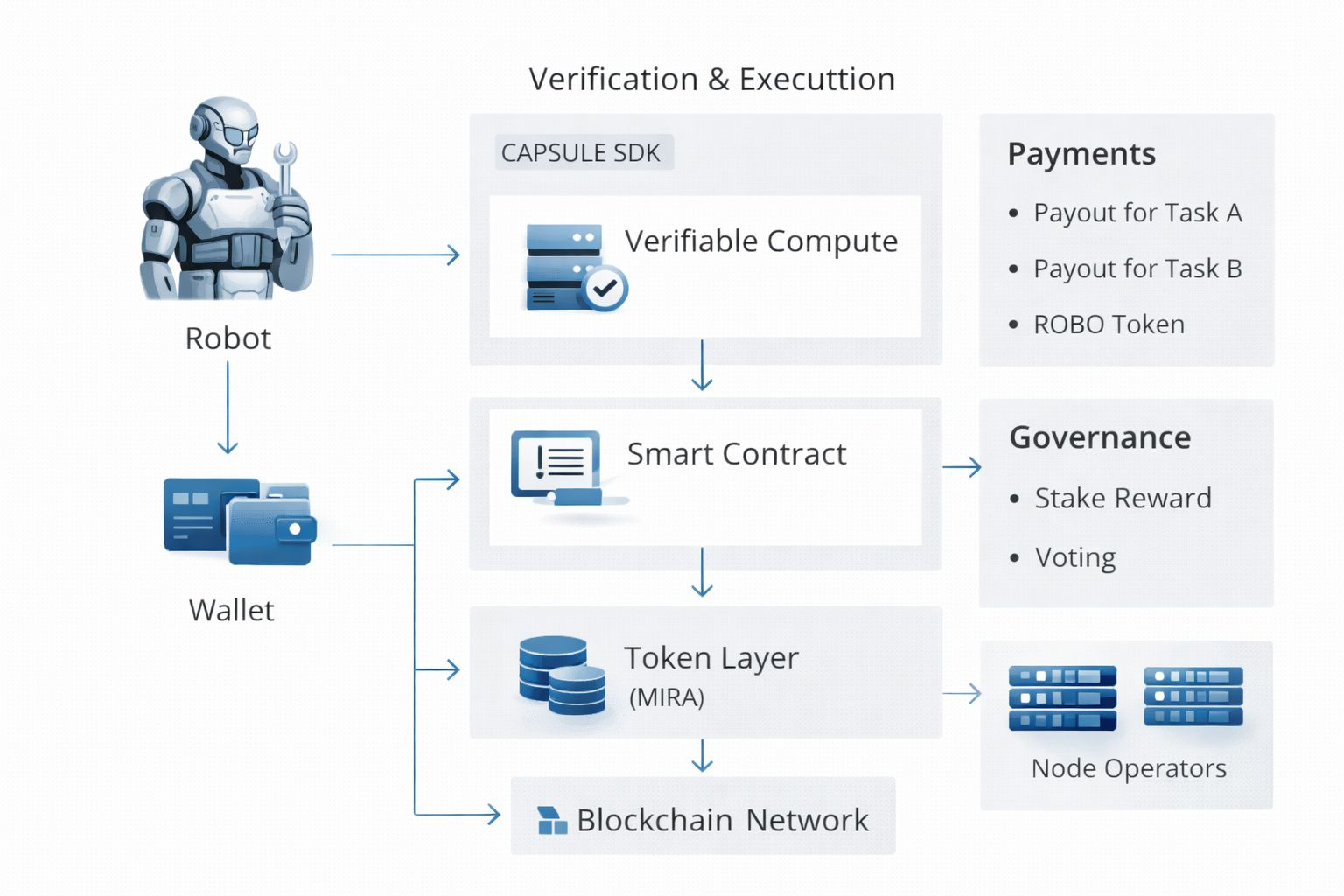

Ces affirmations sont réparties sur un réseau de validateurs. Certains validateurs peuvent être d'autres modèles d'IA. D'autres peuvent être des systèmes conçus spécifiquement pour évaluer certains types d'informations.

Au lieu de faire confiance à un seul modèle, le réseau recherche un « accord entre plusieurs validateurs ».

Si suffisamment de systèmes indépendants confirment le même résultat, cette affirmation devient vérifiée et enregistrée par consensus blockchain.

Ce petit changement modifie complètement le modèle de confiance autour de l'IA.

En ce moment, lorsque nous lisons une réponse de l'IA, nous agissons essentiellement comme la couche de vérification nous-mêmes. Nous ouvrons des onglets supplémentaires, comparons des réponses, vérifions les chiffres.

Mira déplace ce processus « dans le protocole ».

Les validateurs sont incités à vérifier les affirmations avec soin. Une validation correcte peut rapporter des récompenses. Une validation incorrecte peut entraîner des pénalités.

Ainsi, au fil du temps, le système transforme les sorties de l'IA en quelque chose de plus proche de « l'information vérifiable au lieu de conjectures confiantes ».

Ce qui rend cette idée intéressante pour moi, c'est la direction que semble prendre l'IA.

Aujourd'hui, l'IA agit principalement comme un assistant. Vous lisez la réponse et décidez quoi faire. Mais de nouveaux agents d'IA commencent déjà à automatiser des tâches dans la finance, l'analyse de données et l'infrastructure numérique.

Si ces systèmes commencent à prendre des décisions automatiquement, même de petites erreurs peuvent avoir beaucoup plus d'importance.

C'est pourquoi la vérification pourrait s'avérer tout aussi importante que l'intelligence.

La thèse de Mira est essentiellement la suivante : l'IA continuera à générer des informations, mais un réseau décentralisé devrait décider si ces informations peuvent réellement être considérées comme fiables.

Et honnêtement, après avoir vu une autre fausse citation hier... cette idée semble soudainement beaucoup plus nécessaire.