Je me souviens du jour où je suis allé en cours et où j'ai laissé un colis de livraison à la maison. J'ai fait confiance au système automatisé pour tout gérer. Plus tard, j'ai entendu dire que le robot de livraison avait fait tomber le colis. À ce moment-là, une simple question m'est venue à l'esprit : qui est en faute ? Est-ce le robot ? L'entreprise qui a construit le robot ? Moi, pour avoir fait confiance au robot ?

Ce n'est pas un incident. Alors que l'automatisation se propage rapidement dans le monde, une vieille question prend forme : si une machine fait le travail au lieu d'un humain, qui répond lorsque quelque chose ne va pas ? C'est une question qui affecte la Fabric Foundation et son travail avec la robotique et la blockchain.

Lorsqu'un outil échoue, ce n'est pas l'outil lui-même qui est en faute. Celui qui a choisi l'outil l'est. Lorsqu'un réseau comme la Fabric Foundation réunit la robotique et la blockchain pour créer un écosystème automatisé, cette question n'est plus seulement philosophique. Elle devient une réalité commerciale. Si un robot manque une livraison, si un contrat intelligent s'exécute au moment opportun ou si une décision automatisée nuit à un client, qui se manifestera et prendra la responsabilité? Qui dira : "Cette erreur est la mienne" et prendra la faute pour la machine?

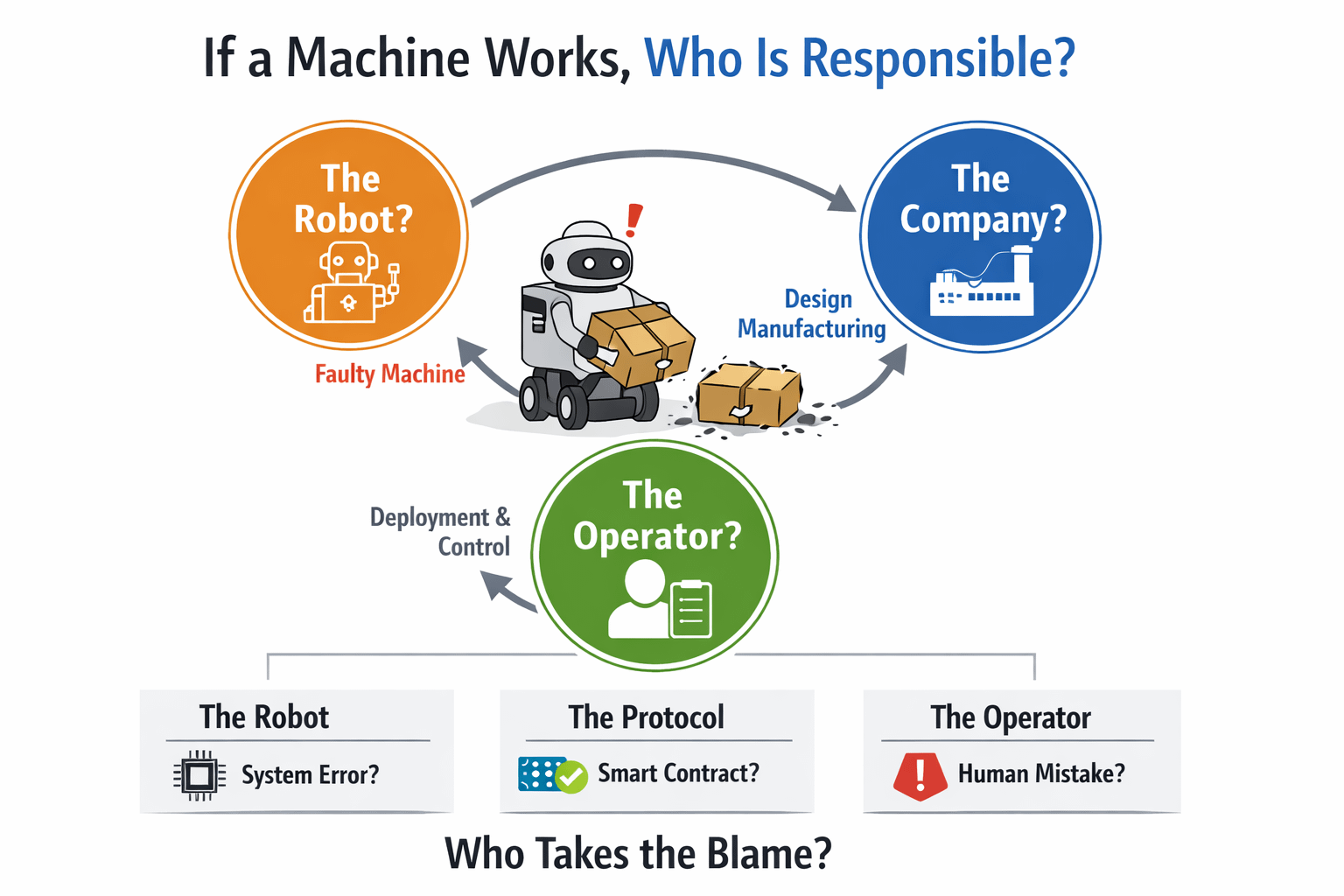

Imaginez un nœud robotique sur le réseau Fabric complétant une tâche logistique. En raison du cycle d'époque, la récompense pour cette tâche n'est pas déclenchée car la fenêtre temporelle des réseaux s'est déjà fermée. Maintenant, la question se pose : le robot est-il responsable? Le protocole est-il responsable? L'opérateur qui a déployé la tâche est-il responsable? Si la responsabilité à travers ces trois couches n'est pas claire, la crédibilité des réseaux est en jeu.

D'un point de vue commercial, si cette question n'a pas de réponse, les investissements ne viendront pas. Aucun client d'entreprise ne fera confiance à un système où des erreurs se produisent. Personne ne prend la responsabilité de la machine. Le plus grand obstacle à l'intelligence et à la robotique aujourd'hui n'est pas technique. C'est l'absence de responsabilité pour les machines.

Si un système automatisé dans votre entreprise prend une décision, qui est mentionné comme responsable dans votre contrat pour la machine? Dans un réseau comme la Fabric Foundation, est-il possible de définir "responsabilité" dans le code ou cela dépend-il toujours du jugement humain pour les machines? Si un robot fait le travail et qu'un humain reçoit le résultat, qui possède l'échec entre les deux pour le robot?

La Fabric Foundation s'attaque à ce défi. Elle ne connecte pas les robots et la blockchain. Elle crée un cadre transparent pour la responsabilité au sein de cette connexion pour les machines. Grâce au système de récompense de jeton ROBO, basé sur des périodes temporelles et une vérification en chaîne. Tous ces efforts visent à encoder la responsabilité pour les robots. Le code à lui seul n'est pas suffisant. Le jugement humain au-delà du protocole, la vigilance de l'opérateur et la responsabilité éthique des concepteurs de systèmes. Sans ces trois couches, aucun contrat intelligent ne peut jamais être entièrement sûr pour les machines.

Peu importe à quel point une machine devient intelligente, elle ne peut pas aller au-delà des règles écrites par des humains pour la machine. Les humains peuvent. Et c'est le problème central pour les machines. Les machines ne font pas d'erreurs. Nous le faisons en faisant faire le travail aux machines.

Pas une Conclusion, mais une Question

Chaque fois que vous comptez sur un système automatisé, faites une pause et demandez-vous : si cette machine fait une erreur, suis-je prêt à prendre cette responsabilité pour la machine?