Il y a un problème silencieux au cœur du monde de l'IA avec lequel la plupart des gens ont déjà appris à vivre, même s'ils ne le disent pas toujours à voix haute. Les réponses sont rapides. La langue est raffinée. La confiance est souvent convaincante. Mais quelque part entre l'utilité et la vérité, quelque chose continue de glisser. Vous pouvez le sentir au moment où une IA vous donne une réponse claire à une question importante et, au lieu du soulagement, ce que vous ressentez d'abord, c'est le doute. Pas parce que la réponse semble mauvaise, mais parce qu'elle semble trop certaine pour quelque chose que vous savez encore pouvoir être faux. Cette petite hésitation est devenue l'une des réalités émotionnelles définissantes de l'IA moderne.

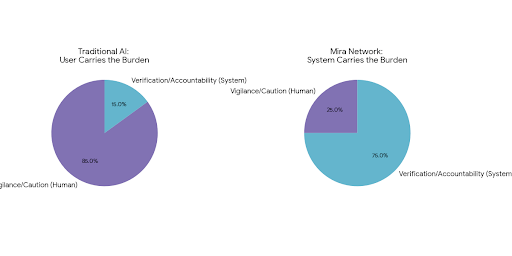

Les gens ont construit des habitudes entières autour de cette hésitation. Ils posent la même question deux fois. Ils vérifient une autre source. Ils comparent un modèle à un autre. Ils lisent attentivement, non pas parce qu'ils le veulent, mais parce qu'ils ne supposent plus que le système a gagné la confiance simplement parce qu'il semble intelligent. C'est la partie de l'histoire de l'IA qui est souvent ignorée. Pour tout le discours sur le progrès, la plupart des utilisateurs portent encore le fardeau de la prudence par eux-mêmes. La machine parle avec aisance, mais l'humain est celui qui doit trier ce sur quoi on peut réellement compter.

C'est pourquoi un projet comme le réseau Mira semble pertinent d'une manière plus sérieuse que beaucoup d'autres. Il ne semble pas provenir uniquement de l'excitation. Il semble provenir de l'irritation, de l'observation des mêmes faiblesses réapparaître encore et encore jusqu'à ce qu'il devienne impossible de les ignorer. Il y a une certaine maturité dans les projets qui sont construits non pas sur une grande ambition, mais sur une exposition répétée à un défaut qui continue de causer des dommages. Mira semble appartenir à cette catégorie. Elle ne commence pas par l'idée que l'IA a simplement besoin de devenir plus puissante. Elle commence par la réalisation plus difficile que le pouvoir sans vérification continue de créer la même relation fragile entre le système et l'utilisateur.

Ce point de départ est important car il façonne toute la philosophie derrière le réseau. Beaucoup de produits d'IA sont construits pour impressionner d'abord et stabiliser ensuite. Ils se concentrent sur la production, la vitesse, la portée et l'échelle. Mira semble prendre le chemin opposé. Elle commence par la partie inconfortable. Elle demande ce qui se passe après que la réponse est générée. Qui la vérifie ? Comment la confiance est-elle acquise ? Que se passe-t-il lorsque la réponse semble cohérente mais cache un raisonnement faible en dessous ? Ce ne sont pas des questions glamour, mais ce sont celles qui décident si l'IA devient quelque chose sur lequel les gens peuvent vraiment compter ou juste quelque chose qu'ils empruntent prudemment.

Ce qui rend l'idée derrière Mira convaincante, c'est qu'elle traite la confiance comme quelque chose qui doit être intégré dans le processus, pas ajouté comme une marque. Au lieu de demander aux gens d'accepter une réponse d'IA comme une vérité finie, elle décompose la production en revendications plus petites qui peuvent être vérifiées, contestées et validées à travers un réseau décentralisé. Cela peut sembler un choix de conception, mais cela change quelque chose de plus profond que la conception. Cela change la forme émotionnelle de l'interaction. L'utilisateur n'a plus besoin de faire confiance à toute la réponse ou de la rejeter entièrement. La relation devient plus ancrée. Une revendication peut se tenir ou tomber par elle-même.

Cela se sent plus proche de la manière dont le jugement humain fonctionne réellement. Dans la vie réelle, les gens acceptent rarement des informations complexes d'un seul coup. Ils recherchent la cohérence. Ils testent certaines parties. Ils font plus confiance à une section qu'à une autre. Ils avancent progressivement, pas aveuglément. Les systèmes d'IA traditionnels sautent souvent ce processus naturel. Ils présentent une réponse finie avec une fluidité qui peut rendre le doute inconfortable. Mira fait quelque chose de plus honnête. Elle fait de la place pour l'examen à l'intérieur du système lui-même. Elle accepte que si l'IA va avoir de l'importance dans des environnements sérieux, alors la vérification ne peut pas rester une réflexion optionnelle.

Cela a un effet direct sur le comportement. Lorsque les utilisateurs sentent que la vérification a été intégrée dans le système, leur relation avec la production change. Ils cessent d'aborder chaque réponse comme un risque poli. Ils commencent à voir le résultat comme quelque chose qui a passé une couche de responsabilité avant de les atteindre. Cela ne signifie pas qu'une confiance aveugle apparaît soudainement. Cela signifie que le fardeau de la vigilance n'est plus entièrement supporté par la personne à l'autre bout de l'écran. Et cette différence est plus grande qu'il n'y paraît. En pratique, de nombreuses personnes ne recherchent pas la perfection de l'IA. Elles recherchent suffisamment de fiabilité pour ne pas avoir à rester mentalement tendues tout le temps où elles l'utilisent.

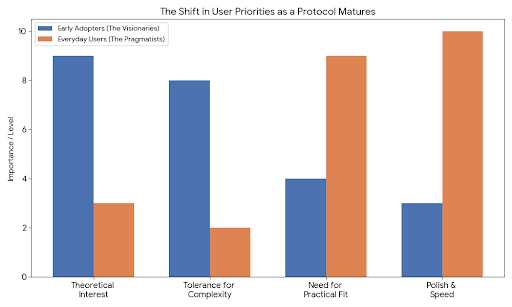

Vous pouvez généralement en apprendre beaucoup sur un protocole en observant le comportement de ses premiers utilisateurs. Dans des systèmes comme Mira, les premiers utilisateurs sont souvent exceptionnellement patients. Ils ne sont pas là parce que tout est poli. Ils sont là parce qu'ils sentent déjà que le système actuel est cassé d'une manière spécifique. Ils sont prêts à faire face à des défauts parce que l'idée plus profonde compte pour eux. Ces utilisateurs ont tendance à être réfléchis, expérimentaux et un peu plus tolérants à la complexité. Ils n'utilisent pas seulement un produit. Ils testent si une structure de confiance différente peut réellement fonctionner.

Mais plus tard, les utilisateurs sont beaucoup moins indulgents, et c'est là que la véritable histoire commence. Ils n'arrivent pas pour valider une théorie. Ils arrivent parce qu'ils ont besoin de quelque chose qui fonctionne. Ils se soucient moins de l'architecture et plus de savoir si le protocole s'intègre naturellement dans de véritables flux de travail. Ils veulent savoir si la vérification crée plus de confiance sans créer plus de confusion. Ils ne s'intéressent pas aux idéaux à moins que ces idéaux ne survivent au contact d'une utilisation pratique. Ce changement des premiers adopteurs curieux aux utilisateurs quotidiens exigeants est l'une des transitions les plus importantes que tout projet sérieux traverse.

Cette transition est là où un protocole commence à révéler s'il est encore une expérience ou s'il devient une infrastructure. Les expériences peuvent survivre sur la croyance. L'infrastructure ne peut pas. L'infrastructure est jugée par la répétition, par la confiance sous pression, par ce qui se passe après que la première vague d'intérêt s'estompe. Si Mira va avoir de l'importance au fil du temps, ce ne sera pas parce que les gens ont trouvé le concept élégant. Ce sera parce que les développeurs, les équipes et les utilisateurs commencent silencieusement à construire leurs habitudes autour d'elle. Ils commenceront à sentir que l'IA sans une forme de vérification n'est pas seulement incomplète, mais risquée d'une manière qui n'est plus acceptable.

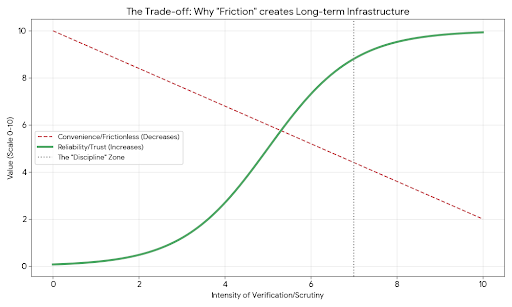

Ce qui rend cela difficile, c'est que la vérification s'accompagne presque toujours de friction. Et la friction est quelque chose que le monde technologique moderne a appris à ne pas aimer. Tout est censé être instantané, fluide, sans effort. Mais la vérité est que tous les types de friction ne sont pas des défauts. Une certaine friction est un signe que le système respecte le coût d'une erreur. Dans un monde où l'IA peut sembler convaincante tout en faisant des erreurs, une petite pause avant de faire confiance n'est pas de l'inefficacité. C'est de la discipline. La valeur plus profonde de Mira peut résider dans le fait qu'elle est prête à protéger cette discipline au lieu de prétendre que chaque système utile doit également sembler sans friction.

Cela crée l'une des tensions centrales du protocole. Les utilisateurs veulent des réponses rapidement, mais ils veulent aussi que ces réponses soient fiables. Plus la couche de vérification devient sérieuse, plus elle doit résister à la culture de la vitesse qui domine les produits d'IA. Ce n'est pas un équilibre facile. Si le processus devient trop lourd, les gens l'évitent. S'il devient trop léger, il cesse de signifier quoi que ce soit. Il n'y a pas de solution parfaite à cette tension. Il n'y a que des compromis, et ces compromis en disent long sur ce qu'un projet valorise réellement lorsque la commodité et la crédibilité commencent à tirer dans des directions opposées.

C'est aussi pourquoi la retenue est si importante dans un système comme celui-ci. Certaines des décisions les plus importantes ne concernent pas ce qui est lancé, mais ce qui est retardé. Il y a toujours une pression pour s'étendre plus rapidement, pour soutenir plus de cas d'utilisation, pour simplifier l'histoire, pour faire sonner le système comme étant plus complet qu'il ne l'est réellement. Mais la vérification est l'un de ces domaines où les promesses excessives peuvent nuire à la chose même que vous essayez de construire. Si les utilisateurs commencent à sentir que le réseau leur donne l'apparence de la certitude sans la substance, la confiance se brise à la racine. Et une fois que cela se produit, il est très difficile de réparer.

Les questions les plus difficiles apparaissent généralement dans les cas limites, et les cas limites sont là où le sérieux devient visible. Que se passe-t-il lorsque les évaluateurs ne s'accordent pas ? Que se passe-t-il lorsqu'une revendication est techniquement vérifiable mais contextuellement trompeuse ? Que se passe-t-il lorsque plusieurs modèles convergent sur la même mauvaise réponse ? Que se passe-t-il lorsque de mauvais acteurs apprennent à formuler des revendications faibles de manière à sembler faciles à vérifier ? Ce ne sont pas des préoccupations secondaires. Ce sont le véritable terrain. Un projet qui comprend cela ne traite pas les cas limites comme des exceptions rares. Il les traite comme des avertissements sur la forme future de l'utilisation quotidienne.

Ce type de réflexion change la manière dont la confiance communautaire se forme. Dans de nombreux écosystèmes, la confiance se construit avec du bruit. Les gens sont récompensés pour leur enthousiasme, pas pour leur observation. Mais dans des systèmes plus sérieux, la confiance provient de l'observation du comportement au fil du temps. Les utilisateurs remarquent si le projet est honnête sur ses limites. Ils remarquent si les échecs sont cachés ou examinés. Ils remarquent si l'équipe devient défensive lorsqu'elle est remise en question ou si la critique aiguise réellement le système. Au fil du temps, ces détails comptent beaucoup plus que des slogans ou un élan temporaire.

La véritable confiance est généralement plus silencieuse que les gens ne s'y attendent. Ce n'est pas une excitation émotionnelle. Ce n'est pas une loyauté aveugle. C'est le sentiment qui vient de voir un système se comporter de manière suffisamment cohérente pour que vous commenciez à comprendre son caractère. Vous savez où il est fort. Vous savez où il est prudent. Vous savez où il hésite encore. C'est ce type de confiance que l'infrastructure gagne. Elle ne demande pas à être admirée. Elle demande à être testée, observée, et finalement comptée sur car elle continue de faire ce qu'elle dit qu'elle fera.

Le côté décentralisé de Mira compte ici aussi, mais pas de la manière superficielle dont ce mot est souvent utilisé. La décentralisation ne compte que si elle améliore la manière dont la confiance est formée. Un réseau n'est pas automatiquement crédible simplement parce qu'il est distribué. La véritable question est de savoir si cette distribution crée de l'indépendance, de la responsabilité et une résistance au contrôle d'un point unique. Dans le cas de la vérification de l'IA, cela compte beaucoup. Lorsque qu'une entreprise contrôle le modèle, la production, l'évaluation et la définition de ce qui compte comme sûr ou correct, l'utilisateur ne participe pas vraiment à la confiance. Il l'hérite.

Mira fait allusion à un modèle différent. Elle suggère que la confiance ne devrait pas être entièrement emballée par une seule autorité centrale. Elle devrait émerger d'un processus où les revendications peuvent être contestées et vérifiées à travers un réseau qui est structurellement plus ouvert que ce que la pile d'IA actuelle permet. Cela ne rend pas le système magiquement parfait. Cela rend simplement la confiance plus contestable, et cela seul a du sens. Dans un domaine où tant d'influence est consolidée entre un petit nombre d'acteurs, donner à la vérification sa propre couche indépendante semble moins être une fonctionnalité et plus une correction nécessaire.

Pour les développeurs, cela change la logique émotionnelle de construire avec l'IA. En ce moment, de nombreux bâtisseurs utilisent l'IA de manière prudente. Ils la laissent aider, suggérer, résumer et rédiger, mais ils s'arrêtent avant de lui donner trop de responsabilités car le coût d'une erreur non détectée est encore trop élevé. Un protocole comme Mira pourrait changer cet état d'esprit au fil du temps. Pas en éliminant complètement l'incertitude, mais en rendant l'incertitude plus gérable. Une fois que la vérification devient partie intégrante de l'environnement, les bâtisseurs peuvent penser moins comme des joueurs et plus comme des concepteurs de systèmes à nouveau.

Ce changement compte car il déplace la conversation de la capacité à la responsabilité. C'est une chose de demander si l'IA peut faire quelque chose. C'est une toute autre chose de demander si le système environnant le rend suffisamment sûr pour compter sur cette capacité en pratique. La deuxième question est plus mature, et c'est là que l'industrie doit finalement se diriger. L'intelligence brute peut attirer l'attention, mais une structure fiable est ce qui rend l'adoption à long terme possible. Mira est intéressante car elle semble comprendre que la couche manquante n'est pas juste une meilleure production. C'est une production responsable.

La plus forte preuve de santé dans un protocole comme celui-ci ne viendra jamais de l'attention seule. Elle viendra de modèles d'utilisation qui sont beaucoup plus silencieux et révélateurs. Les gens reviennent-ils après l'avoir essayé ? Les équipes le gardent-elles dans leurs produits après que l'excitation s'estompe ? Les intégrations deviennent-elles plus profondes avec le temps ? Le réseau résout-il un problème si réel que les utilisateurs n'ont plus besoin d'être persuadés ? Ce sont les signes qui séparent les systèmes durables des expériences intéressantes. La rétention est souvent plus véridique que le battage médiatique car elle reflète la valeur vécue, et non la curiosité temporaire.

La qualité de l'intégration raconte une histoire encore plus importante. Beaucoup de systèmes semblent impressionnants jusqu'à ce qu'ils rencontrent de véritables flux de travail. Les vraies équipes sont désordonnées. Les délais sont serrés. L'infrastructure ne survit que si elle réduit la douleur sans créer de nouvelles confusions. Si Mira s'intègre bien dans des produits où la fiabilité compte réellement, cela en dira plus sur sa pertinence à long terme que n'importe quelle grande narration ne pourrait jamais le faire. De bonnes intégrations sont une forme de preuve. Elles montrent que le protocole n'est pas seulement conceptuellement attrayant, mais pratiquement nécessaire.

Si l'écosystème inclut un jeton, alors sa signification à long terme dépend de s'il renforce la responsabilité ou en distrait. Le seul rôle sérieux d'un jeton dans un réseau comme celui-ci est l'alignement. Il devrait aider à coordonner la participation, récompenser les contributions honnêtes, décourager les comportements nuisibles et donner à la gouvernance une structure réelle au fil du temps. S'il s'éloigne trop de ces objectifs, il devient du bruit. Mais s'il reste lié à la gestion, alors il peut servir de moyen pour les gens d'exprimer leur croyance non pas dans le battage médiatique, mais dans l'importance à long terme de l'intelligence vérifiée.

La gouvernance compte pour la même raison. Dans un protocole basé sur la confiance, la gouvernance n'est pas juste de l'administration. C'est là que les valeurs du système sont testées sous pression. Il y aura toujours des moments où la croissance exige des compromis, où une adoption plus rapide tente le projet de brouiller les frontières, de simplifier les nuances ou de surestimer la préparation. La gouvernance est ce qui détermine si la discipline survit à ces moments. À long terme, cela peut compter plus que n'importe quelle caractéristique technique unique. Les normes sont faciles à décrire en périodes calmes. Leur vraie valeur se révèle lorsque les maintenir devient inconfortable.

Ce qui rend Mira silencieusement important, c'est qu'elle ne semble pas construite autour du spectacle. Elle semble construite autour d'un problème qui devient plus lourd à mesure que l'IA entre dans la vie sérieuse. Une fois que l'IA commence à influencer la recherche, les finances, la coordination, la prise de décision, la gouvernance et l'automatisation, la vérification cesse de sembler optionnelle. À ce stade, les gens ne veulent plus seulement des réponses. Ils veulent des réponses qui peuvent survivre à un examen. Ils veulent des systèmes qui ne leur demandent pas de choisir entre utilité et prudence à chaque fois. C'est le fossé que Mira essaie de combler.

Et peut-être que c'est la manière la plus honnête de comprendre son rôle. Pas comme quelque chose qui rend l'IA magique, mais comme quelque chose qui rend l'IA responsable. C'est une ambition plus silencieuse, mais plus mature. Il ne s'agit pas de faire en sorte que la machine semble plus intelligente. Il s'agit de rendre le système autour de la machine moins négligent. Dans un domaine qui a souvent récompensé la confiance bien avant la fiabilité, ce genre de changement compte plus qu'il n'apparaît au premier abord.

Il reste encore beaucoup à prouver dans cette catégorie. La vérification est difficile. La coordination décentralisée est difficile. Le jugement humain lui-même est souvent désordonné, incomplet et façonné par le contexte. Aucun protocole n'échappe à ces réalités. Mira devra encore faire face à des désaccords, des ambiguïtés, des surfaces d'attaque, des évaluateurs imparfaits et la constante tentation de présenter une certitude plus propre que ce que la vérité permet. Rien de cela ne doit être ignoré. En fait, reconnaître ces limites peut être l'un des signes les plus forts que le projet comprend la responsabilité qu'il prend.

Si cette discipline reste intacte, le réseau Mira pourrait lentement devenir l'un de ces systèmes dont les gens cessent de parler en termes dramatiques parce qu'il est devenu trop utile pour le drame. Pas un miracle. Pas un remplacement du jugement humain. Pas une solution finale à tout ce qui ne va pas avec l'IA. Juste quelque chose de plus rare et de plus durable : une couche de confiance dans une partie du monde numérique qui a passé trop de temps à confondre confiance et vérité. Et si elle atteint ce point, cela ne se produira pas parce qu'elle a crié le plus fort. Cela se produira parce qu'elle a, au fil du temps, donné aux gens une raison de respirer.

\u003cm-60/\u003e \u003ct-62/\u003e \u003ct-64/\u003e \u003cc-66/\u003e