Au cours de l'année passée, j'ai remarqué quelque chose d'étrange en utilisant des outils d'IA.

Les réponses semblent confiantes.

Parfois brillant.

Mais de temps en temps... elles sont tout simplement fausses.

Pas légèrement faux. Complètement fabriqué.

Quiconque passe du temps avec de grands modèles linguistiques a probablement vécu ce moment. Vous posez une question en espérant de la clarté, et à la place, vous recevez une réponse qui semble soignée mais suspecte. Plus vous vérifiez en profondeur, plus vous réalisez que le système vient d'inventer quelque chose qui n'a jamais existé.

Ce problème a un nom dans le monde de l'IA : hallucinations.

Et ce n'est pas un petit problème. C'est en fait une limitation structurelle de la façon dont fonctionnent les modèles d'IA modernes.

Les grands modèles de langage ne “savent” pas des faits. Ils prédisent le mot suivant le plus statistiquement probable.

Cette approche probabiliste est puissante pour générer du texte, du code ou des images. Mais cela signifie également que le modèle peut produire des informations incorrectes de manière confiante si le modèle de probabilité le suggère.

Ce qui soulève une question inconfortable.

Que se passe-t-il lorsque l'IA commence à prendre des décisions dans la finance, la robotique, la recherche ou la santé ? Une mauvaise réponse n'est plus juste ennuyeuse.

Cela devient dangereux.

C'est ici que l'idée derrière @Mira - Trust Layer of AI commence à devenir intéressante.

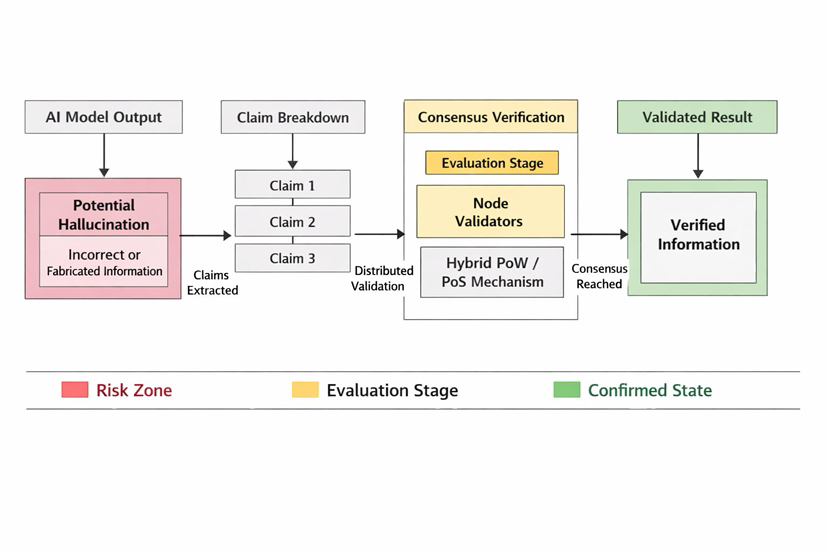

Au lieu d'essayer de construire un modèle IA parfait, Mira aborde le problème sous un angle différent. Le système suppose que l'IA fera des erreurs et conçoit une infrastructure capable de détecter et de vérifier ces erreurs collectivement.

L'architecture est construite autour d'un mécanisme simple mais puissant.

Tout d'abord, un modèle d'IA génère une réponse. Ensuite, cette réponse est décomposée en revendications individuelles. Chaque revendication devient quelque chose qui peut être vérifié indépendamment.

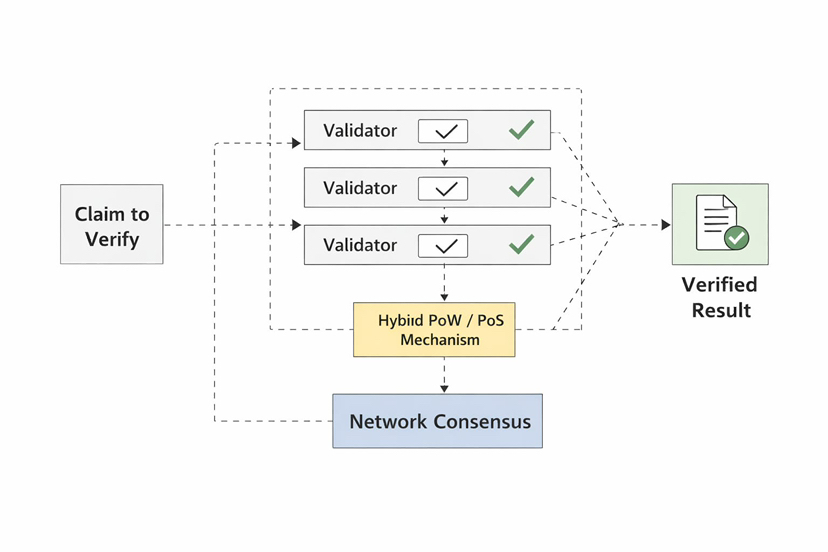

À partir de là, plusieurs modèles d'IA à l'intérieur du réseau Mira évaluent ces revendications. Ils vérifient si l'information est cohérente avec leur propre raisonnement et connaissance.

Si suffisamment de validateurs s'accordent sur le résultat, le système atteint la vérification par consensus.

En d'autres termes, le réseau se comporte moins comme une IA unique et plus comme un panel d'experts débattant de la véracité de chaque déclaration.

Ce processus introduit quelque chose que les systèmes d'IA d'aujourd'hui manquent :

confiance vérifiable.

Les personnes qui dirigent ces nœuds de vérification ne sont pas seulement des bénévoles non plus. La conception de Mira introduit une structure d'incitation hybride combinant les principes de Proof-of-Work et de Proof-of-Stake.

Les opérateurs de nœuds effectuent des tâches d'inférence pour vérifier les revendications.

La vérification honnête est récompensée économiquement.

Le comportement malhonnête devient coûteux.

Cela transforme essentiellement la vérification de l'IA en un processus cryptoeconomique.

Et cette idée semble très alignée avec la direction dans laquelle Web3 évolue.

Depuis des années, les blockchains ont résolu le problème de la vérification des transactions financières sans autorités centralisées.

#Mira essaie quelque chose de similaire pour la validation de vérité de l'IA.

Au lieu de vérifier qui possède un jeton…

Le réseau vérifie si une information est probablement correcte.

Une autre partie intéressante de la vision est l'objectif à long terme de Mira : construire ce qu'ils décrivent comme un modèle de fondation synthétique capable de fournir des résultats sans erreur grâce à une vérification en couches.

Cela ne signifie pas que l'IA deviendra soudainement parfaite.

Mais cela pourrait signifier que les systèmes d'IA ne reposent plus sur une confiance aveugle.

Chaque revendication pourrait porter un score de confiance soutenu par une validation décentralisée.

Si cette infrastructure fonctionne à grande échelle, cela pourrait changer la façon dont l'IA est intégrée dans des systèmes critiques.

Agents autonomes.

Outils de recherche.

Moteurs de décision.

Tous en bénéficieraient d'une couche de vérification qui fonctionne indépendamment du modèle générant la réponse.

En ce moment, l'industrie de l'IA s'empresse de construire des modèles plus grands.

Plus de paramètres.

Plus de données d'entraînement.

Plus de calcul.

L'approche de Mira suggère un chemin différent.

Peut-être que la prochaine avancée n'est pas une IA plus intelligente.

Peut-être que c'est une IA qui peut prouver quand elle a raison.

Et dans un monde où les machines prennent de plus en plus de décisions sans supervision humaine, cette différence pourrait avoir plus d'importance que nous ne le réalisons.