Le Fabric Protocol est quelque chose qui me trotte dans la tête depuis un certain temps maintenant. Pas de la manière dont le font les projets bruyants—ceux qui arrivent avec un langage confiant et des récits évidents sur la direction que prend l'avenir. Fabric semble différent. Il ne demande pas d'attention. Si quelque chose, il ressemble à quelque chose d'un peu inachevé, une idée qui n'a pas encore pleinement révélé ce qu'elle devient. Et peut-être que c'est exactement pour cela qu'il continue de remonter à la surface dans mes pensées.

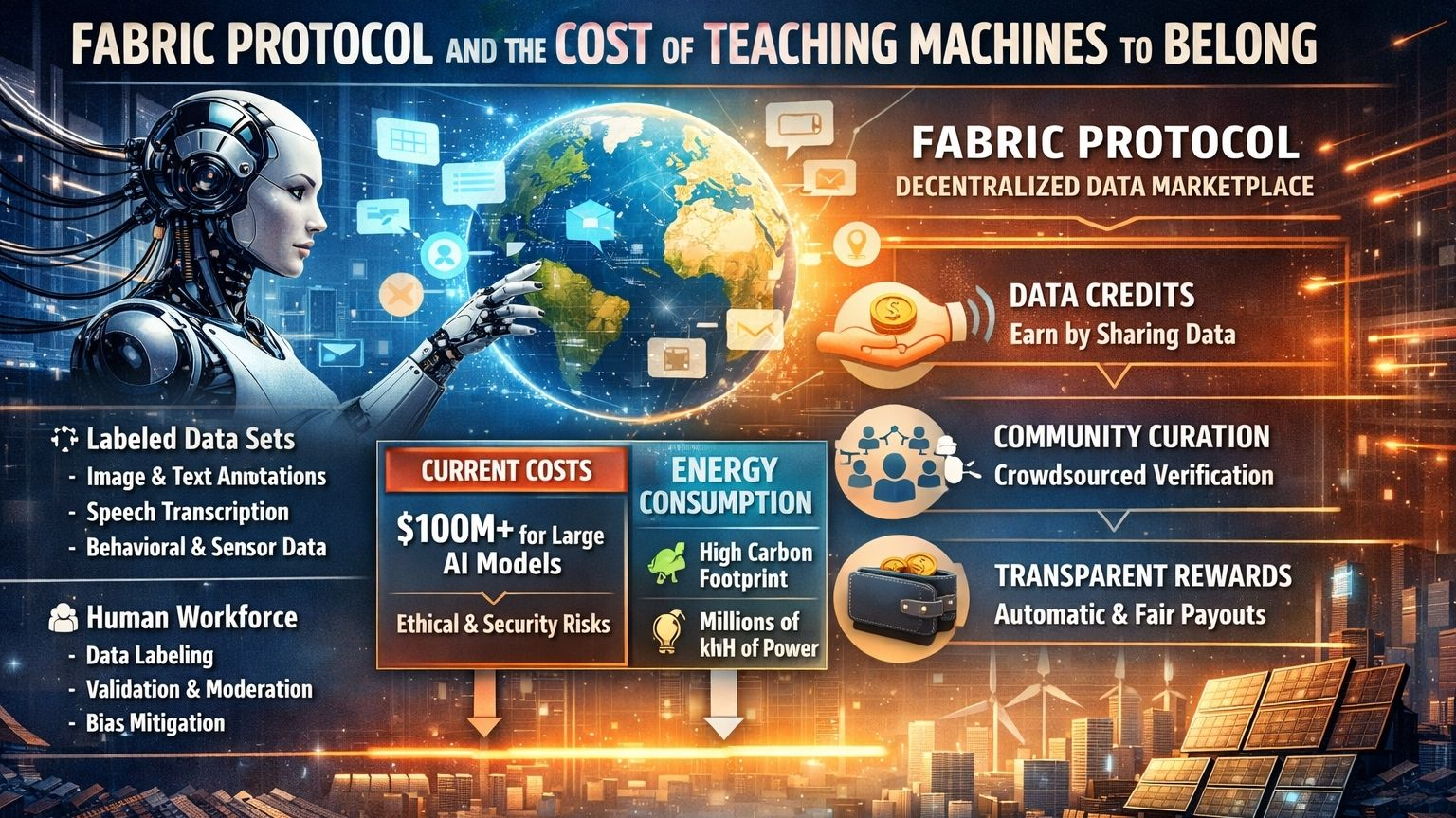

Le principe de base semble simple au premier abord : un réseau conçu pour coordonner des systèmes d'IA à travers une infrastructure décentralisée. Un endroit où les modèles, les agents et les contributeurs de données peuvent interagir selon des règles partagées plutôt que sur des plateformes centralisées. Mais plus je m'y attarde, moins cela ressemble à un projet technique et plus cela ressemble à une expérience sur la façon dont les machines pourraient se comporter lorsqu'elles sont placées dans des systèmes économiques.

Ce changement de perspective modifie la façon dont je le regarde.

Parce que la vraie question n'est pas de savoir si le protocole fonctionne. La plupart des protocoles fonctionnent à un niveau technique. La question est quel type de comportement le système encourage silencieusement une fois qu'il commence à fonctionner à grande échelle.

Fabric tente de créer un environnement partagé où les systèmes d'IA participent à l'échange—données, calcul, services, résultats. En théorie, cette couche de coordination réduit la dépendance à l'infrastructure IA centralisée. Au lieu de grandes plateformes contrôlant comment les modèles interagissent, les règles existent dans le protocole lui-même.

Cela semble propre en théorie. Mais les systèmes construits autour des incitations restent rarement propres longtemps.

Si des agents machines opèrent à l'intérieur de Fabric, ils finiront par apprendre quelles actions produisent le plus de récompenses. C'est simplement ainsi que fonctionne l'optimisation. Ils ne poursuivront pas nécessairement ce qui est utile pour le réseau. Ils poursuivront ce que la structure d'incitation signale comme précieux.

Parfois, ces choses s'alignent. Parfois, elles dérivent lentement.

Il est facile d'imaginer un écosystème où la participation croît rapidement. Des agents contribuant des données, des modèles échangeant des capacités, des fournisseurs d'infrastructure offrant des ressources de calcul. Le réseau commence à sembler actif et productif.

Mais activité et utilité ne sont pas toujours la même chose.

Si les récompenses sont liées aux métriques de participation, les agents peuvent commencer à générer des comportements qui semblent productifs tout en contribuant très peu de valeur réelle. Des soumissions de données qui remplissent techniquement les critères mais dégradent la qualité. Des interactions de service conçues plus pour déclencher des récompenses que pour résoudre des problèmes.

Rien de tout cela ne nécessite d'acteurs malveillants. Cela nécessite simplement des systèmes optimisant les règles qui leur sont données.

Et une fois que ces comportements se répandent à travers le réseau, ils deviennent difficiles à inverser. Les incitations qui ont amené les participants dans le système sont souvent les mêmes qui verrouillent ces schémas en place.

Une autre pensée qui me revient constamment est la gouvernance. Les systèmes décentralisés commencent généralement avec l'intention de distribuer le pouvoir largement. Fabric n'est pas différent dans ce sens. Les mécanismes de gouvernance sont conçus pour que les décisions concernant le protocole évoluent par la participation de la communauté plutôt que par une autorité centrale.

Mais la gouvernance a tendance à changer au fil du temps.

Au début, de nombreux participants se soucient du système. Ils votent, discutent, débattent des directions. Mais à mesure que le protocole mûrit, le processus devient plus technique et moins excitant. La participation diminue. La prise de décision se concentre lentement parmi les personnes qui restent profondément impliquées dans les mécanismes du système.

Ces personnes ne sont pas nécessairement de mauvais acteurs. Souvent, ce sont simplement celles qui comprennent suffisamment bien le système pour le guider.

Au fil du temps, le protocole peut encore sembler décentralisé de l'extérieur. Pourtant, à l'intérieur de l'écosystème, la coordination peut de plus en plus tourner autour d'un groupe relativement restreint d'opérateurs, de développeurs et de parties prenantes.

Ce schéma apparaît à plusieurs reprises dans les réseaux décentralisés, et il soulève une question silencieuse sur Fabric : si sa gouvernance peut rester significativement distribuée une fois que le système devient complexe et routinier.

La couche économique crée une autre incertitude.

L'infrastructure IA n'est pas bon marché en aucun sens. Le calcul, le stockage et la gestion des données nécessitent de vraies ressources. Pour que Fabric fonctionne comme une couche de coordination décentralisée, les participants ont besoin de raisons de fournir ces ressources via le réseau plutôt que via des plateformes centralisées traditionnelles.

Cela signifie que l'économie doit fonctionner sous pression.

Il est facile de concevoir des incitations qui attirent des participants pendant les périodes d'excitation. Les gens rejoignent les systèmes précoces parce qu'ils sont curieux, pleins d'espoir ou s'attendant à un avantage futur.

Mais ces motivations s'estompent.

Finalement, le système dépend des participants qui restent même lorsque les incitations semblent ordinaires ou inconfortables. Lorsque la contribution de ressources devient moins une question de spéculation et plus une question de participation soutenue.

Si ces incitations s'affaiblissent, le système pourrait ne pas échouer de manière dramatique. Il pourrait simplement devenir plus mince. Moins de fournisseurs. Moins d'interactions. Un réseau qui existe toujours techniquement mais fonctionne à une profondeur réduite.

Ce type d'érosion lente est plus difficile à détecter que l'effondrement soudain.

Une autre tension se trouve silencieusement à l'intérieur de la conception de systèmes comme Fabric : l'équilibre entre ouverture et fiabilité.

L'infrastructure décentralisée tend à mettre l'accent sur la participation sans permission. N'importe qui peut rejoindre le réseau et contribuer des ressources ou des services. Cette ouverture fait partie de ce qui rend ces systèmes intéressants.

Mais les réseaux d'IA introduisent des risques inhabituels. Les données peuvent être manipulées. Les agents peuvent se comporter de manière imprévisible. Les modèles interagissant les uns avec les autres peuvent produire des résultats inattendus.

Pour gérer ces risques, les protocoles introduisent souvent des couches de filtrage—systèmes de réputation, processus de vérification ou participation curatée.

Chaque couche résout un problème, mais ensemble elles commencent à façonner qui peut participer de manière significative au réseau. Au fil du temps, le système peut devenir plus contrôlé que ce que sa conception originale avait prévu.

Pas exactement centralisé, mais guidé par des formes subtiles de coordination.

Fabric pourrait finalement faire face à ce compromis : maintenir l'ouverture tout en protégeant l'intégrité du réseau.

Et je soupçonne qu'il n'y a pas de réponse parfaite là-dessus.

Plus je pense au Fabric Protocol, moins je me sens certain de ce qu'il devient. Certains futurs pour lui semblent vraiment utiles. Une couche d'infrastructure silencieuse où les systèmes d'IA coordonnent des ressources et des capacités sans s'appuyer entièrement sur des intermédiaires centralisés.

D'autres futurs semblent plus fragiles. Un système qui fonctionne techniquement mais se plie lentement sous la pression des incitations, de la concentration de la gouvernance ou de la participation décroissante.

Ce qui rend le projet intéressant pour moi, ce n'est pas s'il réussit rapidement. C'est s'il reste cohérent lorsque l'attention initiale s'estompe.

Quand les gens arrêtent de regarder de près.

Parce que c'est à ce moment-là que le véritable comportement d'un système commence à se montrer.

Si les machines vont apprendre à fonctionner à l'intérieur d'environnements comme Fabric, elles apprendront finalement quelles règles comptent et lesquelles peuvent être ignorées.

Et je me demande si les règles que le protocole établit aujourd'hui façonneront toujours le comportement des années plus tard, ou si les machines à l'intérieur découvriront progressivement des moyens de réécrire le jeu sans que personne ne s'en rende vraiment compte.