Lorsque l'IA est en désaccord, la confiance émerge :

La Révolution de la Responsabilité Multi-Modèles de Mira

Article Redéfini pour un Impact Maximum

@Mira - Trust Layer of AI #Mira

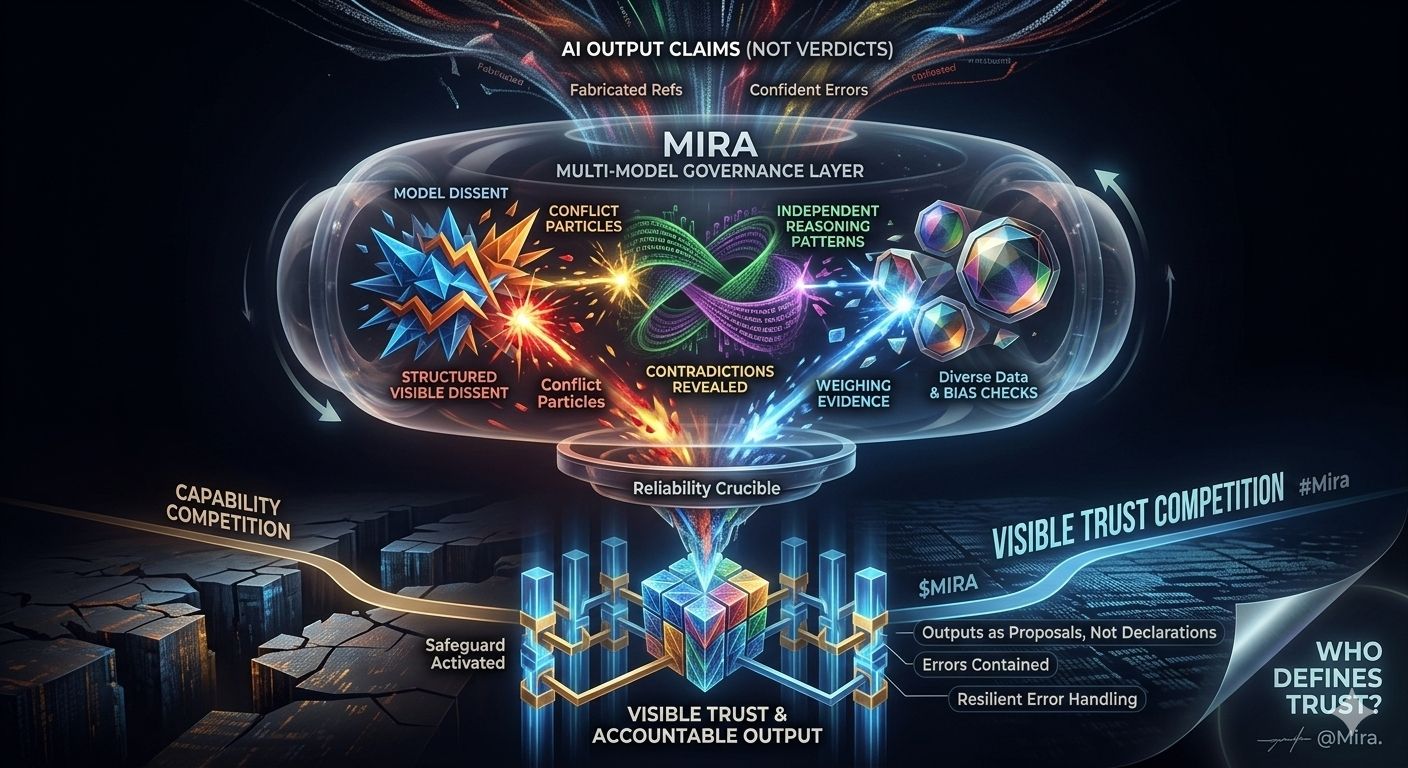

La fiabilité en IA ne concerne pas des réponses unanimes – il s'agit de la manière dont les systèmes gèrent le dissentiment. L'accord peut sembler rassurant, mais il peut cacher des défauts subtils : des faits mal interprétés, des références fabriquées ou un raisonnement confiant mais fragile. La véritable confiance émerge lorsque le désaccord est structuré, visible et vérifiable.

La plupart des échecs de l'IA sont des chuchotements subtils : une clause mal interprétée, un contexte négligé, une sortie confiante basée sur des hypothèses fragiles. L'auto-correction par un seul modèle amplifie souvent les mêmes erreurs. Mira renverse ce paradigme : chaque sortie de l'IA est une affirmation, pas un verdict. Plusieurs modèles indépendants examinent l'affirmation, chacun contribuant avec des données diverses, des schémas de raisonnement et des biais architecturaux. La vérification ne concerne pas le modèle le plus bruyant – il s'agit de la manière dont les preuves sont pesées, les contradictions révélées et la confiance quantifiée.

Le consensus est nuancé. Deux modèles peuvent être d'accord tandis qu'un dissent – est-ce que l'outsider repère une vraie faille ou hallucine ? Le système de Mira identifie les désaccords significatifs par rapport au bruit. Les sorties complexes se décomposent en déclarations vérifiables : les résumés financiers deviennent des aperçus vérifiables, les arguments juridiques se transforment en chaînes d'interprétation. Les modèles n'ont pas besoin d'être plus intelligents – les affirmations deviennent testables et responsables.

La confiance se déplace des modèles vers les couches de gouvernance. Les sorties sont crédibles non pas parce qu'un modèle l'a dit, mais parce que des systèmes indépendants ont atteint des conclusions compatibles. La transparence est essentielle : des données qui se chevauchent ou des architectures similaires peuvent biaiser le consensus, donc la diversité est un garde-fou de fiabilité.

La vérification a un coût – latence, computation, supervision humaine. Les applications intégrant l'IA deviennent désormais des chefs d'orchestre de fiabilité, gérant les compromis entre vitesse et certitude. Cela redessine le paysage concurrentiel : l'IA va rivaliser non seulement sur la capacité mais aussi sur la confiance visible, le désaccord structuré et la gestion résiliente des erreurs.

La gouvernance multi-modèles de Mira est plus qu'une fonctionnalité – c'est une couche de responsabilité. Les sorties de l'IA deviennent des propositions et non des déclarations. Les erreurs sont inévitables, mais le système les contient avant qu'elles ne se propagent dans les décisions des marchés ou le discours public.

La question ultime : qui définit la confiance, comment le dissentiment est-il interprété et quels garde-fous s'activent lorsque le consensus vacille ? C'est là que la fiabilité de l'IA vit vraiment.

$MIRA