Au cours des derniers mois, j'ai commencé à m'appuyer plus souvent sur des outils d'IA tout en recherchant différents sujets.

La vitesse est impressionnante.

Vous posez une question.

Une explication détaillée apparaît presque instantanément.

Au début, on a l'impression d'avoir un assistant puissant toujours prêt à aider.

Mais après avoir utilisé ces outils régulièrement, j'ai commencé à remarquer quelque chose de subtil.

Parfois, la réponse semble confiante...

pourtant, un petit détail s'avère incorrect lorsqu'il est vérifié par rapport à d'autres sources.

Rien de dramatique.

Juste assez pour vous faire pause.

Ces moments révèlent une réalité importante sur de nombreux systèmes d'IA aujourd'hui.

La plupart des modèles génèrent des réponses en prédisant des motifs dans les données.

Ils sont extrêmement bons pour produire un langage qui semble raisonnable et convaincant.

Mais le système lui-même ne vérifie souvent pas si chaque déclaration est réellement vraie.

C'est là que l'idée de vérification décentralisée devient intéressante.

Au lieu de s'appuyer sur un seul modèle pour générer et juger sa propre sortie, un réseau peut examiner la réponse sous plusieurs angles.

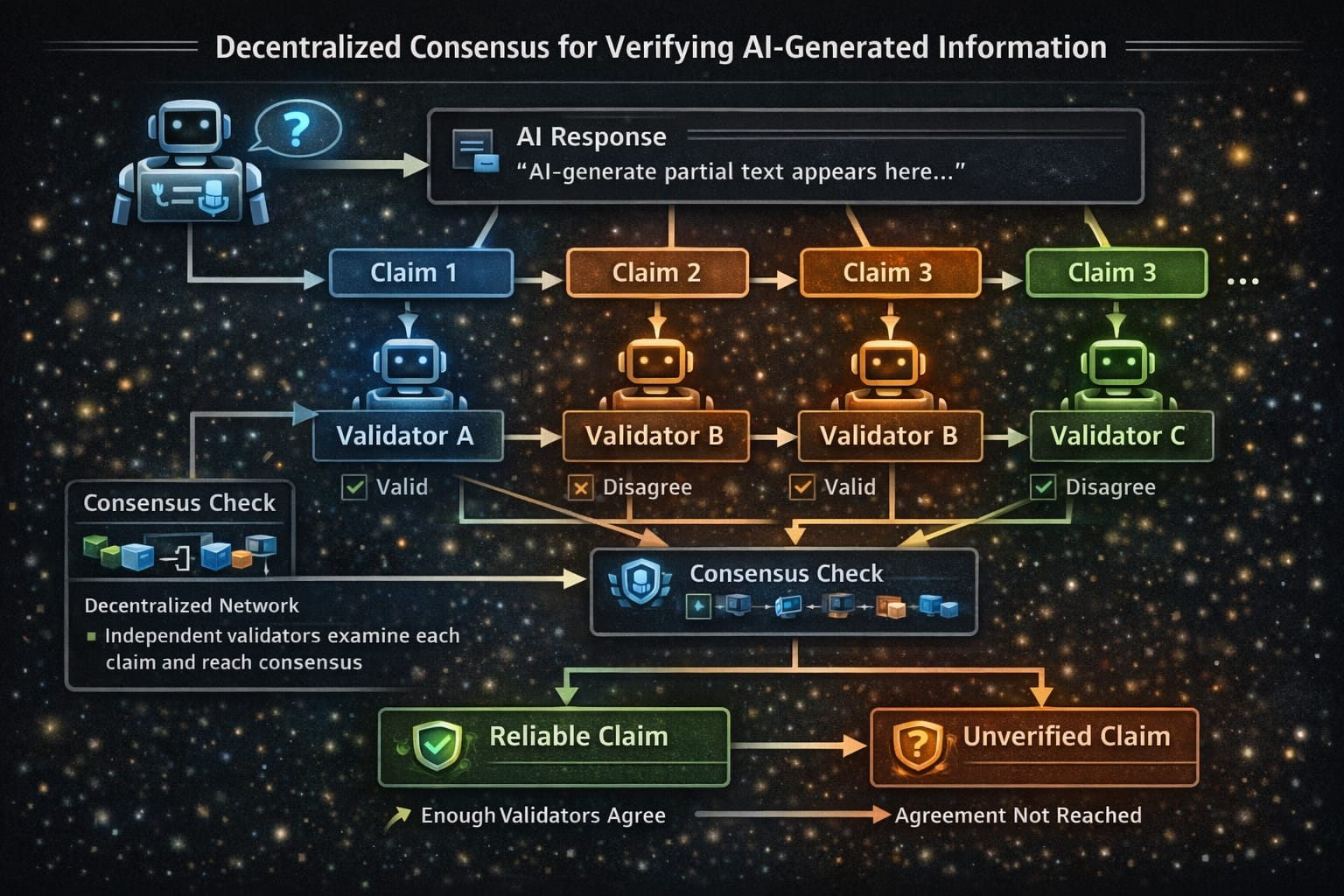

Une approche consiste à décomposer une réponse d'IA en morceaux plus petits.

Chaque élément devient une revendication individuelle.

Ces revendications peuvent ensuite être évaluées par différents modèles d'IA agissant en tant que validateurs indépendants.

Chaque validateur examine l'information séparément.

Certains modèles peuvent être d'accord avec la revendication.

D'autres peuvent le contester.

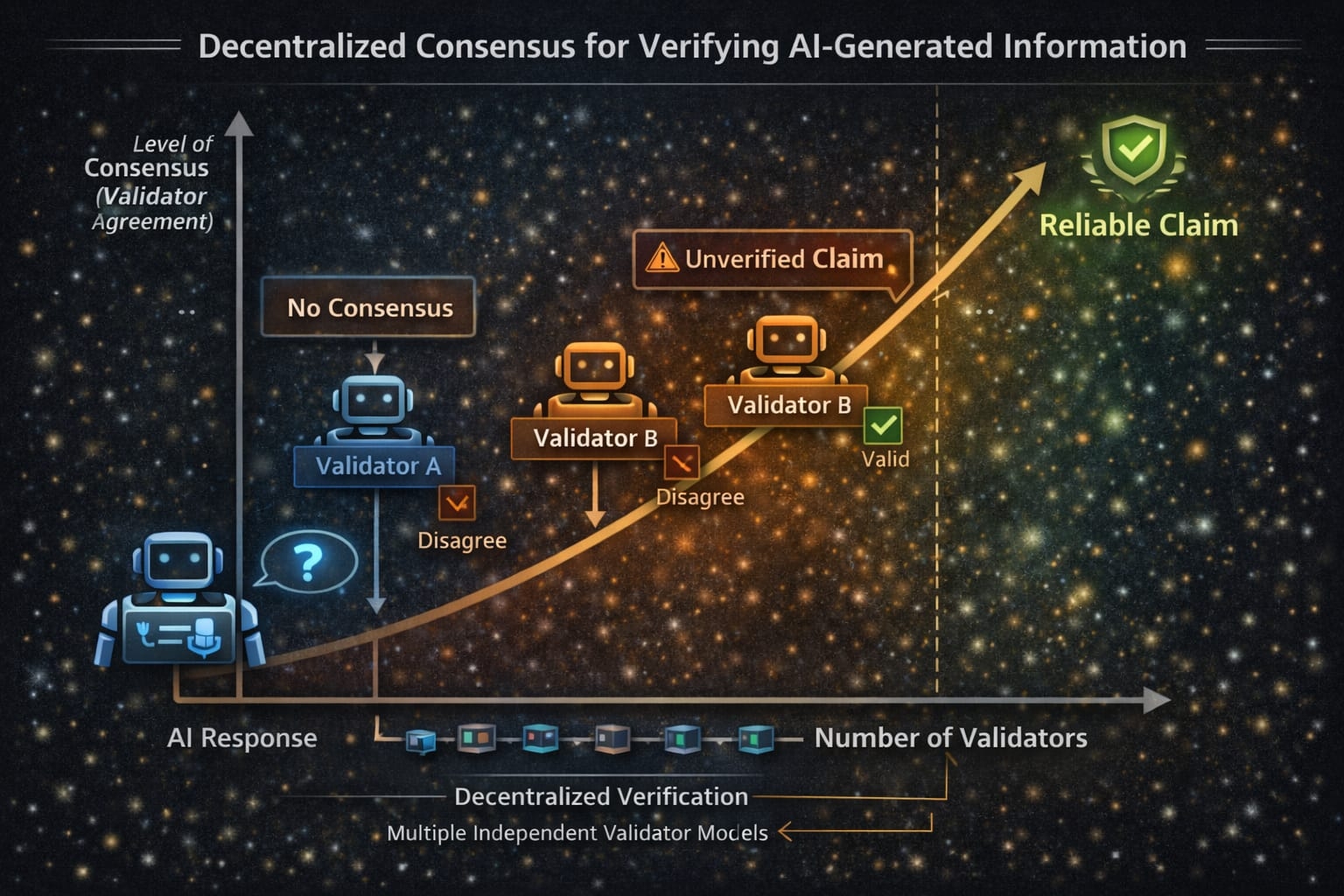

Lorsque suffisamment de validateurs parviennent à un accord, le réseau forme un consensus sur la fiabilité de la revendication.

En termes simples, la confiance ne vient pas de la confiance d'un seul modèle.

Cela provient de plusieurs systèmes atteignant indépendamment la même conclusion.

Ce concept semble similaire à la manière dont les technologies décentralisées résolvent la confiance dans d'autres domaines.

Au lieu de s'appuyer sur une seule autorité, la fiabilité émerge de l'accord entre de nombreux participants.

Pour les systèmes d'IA, ce type de structure pourrait devenir de plus en plus important.

L'IA influence déjà la recherche, l'analyse financière, l'éducation et la prise de décision quotidienne.

Dans ces situations, la différence entre une information qui semble correcte et une information qui peut être vérifiée devient critique.

Générer des réponses rapidement est déjà quelque chose que l'IA peut faire très bien.

Le véritable défi maintenant est de s'assurer que ces réponses peuvent être vérifiées, validées et dignes de confiance avant que les gens ne s'y fient.

Le consensus décentralisé offre un chemin possible vers cet avenir.

@Mira - Trust Layer of AI #Mira $MIRA