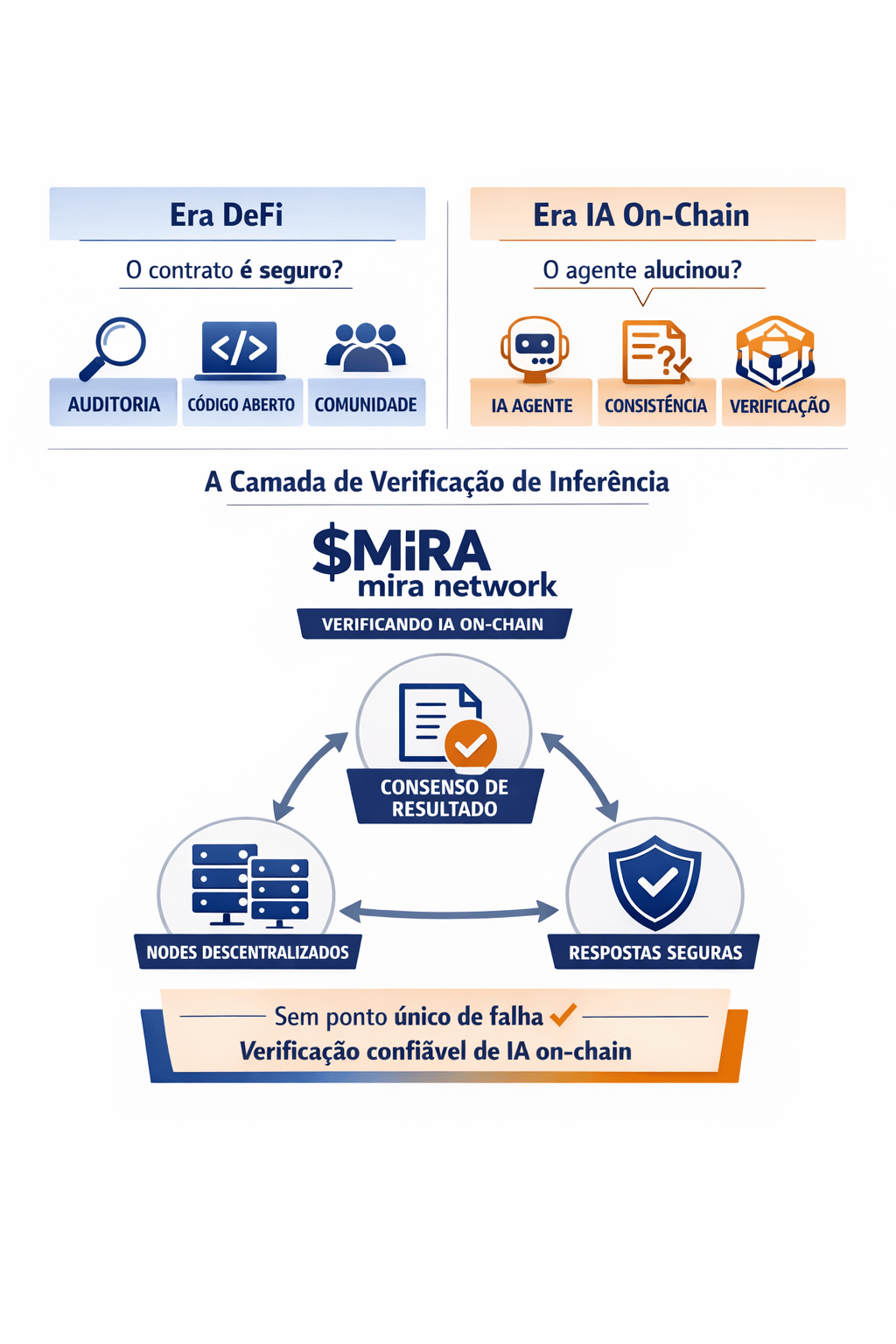

Je me souviens quand DeFi a explosé et que tout le monde se demandait "mais comment sais-tu que le contrat est sûr ?". La réponse était audit + code ouvert + communauté qui révise. Cela a pris du temps, mais la culture de vérification a été construite.

Je me souviens quand DeFi a explosé et que tout le monde se demandait "mais comment sais-tu que le contrat est sûr ?". La réponse était audit + code ouvert + communauté qui révise. Cela a pris du temps, mais la culture de vérification a été construite.

Maintenant, je vois le même cycle commencer avec l'IA on-chain. La question n'est plus "le modèle est-il bon ?" — c'est "comment je vérifie que cet agent n'a pas halluciné dans cette réponse spécifique ?".

C'est exactement cet espace que la @Mira - Trust Layer of AI occupe avec le $MIRA . Ils sont en train de construire la couche de vérification d'inférence qui sera nécessaire lorsque des agents d'IA commenceront à exécuter des transactions, gérer des protocoles et prendre des décisions critiques de manière autonome.

Ce qui m'a convaincu, c'est de comprendre qu'ils ne dépendent pas d'un seul vérificateur - c'est un ensemble de nœuds qui parviennent à un consensus sur la sortie. Cela élimine le point de défaillance unique que tout système centralisé d'IA a aujourd'hui.