"Le Modèle Étrange que J'ai Remarqué en Testant des Outils d'IA"

Plus tôt dans la journée, j'expérimentais avec quelques outils de recherche en IA tout en gardant un œil sur Binance Square. Le marché lui-même était calme, donc j'ai fini par passer plus de temps à lire les publications de campagne sur CreatorPad qu'à regarder des graphiques.

À un moment donné, j'ai demandé à l'un des systèmes d'IA de résumer une proposition de gouvernance DeFi que j'avais étudiée. La réponse semblait parfaite. Structurée. Confiance. Presque trop propre.

Ensuite, je l'ai comparé avec la proposition réelle.

Quelques détails étaient légèrement erronés.

Rien de dramatique, mais assez pour me faire pause. Le modèle avait produit une explication convaincante qui n'était pas complètement précise. Et c'est alors qu'une pensée m'est venue à l'esprit : Si l'IA va interagir avec des systèmes décentralisés, qui vérifie les informations qu'elle génère ?

Cette question m'a finalement conduit dans le terrier de Mira.

L'écart d'infrastructure dans les systèmes d'IA

La plupart des conversations autour de l'IA dans la crypto se concentrent sur les réseaux de calcul ou la formation des modèles. Nous entendons parler de clusters GPU décentralisés, de marchés de données et de couches d'inférence.

Mais quelque chose manque souvent à cette discussion.

Les modèles d'IA produisent des sorties constamment — analyses, prévisions, résumés, recommandations. Dans les plateformes centralisées, les entreprises agissent comme des gardiens qui filtrent ces sorties avant que les utilisateurs ne les voient.

Web3 n'a pas ce luxe.

Une fois que les agents d'IA commencent à fonctionner dans des environnements décentralisés — analysant des données de marché, suggérant des actions de gouvernance ou interagissant avec des contrats intelligents — des sorties incorrectes peuvent se propager rapidement.

Ce qui manque, c'est une couche de vérification indépendante.

Au lieu de supposer que les modèles sont corrects, les réseaux ont besoin de mécanismes qui confirment les résultats avant qu'ils ne soient approuvés.

C'est ici que l'architecture de Mira devient intéressante.

L'approche de Mira en matière de vérification

En lisant certaines discussions sur CreatorPad et des diagrammes communautaires partagés sur Binance Square, j'ai remarqué que Mira traite la vérification presque comme un réseau parallèle.

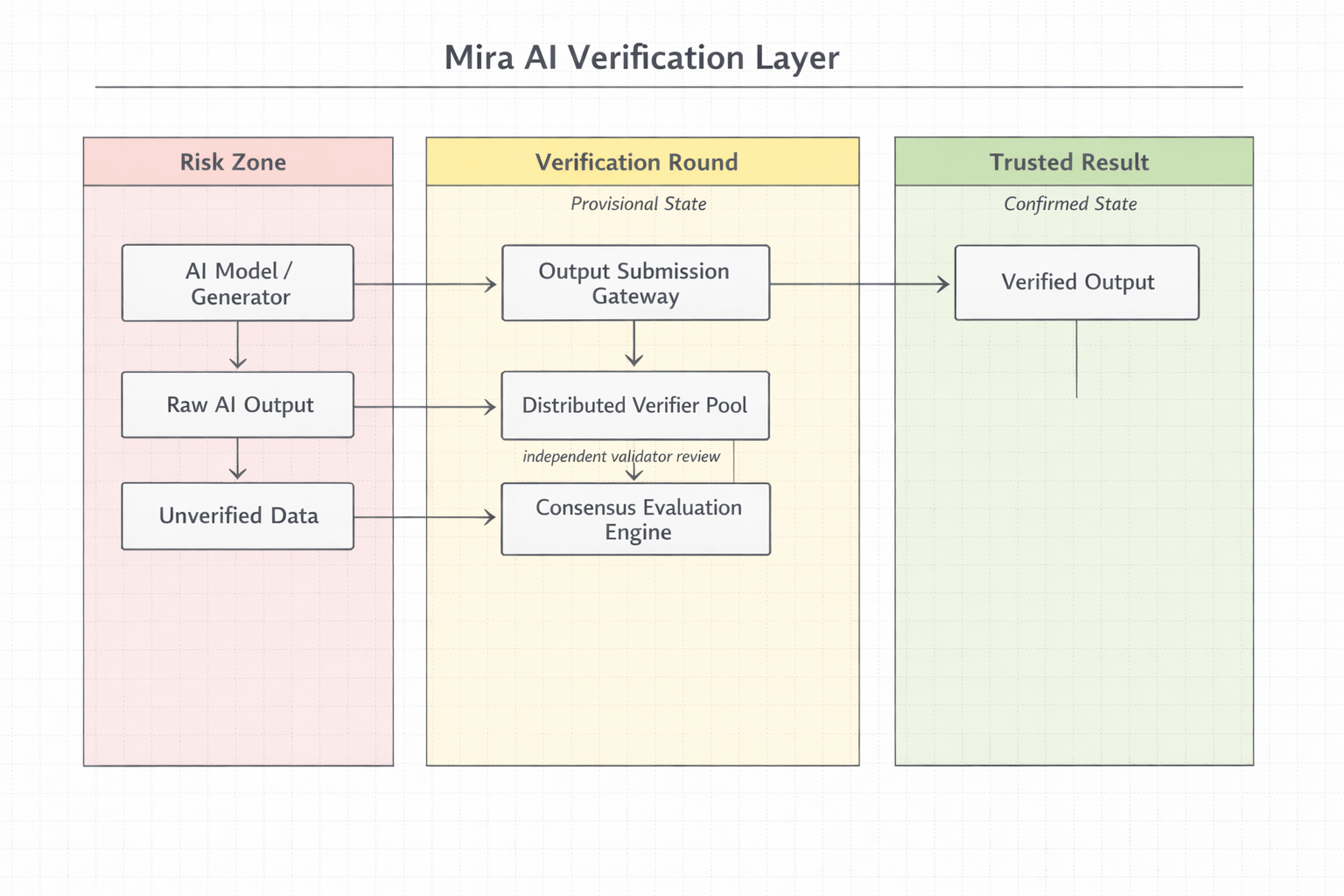

Le protocole sépare le pipeline de l'IA en deux rôles distincts :

• Générateurs – modèles ou systèmes d'IA produisant des sorties

• Vérificateurs – participants indépendants qui valident ces sorties

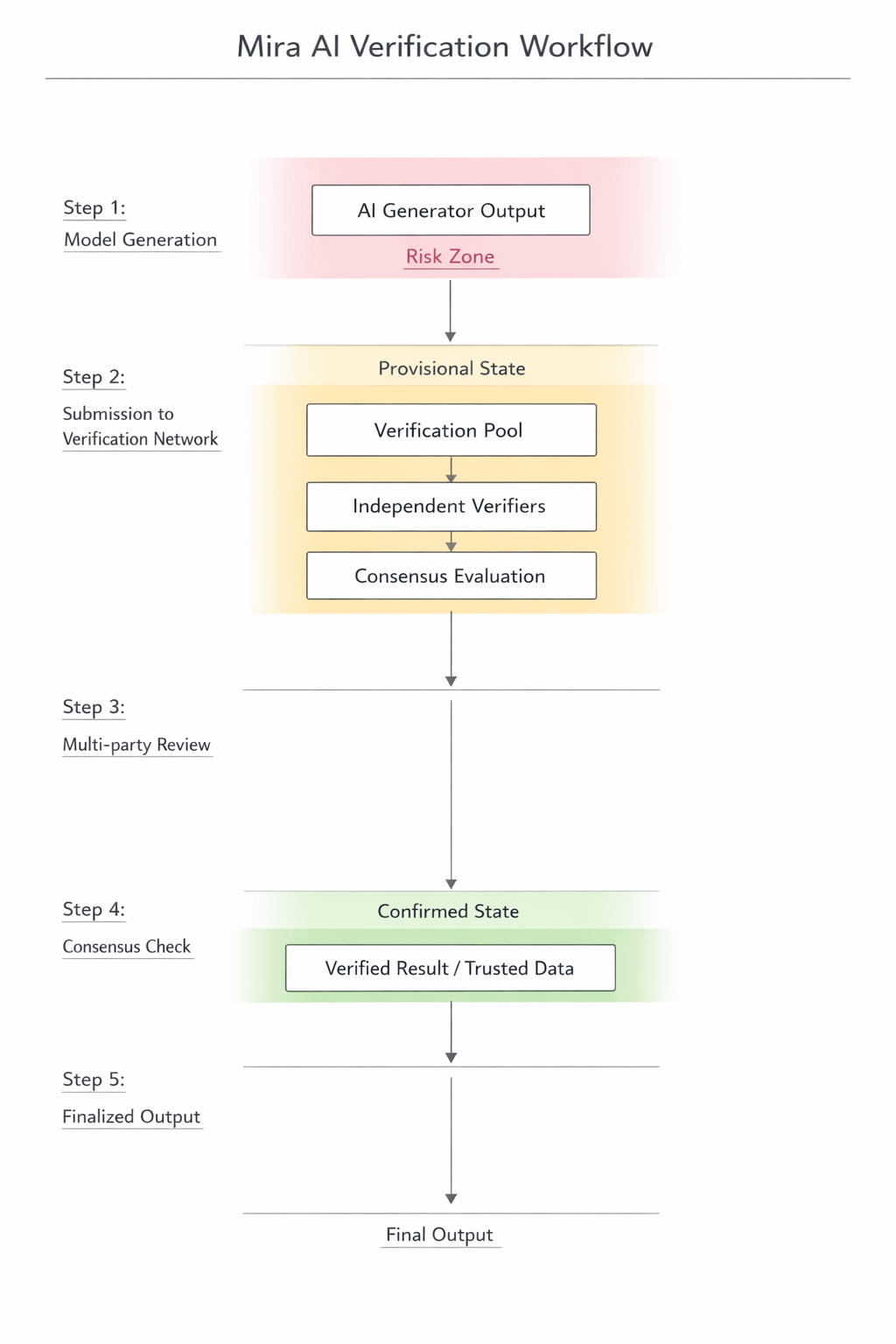

Le flux de travail est assez simple mais conceptuellement puissant. Un modèle d'IA génère une réponse ou une analyse. Cette sortie ne devient pas immédiatement des données fiables. Au lieu de cela, elle entre dans un tour de vérification où plusieurs participants examinent le résultat.

Ce n'est qu'après un consensus parmi les vérificateurs que la sortie devient acceptée par le système.

En essayant de comprendre la structure, j'ai en fait dessiné une petite illustration de flux de travail dans mes notes :

Sortie IA → Pool de vérification → Évaluation de consensus → Résultat vérifié

En termes simples, Mira applique une idée de consensus semblable à celle de la blockchain à l'information plutôt qu'aux transactions.

Pourquoi ce design résout un vrai problème

La raison pour laquelle cela importe devient plus claire lorsque vous pensez à la façon dont l'IA est intégrée dans des systèmes décentralisés.

Considérez les agents de trading autonomes dans DeFi. Ces agents analysent les conditions du marché et exécutent des stratégies automatiquement. Si leur analyse est défectueuse, le système pourrait effectuer des trades incorrects.

Ou imaginez des assistants de gouvernance résumant des propositions pour les détenteurs de jetons. Un résumé trompeur pourrait influencer le comportement de vote.

Sans vérification, les systèmes décentralisés font essentiellement confiance au raisonnement d'un seul modèle d'IA.

Mira introduit la redondance.

Plusieurs participants indépendants examinent la sortie avant qu'elle ne devienne des données fiables. Cela réduit le risque qu'une sortie de modèle incorrecte influence un système entier.

C'est similaire à la façon dont les blockchains dépendent de nombreux validateurs plutôt que de faire confiance à un seul nœud.

Une nouvelle sorte de couche d'incitation

Un autre détail intéressant est la structure économique derrière le réseau.

Les vérificateurs ne sont pas simplement des bénévoles vérifiant les résultats de l'IA. Ce sont des participants incités qui gagnent des récompenses pour évaluer avec précision les résultats.

Cela signifie que la vérification elle-même devient un service au sein de l'écosystème.

Certains participants de CreatorPad ont même décrit Mira comme construisant une économie de vérification où la validation de l'information générée par machine devient un marché.

Cette idée semble étrangement similaire aux premiers réseaux de blockchain.

À l'époque, les gens se demandaient si quelqu'un participerait réellement à la validation des transactions. Aujourd'hui, les validateurs sécurisent des écosystèmes financiers entiers.

Mira semble explorer si le même concept peut s'appliquer à l'information générée par l'IA.

Les compromis qui doivent encore être résolus

Bien sûr, le système soulève quelques questions compliquées.

La vérification semble simple jusqu'à ce que vous réalisiez que toutes les sorties de l'IA ne sont pas facilement mesurables. Certaines réponses sont factuelles, tandis que d'autres impliquent du raisonnement, de l'interprétation ou des prévisions.

Comment les vérificateurs jugent-ils constamment ces sorties ?

Un autre défi est la vitesse. Les systèmes d'IA fonctionnent rapidement, tandis que les couches de vérification introduisent des étapes supplémentaires. Si le processus devient trop lent, les applications en temps réel pourraient avoir du mal.

Il y a aussi le problème de coordination. Les vérificateurs ont besoin d'incitations qui encouragent l'analyse indépendante plutôt que de simplement copier les conclusions des autres.

Ces défis de conception détermineront probablement si le modèle de Mira fonctionne en pratique.

Pourquoi les discussions de CreatorPad autour de Mira semblent différentes

Après avoir passé quelques heures à lire les publications de la campagne CreatorPad sur le projet, j'ai remarqué quelque chose d'intéressant.

La plupart des discussions sur la crypto se concentrent sur des récits et des spéculations. Les conversations sur Mira ont tendance à se concentrer davantage sur la conception du système.

Les gens posent des questions comme :

• Les réseaux décentralisés peuvent-ils vérifier le raisonnement de l'IA ?

• Des marchés de validation émergeront-ils autour des données générées par machine ?

• Les couches de vérification pourraient-elles devenir une infrastructure standard pour les agents d'IA ?

Ce sont des questions plus profondes que les discussions typiques de campagne.

Pourquoi la couche de vérification pourrait être importante à long terme

Plus j'y pense, plus l'idée de Mira semble combler un vide structurel dans les systèmes d'IA.

Les modèles d'IA deviennent incroyablement bons pour générer des informations. Mais la génération seule n'est pas suffisante.

Les systèmes décentralisés ont besoin d'un moyen de confirmer que l'information est fiable.

Les blockchains ont résolu la confiance pour les transactions financières grâce à un consensus distribué. Mira semble explorer un concept similaire pour la connaissance générée par machine.

Que le protocole réussisse ou non, le problème qu'il aborde semble très réel.

Si les agents d'IA deviennent courants dans Web3, les réseaux auront besoin de moyens pour vérifier leur raisonnement avant que ce raisonnement n'affecte les systèmes on-chain.

Et cette couche de vérification manquante pourrait s'avérer tout aussi importante que les modèles d'IA eux-mêmes.

$MIRA #Mira @Mira - Trust Layer of AI

$BTR $DEGO #creatorpad #LearnWithFatima #TradingCommunity #TrendingTopic.