En tant que personne qui passe beaucoup de temps à examiner les outils et l'infrastructure de l'IA, un problème revient sans cesse - les modèles d'IA sont puissants, mais ils ne sont pas toujours fiables. Quiconque a construit avec de grands modèles de langage sait que des hallucinations et des sorties incorrectes peuvent encore se produire.

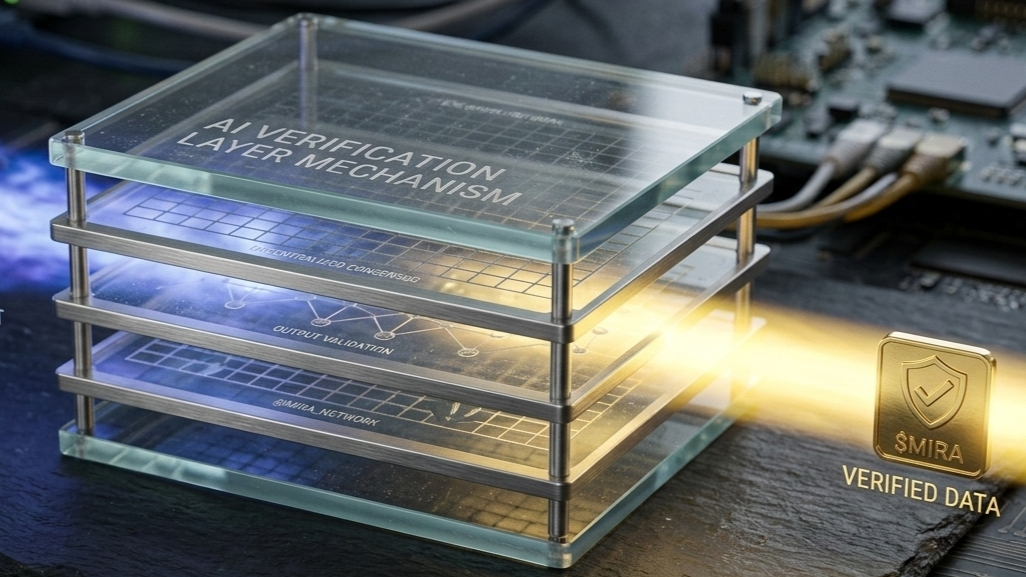

C'est pourquoi l'approche adoptée par @Mira - Trust Layer of AI a attiré mon attention. Au lieu de simplement se concentrer sur des modèles plus rapides ou des ensembles de données plus volumineux, le projet travaille sur une couche de vérification pour les sorties de l'IA. L'idée est assez simple : plutôt que de faire aveuglément confiance à ce qu'un modèle d'IA produit, le réseau peut valider les réponses en utilisant des mécanismes de vérification décentralisés.

D'un point de vue développeur, cela pourrait être extrêmement utile. À mesure que de plus en plus d'applications commencent à utiliser des agents IA, des systèmes d'automatisation et des services on-chain, avoir un moyen de vérifier cryptographiquement les résultats pourrait réduire le risque et améliorer la confiance dans les processus automatisés.

Cela ouvre également la porte à des systèmes d'IA qui interagissent directement avec les environnements blockchain. Si les résultats peuvent être vérifiés par un réseau, les développeurs peuvent créer des applications pilotées par l'IA plus fiables sans dépendre d'un seul fournisseur de confiance.

C'est pourquoi je garde un œil attentif sur $MIRA. Si l'écosystème autour de @Mira - Trust Layer of AI continue de se développer, le projet pourrait devenir une pièce importante de l'infrastructure émergente AI+crypto.

Curieux de voir comment les builders commencent à expérimenter avec cela au cours des prochains mois.