Je suis l’espace IA depuis un certain temps maintenant et une chose revient toujours à mon esprit. Les modèles deviennent de plus en plus intelligents chaque mois. Plus rapides, plus fluides, de meilleures réponses. Mais le vrai problème n’est plus l’intelligence. C’est la confiance.

C’est la partie dont les gens ne parlent pas assez.

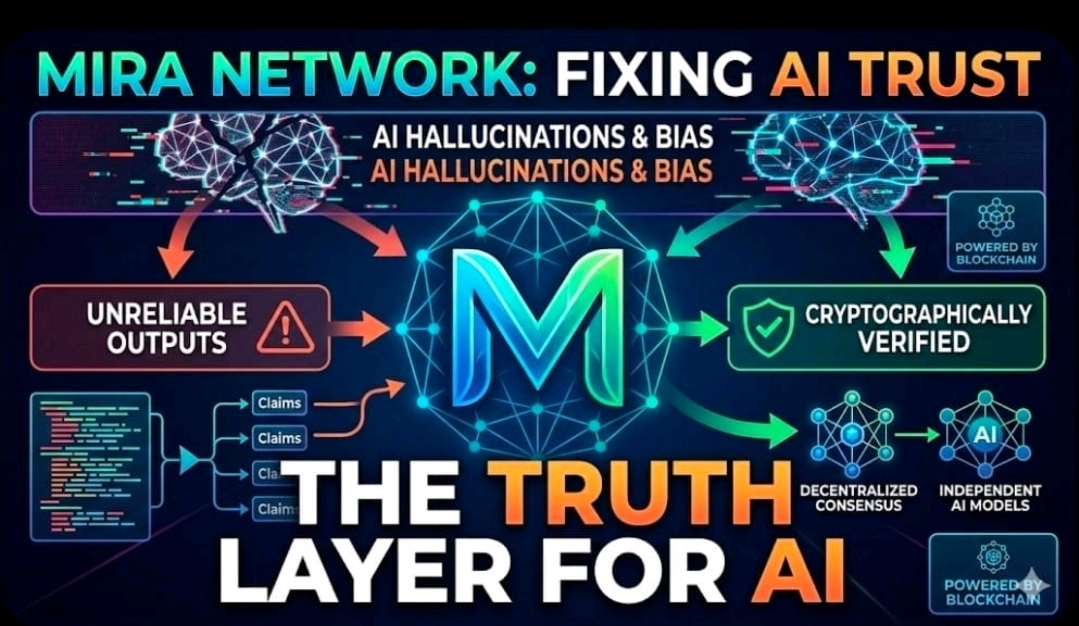

Quand je regarde @Mira - Trust Layer of AI , je ne vois pas vraiment un autre projet IA essayant de rendre les modèles plus impressionnants. Ce que je vois, c'est une tentative de résoudre un problème plus profond. Le problème de savoir si une réponse IA est réellement correcte.

Les systèmes d'IA aujourd'hui fonctionnent principalement sur la probabilité. Ils prédisent la réponse la plus probable basée sur des schémas. Et honnêtement, ils peuvent sembler extrêmement convaincants. Des phrases propres. Des explications structurées. Un ton très confiant.

Mais être confiant ne signifie pas toujours avoir raison.

Dans des domaines comme la finance, la conformité ou les données médicales... "presque correct" peut encore être un problème sérieux. J'ai vu cela dans la crypto aussi. De petites erreurs dans les données ou les hypothèses peuvent entraîner de grosses pertes.

Ce que je trouve intéressant dans l'approche de Mira, c'est comment elle traite les réponses de l'IA. Au lieu d'accepter une réponse comme définitive, le système la traite essentiellement comme un brouillon.

Quelque chose qui doit encore être vérifié.

La réponse est décomposée en revendications plus petites. Des pièces individuelles qui peuvent être examinées séparément. Cela semble déjà être une façon plus honnête de traiter les résultats de l'IA.

Ensuite, les validateurs interviennent.

Pas une seule entreprise centrale décidant de tout, mais des nœuds validateurs indépendants vérifiant ces revendications. Différents participants, différents systèmes. Presque comme une forme de scepticisme distribué.

Si suffisamment de validateurs sont d'accord, l'information devient plus forte.

Il y a aussi une couche blockchain impliquée, ce qui ajoute de la transparence. Les enregistrements de vérification, les journaux d'activité et les résultats de validation peuvent vivre sur un registre où les changements ne sont pas faciles à cacher. Les contrats intelligents gèrent automatiquement les incitations, le staking et les flux de validation.

Le côté jeton compte aussi.

Le jeton natif n'est pas seulement là pour le trading. Les participants le stakent lorsqu'ils participent à des processus de vérification ou de validation. Lorsque de l'argent est impliqué, les gens se comportent différemment. Une mauvaise validation devient coûteuse.

Ce type de pression économique aide le système à rester honnête.

Une autre chose que j'ai remarquée est la conception hybride. Une partie de la sécurité provient du travail informatique. Une partie provient du capital de staking. Cela mélange des idées de Proof of Work et de Proof of Stake.

Ce n'est peut-être pas un système parfait. Mais cela semble intentionnel.

Et si quelque chose comme ça fonctionne, les applications pourraient être assez larges. Analyse de la santé. Revues juridiques. Vérifications de conformité. Modélisation financière. Tous des domaines où l'exactitude compte réellement.

Pour moi, $MIRA n'est pas vraiment une question de construire des modèles d'IA plus intelligents.

Il s'agit davantage de construire des systèmes d'IA qui peuvent être vérifiés, contestés et audités.

Parce que l'intelligence seule peut augmenter rapidement le risque.

Mais l'intelligence vérifiée... c'est ce qui crée une véritable confiance.

Et honnêtement, la confiance est probablement ce dont l'écosystème IA a le plus besoin en ce moment.