Tout le monde est excité par l'intelligence artificielle. Les modèles deviennent plus rapides, plus intelligents et plus capables chaque mois. Mais il y a une question critique que la plupart des gens oublient de poser :

Comment savons-nous que la réponse de l'IA est réellement vraie ?

En ce moment, la plupart des systèmes d'IA fonctionnent comme des narrateurs extrêmement confiants. Ils génèrent des réponses instantanément, mais ces réponses peuvent contenir des hallucinations, des biais cachés ou des erreurs factuelles subtiles. Dans des conversations décontractées, cela peut ne pas beaucoup importer. Mais dans des domaines comme la finance, la recherche, la sécurité ou les systèmes de décision automatisés, une seule sortie incorrecte peut entraîner des conséquences massives.

Au lieu de traiter la sortie de l'IA comme la dernière étape, Mira la considère comme le début d'un processus de vérification. Voici la partie intéressante.

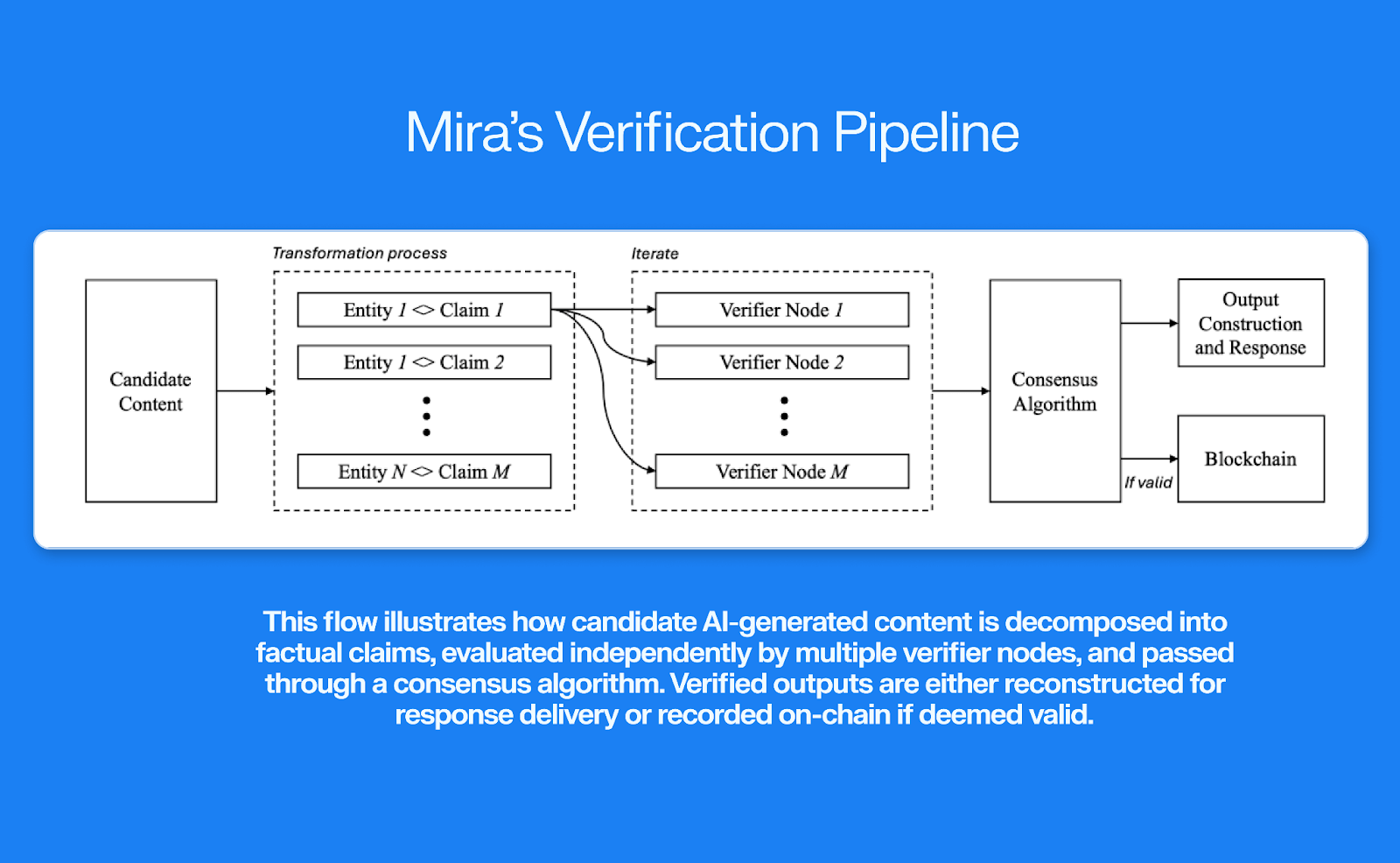

Lorsqu'une IA produit une réponse, Mira peut décomposer cette réponse en revendications vérifiables plus petites. Ces revendications sont ensuite distribuées à travers un réseau de vérification décentralisé. Plusieurs modèles et validateurs indépendants évaluent l'information, la remettent en question et confirment si elle est logique et factuelle.

Ce n'est qu'après avoir passé cette couche de vérification que le résultat acquiert une crédibilité plus forte.

Considérez cela comme un passage de l'IA d'une voix unique à un système de débat décentralisé.

Cette approche change quelque chose de fondamental dans le paysage de l'IA.

Aujourd'hui, la plupart des plateformes d'IA se concentrent sur l'agrandissement et l'accélération des modèles. Mira se concentre sur quelque chose de différent : rendre les résultats de l'IA dignes de confiance.

Et la confiance est le véritable goulot d'étranglement pour l'adoption de l'IA.

Sans vérification, l'IA reste un assistant utile. Avec vérification, l'IA peut commencer à alimenter des systèmes critiques où la précision est essentielle : analyse financière, recherche automatisée, agents intelligents et applications décentralisées.

C'est ici que $MIRA devient essentiel pour l'écosystème.

Le jeton peut aider à coordonner les incitations à travers le réseau. Les validateurs, les modèles et les participants ont besoin d'une motivation économique pour examiner, contester et vérifier honnêtement les résultats de l'IA. Dans un système décentralisé, les incitations sont ce qui transforme un cadre technique en un réseau vivant.

Ce qui me fascine à propos de #Mira , c'est qu'il n'essaie pas de rivaliser avec les modèles d'IA eux-mêmes.

Au lieu de cela, il construit quelque chose qui pourrait devenir encore plus important : l'infrastructure de confiance pour l'IA.

Si l'avenir est rempli d'agents autonomes, de recherches automatisées et de systèmes de décision pilotés par l'IA, alors la vérification deviendra tout aussi précieuse que l'intelligence elle-même.

Dans un monde où l'IA peut générer une information illimitée, le véritable pouvoir pourrait appartenir aux réseaux qui peuvent prouver quelle information est réellement correcte.

C'est la couche @Mira - Trust Layer of AI qui se construit tranquillement autour de $MIRA .