Au cours de l'année passée, tout en lisant sur différentes approches de l'infrastructure de l'IA, un schéma continue d'apparaître : les modèles s'améliorent, mais le problème de fiabilité n'a pas vraiment disparu.

Les grands systèmes d'IA peuvent produire des réponses impressionnantes, mais ils peuvent aussi générer des erreurs de manière confiante. Les hallucinations, les biais subtils et les revendications non vérifiables apparaissent encore même dans des modèles avancés. Cet écart entre confiance et exactitude devient l'un des enjeux centraux de l'écosystème de l'IA.

En explorant comment différentes équipes essaient de faire face à cela, je suis tombé sur la conception de Mira Network.

À un niveau basique, Mira n'essaie pas de construire un autre grand modèle. Au lieu de cela, le projet derrière le compte @Mira - Trust Layer of AI se concentre sur quelque chose de plus discret mais tout aussi important : la vérification.

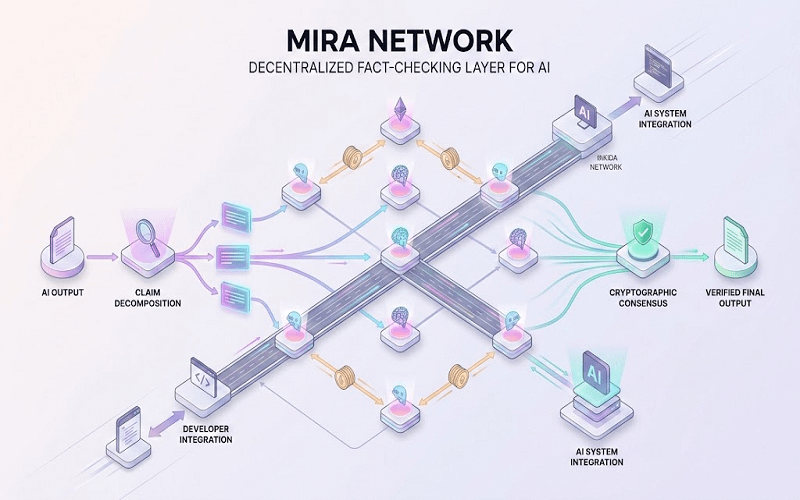

L'idée est de construire un système décentralisé qui vérifie si les résultats de l'IA peuvent réellement être fiables.

La partie intéressante est de savoir comment cette vérification se déroule.

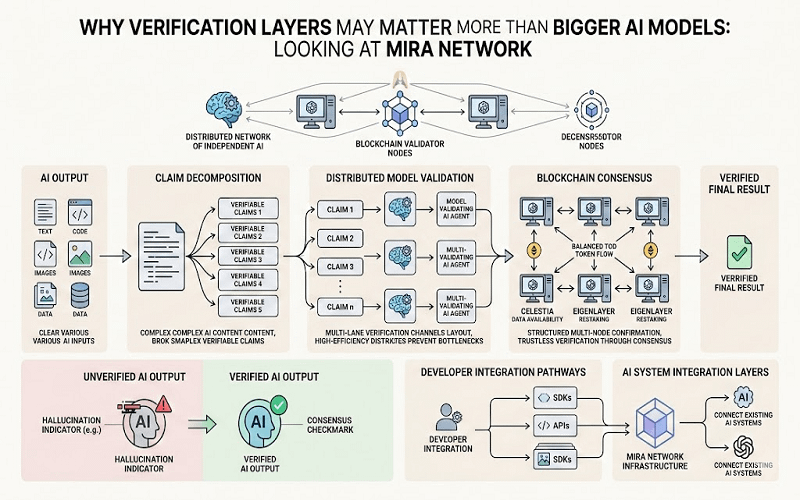

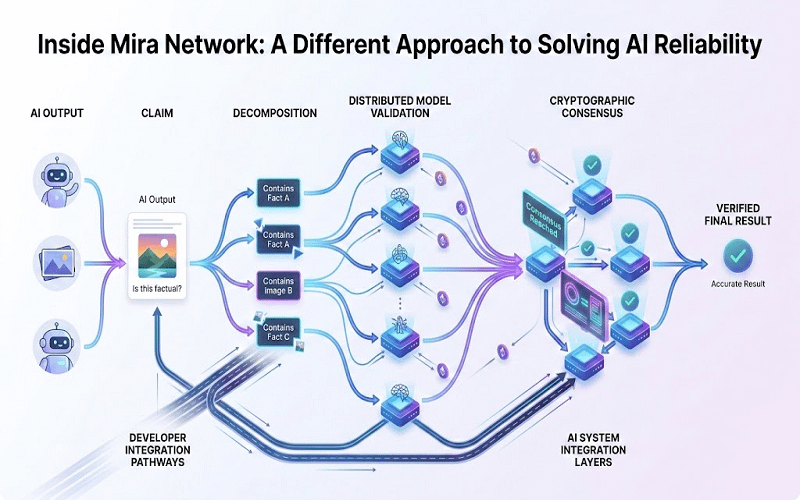

Au lieu de traiter une réponse d'IA comme une grande réponse, Mira divise la sortie en plus petites revendications factuelles. Chaque revendication peut ensuite être examinée individuellement. Ces éléments sont envoyés à travers un réseau de modèles d'IA indépendants qui tentent de valider si l'énoncé est exact, cohérent ou potentiellement incorrect.

Cela fonctionne un peu comme un système de vérification des faits distribué.

Si un modèle produit une réponse, d'autres modèles examinent les revendications derrière cette réponse. Leurs résultats sont ensuite agrégés par un processus de consensus enregistré sur la chaîne. La couche blockchain agit comme le registre neutre de l'accord, garantissant que le processus de vérification lui-même ne peut pas être facilement manipulé.

Cette structure est ce qui rend le système différent de la validation traditionnelle de l'IA.

La plupart des vérifications de fiabilité actuelles se déroulent au sein d'entreprises centralisées. Une seule organisation contrôle les modèles, le processus d'évaluation et le jugement final sur la correction. Cela fonctionne dans de nombreux cas, mais cela signifie aussi que les utilisateurs font finalement confiance à l'entreprise qui gère le système.

Mira aborde le problème différemment.

La vérification se produit entre des participants indépendants dans un réseau plutôt qu'à l'intérieur d'une seule plateforme. Différents modèles d'IA contribuent au processus de validation, et leurs conclusions sont combinées par des preuves cryptographiques et un consensus basé sur la blockchain.

La confiance passe d'une seule autorité à la structure du système lui-même.

En théorie, cela crée une couche de vérification qui se situe au-dessus des modèles d'IA plutôt que de les remplacer. Tout modèle pourrait générer une réponse, et Mira se concentrerait sur la vérification de la solidité de cette réponse sous un examen distribué.

C'est là que le jeton $MIRA entre en jeu.

Le réseau s'appuie sur des incitations économiques pour coordonner les participants. Les validateurs qui contribuent des ressources informatiques pour vérifier les revendications sont récompensés, tandis que la validation incorrecte ou malhonnête peut entraîner des pénalités. Le jeton devient un mécanisme qui aligne les incitations pour que les participants agissent honnêtement lors de l'évaluation des résultats de l'IA.

L'approche me rappelle un peu comment les blockchains vérifient les transactions financières.

Au lieu de faire confiance à un seul opérateur de registre, de nombreux nœuds vérifient indépendamment la même transaction. Si la plupart s'accordent sur le résultat, la transaction devient partie du registre partagé. Mira applique une idée similaire à l'information produite par les systèmes d'IA.

L'objectif n'est pas de créer une vérité parfaite.

C'est pour rendre plus difficile le passage de résultats incorrects sans examen.

Si ce type de couche de vérification fonctionne à grande échelle, cela pourrait avoir des implications pratiques pour les systèmes qui dépendent fortement des réponses de l'IA. Les outils de recherche, les assistants automatisés et les plateformes d'analyse alimentées par l'IA rencontrent tous la même question de fiabilité : jusqu'où pouvons-nous faire confiance à la sortie ?

Un réseau de validation décentralisé pourrait agir comme une seconde couche d'assurance avant que ces résultats ne soient utilisés dans des décisions réelles.

Néanmoins, il existe des défis pratiques.

La vérification elle-même nécessite des calculs. Faire fonctionner plusieurs modèles d'IA pour vérifier chaque revendication augmente le coût et la complexité par rapport à un seul modèle produisant une réponse. La coordination à travers un réseau de validateurs distribués introduit également une latence que les systèmes centralisés ne rencontrent pas.

Il y a ensuite le paysage concurrentiel plus large.

Plusieurs projets expérimentent avec une infrastructure d'IA décentralisée, chacun se concentrant sur différentes couches de la pile. Certains se concentrent sur les marchés de données, d'autres sur la formation distribuée ou les marchés de calcul. Mira, dans le cadre de la conversation plus large autour de #Mira et #MiraNetwork , se taille une place dans la couche de vérification au sein de cet écosystème.

Que cette couche devienne essentielle ou optionnelle reste une question ouverte.

Ce qui rend le concept intéressant, c'est qu'il aborde une faiblesse structurelle dans les systèmes d'IA modernes plutôt que d'essayer de rivaliser sur la taille ou la vitesse brute du modèle.

Des modèles plus grands peuvent améliorer la précision au fil du temps, mais la vérification peut rester nécessaire.

Et c'est là que Mira semble se positionner : non pas comme le système qui génère des réponses, mais comme le réseau qui les vérifie discrètement avant que quiconque ne s'y fie.