La conversation autour de l'intelligence a changé discrètement au cours de l'année écoulée. Pendant un certain temps, l'industrie s'est concentrée sur la construction de modèles individuels plus grands et plus intelligents. Chaque nouveau système tentait de surpasser le précédent. Ils utilisaient des ensembles de données, plus de calcul et plus de paramètres. Quelque chose est devenu clair pour de nombreux chercheurs et développeurs. Même les modèles avancés font encore des erreurs. Parfois elles sont petites, parfois elles sont étonnamment grandes. Le problème n'est pas l'intelligence. C'est la fiabilité.

C'est le fossé que des projets comme m-70 essaient de combler. Au lieu de s'appuyer sur un seul modèle puissant, Mira explore un chemin différent. Un chemin où l'intelligence est vérifiée à travers des réseaux de modèles plutôt que de faire confiance aveuglément. C'est le projet Mira. Mira travaille sur une manière de construire des systèmes d'IA.

Aller au-delà de l'intelligence à modèle unique

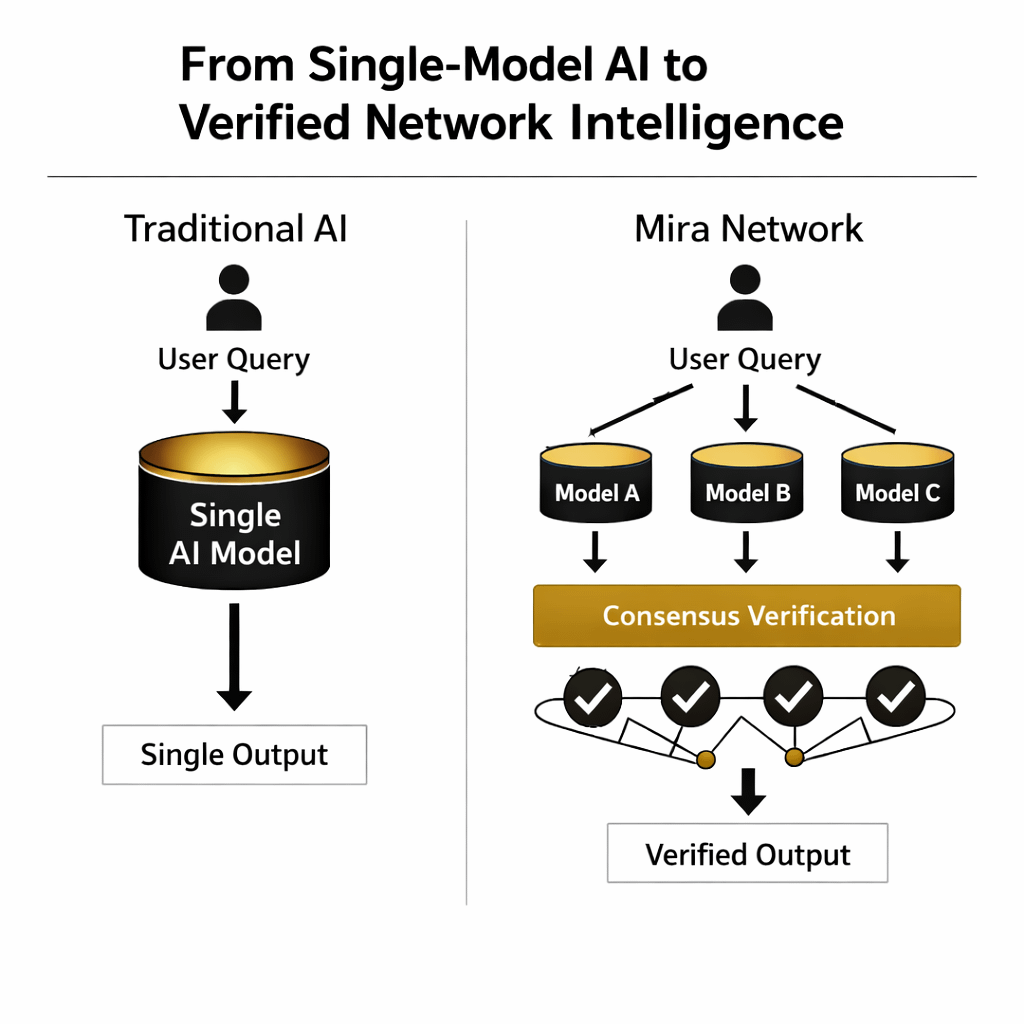

La plupart des systèmes d'IA modernes suivent un modèle. Un seul modèle génère une réponse et les utilisateurs l'acceptent ou la vérifient manuellement. Cette approche fonctionne pour les tâches. Lorsque les décisions deviennent plus importantes, comme les insights médicaux, l'analyse financière ou la recherche complexe, s'appuyer sur un seul modèle devient risqué. Les systèmes d'IA peuvent inventer des faits. Produire des réponses confiantes mais incorrectes.

L'approche de Mira traite ce problème comme un enjeu. Si l'intelligence est probabilistique, la vérification devrait également faire partie du système. Au lieu de demander à un modèle une réponse, le réseau répartit la tâche entre plusieurs modèles. Chaque modèle produit sa propre interprétation. Les résultats sont ensuite comparés, vérifiés et enregistrés par le biais d'un processus de consensus. En termes, cela fonctionne davantage comme une discussion de groupe que comme l'opinion d'un seul expert. C'est ainsi que fonctionne le réseau de Mira.

L'idée d'intelligence vérifiée

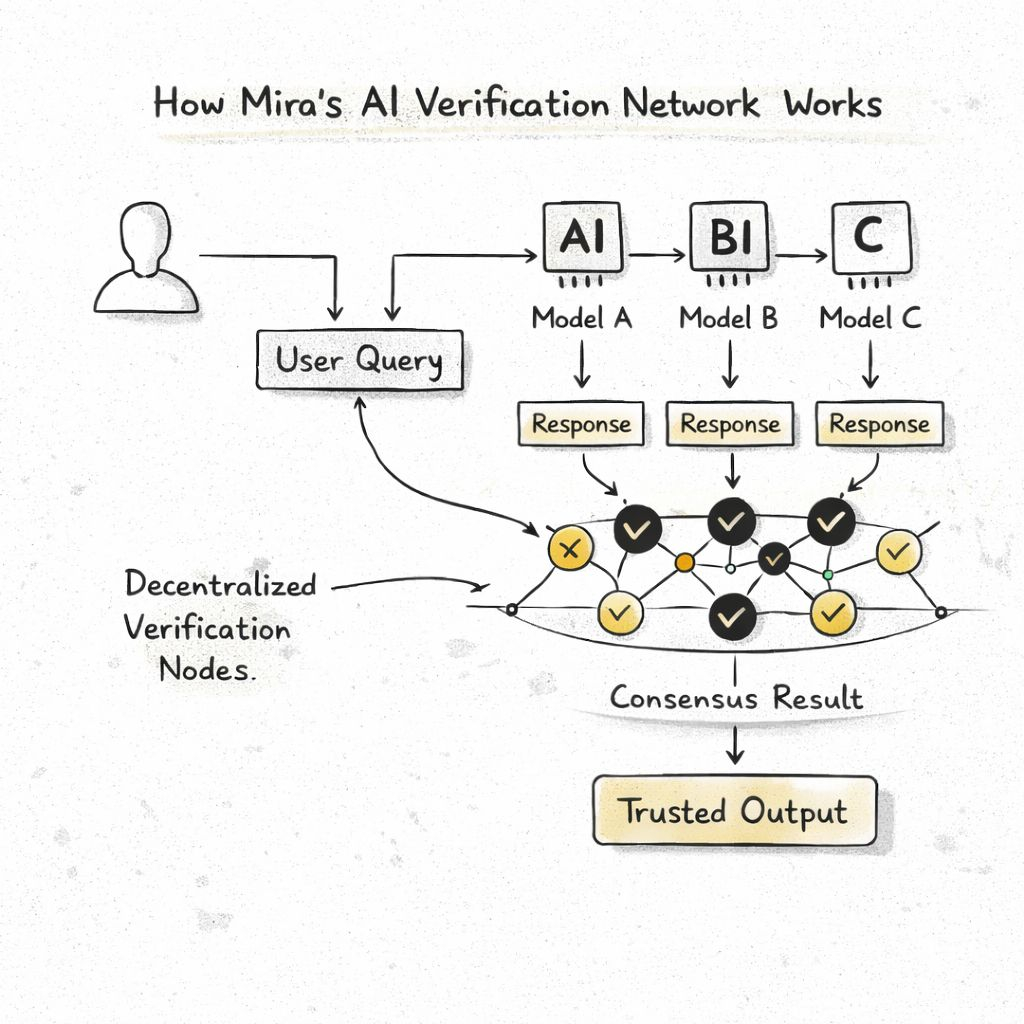

Au cœur de la conception de Mira. Plutôt que de faire confiance par défaut à une sortie d'IA, le système décompose cette sortie en revendications plus petites qui peuvent être validées à travers un réseau de modèles. Si plusieurs modèles indépendants s'accordent sur le résultat, la confiance augmente. S'ils ne sont pas d'accord, le système peut signaler une incertitude ou déclencher des étapes de vérification.

Cette idée s'inspire de la philosophie qui a aidé les réseaux blockchain à fonctionner. Le consensus distribué remplace la confiance dans une autorité. Dans le cas de Mira, cette autorité serait autrement un modèle d'IA. Le réseau lui-même fonctionne comme une couche de vérification décentralisée. Les opérateurs de nœuds parient. Participent à la vérification des résultats, aidant à maintenir l'intégrité du système. Des incitations encouragent la vérification tandis que les activités incorrectes ou malveillantes peuvent être pénalisées. L'objectif n'est pas de construire le modèle en isolement. C'est de créer un système où l'intelligence peut être digne de confiance parce qu'elle est collectivement vérifiée.

Traction dans le monde réel et croissance précoce de l'écosystème

C'est ce que Mira essaie d'accomplir. Mira a déjà commencé à tester son approche à grande échelle. À partir de 2025, le réseau a rapporté plus de 2,5 millions d'utilisateurs et traite environ deux milliards de jetons d'IA par jour à travers ses applications écosystémiques. Ces jetons représentent des morceaux d'informations générées par l'IA circulant dans le réseau de vérification.

Plusieurs applications construites sur le système explorent des aspects de ce modèle. Une application intègre de grands modèles de langage dans une interface unifiée. Un autre agent se concentre sur la vérification des informations dans les bases de connaissances publiques en comparant les affirmations avec des sources. Ces premières expériences illustrent comment l'intelligence vérifiée pourrait fonctionner en pratique. En remplaçant les modèles existants, le réseau agit comme une couche au-dessus d'eux. Pensez-y comme un système d'arbitre pour l'IA.

Pourquoi l'intelligence collective pourrait avoir plus d'importance avec le temps

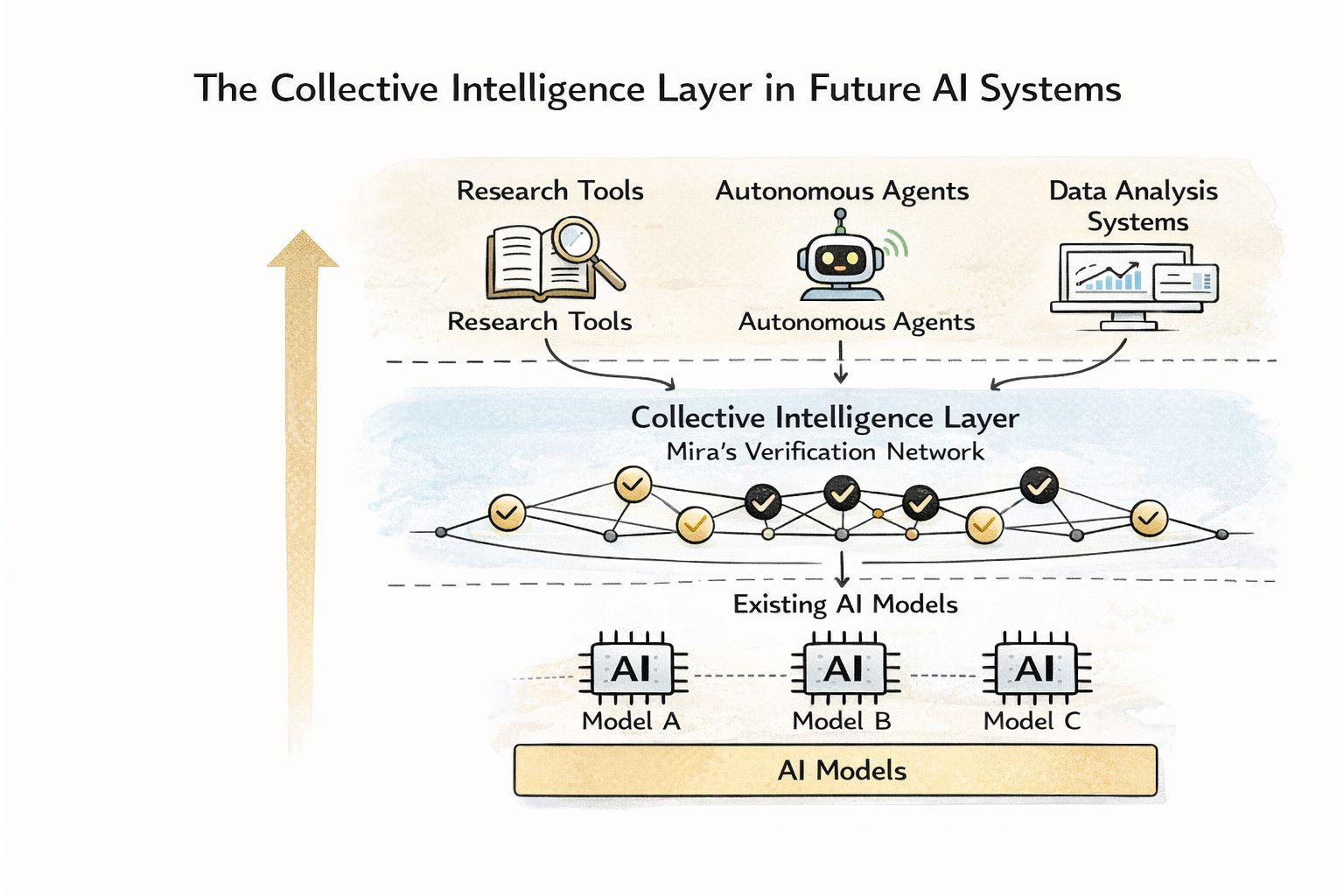

Il y a une raison pour laquelle cette approche attire l'attention. Les systèmes d'IA deviennent plus puissants. Ils deviennent également plus difficiles à évaluer. À mesure que les modèles deviennent plus complexes, il devient difficile pour les humains de vérifier tout ce qu'ils produisent. Cela crée un paradoxe. Plus l'IA devient intelligente, plus elle nécessite une supervision humaine. La conception de Mira tente de supprimer ce goulot d'étranglement. En transformant la vérification en un processus distribué, les systèmes d'IA pourraient éventuellement vérifier automatiquement les résultats des autres.

Cela ouvre la porte à des systèmes autonomes – des agents capables d'effectuer des tâches sans supervision humaine constante. Bien sûr, le succès de tels systèmes dépend de la performance du réseau de vérification en pratique.

Les risques et les questions ouvertes

Malgré sa promesse, l'idée de l'intelligence vérifiée par un réseau porte encore des incertitudes. Un défi est la coordination. Les réseaux distribués ont souvent du mal avec la latence et l'efficacité. Vérifier les résultats de l'IA à travers des nœuds peut introduire des délais, en particulier pour des tâches complexes.

Il y a aussi la question des incitations. Les réseaux de vérification s'appuient sur des récompenses pour encourager une participation honnête. Concevoir ces incitations avec soin est essentiel. Si elles sont mal structurées, des acteurs malveillants pourraient tenter de manipuler les résultats de vérification. Un autre risque réside dans la diversité des modèles. Si de nombreux nœuds de vérification s'appuient sur des modèles d'IA similaires, le consensus pourrait simplement renforcer les mêmes erreurs plutôt que de les détecter.

L'évolutivité est une autre question. Traiter des milliards de jetons par jour est impressionnant. L'infrastructure mondiale de l'IA nécessiterait une capacité beaucoup plus grande si les systèmes autonomes devenaient répandus. Enfin, l'environnement réglementaire plus large autour de l'IA et des réseaux est encore en évolution. Tout système qui influence la prise de décision automatisée pourrait finalement faire face à une surveillance de la part des gouvernements et des institutions.

Un changement silencieux dans la manière dont l'intelligence est construite

En regardant vers l'avenir, la partie intéressante de la vision de Mira n'est pas la technologie elle-même. C'est le changement qui la sous-tend. Pendant des décennies, le progrès en intelligence a été mesuré par la puissance d'un modèle unique. Plus le modèle est grand, mieux c'est pour le système. Des projets comme Mira suggèrent une autre direction. Plutôt que de poursuivre une seule source de vérité, l'intelligence pourrait émerger de réseaux de modèles qui se questionnent, vérifient et affinent les résultats des autres. Une sorte de couche de raisonnement.

De certaines manières, cette approche semble familière. Les humains ont compté sur la connaissance pendant des siècles. La science fonctionne par le biais de l'examen par les pairs. Le journalisme par le biais de la surveillance. Les décisions quotidiennes bénéficient souvent de multiples perspectives. Mira explore essentiellement si les systèmes d'IA peuvent adopter ce principe. Si l'idée fonctionne, l'avenir de l'IA pourrait ne pas appartenir au modèle, dans la pièce. Il pourrait appartenir au système qui sait comment vérifier l'intelligence.