Un problème silencieux avec les systèmes d'IA modernes n'est pas qu'ils manquent de connaissances. C'est qu'ils parlent parfois avec certitude de choses qui ne sont que partiellement vraies.

Un modèle peut écrire une explication détaillée, citer des sources et structurer sa réponse de manière soignée. Pourtant, une petite affirmation dans la réponse pourrait être fausse. Et à moins que quelqu'un ne le vérifie attentivement, l'erreur voyage simplement avec le reste du texte.

Cette faiblesse devient plus visible à mesure que les outils d'IA pénètrent dans la recherche, le codage et le soutien à la décision.

Donc, la question se pose naturellement : qui vérifie les réponses ?

La plupart des systèmes aujourd'hui s'appuient sur des solutions centralisées. Une seule organisation construit le modèle, contrôle les mises à jour et décide comment les erreurs sont traitées. Même lorsque des examens externes existent, la couche de vérification reste à l'intérieur d'une seule institution.

Cette structure fonctionne jusqu'à un certain point. Mais elle concentre aussi la confiance.

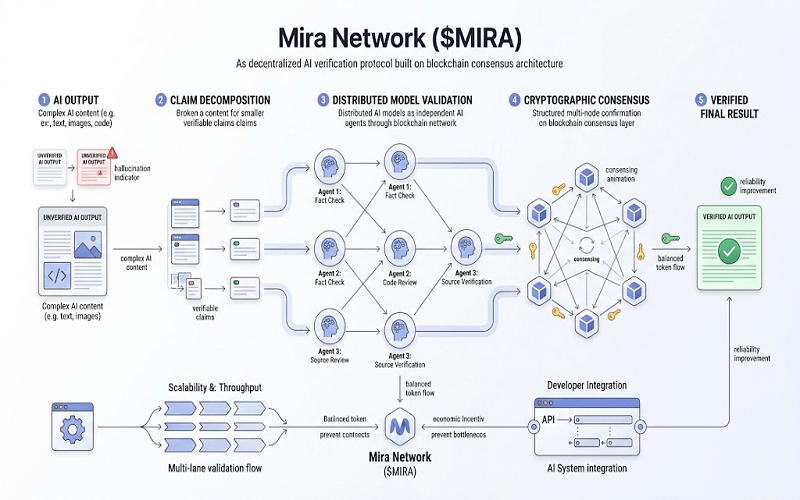

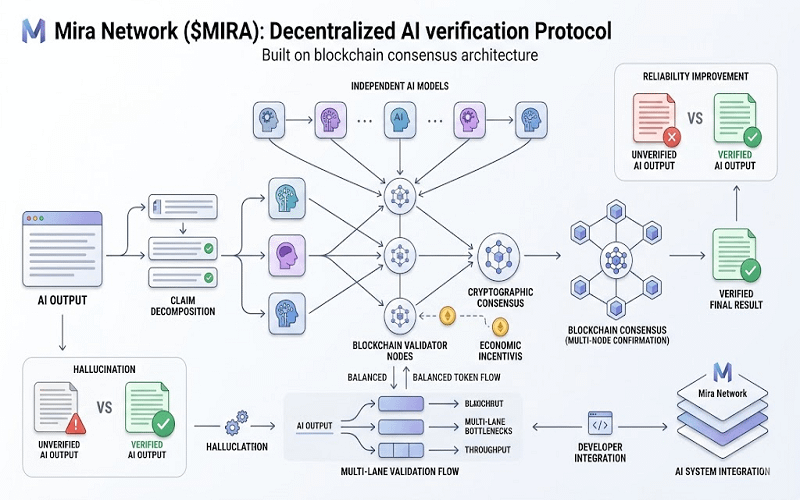

En lisant à propos de @Mira - Trust Layer of AI , j'ai trouvé leur approche intéressante car elle commence d'une hypothèse différente. Au lieu de demander à une IA de se vérifier elle-même, le protocole traite la vérification comme un processus de réseau.

L'idée est assez simple.

Une réponse d'IA peut être décomposée en déclarations plus petites. Chaque déclaration est essentiellement une affirmation. Quelque chose comme une date, une statistique ou une explication causale.

Ces affirmations peuvent alors être évaluées séparément.

Différents modèles d'IA indépendants examinent les éléments et soumettent leurs jugements. Certains confirment l'affirmation. D'autres peuvent signaler incertitude ou désaccord. Au fil du temps, ces réponses forment un schéma.

C'est ici que la couche blockchain entre en jeu.

Plutôt que de garder le processus de validation à l'intérieur des serveurs d'une seule entreprise, les résultats sont enregistrés par consensus décentralisé. La vérification cryptographique aide à garantir que les contrôles ont été effectués et enregistrés de manière transparente.

En termes pratiques, le système commence à ressembler à une couche de vérification des faits distribuée pour les résultats d'IA.

Pas un seul arbitre.

Plus comme un panel d'examinateurs qui n'appartiennent pas à la même institution.

Le jeton $MIRA joue un rôle dans la coordination de ce processus. Les participants qui exécutent des modèles de vérification peuvent être récompensés pour avoir contribué à des contrôles précis. Le design économique essaie d'encourager une validation honnête plutôt qu'une participation passive.

C'est une tentative intéressante d'aligner les incitations autour de l'exactitude plutôt que de la rapidité.

Bien sûr, l'idée soulève des questions pratiques.

Exécuter plusieurs modèles pour vérifier chaque affirmation peut devenir coûteux en ressources informatiques. Coordonner des validateurs indépendants n'est pas trivial non plus. Et l'espace d'infrastructure d'IA décentralisée devient encombré, avec plusieurs projets explorant des idées similaires sur la confiance et la vérification.

Il y a aussi le simple fait que l'écosystème est encore jeune.

Les protocoles comme #Mira et #MiraNetwork sont des expériences autant qu'ils sont une infrastructure. Le véritable test sera de savoir si ces systèmes peuvent fonctionner efficacement lorsque les demandes de vérification augmentent.

Pourtant, le concept lui-même semble valoir la peine d'être exploré.

À mesure que les systèmes d'IA produisent davantage d'informations que les gens lisent et sur lesquelles ils s'appuient, la fiabilité de ces résultats devient une préoccupation partagée. Un réseau conçu pour vérifier les affirmations collectivement est une façon possible d'aborder ce problème.

Et parfois, la partie la plus intéressante n'est pas la technologie elle-même, mais le changement silencieux de pensée qui la sous-tend.