Ce qui attire mon attention dans Pixels, ce n'est pas la confiance.

C'est la partie où ils l'appellent confiance tout en l'utilisant comme une porte.

Réputation. Score de confiance. Noms propres. Langage doux. Cela ressemble à vous gagner quelque chose de social — crédibilité, statut dans la communauté, un signal que vous êtes un "bon joueur."

Ensuite, vous suivez là où cela compte réellement.

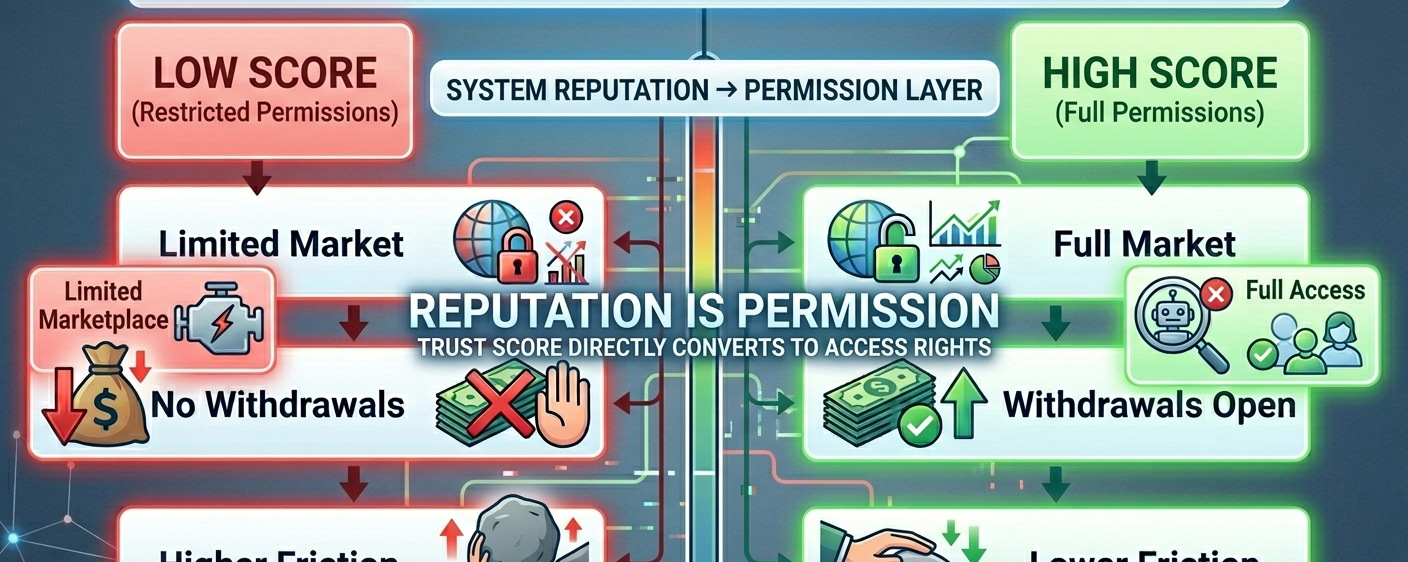

L'accès au commerce en dépend.

Les retraits sont derrière cela.

La participation au marché évolue avec cela.

La création de guilde se débloque grâce à cela.

Même le traitement des frais varie en fonction de l'endroit où vous vous trouvez.

Ce n'est pas juste un badge.

C'est l'infrastructure.

Et cela ne se comporte pas comme quelque chose de passif. Cela se trouve au milieu de l'économie, façonnant discrètement qui peut se déplacer librement et qui ne le peut pas.

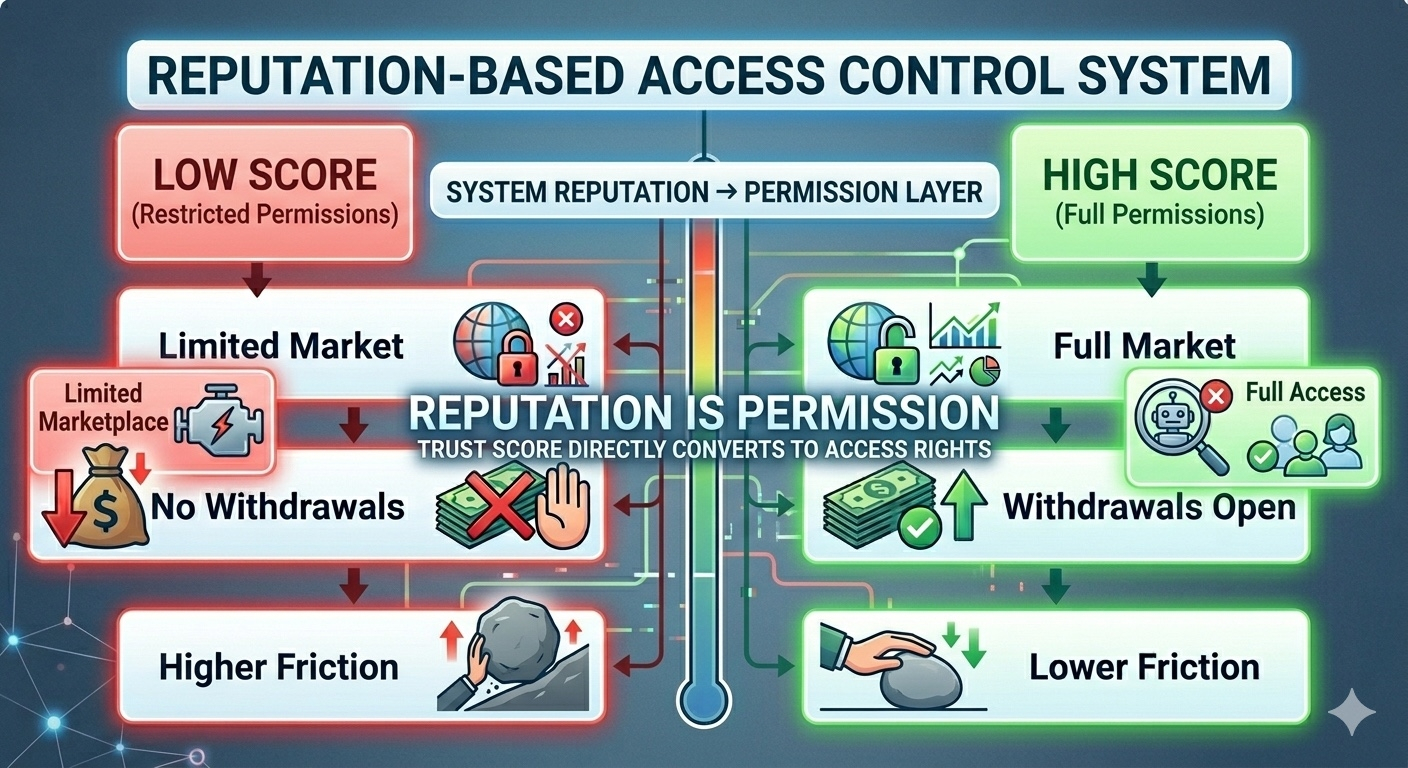

Vous commencez à le remarquer dans le jeu réel.

Un joueur reste à l'intérieur de la boucle — effectuant des tâches, construisant un score, se rapprochant d'un accès complet. Le système s'ouvre progressivement. Le commerce devient plus facile. Les retraits se débloquent. Le mouvement semble plus fluide.

Un autre joueur fait toujours la même agriculture, la même collecte, la même boucle de base — mais continue de rencontrer des murs.

L'accès au marché est partiel.

Les retraits sont verrouillés.

Le progrès semble plus lent, non pas à cause de l'effort, mais à cause de la permission.

Même monde.

Droits différents.

Vous pouvez appeler cela la confiance si vous le souhaitez.

Cela ne ressemble pas à de la confiance.

Parce que la confiance, dans la plupart des systèmes, reflète le comportement.

Cela ressemble à quelque chose qui gère activement l'accès.

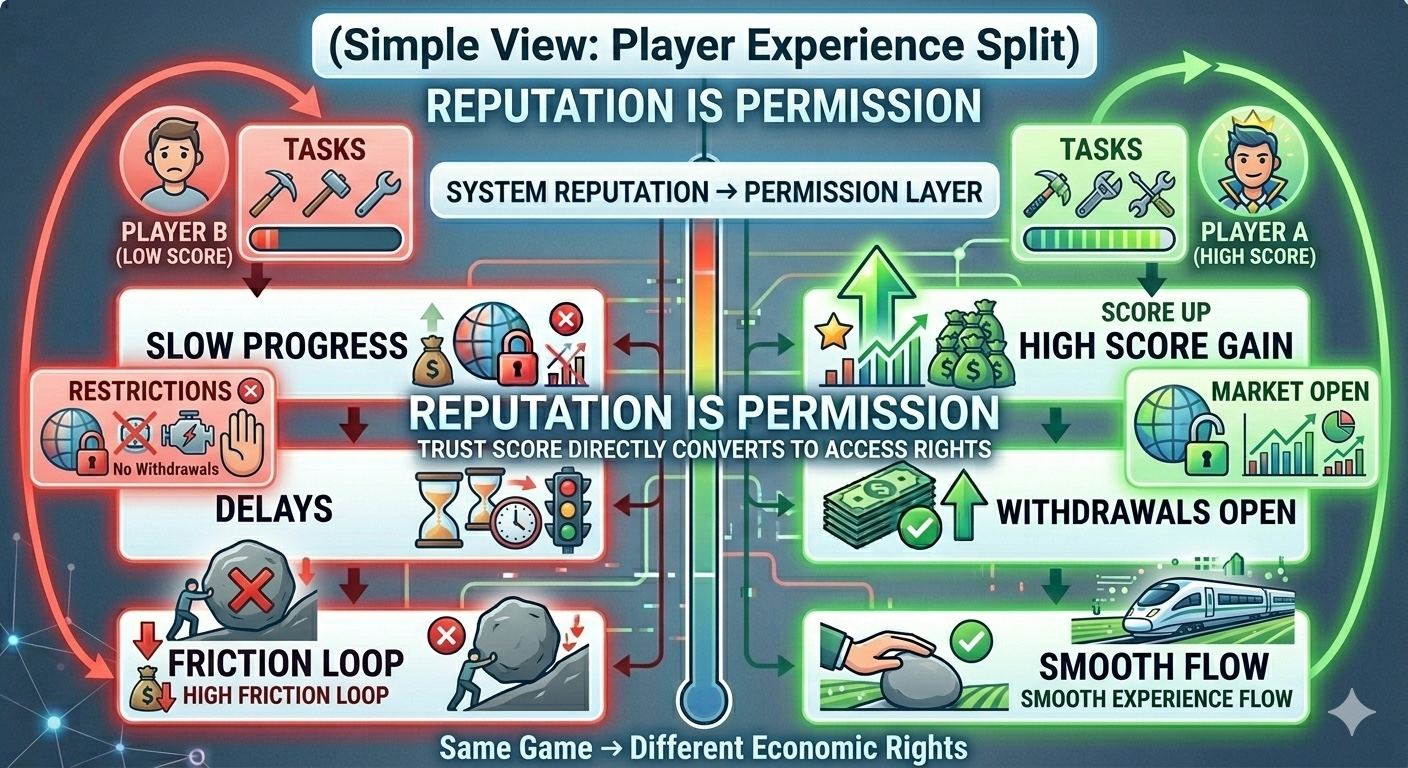

Et il ne s'agit pas seulement d'arrêter les bots.

Si c'était seulement cela, la conception serait plus simple. Détecter les abus, les bloquer, et passer à autre chose.

Mais ici, le score fait plus.

Cela signale un « bon comportement ».

Cela filtre l'agriculture automatisée.

Cela contrôle combien de valeur peut circuler dans le système.

C'est trois emplois différents.

Quand un système commence à faire trois travaux à la fois, quelque chose de subtil se produit.

Cela cesse d'être transparent.

Un joueur pense qu'il construit une réputation.

Le système décide combien d'accès autoriser.

Cette différence compte.

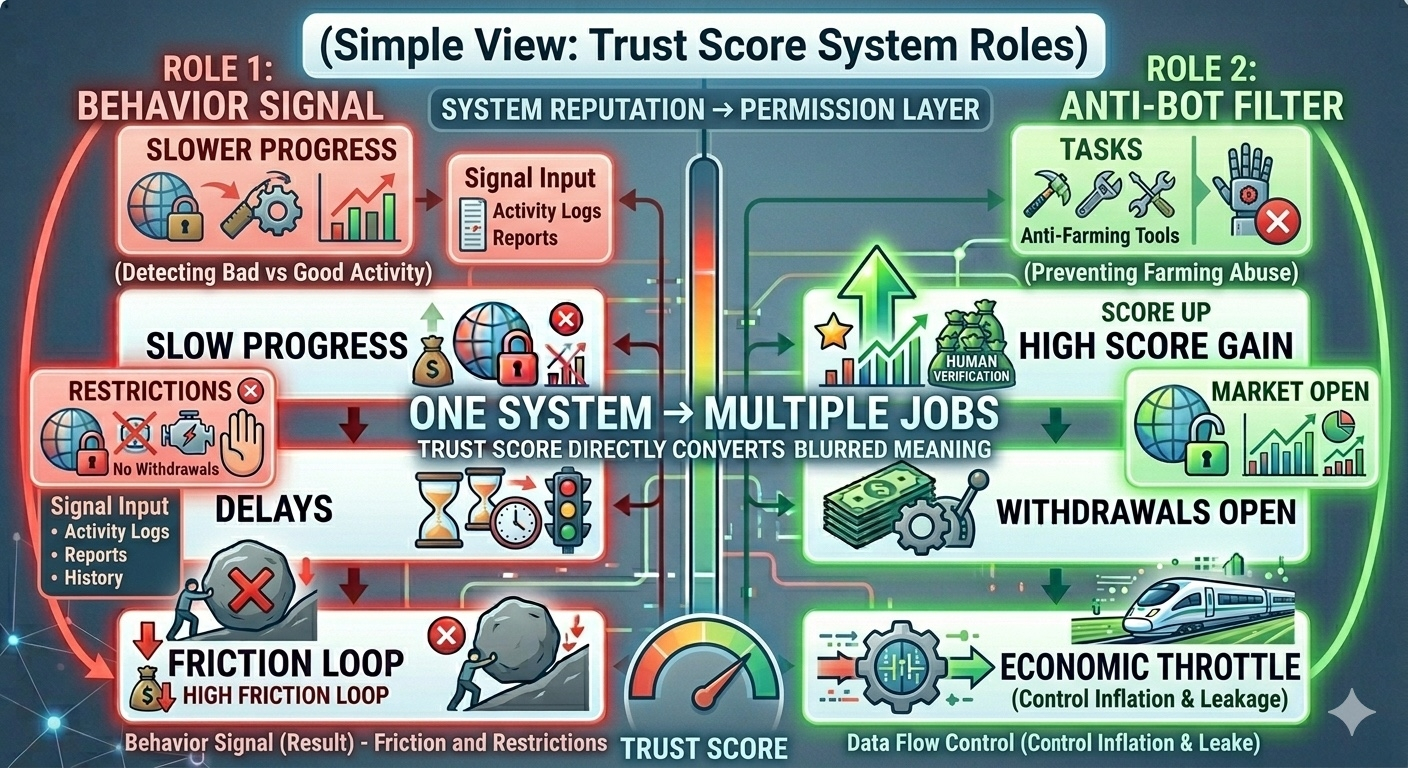

Parce qu'à présent, le score ne mesure pas seulement l'activité. Il réagit à la pression à l'intérieur de l'économie.

Si l'agriculture devient trop efficace, le système doit ralentir les choses.

Si la valeur commence à fuir trop facilement, le système a besoin d'un contrôle plus strict.

Et le moyen le plus simple d'appliquer ce contrôle est la même couche déjà liée à l'accès :

Le Trust Score.

C'est là que cela passe de « design social » à quelque chose d'autre.

Cela commence à agir comme un contrôle des frontières économiques.

Pas de manière évidente. Rien d'agressif. Pas d'arrêts brusques qui ressemblent à une punition.

Juste un façonnement graduel.

Plus de friction ici.

Plus d'exigences là.

Plus d'efforts nécessaires avant que l'accès ne s'ouvre.

Du côté du joueur, cela ressemble toujours à une progression.

Du côté du système, c'est la régulation.

La partie intéressante est à quel point cela semble propre en surface.

On ne vous dit pas que vous êtes restreint.

On vous dit de continuer à jouer. Continuez à construire. Continuez à améliorer votre score.

Et c'est là que le cadrage fait la majeure partie du travail.

Parce que « confiance » suggère quelque chose gagné socialement.

Mais ce qui est réellement distribué, c'est la permission.

Permission d'échanger.

Permission de retirer.

Permission d'opérer avec moins de contraintes.

Ce n'est pas juste une réputation.

C'est un contrôle d'accès enveloppé dans un langage plus doux.

Et il est logique qu'il existe.

Les systèmes de récompense ouverts dans les jeux Web3 ne tiennent pas bien sous pression. Les joueurs optimisent rapidement. L'extraction s'échelle. Les économies s'épuisent.

Ainsi, des systèmes comme celui-ci apparaissent.

Couches qui ralentissent les choses.

Filtres qui séparent les utilisateurs.

Mécanismes qui décident de la vitesse à laquelle la valeur peut circuler.

D'un point de vue de conception, c'est rationnel.

Probablement nécessaire.

Mais cela change la façon dont le système se sent une fois que vous le voyez clairement.

Parce qu'à présent, vous ne jouez pas seulement à un jeu.

Vous traversez un ensemble de permissions.

Vous ne construisez pas seulement une réputation.

Vous débloquez des droits économiques.

Et ces droits ne sont pas fixes — ils peuvent changer en fonction de la façon dont le système doit se comporter.

C'est la question inconfortable qui se cache en dessous.

Quand l'économie devient tendue, que mesure réellement le Trust Score ?

Participation réelle ?

Comportement cohérent ?

Ou à quel point le système doit-il garder la porte fermée à ce moment-là ?

Parce que si le même score est responsable de signaler le comportement, de filtrer les abus et de contrôler le flux de valeur…

Alors au moins l'un de ces rôles va influencer les autres.

Et le joueur ne saura pas toujours lequel.

Pixels ($PIXEL) l'appelle confiance.

Et peut-être qu'une partie de cela l'est.

Mais une fois que ce score décide qui peut se déplacer librement et qui reste restreint, cela cesse d'être purement social.

Cela commence à ressembler à une porte.

Et plus l'économie devient importante, plus cette porte commence à compter.