Il y a eu un moment où je naviguais à travers quelques actions on-chain pendant une période d'activité nettement plus élevée, et tout semblait normal en surface, mais le timing semblait légèrement décalé. Rien n'a échoué, rien n'est resté bloqué, mais la confirmation d'une simple action a pris plus de temps que prévu. Je me souviens d'avoir juste attendu sans rien faire d'autre, non pas parce que j'étais inquiet, mais parce que j'essayais de comprendre si le retard signifiait quelque chose ou si c'était juste une surcharge du système.

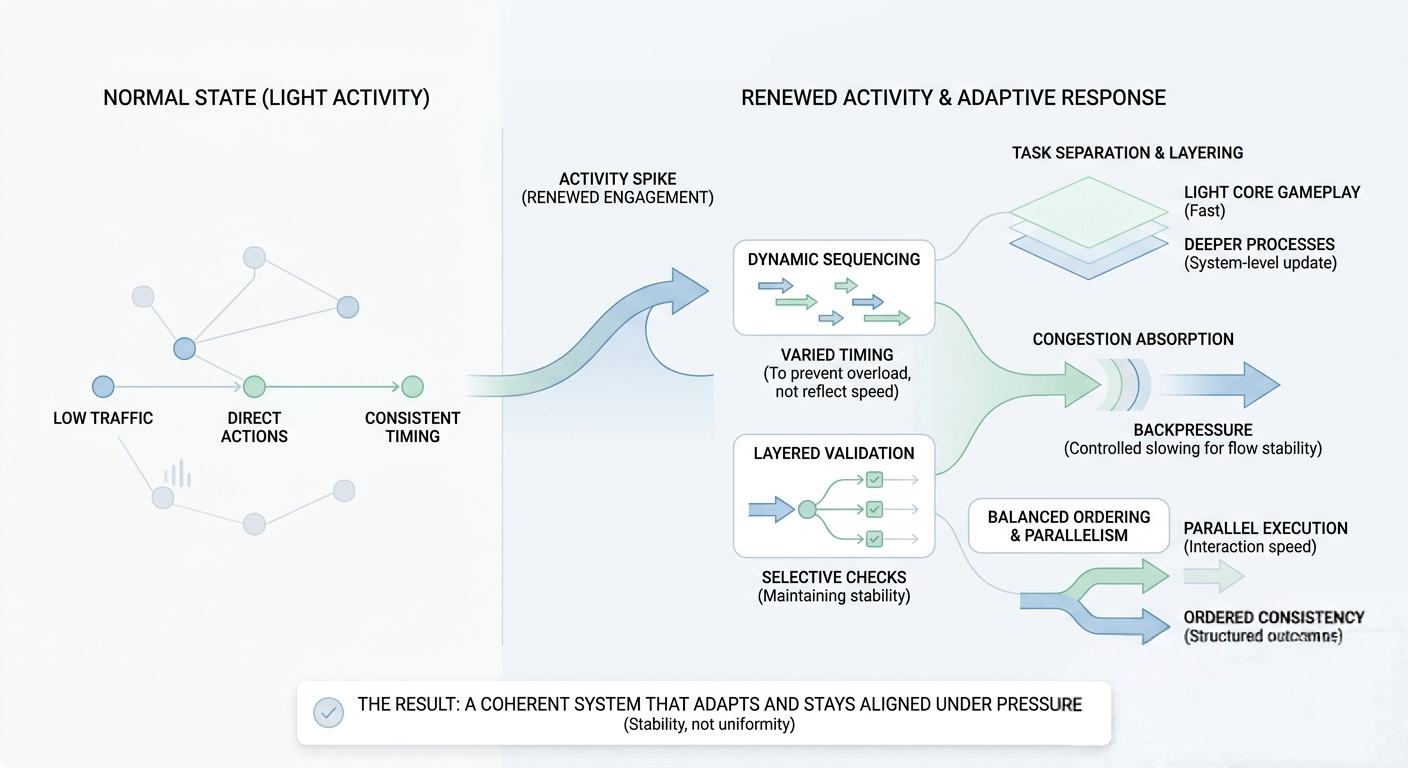

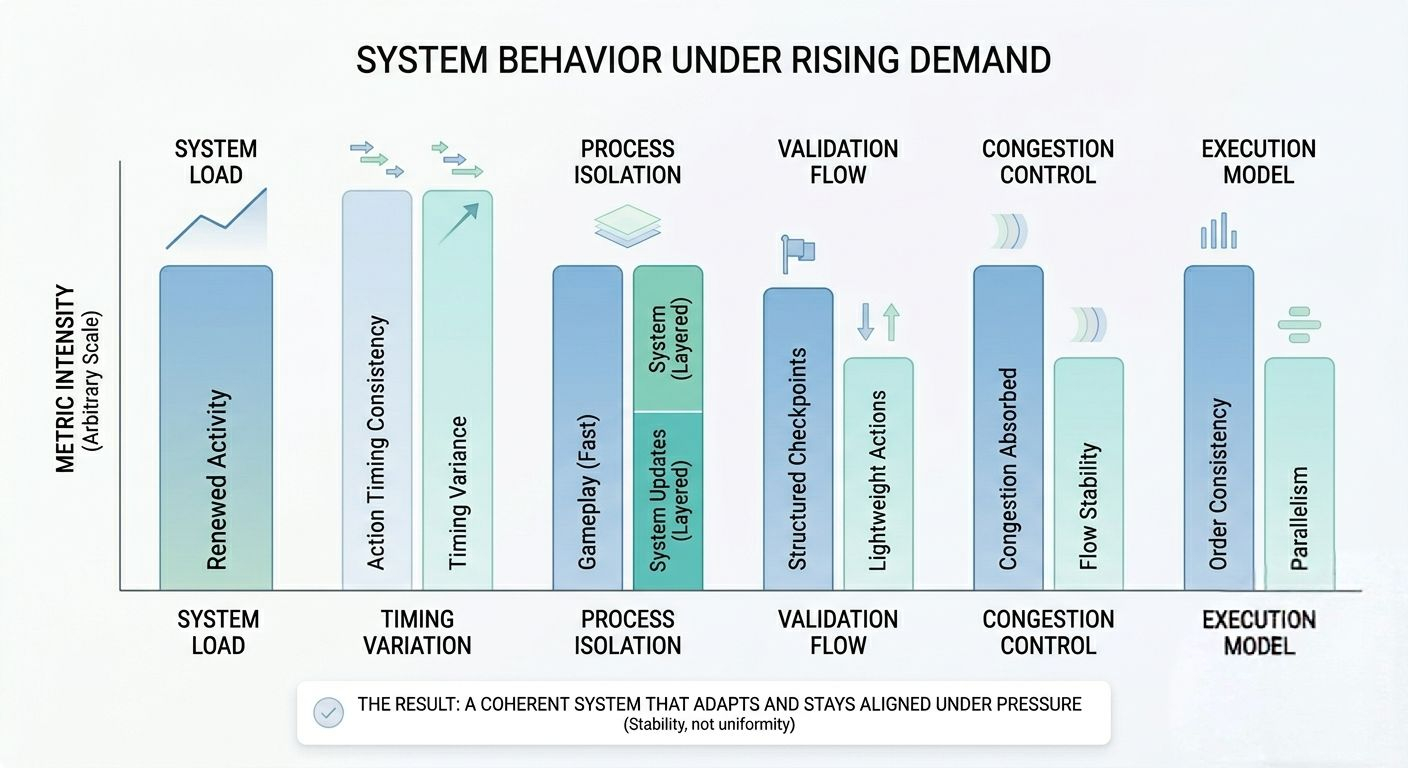

Après avoir observé cela plusieurs fois, ce que j'ai remarqué, c'est que les systèmes crypto changent rarement de manière évidente. Il n'y a pas de moment clair pour "on" ou "off". Au lieu de cela, ce qui change, c'est la façon dont le système se comporte sous pression. Lorsque l'activité augmente, tout fonctionne toujours, mais le rythme change. Certaines actions semblent immédiates, d'autres semblent espacées, et de l'extérieur, cela peut sembler incohérent même lorsque c'est en réalité un ajustement contrôlé.

D'un point de vue système, c'est là que le véritable comportement de l'infrastructure devient visible. Chaque interaction fait partie d'un environnement partagé où les actions ne sont pas isolées, mais se font concurrence pour le traitement, la validation et l'ordonnancement. Lorsque la demande augmente, le système ne cesse pas de fonctionner. Il commence à réorganiser la façon dont le flux est distribué pour ne pas s'effondrer sous la concentration.

Je pense souvent à cela comme à un port. Lorsque le trafic est léger, les navires accostent et partent sans délai. Mais quand plusieurs navires arrivent en même temps, le port ne panique pas. Il commence à attribuer des priorités, à ajuster les horaires et à gérer les mouvements de manière à ce que tout ne se bloque pas. L'expérience devient moins uniforme, mais plus stable dans l'ensemble.

Quand je regarde comment @Pixels aborde cela, ce qui a attiré mon attention, ce n'est pas seulement la couche de gameplay visible, mais la façon dont le système semble se comporter pendant les moments d'activité renouvelée. On n’a pas l’impression d’une simple mise à jour de contenu sur une structure fixe. On a plutôt l'impression d'un système qui devient actif en réponse à la participation elle-même.

Ce qui m'intéresse davantage, c'est comment cette activité révèle les choix de conception sous-jacents.

La planification semble moins rigide qu'elle n'apparaît au premier abord. Certaines actions se déplacent instantanément, tandis que d'autres semblent légèrement retardées. Cela ne paraît pas aléatoire. On a l'impression que le timing est utilisé comme un outil pour prévenir la surcharge plutôt que de simplement refléter la vitesse d'exécution.

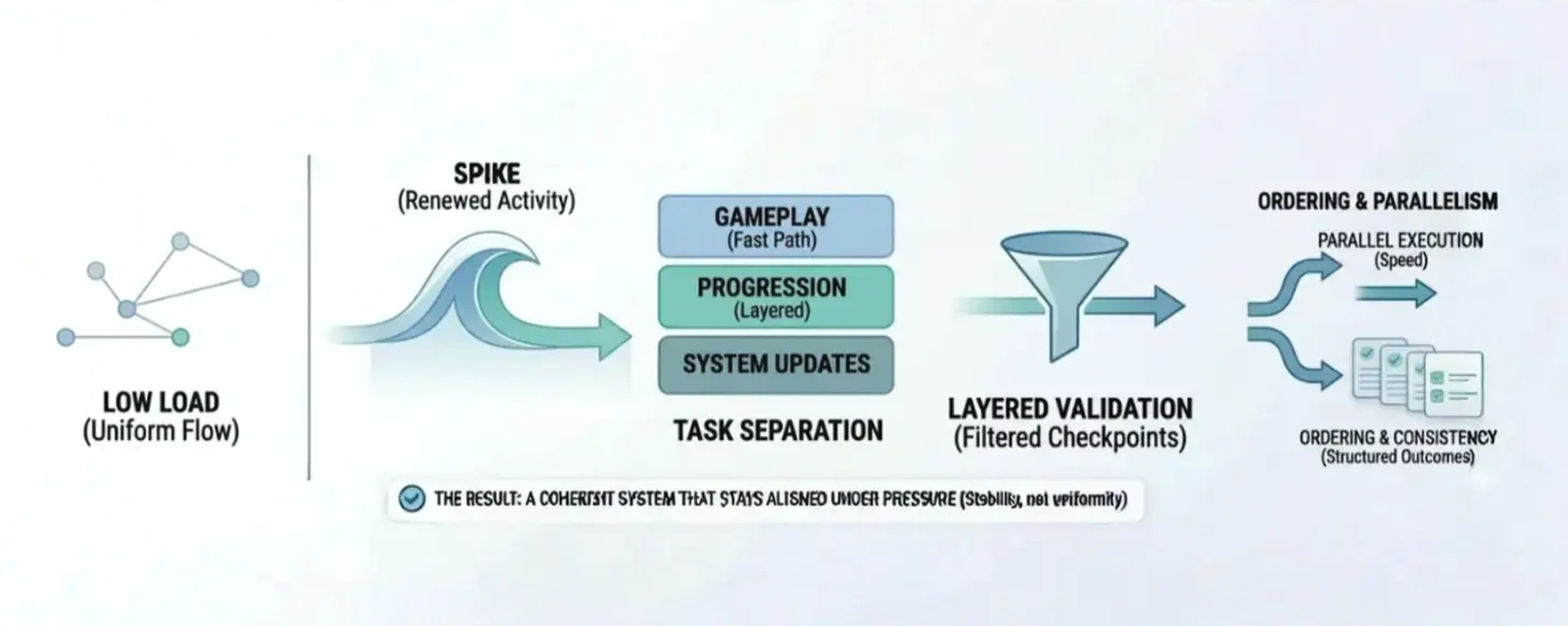

La séparation des tâches est une autre chose que je remarque souvent. La boucle de gameplay principale reste légère même lorsque l'activité augmente, tandis que des processus plus profonds comme la progression ou les mises à jour au niveau du système semblent fonctionner en couches séparées. D'un point de vue système, cette séparation est ce qui empêche tout de ralentir en même temps.

Le flux de vérification devient également plus visible pendant les périodes actives. Dans mon expérience d'observation des systèmes qui évoluent, toutes les actions ne sont pas traitées de manière égale. Certaines sont légères et rapides, tandis que d'autres nécessitent une validation plus structurée. Cette approche en couches aide à maintenir la stabilité sans forcer un retard uniforme à travers le système.

Puis il y a le contrôle de congestion. Ce qui compte en pratique, ce n'est pas de prévenir la charge, mais de l'absorber sans casser le flux. La pression inverse fait partie de ce mécanisme silencieux qui ralentit certains chemins juste assez pour que le système ne soit pas submergé tout en maintenant le mouvement vivant.

Le scalage des travailleurs et la distribution de la charge de travail ne comptent que lorsqu'ils réduisent effectivement la concentration. Si tout passe encore par un chemin étroit, ajouter de la capacité ne résout pas grand-chose. Ce qui fait la différence, c'est la façon dont le système répartit uniformément l'activité lorsque la demande augmente.

Et puis il y a l'équilibre entre l'ordonnancement et le parallélisme. L'exécution parallèle garde l'interaction réactive, surtout dans le gameplay, mais l'ordonnancement est toujours nécessaire pour maintenir la cohérence dans les résultats structurés. Le défi est de permettre aux deux d'exister sans interférer les uns avec les autres.

Ce qui m'a marqué pendant l'activité renouvelée, c'est que Pixel ne semble pas simplement réagir aux événements. On a l'impression que le système s'ajuste subtilement en fonction de la façon dont les gens s'engagent à ce moment-là. L'expérience reste simple en surface, mais en dessous, il y a un réajustement constant qui se produit dans le timing et le flux.

D'un point de vue plus large, c'est ce qui rend des systèmes comme celui-ci intéressants. Pas comment ils se comportent quand tout est calme, mais comment ils s'adaptent lorsque la participation revient et que la pression augmente à nouveau.

Un système fiable n'est pas celui qui semble parfaitement fluide tout le temps, mais celui qui reste cohérent lorsque les conditions changent. Une bonne infrastructure ne fait pas attention à ses ajustements. Elle maintient simplement tout aligné, même lorsque l'activité arrive par vagues.