Les hackers crypto exploitent l'IA pour des escroqueries hyper-réalistes ; les deepfakes, le phishing automatisé et la manipulation du marché en hausse

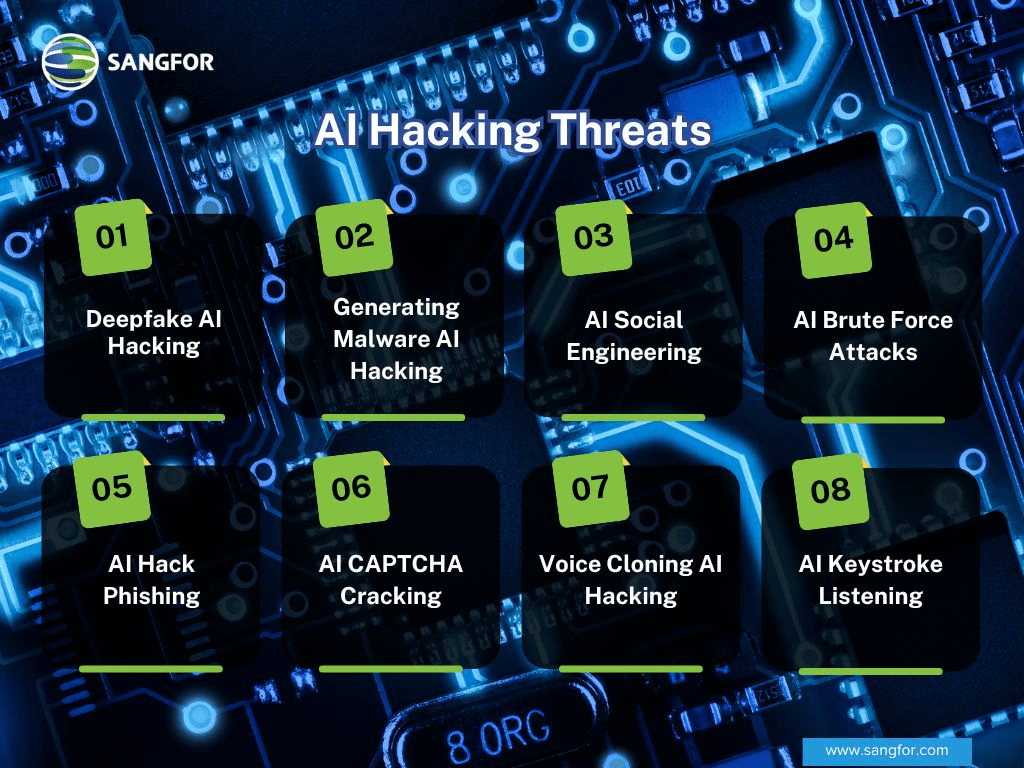

Les hackers crypto utilisent l'IA pour créer des escroqueries plus convaincantes, évolutives et sophistiquées qui exploitent la confiance humaine et automatisent les opérations frauduleuses. Ces attaques alimentées par l'IA incluent la génération de vidéos et d'audios deepfake hyper-réalistes, la création de contenus de phishing hautement personnalisés et l'automatisation des interactions avec les victimes.

Comment les hackers utilisent l'IA pour escroquer

Les deepfakes et le clonage vocal : Les escrocs créent des imitations vidéo et audio convaincantes de célébrités (comme Elon Musk), d'exécutifs, ou même de membres de la famille d'une victime pour promouvoir de faux schémas d'investissement ou faire des appels urgents pour de l'argent. Quelques secondes audio peuvent suffire à cloner une voix.

Attaques de phishing générées par l'IA : De grands modèles de langage (LLMs) sont utilisés pour créer des e-mails et des messages de phishing avec une grammaire parfaite et des détails personnalisés, les rendant difficiles à distinguer des communications légitimes. Les escrocs utilisent également l'IA pour construire rapidement de faux sites Web qui imitent de vraies plateformes de crypto pour voler des identifiants de connexion ou des clés privées.

Escroqueries automatisées (Bots) : Les chatbots alimentés par l'IA peuvent soutenir des escroqueries à long terme de type "pig butchering" ou romance en engageant des conversations semblables à celles des humains pendant des semaines ou des mois pour établir la confiance avant qu'une demande d'investissement ne soit faite. Ces bots peuvent fonctionner à grande échelle, ciblant des milliers de victimes potentielles simultanément sur des plateformes comme Telegram ou Discord.

Distribution de logiciels malveillants : L'IA peut être utilisée pour générer des logiciels malveillants qui échappent à la détection des antivirus traditionnels. Dans un cas, une fausse chaîne YouTube a utilisé une persona générée par IA pour promouvoir un "logiciel de trading alimenté par l'IA" qui, une fois téléchargé, a installé un logiciel malveillant volé d'informations pour vider les portefeuilles crypto.

Manipulation de marché : Les escrocs utilisent des bots IA pour générer du buzz et manipuler le sentiment du marché autour de tokens spécifiques (souvent dans des schémas de "pump-and-dump") pour gonfler artificiellement les prix avant de vendre leurs propres avoirs.

Comment vous protéger

Vérifiez les sources : Vérifiez toujours la source de l'information, surtout si elle implique des opportunités crypto inattendues ou non sollicitées. Tapez manuellement les URL officielles dans votre navigateur plutôt que de cliquer sur des liens dans des messages ou des publications sur les réseaux sociaux.

Soyez sceptique face aux offres "trop belles pour être vraies" : Méfiez-vous des promesses de rendements élevés garantis avec peu ou pas de risque ou de pressions pour agir rapidement.

Ne partagez jamais d'informations sensibles : Un échange ou un projet légitime ne vous demandera jamais vos clés privées ou votre phrase de récupération.

Utilisez des mesures de sécurité fortes : Activez l'authentification multi-facteurs (MFA) sur tous les comptes, et pour les avoirs crypto importants, envisagez d'utiliser un portefeuille matériel pour garder vos clés privées hors ligne.

Établissez un mot de code : Pour les membres de la famille, envisagez de créer un mot de code secret pour vérifier leur identité dans une situation urgente ou stressante, ce qui peut protéger contre les escroqueries par clonage vocal.

Restez informé : Éduquez-vous continuellement sur les dernières tactiques d'escroquerie et les signaux d'alerte en consultant des ressources de cybersécurité fiables et des alertes de fraude.