Trois heures du matin. Je fixe l'écran, rempli de code et de livres blancs, mon café est déjà froid depuis longtemps.

Je suis encore en train de réfléchir à cette question banale : à qui appartiendra vraiment la prochaine décennie de la blockchain ? Il y a quelques années, tout le monde était obsédé par le TPS (transactions par seconde), comme si une vitesse suffisante pouvait résoudre tous les problèmes. Mais récemment, en étudiant la @Vanar architecture technique, le sentiment dans ma tête que 'c'est ainsi' devient de plus en plus fort. Ce n'est pas une course à la vitesse, c'est une évolution de 'l'intelligence'.

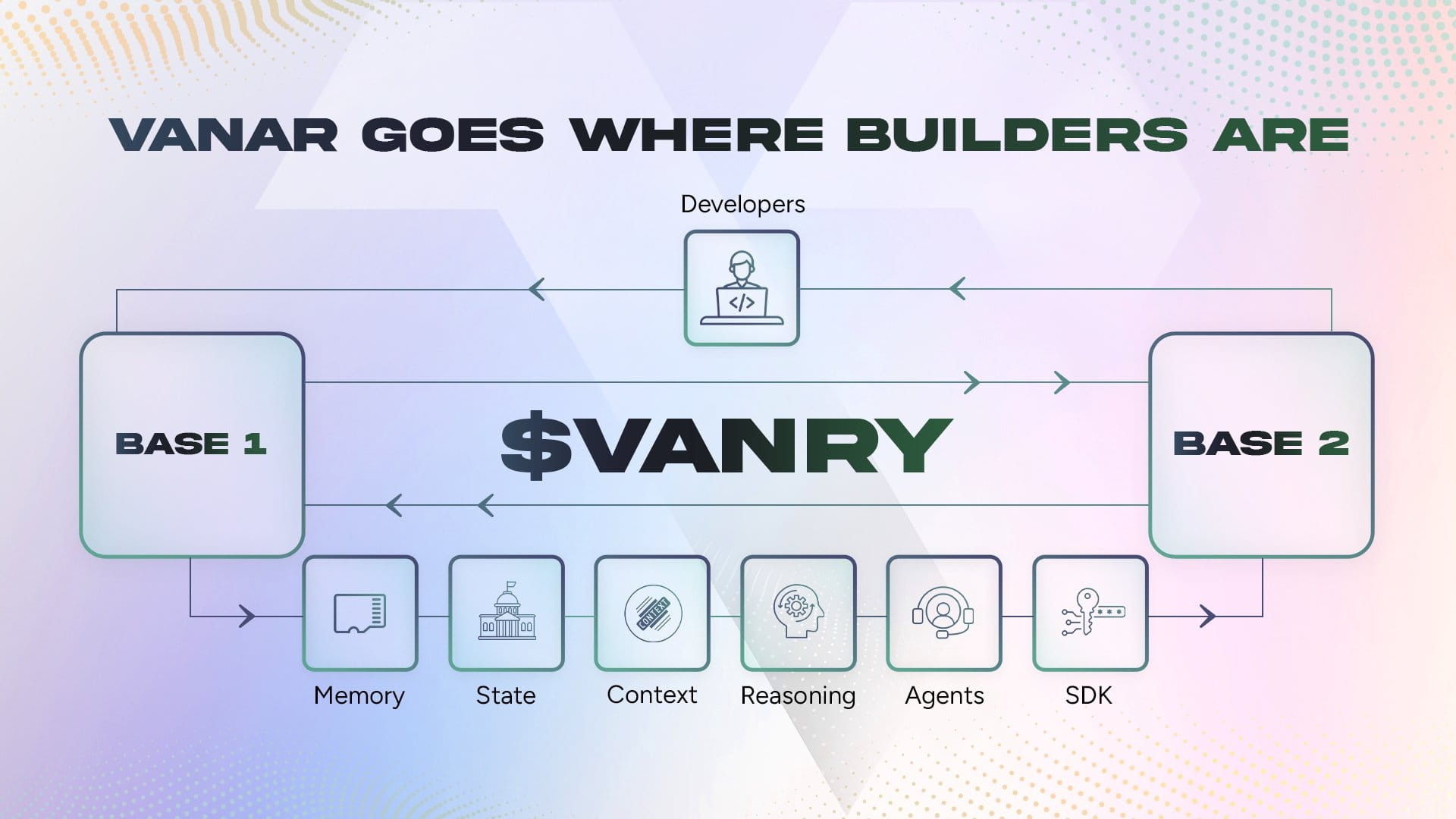

En regardant le diagramme d'architecture de Vanar Chain sur l'écran, je ne peux m'empêcher de vouloir clarifier cette ligne logique. Le marché des chaînes publiques d'aujourd'hui ressemble, pour être honnête, à un groupe de personnes en compétition pour voir qui court le plus vite, mais personne ne se soucie de savoir où courir vite. Tout le monde crie 'IA + Blockchain', mais la grande majorité des soi-disant 'chaînes publiques IA', à mes yeux, ne sont rien d'autre que des modèles IA forcés 'ajoutés' à une ancienne chaîne. Cela ressemble à équiper une charrette d'un GPS, ça a l'air très avancé, mais la puissance motrice principale reste le cheval.

Mais @vanar me donne une sensation différente. C'est natif.

Je réfléchis à la portée du terme "natif". En parcourant leur documentation technique sur la couche Neutron, cette différence devient concrète. Normalement, lorsque nous stockons des données sur la chaîne, pour économiser de l'argent et de l'espace, nous ne stockons qu'une valeur de hachage, les vraies données - comme les images NFT ou les documents PDF - sont en réalité stockées sur IPFS ou sur des serveurs cloud d'Amazon. Cela a conduit à une question qui me préoccupe depuis longtemps : la soi-disant "propriété en chaîne" est en fait une illusion. Si le serveur correspondant à votre NFT perd de l'énergie, la valeur de hachage que vous détenez devient un morceau de papier sans valeur.

Et la couche Neutron de Vanar semble s'attaquer directement à ce problème. J'ai regardé le concept de "stockage sémantique" pendant longtemps. Ils ne stockent pas de hachages, mais utilisent des algorithmes d'IA pour compresser sémantiquement les données. Ce ratio de compression de 500:1 m'a un peu surpris. Que signifie cela ? Cela signifie qu'un contrat complexe de 25 Mo ou un document technique peut être compressé en quelques dizaines de Ko de "semence (Seed)" et ensuite directement stocké dans un bloc.

Dans ma tête, j'ai simulé ce processus : lorsque un Agent IA (intelligent) doit lire ce contrat, il n'a pas besoin de chercher le fichier original partout hors chaîne, il peut directement décompresser, lire et comprendre sur la chaîne. Cette "présence des données" est quelque chose que la majorité des blockchains publiques ne peuvent pas réaliser. Ce n'est pas seulement un changement de méthode de stockage, c'est donner à l'IA un "cerveau natif". Une IA sans mémoire ne peut pas gérer des tâches complexes, et Neutron est comme un hippocampe pour la blockchain, transformant les données sur la chaîne en "connaissance" compréhensible par l'IA, plutôt qu'en froide code binaire.

Mes pensées s'éloignant un peu, j'ai ramené mon regard vers leur architecture à cinq niveaux. Vanar Chain est en bas, Neutron fait la mémoire, et au-dessus se trouve Kayon - la couche de raisonnement.

En voyant Kayon, l'image de la rigidité actuelle des contrats intelligents m'a frappé. Les contrats intelligents d'aujourd'hui, en gros, c'est "si A se produit, alors exécutez B", c'est une logique complètement linéaire et rigide. Ils ne comprennent pas le langage humain et ne saisissent pas des contextes complexes. Mais l'ambition de Kayon semble être de donner une capacité de raisonnement à la logique sur la chaîne.

J'imagine un tel scénario : les futurs protocoles DeFi ne déclenchent pas simplement des liquidations en fonction des prix, mais un Agent IA utilise la couche Kayon pour analyser le sentiment du marché, les nouvelles macroéconomiques et même les flux de fonds sur la chaîne, puis prend une décision de "liquidation ou non" dans ce contexte complexe. Ce n'est plus simplement de l'"automatisation", c'est de l'"intelligence". Ce que Vanar semble faire, c'est fournir l'infrastructure pour un tel avenir. Si le code peut penser comme un humain, ou du moins traiter la logique floue comme un assistant extrêmement intelligent, alors la couche d'application du Web3 pourrait réellement exploser.

De nombreux projets sur le marché aujourd'hui, pour surfer sur la tendance, se précipitent pour intégrer l'API ChatGPT, puis se déclarent comme des projets IA. Chaque fois que je vois cela, je roule les yeux intérieurement. Cette dépendance à des API externes non seulement entraîne des délais élevés, mais si l'interface d'OpenAI tombe, l'ensemble de l'application sur la chaîne s'effondre. Sans parler des problèmes de confidentialité - oseriez-vous confier la logique financière centrale à un modèle de boîte noire centralisé ?

L'approche de Vanar semble clairement vouloir éviter ce piège. Ils placent le raisonnement et la vérification sur la chaîne, ou du moins les résolvent au niveau du protocole, plutôt que de les externaliser aux géants du Web2. C'est ce à quoi le Web3 doit ressembler : une intelligence décentralisée.

Je ne peux m'empêcher de penser à la récente nouvelle de leur collaboration avec Google Cloud et NVIDIA. Normalement, je ne fais pas vraiment attention à ce genre de collaboration "mur de logos", mais en tenant compte de leur pile technologique, cela devient intéressant. NVIDIA fournit des outils de calcul, Google Cloud offre un soutien de nœuds verts, cela ressemble davantage à préparer le terrain pour des calculs IA à haute charge, plutôt qu'à un simple soutien de marque. Après tout, faire fonctionner ne serait-ce qu'un modèle de raisonnement simplifié sur la chaîne exige également une infrastructure de haute qualité.

À ce moment-là, j'ai repensé à ceux qui sont toujours en train de se battre pour les frais de Gas et le TPS parmi les L2. Ce n'est pas qu'ils ne sont pas importants, mais c'est une question de dimension différente. Si l'internet du futur est composé de millions d'Agents IA interagissant, échangeant et signant des contrats sur la chaîne, ce dont ils auront le plus besoin ce n'est peut-être pas d'une vitesse de transaction de cent mille par seconde, mais plutôt - "Puis-je comprendre ce contrat ?", "Ces données sont-elles réelles ?", "Puis-je établir une mémoire à long terme sur cette chaîne ?".

À ce niveau, Vanar semble être en avance. Il considère "l'intelligence" comme un principe fondamental, et non comme une option.

Tout à l'heure, j'ai rapidement vérifié les discussions récentes de la communauté #Vanar et j'ai réalisé que les gens commencent à prendre conscience de la tendance de la transition des "chaînes d'applications" vers "chaînes intelligentes". Autrefois, dire "tout doit être en chaîne" était en fait très lourd. Transmettre une montagne de données inutiles coûtait cher et n'était pas utile. Maintenant, avec Neutron et la compression sémantique et le raisonnement de Kayon, nous pourrions vraiment réaliser que "tout a une âme" - permettant à chaque actif sur la chaîne, que ce soit des titres financiers ou des objets de jeu, d'avoir une logique lisible et manipulable par l'IA.

Cette profondeur technique m'excite, mais m'entraîne également dans une réflexion plus profonde. Construire un tel système nécessite un travail colossal. De l'optimisation des algorithmes de compression sémantique au contrôle des coûts de raisonnement sur la chaîne, chaque étape est un véritable défi. Je regarde les détails techniques sur les "Seeds" à l'écran et je ne peux m'empêcher de penser que cette équipe veut vraiment toucher aux logiques fondamentales.

Par exemple, pour les développeurs, écrire du code dans cet écosystème pourrait ne plus être aussi simple que d'écrire en Solidity, mais plutôt de concevoir les chemins de pensée des Agents. J'aurais peut-être à définir comment mon IA récupère les souvenirs dans Neutron, comment elle utilise Kayon pour prendre des décisions, et enfin exécuter des opérations automatisées via la couche Axon. Cela change complètement le paradigme de développement des DApp. Les futurs développeurs pourraient ressembler davantage à des "entraîneurs" ou "architectes logiques" de l'IA.

J'ai aussi pensé à ce classique "triangle impossible". Dans la blockchain IA, il pourrait également exister un nouveau triangle : profondeur de raisonnement, vitesse de réponse et degré de décentralisation. L'architecture actuelle de Vanar semble essayer de équilibrer ces trois éléments par la stratification. Le niveau inférieur est chargé du consensus et du règlement, le niveau intermédiaire gère la mémoire et le raisonnement. Cette conception modulaire semble être la plus scientifique à ce jour.

La nuit s'épaissit, la ville dehors est complètement silencieuse, mais les neurones dans mon cerveau continuent de vibrer frénétiquement.

Je me demande, si cette architecture fonctionne vraiment, à quoi ressemblera le futur ? Peut-être que sur Vanar, j'aurai un véritable "deuxième cerveau" qui m'appartient. Il ne s'agit pas seulement de stocker mes fichiers, il comprend mes habitudes de transaction, il se souvient de chaque livre blanc que j'ai lu (sous forme de semences compressées), il peut même m'aider à analyser si les nouveaux protocoles DeFi correspondent à mes préférences de risque pendant que je dors. De plus, toutes ces données et logiques sont vérifiables sur la chaîne, ne appartenant à aucun géant technologique.

C'est exactement ce que le Web3 promet pour notre avenir, n'est-ce pas ?

Le marché actuel est toujours trop agité, les barres rouges et vertes des prix masquent trop facilement l'essence de la technologie. Mais je préfère me concentrer sur ces diagrammes d'architecture ternes. Parce que je sais qu'une fois la marée redescendue, ce qui restera pour définir la prochaine époque, ce seront ceux qui ont résolu les douleurs fondamentales.

Dans le domaine AI x Crypto, le point de douleur est que : l'IA a besoin de puissance de calcul, de stockage et de vérification décentralisés. Les chaînes actuelles ne peuvent pas fournir cela, mais Vanar le fait.

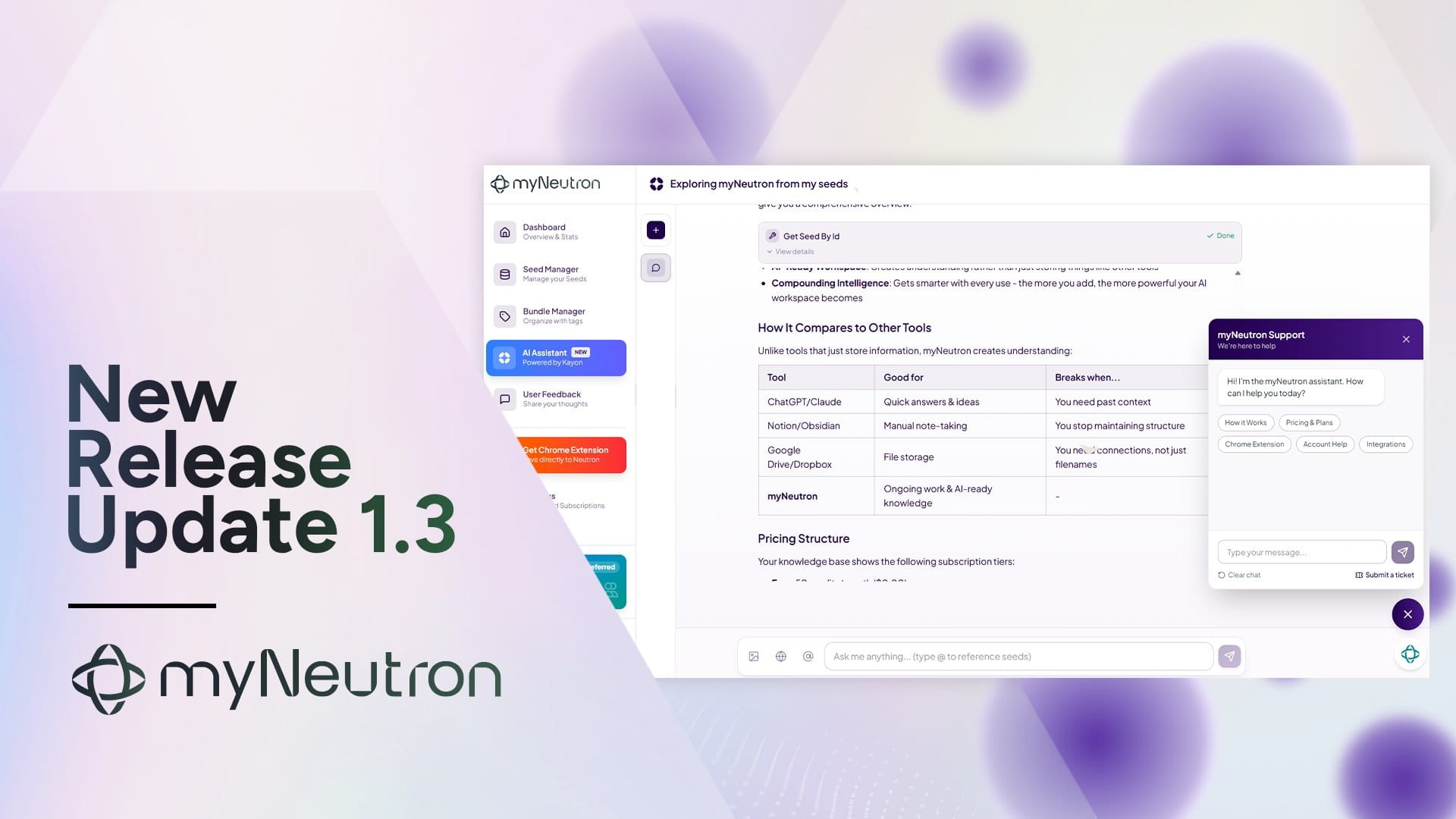

Je suis retourné voir leur récente feuille de route (Roadmap). De la mise en œuvre de myNeutron à l'avancement du réseau de test Vanguard, chaque étape est axée sur "rendre la blockchain plus intelligente". Cette capacité d'exécution est en fait assez rare dans le cercle des cryptomonnaies. Beaucoup de projets font des promesses, mais peu sont ceux qui peuvent réaliser quelque chose d'aussi futuriste que le "stockage sémantique".

En écrivant cela, je me suis soudain rendu compte que peut-être nous ne devrions plus définir @vanar par le terme "blockchain publique". Cela ressemble davantage à un cloud intelligent décentralisé. Dans ce cloud, la puissance de calcul, les données et les algorithmes ne sont plus des ressources monopolistiques, mais des infrastructures publiques qui peuvent circuler via des tokens.

J'imagine un jour où des milliers d'Agents IA parcourent le réseau #Vanar. Ils échangent des informations à haute densité compressées par Neutron, atteignent un consensus via Kayon et exécutent automatiquement une logique commerciale complexe. Les humains n'ont peut-être besoin de jouer que le rôle de superviseurs et de régulateurs. À quelle distance sommes-nous de ce monde ?

En regardant l'heure en bas à droite de l'écran, il est presque quatre heures du matin. Mais je n'ai pas du tout sommeil. La sensation de frisson provoquée par la révolution technologique est beaucoup plus efficace que la caféine.

Pour nous qui avons traîné dans cette industrie, ce que nous craignons le plus n'est pas de perdre de l'argent, mais de manquer le moment de la transition de paradigme. Quand Ethereum a introduit les contrats intelligents, transformant la blockchain de "registre" en "ordinateur", c'était un saut. Maintenant, Vanar essaie de transformer la blockchain de "ordinateur" en "cerveau", sera-ce le prochain saut ?

Je ne peux pas en être certain, mais en regardant cette architecture technique rigoureuse à cinq niveaux, mon instinct me dit : la direction est la bonne.

Dans ce marché bruyant, un projet capable de se concentrer sur l'innovation de l'infrastructure de base mérite un regard attentif, encore et encore. J'ai fermé mon carnet, et les mots "semences sémantiques", "raisonnement sur la chaîne" résonnent toujours dans ma tête.

Le ciel dehors commence à s'éclaircir. Et l'ère de l'IA blockchain pourrait être à l'aube d'un nouveau jour. Nous nous tenons à un grand carrefour, d'un côté se trouve le registre mécanique de l'ancienne époque, de l'autre, le réseau intelligent de la nouvelle ère. Je suis heureux de me concentrer sur ce dernier.

Voilà tout ce que j'ai pensé ce soir - ou plutôt ce matin. À propos de la technologie, de l'avenir, de ce monde décentralisé qui pourrait être construit par des codes et des algorithmes plus intelligents.#vanar $VANRY