Kecerdasan buatan sekarang menjadi bagian dari kehidupan sehari-hari. Ini membantu menulis email, menjawab pertanyaan, meringkas penelitian, dan bahkan membimbing keputusan keuangan. Tetapi ada masalah besar.

AI dapat membuat kesalahan, dan sering kali terdengar sangat yakin pada dirinya sendiri bahkan ketika ia salah.

Terkadang, AI memberikan jawaban yang tampak akurat tetapi tidak sepenuhnya benar. Faktanya, studi telah menunjukkan bahwa model bahasa besar dapat menghasilkan informasi yang salah atau menyesatkan dalam hingga 15% kasus, tergantung pada kompleksitas tugas.

Ini terjadi karena model AI memprediksi respons berdasarkan pola, bukan pemahaman yang sebenarnya. Dalam kasus penggunaan yang sederhana, itu mungkin tidak terlalu penting. Tetapi dalam lingkungan yang lebih serius, keandalan menjadi penting.

Di situlah @Mira - Trust Layer of AI masuk.

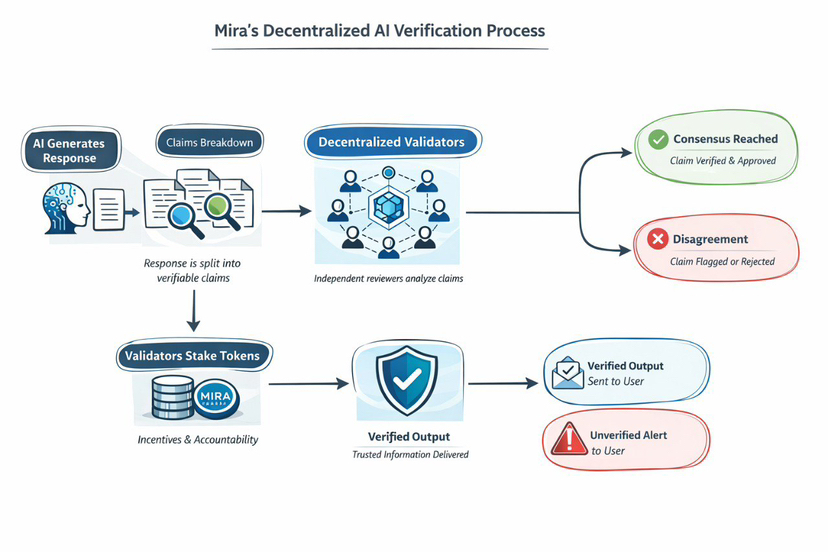

Mira Network sedang membangun sistem yang memeriksa keluaran AI sebelum mereka dipercaya. Alih-alih bergantung pada satu model untuk memberikan jawaban akhir, Mira menggunakan beberapa validator independen untuk meninjau respons.

Inilah cara kerjanya dalam istilah sederhana.

Pertama, AI menghasilkan jawaban. Mira kemudian membagi jawaban itu menjadi pernyataan yang lebih kecil. Pernyataan ini dikirim ke validator yang berbeda dalam jaringan. Setiap validator memeriksa apakah pernyataan tersebut tampak akurat atau tidak. Setelah itu, sistem melihat kesepakatan keseluruhan di antara mereka.

Jika sebagian besar validator setuju jawaban itu benar, itu lulus verifikasi. Jika ada ketidaksetujuan, keluaran bisa ditandai atau ditolak.

Idenya sederhana, alih-alih mempercayai satu sumber, percayalah pada kesepakatan antara banyak.

Pendekatan ini terinspirasi oleh cara kerja sistem terdesentralisasi. Dalam jaringan blockchain, transaksi tidak dikonfirmasi oleh satu otoritas. Mereka divalidasi oleh banyak peserta. Mira menerapkan ide serupa pada respons AI.

Jaringan juga menggunakan insentif untuk mendorong partisipasi yang jujur. Validator harus mempertaruhkan $MIRA token untuk menjadi bagian dari sistem.

Jika mereka bertindak jujur dan memberikan pemeriksaan yang akurat, mereka mendapatkan imbalan. Jika mereka bertindak sembrono atau mencoba memanipulasi hasil, mereka berisiko kehilangan sebagian dari taruhan mereka.

Ini menciptakan akuntabilitas. Validator memiliki sesuatu yang dipertaruhkan, jadi mereka termotivasi untuk akurat.

Penting untuk memahami bahwa Mira tidak mencoba membangun model AI yang lebih baik. Ini tidak bersaing dengan perusahaan AI besar. Sebaliknya, ia fokus pada menambahkan lapisan verifikasi di atas sistem AI yang ada.

Anggap ini sebagai sistem ulasan untuk keluaran AI. Tujuannya bukan kesempurnaan. Tujuannya adalah mengurangi kesalahan dan menambahkan lapisan kepercayaan ekstra sebelum keputusan diambil berdasarkan respons AI.

Seiring AI menjadi lebih umum di berbagai industri, kebutuhan akan keandalan meningkat. Mira Network fokus pada memecahkan masalah spesifik itu, bagaimana membuat keluaran AI lebih dapat diandalkan tanpa bergantung pada satu sumber terpusat.

Dalam istilah sederhana, Mira sedang membangun sistem yang memeriksa AI sebelum Anda mengandalkannya.

#Mira #AI #MiraNetwork #ArtificialInteligence #DecentralisedAI