*Momen Ketika Jawaban AI Membuat Saya Terhenti"

Hari ini saya sedang meninjau dasbor DeFi sambil mengikuti beberapa diskusi kampanye CreatorPad di Binance Square. Saya telah meminta asisten AI untuk merangkum aktivitas likuiditas di beberapa kolam yang telah saya pantau. Jawabannya terlihat bagus pada pandangan pertama. Analisis yang terstruktur, alasan yang jelas, bahkan sedikit ramalan tentang ke mana likuiditas mungkin bergerak selanjutnya. Kemudian saya memeriksa data mentah. Salah satu asumsi yang dibuat AI sedikit salah. Tidak sepenuhnya salah, tetapi cukup agar kesimpulannya tentang arah pasar tidak benar-benar dapat dipertahankan. Momen itu mengingatkan saya pada sesuatu yang tidak nyaman tentang sistem AI: mereka sangat baik dalam menghasilkan jawaban yang terdengar dapat dipercaya, bahkan ketika logika di baliknya tidak sempurna. Dan itulah tepatnya jenis masalah yang tampaknya coba diatasi oleh Mira. Masalah Kepercayaan yang Nyata di Balik Keluaran AI. Dalam crypto, kita menghabiskan banyak waktu membicarakan desentralisasi dan minimisasi kepercayaan. Blockchain menyelesaikan masalah transaksi dengan mengganti kepercayaan dengan konsensus terdistribusi. Namun, sistem AI masih sebagian besar beroperasi dalam lingkungan yang berat kepercayaan. Ketika sebuah model menghasilkan sepotong informasi — analisis, rekomendasi, atau ringkasan — pengguna biasanya mempercayai keluaran tersebut tanpa proses verifikasi. Dalam sistem terpusat, perusahaan yang menjalankan model bertindak sebagai otoritas di balik kepercayaan itu. Begitu AI mulai berinteraksi dengan sistem desentralisasi, keadaan menjadi lebih rumit. Bayangkan agen AI menganalisis pasar DeFi, merangkum usulan tata kelola, atau menghasilkan sinyal untuk strategi perdagangan otomatis. Jika keluaran tersebut tidak benar, konsekuensinya bisa bergetar di seluruh aplikasi desentralisasi. Di situlah arsitektur Mira menjadi menarik. Alih-alih menganggap keluaran AI dapat diandalkan, ia memperkenalkan lapisan verifikasi antara generasi dan kepercayaan.

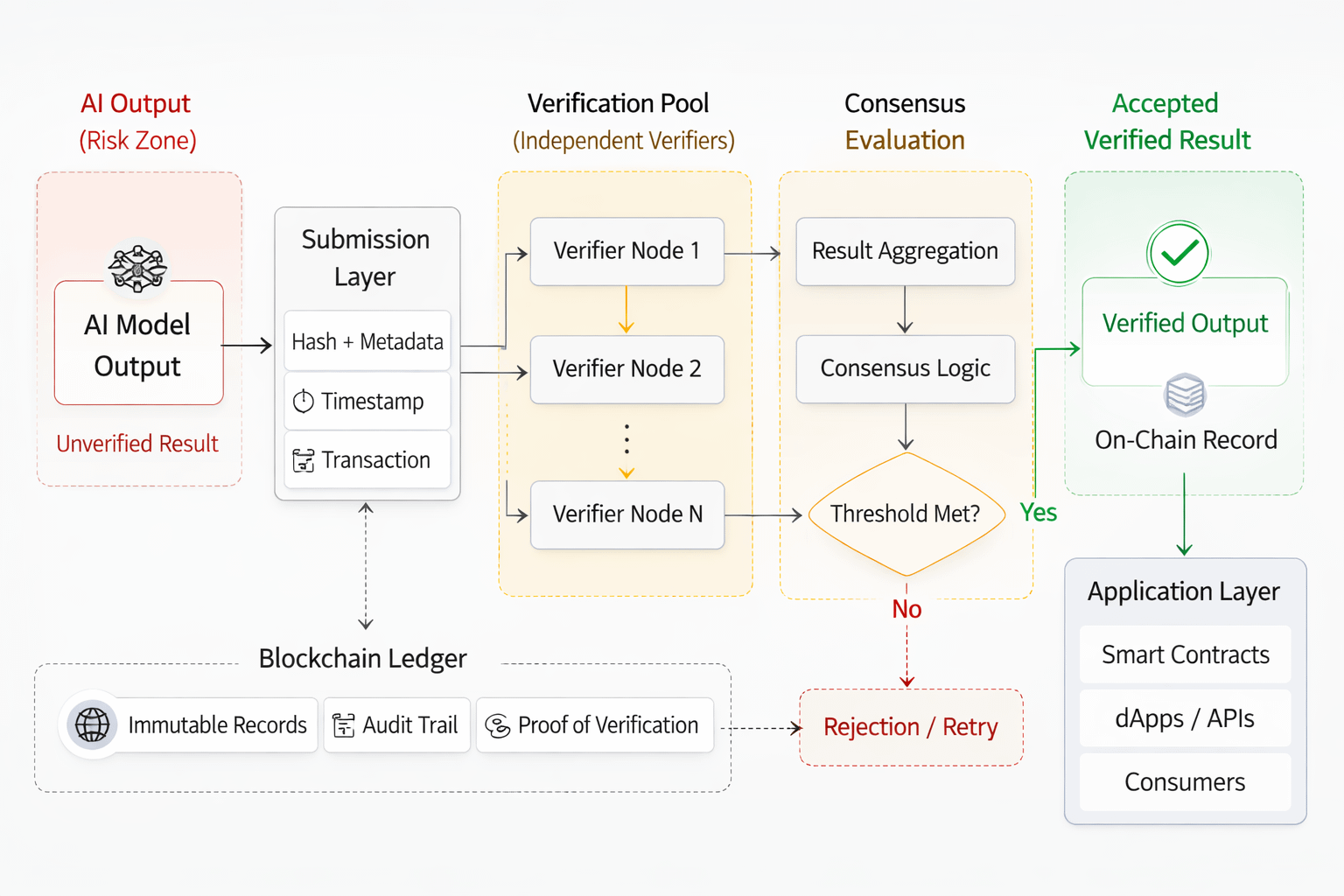

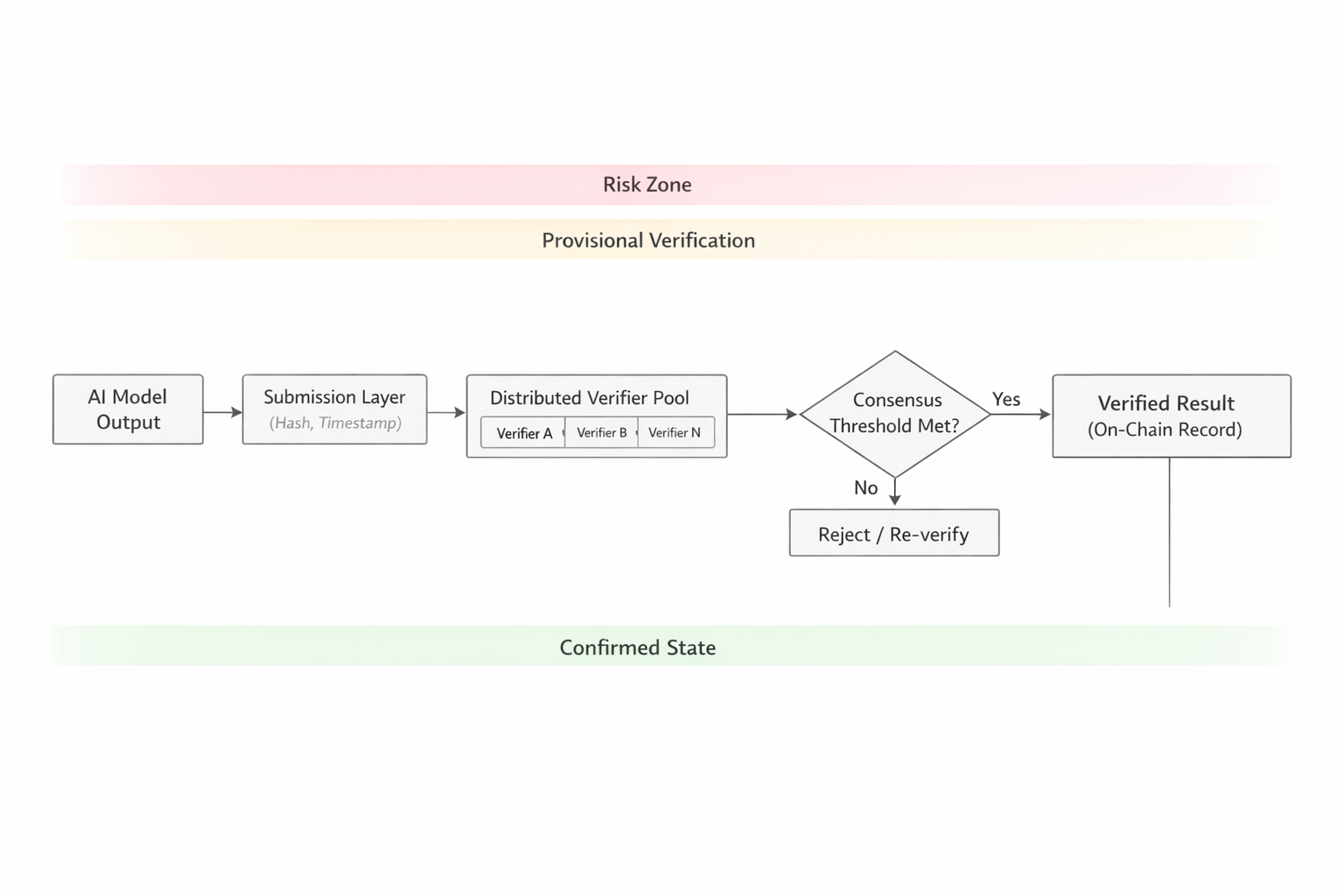

Mekanisme Inti Mira: Memisahkan Output Dari Penerimaan. Dari membaca pos CreatorPad dan menggali referensi dokumentasi yang dibagikan dalam thread Binance Square, sistem Mira bekerja dengan membagi proses menjadi dua tahap. Tahap pertama sangat sederhana: model AI menghasilkan output. Namun, output tersebut tidak segera diterima oleh jaringan. Sebaliknya, mereka memasuki fase verifikasi di mana peserta independen mengevaluasi hasilnya sebelum menjadi informasi yang dipercaya. Alur terlihat seperti ini:

AI Output → Verification Round → Validator Agreement → Accepted Result

Saat mempelajari desain, saya sebenarnya menggambar diagram alur kecil untuk memahami hal itu. Struktur tersebut mengingatkan saya pada jalur validasi blockchain, kecuali jaringan memverifikasi informasi daripada transaksi. Pergeseran desain kecil itu bisa menjadi sangat signifikan. Mengubah Verifikasi Menjadi Jaringan Terdesentralisasi. Salah satu detail yang menonjol dalam model Mira adalah ketergantungan pada beberapa verifier independen. Alih-alih mempercayai satu entitas untuk mengevaluasi output AI, jaringan mendistribusikan tanggung jawab itu di antara peserta. Setiap verifier meninjau output dan mengirimkan evaluasi. Jika cukup banyak peserta setuju bahwa informasi itu valid, jaringan menerimanya. Jika tidak, output ditolak atau ditandai. Pada dasarnya, Mira menerapkan prinsip yang sama yang mengamankan blockchain — konsensus terdistribusi — untuk evaluasi informasi yang dihasilkan mesin. Dan pendekatan itu dapat secara dramatis mengurangi kepercayaan buta pada output AI. Dimana Ini Bisa Penting dalam Aplikasi Nyata Saat membaca diskusi kampanye CreatorPad, saya terus memikirkan agen AI yang beroperasi di dalam sistem DeFi. Beberapa protokol sudah bereksperimen dengan alat analitik bertenaga AI yang merekomendasikan alokasi portofolio atau strategi likuiditas. Jika alat-alat tersebut menghasilkan penalaran yang salah, pengguna mungkin mengambil keputusan keuangan berdasarkan informasi yang cacat. Dengan lapisan verifikasi Mira, output tersebut dapat dievaluasi oleh beberapa peserta sebelum mempengaruhi aplikasi. Alih-alih mempercayai model secara langsung, jaringan mengonfirmasi apakah penalaran tersebut valid. Langkah tambahan itu mungkin terdengar kecil, tetapi dalam sistem keuangan dapat secara signifikan mengurangi risiko. Sisi Ekonomi dari Kepercayaan Aspek lain dari desain Mira yang menarik perhatian saya adalah model insentif. Peserta yang memverifikasi output AI tidak hanya melakukan tugas teknis. Mereka diberi imbalan secara ekonomi untuk evaluasi yang akurat. Itu menciptakan sistem di mana kepercayaan itu sendiri menjadi layanan jaringan. Pengembang AI menghasilkan informasi. Verifier mengevaluasi informasi tersebut. Aplikasi mengkonsumsi hasil yang telah diverifikasi. Beberapa kontributor CreatorPad mulai merujuk pada struktur ini sebagai ekonomi verifikasi, di mana validasi pengetahuan yang dihasilkan mesin menjadi aktivitas yang produktif. Jika konten yang dihasilkan AI terus meluas di seluruh ekosistem Web3, lapisan ekonomi semacam itu mungkin menjadi sangat berharga.

Tantangan yang Harus Diselesaikan Sistem. Tentu saja, arsitektur ini menimbulkan beberapa pertanyaan penting. Verifikasi tidak selalu sederhana. Beberapa output AI melibatkan klaim faktual yang dapat diperiksa dengan mudah, tetapi yang lain melibatkan penalaran atau interpretasi. Protokol akan membutuhkan kerangka evaluasi yang dapat diandalkan untuk membimbing para verifier. Kecepatan juga menjadi perhatian. Aplikasi AI sering beroperasi dengan cepat, sementara lapisan verifikasi memperkenalkan langkah tambahan sebelum output diterima. Ada juga risiko masalah koordinasi jika para verifier hanya menyalin respon satu sama lain alih-alih melakukan evaluasi independen. Ini adalah tantangan desain yang sulit, tetapi juga mirip dengan masalah koordinasi yang dihadapi jaringan blockchain awal saat membangun sistem konsensus. Mengapa Mira Terus Muncul dalam Diskusi CreatorPad. Setelah menghabiskan waktu membaca pos kampanye CreatorPad di Binance Square, saya menyadari bahwa diskusi tentang Mira sering lebih mendalam daripada percakapan token biasa. Orang-orang tidak hanya bertanya tentang kinerja harga. Mereka mendebat bagaimana sistem terdesentralisasi dapat memverifikasi informasi yang dihasilkan AI dalam skala besar. Itu adalah jenis percakapan yang sangat berbeda. Pertanyaan Besar di Balik Desain Mira. Blockchain mengubah sistem keuangan dengan menghilangkan kebutuhan untuk mempercayai perantara terpusat. Namun, sistem AI masih sangat bergantung pada kepercayaan. Pengguna mempercayai penyedia model, data pelatihan, dan infrastruktur yang memproduksi output. Arsitektur Mira mengisyaratkan kemungkinan lain. Alih-alih mempercayai AI secara membabi buta, jaringan dapat memverifikasi informasi yang dihasilkan mesin secara kolektif sebelum menerimanya. Jika AI terus terintegrasi ke dalam ekosistem terdesentralisasi — dari analitik DeFi hingga alat pemerintahan — lapisan verifikasi semacam itu mungkin menjadi penting. Dan jika itu terjadi, proyek-proyek seperti Mira tidak hanya akan menjadi eksperimen AI. Mereka bisa menjadi bagian dari infrastruktur yang mendefinisikan bagaimana kepercayaan bekerja di era pengetahuan yang dihasilkan mesin.

$ARIA $UAI $MIRA #Mira @Mira - Trust Layer of AI

#creatorpad #LearnWithFatima

#TrendingTopic #Market_Update