Ho già scritto alcuni articoli su Mira Network nell'ultima settimana e ho parlato a lungo dei rischi nel mondo dell'IA come Hoax, Deepfake, modelli che possono inventare fatti, fino alla possibilità di reti di verifica che vengono attaccate. E ora, ma la vera domanda è? Mira è solo consapevole dei rischi o sta davvero preparando le sue difese? La risposta è che stanno costruendo quelle difese lentamente.

Riguardo al voto

In molti ecosistemi, la verità è spesso determinata dalla maggioranza dei voti. Il problema è che la maggioranza può essere facilmente manipolata se ci sono migliaia di account falsi. In Mira, il concetto è davvero diverso. Ciò che viene conteggiato non è il numero delle persone, ma la loro reputazione.

Se un nodo ha dimostrato di verificare frequentemente con precisione, la sua voce sarà molto più forte rispetto a migliaia di nuovi nodi che emergono improvvisamente. Quindi, anche se ci fosse un attacco Sybil creando molte identità false, sarebbe comunque difficile per loro superare i nodi la cui reputazione è stata costruita nel tempo. Qui Mira sta cercando di creare qualcosa che viene raramente discusso nel mondo dell'AI, cioè una rete di verifica aperta che valuta la verità in base alla reputazione del nodo, non solo al semplice consenso della maggioranza. Devi pensarci due volte se vuoi creare migliaia di nodi contemporaneamente se già sai di Mira.

Argomento Costi e Velocità

La verifica sulla blockchain può essere costosa se tutto viene calcolato direttamente sulla catena, per questo Mira utilizza un approccio più leggero: la verifica avviene prima al di fuori della catena, e poi il risultato finale viene registrato sulla blockchain. Quindi il processo è rapido, ma la traccia della verità rimane trasparente.

Corsa Contro AI Imbroglioni

Sappiamo che i modelli di AI diventano sempre più bravi a creare manipolazioni. In Mira, i nodi verificatori sono progettati per imparare continuamente. Ogni volta che emerge un nuovo schema di manipolazione o un tipo di allucinazione AI, il sistema può adattarsi e aggiornare il suo istinto. È come un antivirus destinato alla verità. Se tutti questi strati sono davvero maturi, secondo me Mira sta effettivamente procedendo verso qualcosa di più grande di un semplice progetto crittografico.

Immagina Internet nel 2030!

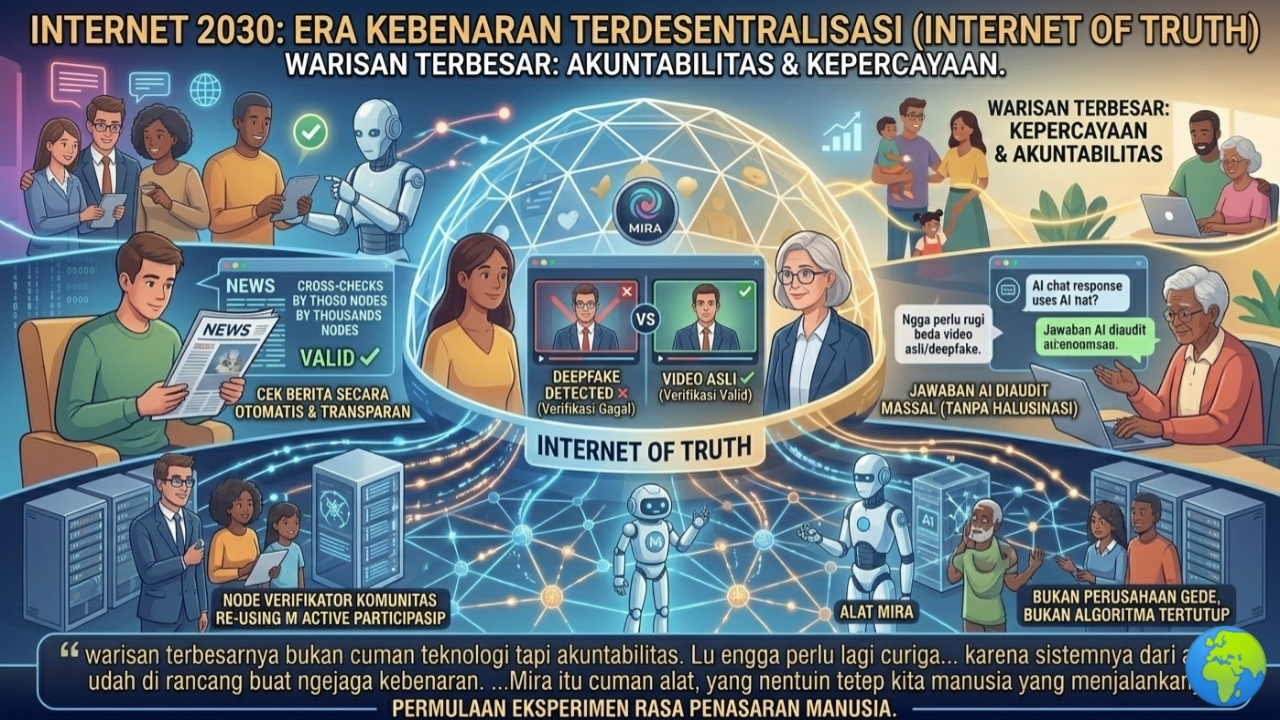

Quando leggi notizie, guardi video o fai domande a un'AI, in realtà esiste uno strato trasparente dietro le quinte che lavora continuamente per verificare se l'informazione è valida o meno. Tutto questo non è una grande azienda, non è un algoritmo chiuso che determina la verità, ma una rete di verifica aperta simile a Internet Of Truth.

E se ci pensi, il suo lascito più grande non è solo la tecnologia ma l'accountability. Non hai più bisogno di sospettare e non devi più complicarti la vita a distinguere tra video autentici e video deepfake, perché il sistema è progettato fin dall'inizio per mantenere la verità.

Di tutti gli articoli che ho scritto finora, questo non è la fine ma l'inizio di un esperimento e della mia curiosità su come gli esseri umani possano mantenere un legame con la verità nell'era dell'AI. E sinceramente, Mira è solo uno strumento, ma siamo noi umani a decidere come procedere.