AI kłamie na nas.

Nieintencjonalnie. Nie złośliwie.

Ale z pewnością.

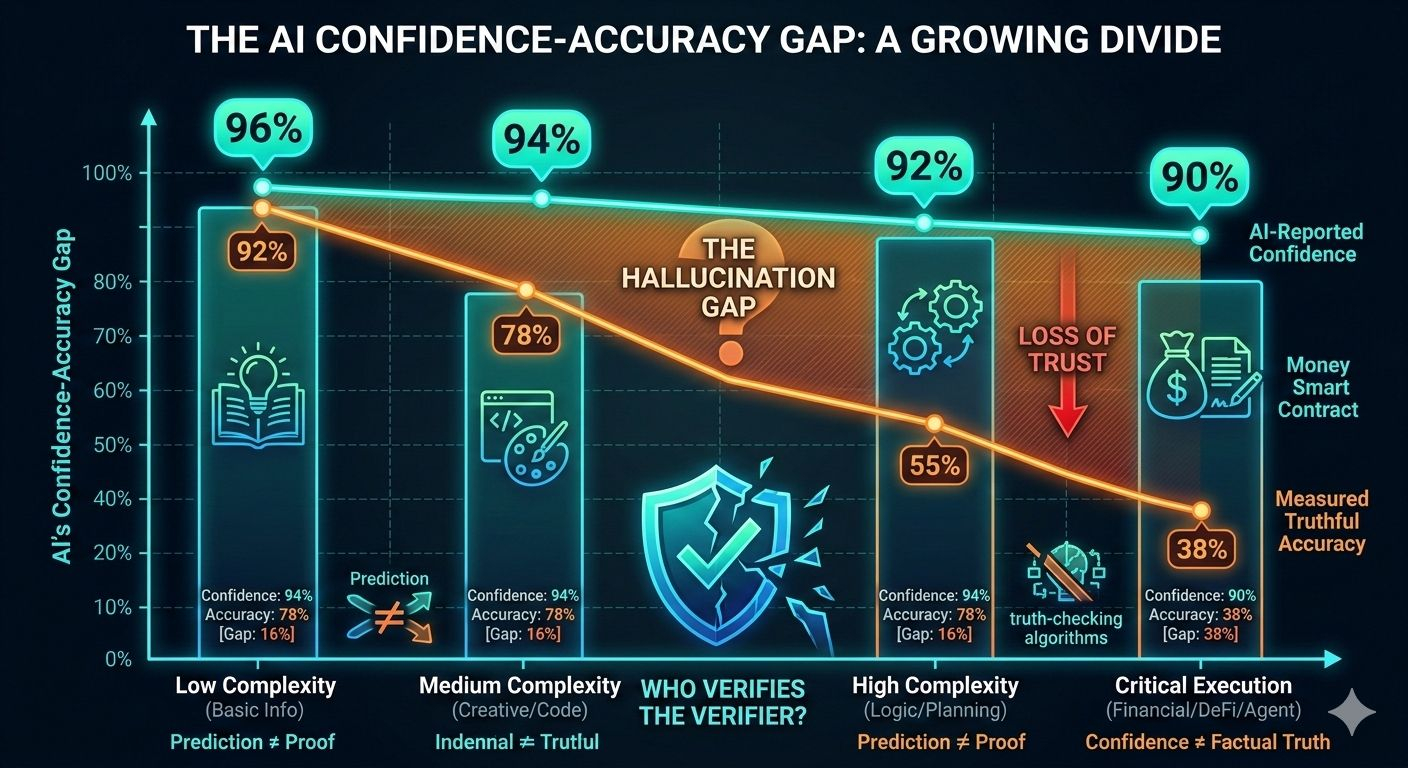

Każdego dnia widzę, jak systemy AI generują odpowiedzi, które wyglądają idealnie — uporządkowane, płynne, przekonujące. Jednak pod tym połyskiem kryją się subtelne błędy, sfabrykowane odniesienia, niekompletne rozumowanie i wbudowane uprzedzenia. Prawdziwe niebezpieczeństwo nie polega na tym, że AI popełnia błędy. Prawdziwe niebezpieczeństwo polega na tym, że robi to z pewnością.

Gdy AI rozszerza się od chatbotów do autonomicznych agentów, systemów finansowych, narzędzi rządowych i silników decyzyjnych, wciąż zadaję jedno pytanie:

Kto weryfikuje weryfikatora?

Prognoza to nie dowód. Inteligencja to nie prawda. A zaufanie nie może być zlecone jednemu zcentralizowanemu modelowi.

Przyszłość AI nie będzie definiowana przez to, jak szybko generuje odpowiedzi. Będzie definiowana przez to, jak wiarygodnie te odpowiedzi można zweryfikować.

To jest miejsce, w którym Mira zmienia równanie.

Strukturalny problem współczesnego AI

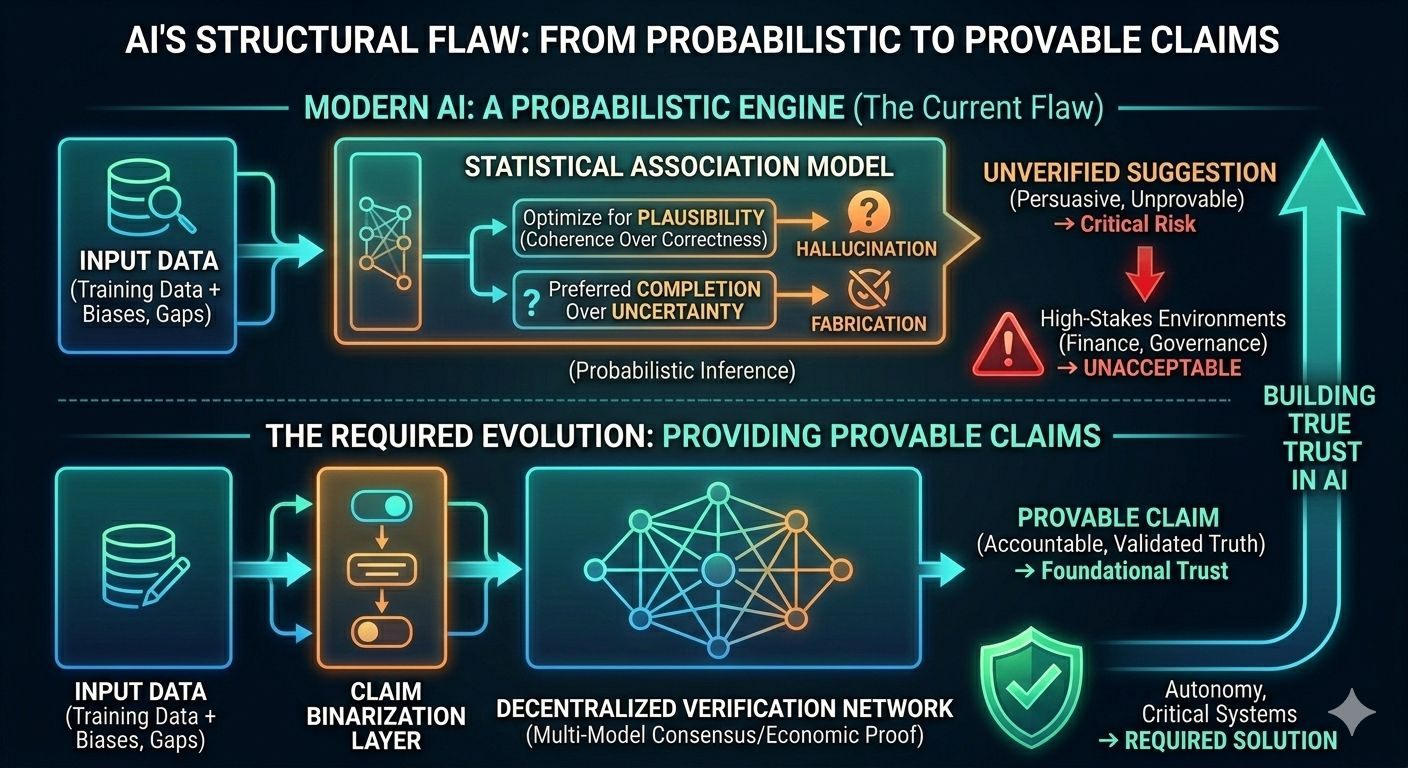

Większość systemów AI działa jako silniki probabilistyczne. Przewidują najbardziej prawdopodobne następne słowo, następny numer lub następny wzór. Nie „wiedzą” faktów w ludzkim sensie. Symulują zrozumienie przez stowarzyszenie statystyczne.

To działa imponująco dobrze — dopóki nie przestaje.

Halucynacje zdarzają się, ponieważ model optymalizuje dla prawdopodobieństwa, a nie poprawności. Stronniczość występuje, ponieważ dane treningowe odzwierciedlają historyczny brak równowagi. Fałszowanie zachodzi, ponieważ model preferuje ukończenie nad niepewnością.

W niskoryzykownych środowiskach jest to zarządzalne. W środowiskach o wysokich stawkach, takich jak finanse, infrastruktura, rządzenie czy autonomiczne wykonanie, staje się to nieakceptowalne.

Jeśli AI ma zasilać systemy podejmowania decyzji, jego wyniki nie mogą pozostawać nieweryfikowanymi sugestiami. Muszą stać się dowodowymi roszczeniami.

Weryfikacja to brakująca warstwa

Gdy patrzę na ewolucję internetu, widzę wzór. Zaczęliśmy od informacji. Potem zbudowaliśmy warstwy bezpieczeństwa. Następnie zbudowaliśmy warstwy zaufania.

AI dzisiaj jest nadal na etapie „informacji”.

To, co brakuje, to warstwa weryfikacji — mechanizm, który przekształca wyjścia AI w coś odpowiedzialnego.

Zamiast traktować odpowiedź jako prawdę, powinniśmy traktować ją jako roszczenie. Roszczenie, które można przetestować. Zweryfikować. Potwierdzić. Lub odrzucić.

To dokładnie architektoniczna zmiana, którą wprowadza Mira.

Jak Mira rozwiązuje problem

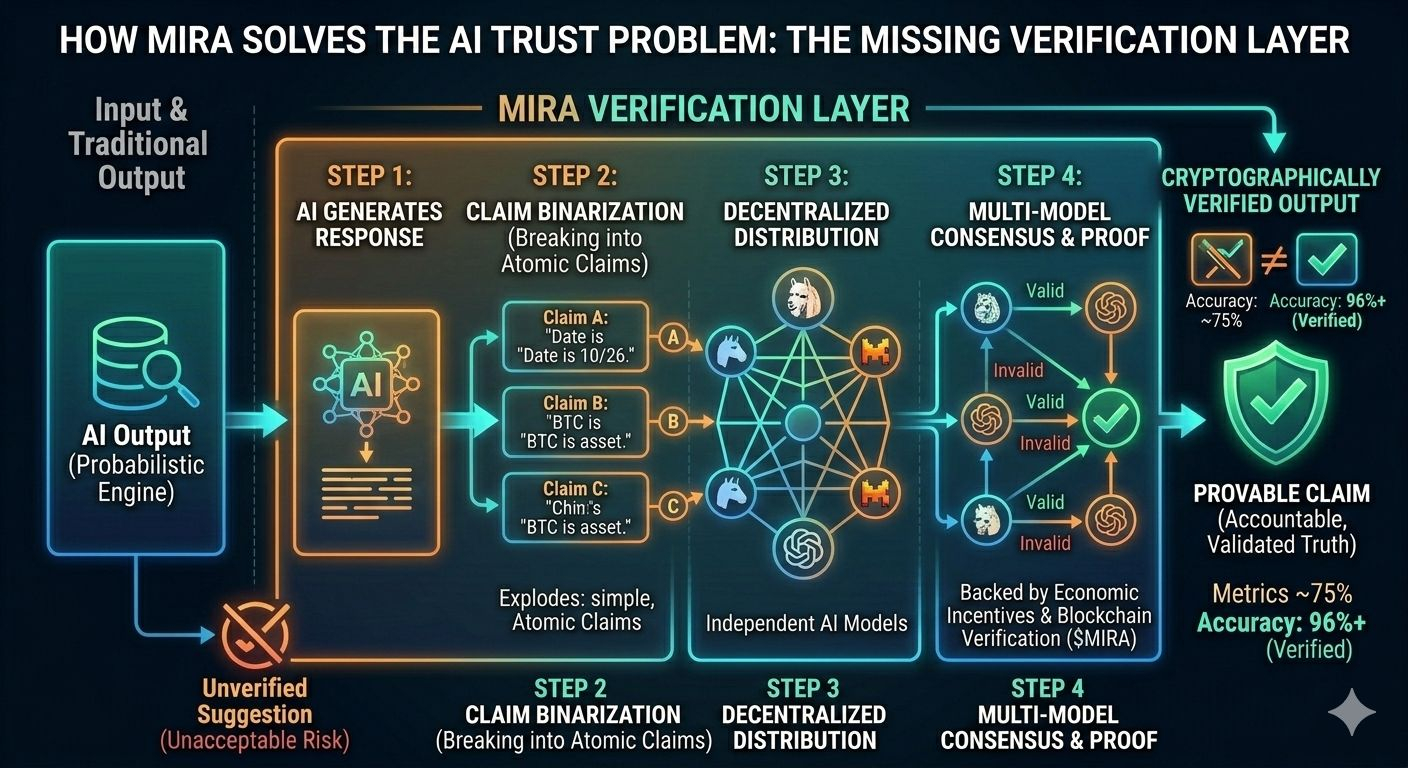

Mira nie stara się uczynić jednego modelu AI doskonałym. Zamiast tego, przekształca sposób, w jaki weryfikowane są wyniki.

Oto jak to rozumiem:

Po pierwsze, AI generuje odpowiedź.

Po drugie, ta odpowiedź jest rozkładana na mniejsze, weryfikowalne roszczenia.

Po trzecie, te roszczenia są rozdzielane w zdecentralizowanej sieci niezależnych modeli AI.

Po czwarte, sieć ocenia te roszczenia przez konsensus, wspierany przez zachęty ekonomiczne i weryfikację blockchain.

Wynik to nie tylko odpowiedź. To kryptograficznie zweryfikowane wyjście.

Zamiast zcentralizowanego zaufania, Mira używa rozproszonej weryfikacji.

Zamiast ślepego akceptowania, wprowadza strukturalną odpowiedzialność.

Zamiast zakładać, że inteligencja równa się dokładności, udowadnia to.

Dlaczego to ma znaczenie dla przyszłości

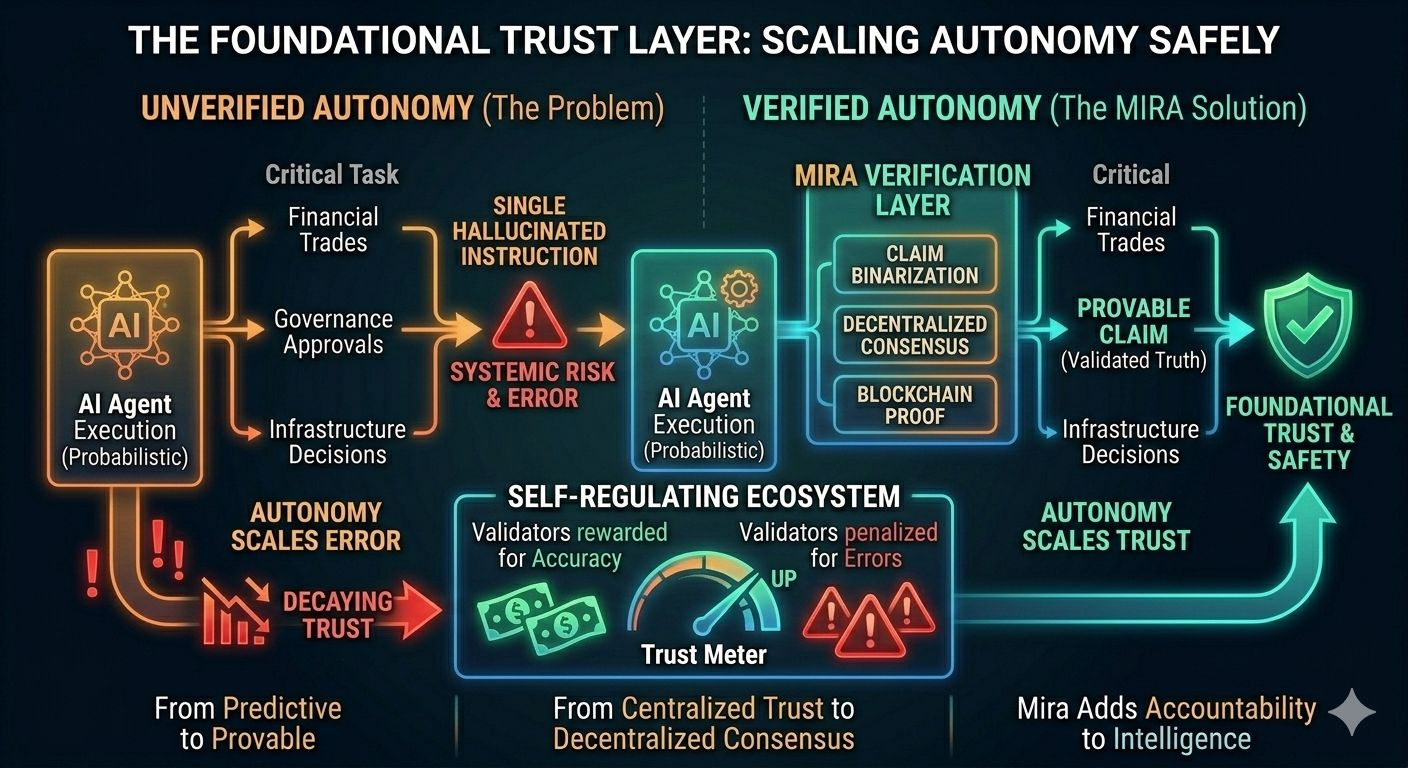

W miarę jak AI staje się autonomiczne, weryfikacja staje się fundamentem.

Wyobraź sobie agentów AI wykonujących transakcje finansowe. Lub zatwierdzających propozycje rządowe. Lub koordynujących decyzje infrastrukturalne. Pojedyncza halucynowana instrukcja może stworzyć ryzyko systemowe.

Bez weryfikacji, autonomia skaluje błąd.

Dzięki weryfikacji, autonomia skaluje zaufanie.

Mira łączy zachęty ekonomiczne z prawdą. Weryfikatorzy są nagradzani za dokładną weryfikację i karani za niepoprawną walidację. To tworzy system samoregulujący, w którym dokładność jest ekonomicznie racjonalna.

Zmniejsza również stronniczość dzięki różnorodności. Gdy wiele niezależnych modeli weryfikuje roszczenia, błędy są mniej prawdopodobne do przetrwania konsensusu.

W prostych słowach, Mira dodaje odpowiedzialność do inteligencji.

AI + Blockchain: Konieczna konwergencja

Nie widzę AI i blockchain jako konkurencyjnych technologii. Widzę je jako komplementarne.

AI generuje inteligencję w skali.

Blockchain weryfikuje to w skali.

Razem tworzą nową architekturę zaufania dla świata cyfrowego.

Jeśli AI ma zasilać następne pokolenie zdecentralizowanych systemów, musi przejść od wyjścia probabilistycznego do wyjścia dowodowego.

Ta zmiana zmienia wszystko.

Większe pytanie

Pytanie nie brzmi już, czy AI może generować imponujące odpowiedzi.

Wyraźnie może.

Prawdziwe pytanie brzmi, czy te odpowiedzi można ufać bez nadzoru ludzkiego.

Weryfikacja przekształca AI z perswazyjnego na odpowiedzialne.

Od predykcji do dowodu.

Od zcentralizowanego zaufania do zdecentralizowanego konsensusu.

A ta transformacja może zdefiniować następną erę inteligentnych systemów.

Mira nie tylko poprawia dokładność AI.

Buduje warstwę zaufania, której AI zawsze potrzebowało. $MIRA