Ciągle wracam do prostego pytania.

Co się stanie, gdy system AI musi bronić się przed kimś, kto jest opłacany za jego wątpliwości?

Nie jest to demonstracja produktu. Nie jest to wykres porównawczy. To prawdziwe pomieszczenie z doradcą prawnym, oficerami ds. zgodności, może z regulatorem dzwoniącym zdalnie. AI wygenerowało raport — prognozy finansowe, podsumowania narażenia na ryzyko lub memorandum due diligence. Wygląda na dopracowane. Logika jest spójna. Ale jeden akapit zawiera założenie, które nie może być przypisane do obronnego źródła.

Teraz zespół prawny przedsiębiorstwa wpatruje się w to.

„Skąd wzięło się to twierdzenie?”

A nikt w pokoju nie może odpowiedzieć z precyzją.

To jest miejsce, gdzie niezawodność przestaje być technicznym wskaźnikiem i staje się problemem odpowiedzialności.

Przywykliśmy do wyników AI w środowiskach o niskich stawkach. Pisanie e-maili. Burze mózgów. Podsumowywanie dokumentów. Ale pod presją odpowiedzialności — audyt, regulacje, narażenie na umowy — niezawodność AI zawodzi w bardzo specyficzny sposób. Zawodzi w kwestii ograniczeń.

Nie chodzi tylko o to, że modele halucynują. Chodzi o to, że kiedy to robią, błąd jest wpleciony w płynną narrację. System produkuje wnioski, nie zachowując struktury, w jaki sposób te wnioski zostały skonstruowane. Kiedy poddawane są wątpliwościom, dostawca może zaoferować ogólne zapewnienia — dane treningowe modelu, ramy oceny, warstwy bezpieczeństwa — ale żadne z tego nie odpowiada na konkretne pytanie przed zespołem prawnym.

Skąd wzięła się ta liczba?

Tradycyjne odpowiedzi na ten problem wydają się strukturalnie kr fragile.

Centralizowany audyt oznacza zaufanie do wewnętrznego procesu przeglądu dostawcy AI. Działa to dopóki motywacje się nie rozdzielają. Dostosowanie modelu do danych z danej dziedziny redukuje błędy powierzchniowe, ale nie tworzy zewnętrznej odpowiedzialności. „Zaufaj dostawcy” staje się pozycją zapasową, i działa to aż do momentu, gdy coś istotnego pójdzie źle.

Instytucje zachowują się przewidywalnie pod presją odpowiedzialności. Spowalniają. Centralizują podejmowanie decyzji. Wymagają dokumentacji. A jeśli dokumentacja nie może być dostarczona, wycofują się z automatyzacji.

Niezawodność, w tym kontekście, jest mniej związana z inteligencją, a bardziej z obronnością.

To jest miejsce, gdzie znajduję @Mira - Trust Layer of AI interesujące — nie dlatego, że obiecuje idealne AI, ale dlatego, że przekształca niezawodność w problem koordynacji.

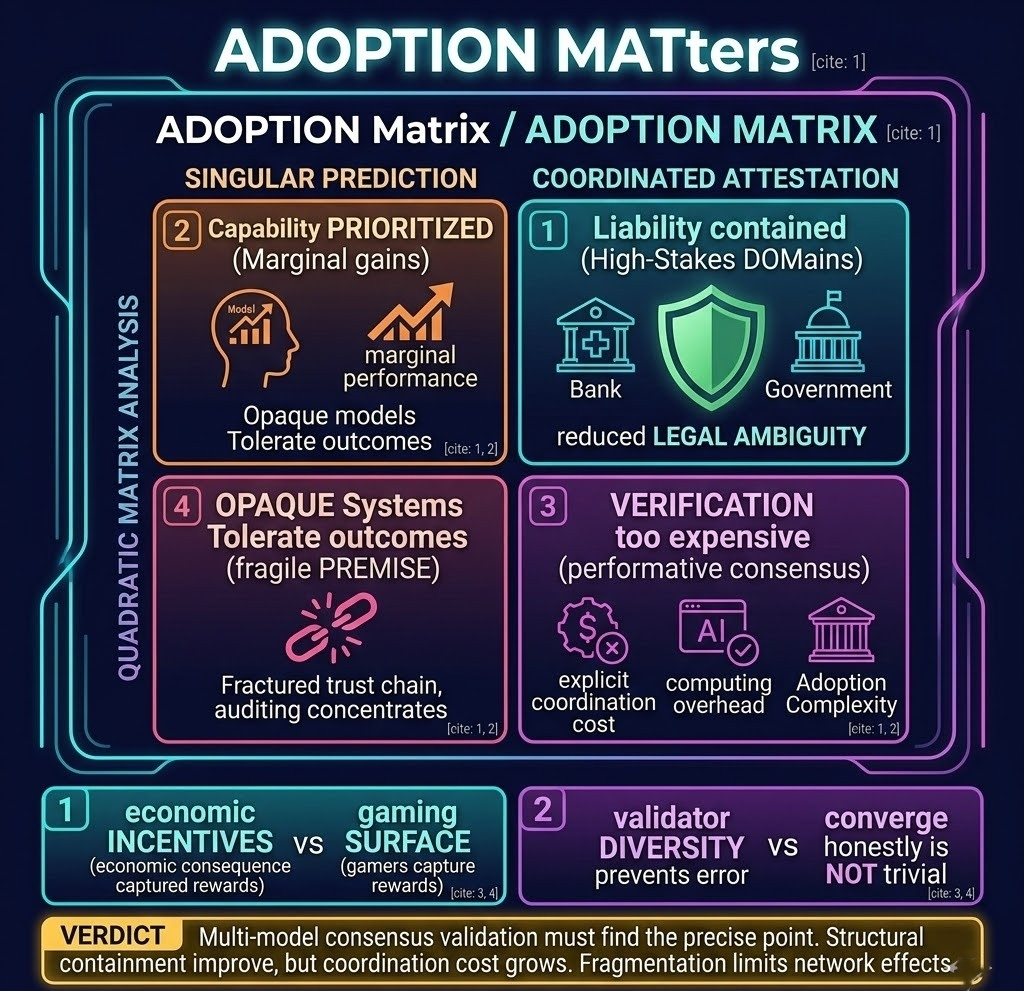

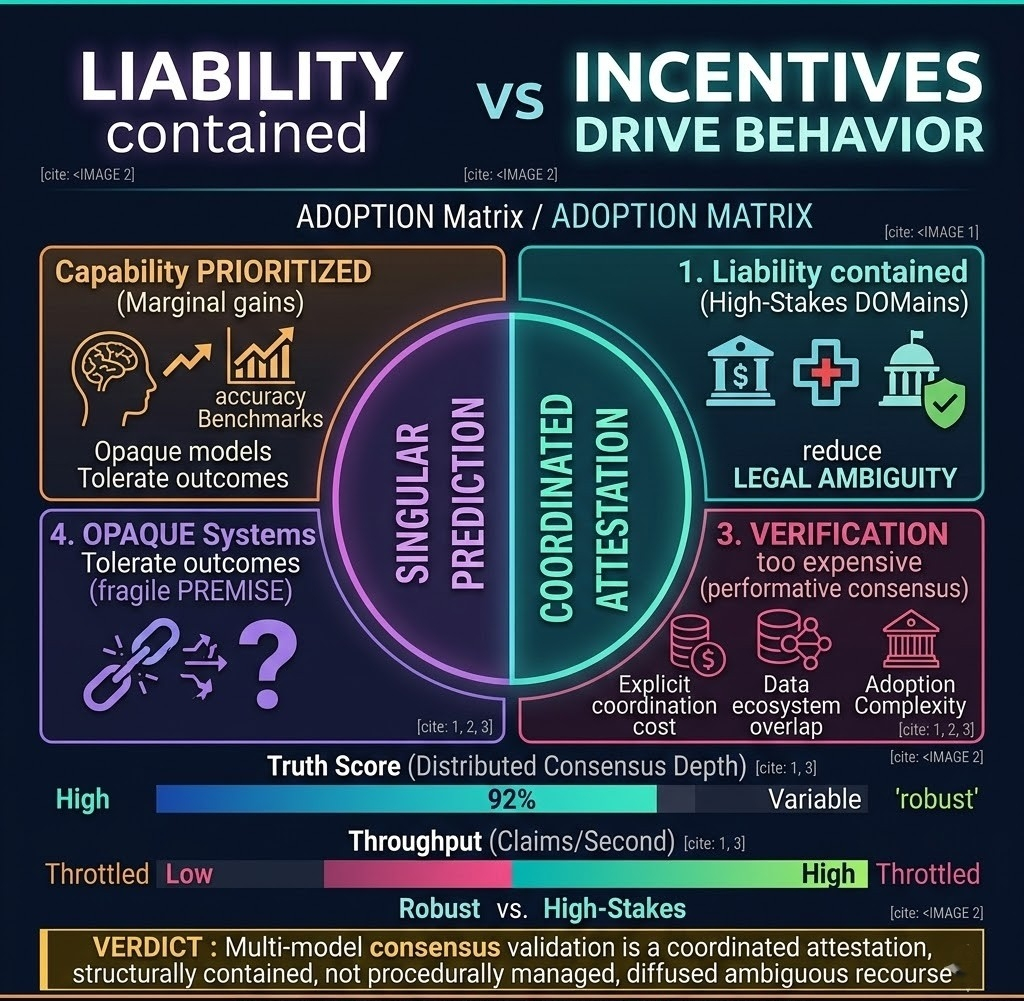

Zamiast traktować wynik AI jako pojedynczą monolityczną odpowiedź, Mira dekomponuje go na dyskretne, weryfikowalne twierdzenia. Wygenerowany raport staje się zbiorem asercji. Każda asercja może być następnie oceniana niezależnie przez sieć modeli i uczestników. Walidacja nie jest wewnętrzna dla jednego dostawcy. Jest rozproszona i ekonomicznie motywowana.

Ta strukturalna zmiana ma znaczenie.

W wcześniejszym mikro-scenariuszu — zespół prawny kwestionujący raport — tarcie istnieje, ponieważ wynik AI jest nieprzezroczysty. Brakuje mu modułowej odpowiedzialności. Dzieląc złożone wyniki na weryfikowalne jednostki, Mira stara się wprowadzić ograniczenie. Jeśli konkretne twierdzenie nie przejdzie walidacji, błąd jest lokalizowany, a nie rozprzestrzeniony po całym dokumencie.

Ograniczenie zmniejsza promień eksplozji.

Ale wprowadza nowy koszt: koordynację.

Dekompzycja twierdzeń brzmi schludnie w teorii. W rzeczywistości, wzięcie długiego łańcucha rozumowania i podzielenie go na małe, samodzielne twierdzenia nie jest tak proste, jak się wydaje. Kontekst wycieka. Powiązania tworzą się między twierdzeniami. System musi zdecydować, co kwalifikuje się jako jednostka weryfikacji, a co pozostaje interpretacyjne.

Ta decyzja nie jest neutralna. Wprowadza zarządzanie do architektury.

Jest też ekonomiczna strona tego. Mira opiera się na zachętach. Osoby, które poprawnie weryfikują informacje, są nagradzane. Ci, którzy weryfikują coś nieprawidłowo, tracą.

Jednak systemy zachęt niosą ze sobą swoją własną kruchość. Zakładają, że weryfikatorzy są racjonalni, wystarczająco różnorodni i ekonomicznie zmotywowani do zachowania uczciwości. Jeśli walidacja stanie się zbyt kosztowna w stosunku do nagrody, uczestnictwo spada. Jeśli zachęty są źle wycenione, pojawiają się ryzyka koluzji. Niezawodność staje się funkcją ekonomiki tokenów.

Jedna ostra prawda leży pod tym wszystkim: weryfikacja nie jest darmowa.

Instytucje często to niedoszacowują. Chcą, aby AI było szybkie i tanie, ale chcą też, aby przetrwało audyt.#Mira skutecznie argumentuje, że niezawodność musi być kupowana poprzez strukturalną weryfikację. Kompromis to prędkość i prostota.

W obszarach o wysokich stawkach — finanse, opieka zdrowotna, zgodność prawna — ten kompromis może być akceptowalny. Instytucja może tolerować wolniejsze wyniki, jeśli zyskuje obronność. Pod presją odpowiedzialności AI, zachowanie się zmienia. Decydenci nie pytają: „Czy ten model jest najnowocześniejszy?” Pytają: „Czy mogę to wyjaśnić, jeśli zostanę wezwany do sądu?”

Grawitacja weryfikacji zaczyna ciągnąć mocniej niż metryki wydajności.

Ale przyjęcie nie jest automatyczne.

Te zmiany zajmują czas. Obejmują wiele zespołów, budżetów i kontroli zgodności. Tak więc wahanie nie jest oporem wobec postępu. To rzeczywistość tego, jak głęboko wbudowane systemy są tworzone — i jak kosztowne może być ich przekształcenie. Komitety zarządzające muszą zrozumieć, jak rozwiązywane są spory. Kto ponosi odpowiedzialność, jeśli zweryfikowane twierdzenie później okazuje się błędne? Sieć? Przedsiębiorstwo? Dostawca modelu?

Istnieje także tarcie związane z migracją. Duzi dostawcy AI już kontrolują dystrybucję. Jeśli oferują wewnętrzne funkcje przejrzystości, instytucje mogą preferować stopniowe aktualizacje zamiast integrowania zewnętrznej infrastruktury. Ryzyko koncentracji platform działa w obie strony: zależność od jednego dostawcy wydaje się niebezpieczna, ale koordynacja w nowej zdecentralizowanej warstwie wprowadza nieznaną złożoność.

Strukturalne założenie Miri jest takie, że presja odpowiedzialności nasili się szybciej, niż dotychczasowi gracze będą w stanie wygodnie to wchłonąć. To założenie wydaje się plausible — regulacyjna kontrola rośnie — ale nie jest gwarantowane. Regulatorzy mogą zaakceptować łagodniejsze standardy wyjaśnialności, szczególnie jeśli systemy AI pozostają probabilistyczne z założenia. Jeśli regulacyjna poprzeczka pozostaje niejasna, pilność dla zewnętrznych warstw weryfikacji słabnie.

Na poziomie ekosystemu staje się to pytaniem o zarządzanie.

Czy chcemy, aby niezawodność AI była zintegrowana pionowo w dominujących platformach, czy poziomo rozproszona w niezależnych sieciach weryfikacyjnych? To pierwsze jest prostsze. To drugie rozdziela władzę, ale zwiększa koszt koordynacji.

Mira skłania się ku poziomemu rozproszeniu.

To ma filozoficzną atrakcyjność. Zdecentralizowana walidacja redukuje pojedyncze punkty awarii. Dostosowuje się do świata, w którym żaden pojedynczy dostawca AI nie powinien monopolizować autorytetu epistemicznego. Ale systemy rozproszone wprowadzają opóźnienie, złożoność i tarcie w zarządzaniu. Spory muszą być rozwiązywane. Zachęty ekonomiczne muszą być skalibrowane. Uczestnictwo musi być utrzymywane.

Ograniczenie pozostaje tutaj kotwicą.

Pod presją odpowiedzialności instytucje nie szukają tylko inteligencji. Szukają ograniczenia ryzyka. Dekompzycja twierdzeń Miri i walidacja wielomodelowa starają się stworzyć to ograniczenie strukturalnie, a nie proceduralnie.

Pytanie brzmi, czy koszt koordynacji przewyższa korzyści z modułowej odpowiedzialności.

Jeśli AI nadal będzie przechodzić w autonomiczne role — zatwierdzanie transakcji, generowanie dokumentów regulacyjnych, kierowanie decyzjami medycznymi — warstwy weryfikacji mogą stać się mniej opcjonalne. Przyjęcie byłoby wtedy motywowane redukcją odpowiedzialności. Dostawcy ubezpieczeń, audytorzy i regulatorzy mogliby pośrednio skłonić przedsiębiorstwa do weryfikowalnych wyników AI.

Ale jeśli AI pozostanie doradcze, a nie autorytatywne w krytycznych systemach, organizacje mogą tolerować niejasności. Mogą zaakceptować „wystarczającą” niezawodność, szczególnie jeśli scentralizowani dostawcy oferują gwarancje umowne.

Ostatecznie, Mira nie rozwiązuje halucynacji w izolacji. Testuje, czy niezawodność może być zewnętrzna — przekształcona z wewnętrznej cechy modelu w wspólny proces ekonomiczny.

To jest strukturalne ryzyko.

Jeśli grawitacja weryfikacji wzmacnia się, zdecentralizowana walidacja staje się infrastrukturą. Jeśli słabnie, koszt koordynacji może wydawać się nieuzasadniony.

Nie jestem pewien, która siła będzie dominować.

Co jest jasne, to to, że gdy wyniki AI muszą przetrwać audyt, samo zaufanie przestaje być wystarczające. System albo buduje ograniczenie w swojej architekturze, albo instytucje cicho ograniczą, jak daleko autonomia może się rozprzestrzeniać.

$MIRA siedzi w tej napiętej sytuacji.

A na razie napięcie pozostaje nierozwiązane.