Sztuczna inteligencja jest teraz częścią codziennego życia. Pomaga pisać e-maile, odpowiadać na pytania, podsumowywać badania, a nawet kierować decyzjami finansowymi. Ale istnieje poważny problem.

AI może popełniać błędy i często brzmi bardzo pewnie siebie, nawet gdy się myli.

Czasami AI podaje odpowiedź, która wydaje się dokładna, ale nie jest całkowicie poprawna. W rzeczywistości badania wykazały, że duże modele językowe mogą generować nieprawidłowe lub wprowadzające w błąd informacje w aż 15% przypadków, w zależności od złożoności zadania.

To się dzieje, ponieważ modele AI przewidują odpowiedzi na podstawie wzorców, a nie prawdziwego zrozumienia. W prostych przypadkach użytkowania, to może nie mieć dużego znaczenia. Ale w poważniejszych środowiskach, niezawodność staje się ważna.

To jest miejsce, gdzie @Mira - Trust Layer of AI wchodzi w grę.

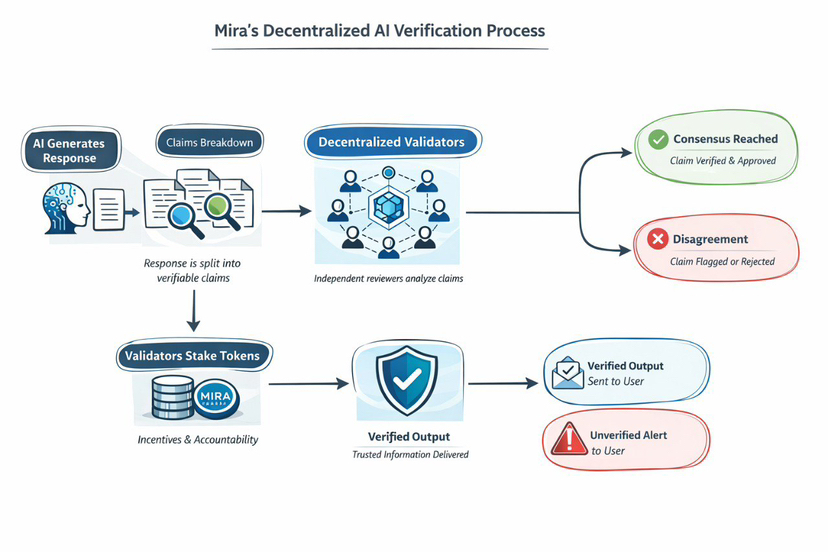

Mira Network buduje system, który sprawdza wyniki AI przed ich zaufaniem. Zamiast polegać na jednym modelu, aby dać ostateczną odpowiedź, Mira wykorzystuje wielu niezależnych walidatorów do przeglądania odpowiedzi.

Oto jak to działa w prostych słowach.

Najpierw AI generuje odpowiedź. Mira następnie dzieli tę odpowiedź na mniejsze stwierdzenia. Te stwierdzenia są wysyłane do różnych walidatorów w sieci. Każdy walidator sprawdza, czy stwierdzenia wydają się dokładne, czy nie. Po tym system patrzy na ogólną zgodność między nimi.

Jeśli większość walidatorów zgadza się, że odpowiedź jest poprawna, przechodzi weryfikację. Jeśli występuje niezgodność, wynik może być oznaczony lub odrzucony.

Pomysł jest prosty, zamiast ufać jednemu źródłu, ufaj zgodzie wielu.

To podejście jest inspirowane tym, jak działają systemy zdecentralizowane. W sieciach blockchain transakcje nie są potwierdzane przez jedną władzę. Są weryfikowane przez wielu uczestników. Mira stosuje podobny pomysł do odpowiedzi AI.

Sieć wykorzystuje również zachęty, aby zachęcić do uczciwego uczestnictwa. Walidatorzy muszą stakować $MIRA tokeny, aby być częścią systemu.

Jeśli działają uczciwie i zapewniają dokładne kontrole, zdobywają nagrody. Jeśli działają lekkomyślnie lub próbują manipulować wynikami, ryzykują utratę części swojego stawki.

To tworzy odpowiedzialność. Walidatorzy mają coś do stracenia, więc są zmotywowani do bycia dokładnymi.

Ważne jest, aby zrozumieć, że Mira nie próbuje zbudować lepszego modelu AI. Nie konkuruje z dużymi firmami AI. Zamiast tego koncentruje się na dodaniu warstwy weryfikacyjnej na szczycie istniejących systemów AI.

Pomyśl o tym jak o systemie recenzji dla wyników AI. Celem nie jest doskonałość. Celem jest zmniejszenie błędów i dodanie dodatkowej warstwy zaufania przed podjęciem decyzji na podstawie odpowiedzi AI.

W miarę jak AI staje się coraz bardziej powszechne w różnych branżach, potrzeba niezawodności rośnie. Mira Network koncentruje się na rozwiązaniu tego konkretnego problemu, jak uczynić wyniki AI bardziej wiarygodnymi bez polegania na jednym scentralizowanym źródle.

Mówiąc prosto, Mira buduje system, który sprawdza AI, zanim na nim polegnię.

#Mira #AI #MiraNetwork #ArtificialInteligence #DecentralisedAI