Kiedyś myślałem, że niezawodność AI naturalnie poprawi się z upływem czasu, wystarczy tylko zwiększyć modele, dostarczyć im więcej danych, dłużej je trenować, a problem halucynacji powoli zniknie. Rzeczywistość jest taka, że to nie działa w ten sposób. Modele stają się bardziej płynne, tak, ale płynność nie jest tym samym co prawda. To jest to, co przykuło moją uwagę w Mira Network.

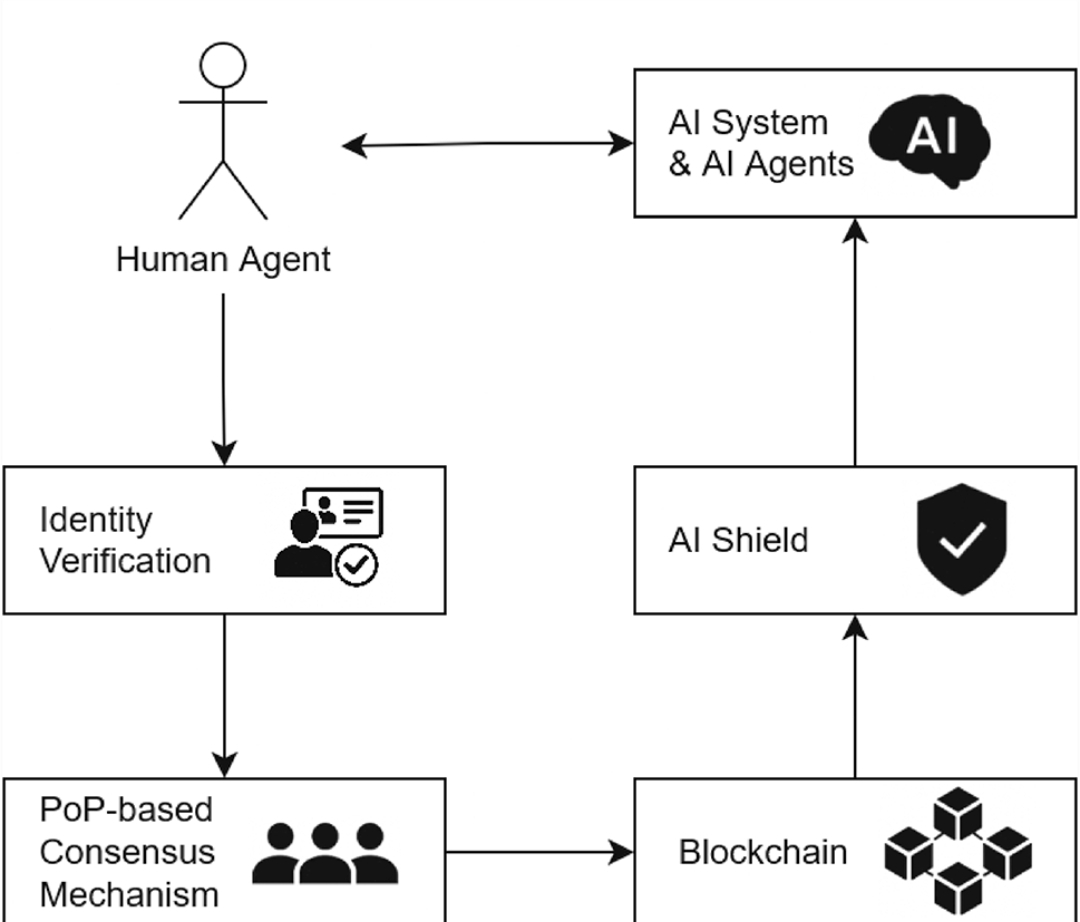

Mira nie stara się konkurować z dużymi laboratoriami AI. To nie jest inny model obiecujący mniejszą liczbę błędów. Został zbudowany jako zdecentralizowana warstwa weryfikacji, która znajduje się po tym, jak AI generuje wyniki, a przed podjęciem decyzji o zaufaniu tym wynikom. To rozmieszczenie ma znaczenie. Zamiast prosić jeden model o poprawność, Mira dzieli swoje wyniki na mniejsze twierdzenia i rozdziela te twierdzenia pomiędzy niezależnych weryfikatorów. Ci weryfikatorzy, którzy mogą być oddzielnymi systemami AI, oceniają każde twierdzenie i osiągają konsensus, korzystając z koordynacji blockchain i zachęt ekonomicznych.

Zamiast polegać na jednej pewnej odpowiedzi, polegasz na rozproszonym porozumieniu. To duża zmiana w tym, jak myślimy o niezawodności AI. Księga blockchain rejestruje decyzje walidacyjne, a struktura zachęt zachęca do uczciwej oceny. Walidatorzy mają udział w procesie, co oznacza, że lekkomyślność ma konsekwencje. Prawda staje się czymś egzekwowanym przez zachęty, a nie tylko reputację.

To, co czyni to teraz istotnym, to wzrost autonomicznych agentów AI. Dopóki ludzie podwójnie sprawdzają wyniki, szkody wynikające z halucynacji pozostają ograniczone. Ale gdy systemy AI zaczynają realizować transakcje finansowe, zatwierdzać przepływy pracy lub generować badania wykorzystywane do poważnych decyzji, tolerancja na błąd maleje. Potrzebujesz wyników, które są audytowalne i weryfikowalne, a nie tylko przekonywujące.

Mira zakłada, że halucynacje się zdarzą. Projektuje wokół tego faktu, zamiast udawać, że znikną. To wydaje się realistyczne. Oczywiście istnieją otwarte pytania dotyczące skalowalności, opóźnienia i różnorodności walidatorów. Rozbijanie złożonego rozumowania na atomowe twierdzenia nie jest trywialne, a ryzyka zmowy muszą być starannie zarządzane.

Wciąż kierunek jest jasny. Inteligencja bez weryfikacji nie rozwija się bezpiecznie. Mira pozycjonuje się jako infrastruktura zaufania dla AI, zamieniając probabilistyczne wyniki w informacje poparte konsensusem. Może nie jest efektowna, ale jeśli AI nadal będzie integrować się w krytyczne systemy, warstwy weryfikacji, takie jak ta, nie będą opcjonalne, będą konieczne.