Większość systemów AI dzisiaj jest dobra w generowaniu odpowiedzi. Są znacznie mniej wiarygodne w ich gwarantowaniu.

Zadajesz pytanie. Model odpowiada z pewnością. Struktura brzmi logicznie. Wyjaśnienie wydaje się kompletne. Ale pod tą odpowiedzią kryje się prosty problem: może być błędna.

Ta niepewność jest niewidzialnym ograniczeniem nowoczesnych systemów wiedzy AI.

Informacje są generowane szybciej, niż mogą być weryfikowane.

Tutaj Mira zaczyna zmieniać równanie.

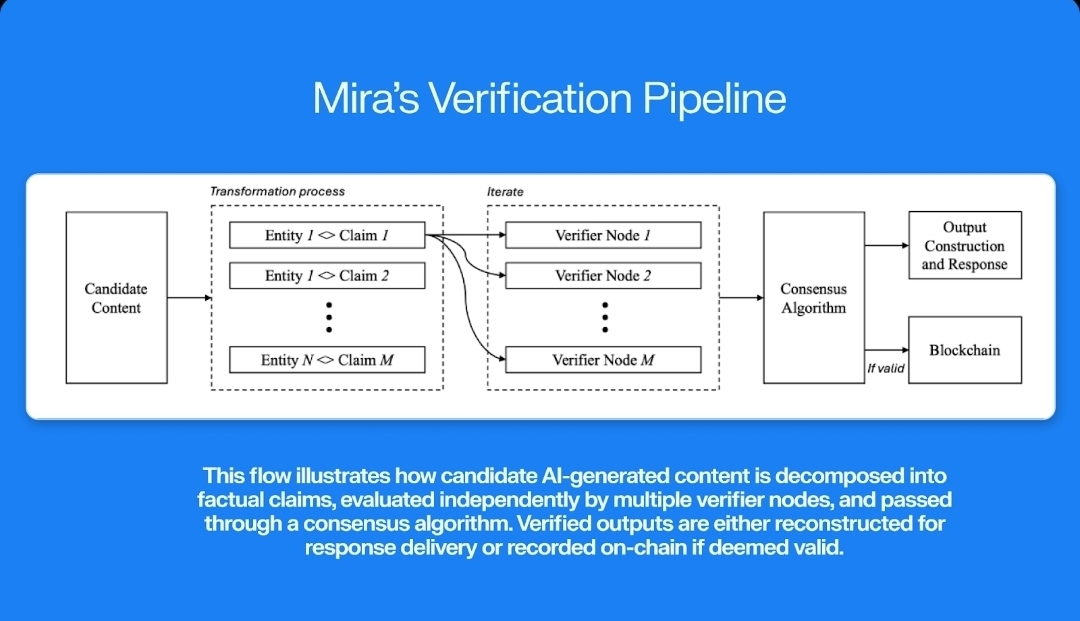

Zamiast traktować wyniki AI jako gotowe odpowiedzi, Mira traktuje je jako twierdzenia, które wymagają weryfikacji. System dzieli generowane treści na mniejsze stwierdzenia, które można niezależnie sprawdzić w zdecentralizowanej sieci weryfikatorów.

Ten proces przekształca sposób, w jaki sama wiedza może być strukturalizowana.

Tradycyjne grafy wiedzy przechowują relacje między podmiotami. Mapują połączenia między ludźmi, miejscami, wydarzeniami i pojęciami w strukturze opartej na grafie, gdzie węzły reprezentują podmioty, a krawędzie reprezentują relacje.

Ale te grafy zazwyczaj zakładają, że informacje w nich zawarte są już poprawne.

W rzeczywistości, większość nowoczesnych grafów wiedzy jest zbudowana z danych zebranych, ludzkiego wkładu lub zautomatyzowanych pipeline'ów ekstrakcji. Błędy mogą cicho propagować się w systemie.

Mira wprowadza inny model.

Zanim informacje staną się częścią grafu, muszą przejść przez weryfikację.

Każde oświadczenie generowane przez model AI może być rozłożone na zorganizowane twierdzenia. Te twierdzenia są rozproszone w wielu niezależnych modelach lub weryfikatorach, które oceniają ich dokładność i osiągają konsensus przed ich zaakceptowaniem.

Po walidacji, te twierdzenia mogą być zakotwiczone jako wiarygodne punkty danych w obrębie grafu wiedzy.

Wynikiem jest graf, który nie tylko przechowuje relacje.

Przechowuje zweryfikowane relacje.

Ta różnica ma większe znaczenie, niż się wydaje.

W normalnym systemie wiedzy AI, informacje są probabilistyczne. System uważa, że coś jest prawdopodobnie prawdziwe, ponieważ widział podobne wzorce w danych treningowych.

W zweryfikowanym grafie wiedzy informacje stają się śledzone. Każdy węzeł i relacja mogą nieść dowód, że twierdzenie zostało ocenione i uzgodnione przez wielu weryfikatorów w sieci.

To zmienia sposób, w jaki systemy AI rozumują.

Zamiast generować odpowiedzi na podstawie luźno połączonych prawdopodobieństw, modele mogą zapytać o zorganizowaną mapę zweryfikowanej wiedzy.

Rozumowanie staje się bardziej wiarygodne, ponieważ sama podstawa została sprawdzona.

Dla autonomicznych agentów AI, to może być krytyczne.

Agenci, którzy działają niezależnie, potrzebują zaufanego źródła informacji. Jeśli ich baza wiedzy zawiera halucynacyjne fakty lub niespójne dane, ich decyzje szybko mogą stać się niewiarygodne.

Zweryfikowany graf wiedzy zmniejsza to ryzyko.

Agenci mogą odnosić się do twierdzeń, które zostały już zweryfikowane przez rozproszoną warstwę weryfikacji, zamiast polegać wyłącznie na swoich własnych prognozach.

Z biegiem czasu tworzy to pętlę zwrotną.

AI generuje wiedzę.

Sieć to weryfikuje.

Zweryfikowane twierdzenia rozszerzają graf wiedzy.

Przyszłe systemy AI zapytują ten graf, aby rozumować dokładniej.

System staje się coraz bardziej wiarygodny w miarę jego rozwoju.

To jest większa wizja stojąca za warstwami weryfikacyjnymi, jak Mira.

Nie tylko naprawiając halucynacje.

Ale budowanie infrastruktury dla zaufanej wiedzy samej w sobie.

Jeśli każde twierdzenie w grafie wiedzy AI niesie dowód weryfikacji, informacje przestają być efemerycznym tekstem produkowanym przez model.

Staje się to zorganizowaną, audytowalną wiedzą.

A gdy wiedza staje się weryfikowalna, systemy AI przestają tak często zgadywać.

Zaczynają rozumować na podstawie czegoś bliższego prawdzie.