Dlaczego niezależna weryfikacja AI staje się kluczowa podczas wojny i kryzysu

Duże modele językowe są trenowane na ogromnych zbiorach danych z internetu. Te dane nie są neutralne. Odzwierciedlają polityczny, kulturowy i instytucjonalny ciężar regionów, które produkują większość treści. Gdy dominująca część materiałów szkoleniowych pochodzi z konkretnego kraju lub ekosystemu medialnego, wzorce ramowania, terminologia i stronniczość narracyjna mogą stać się zakorzenione w modelu.

To nie wymaga złośliwych zamiarów. To jest strukturalne. Modele uczą się statystycznych relacji. Jeśli pewne punkty widzenia są powtarzane częściej, te punkty widzenia zyskują probabilistyczny priorytet w odpowiedziach.

W stabilnych czasach może to wydawać się subtelnym kulturowym skłonieniem. W czasie wojny lub kryzysu geopolitycznego staje się to znacznie poważniejsze.

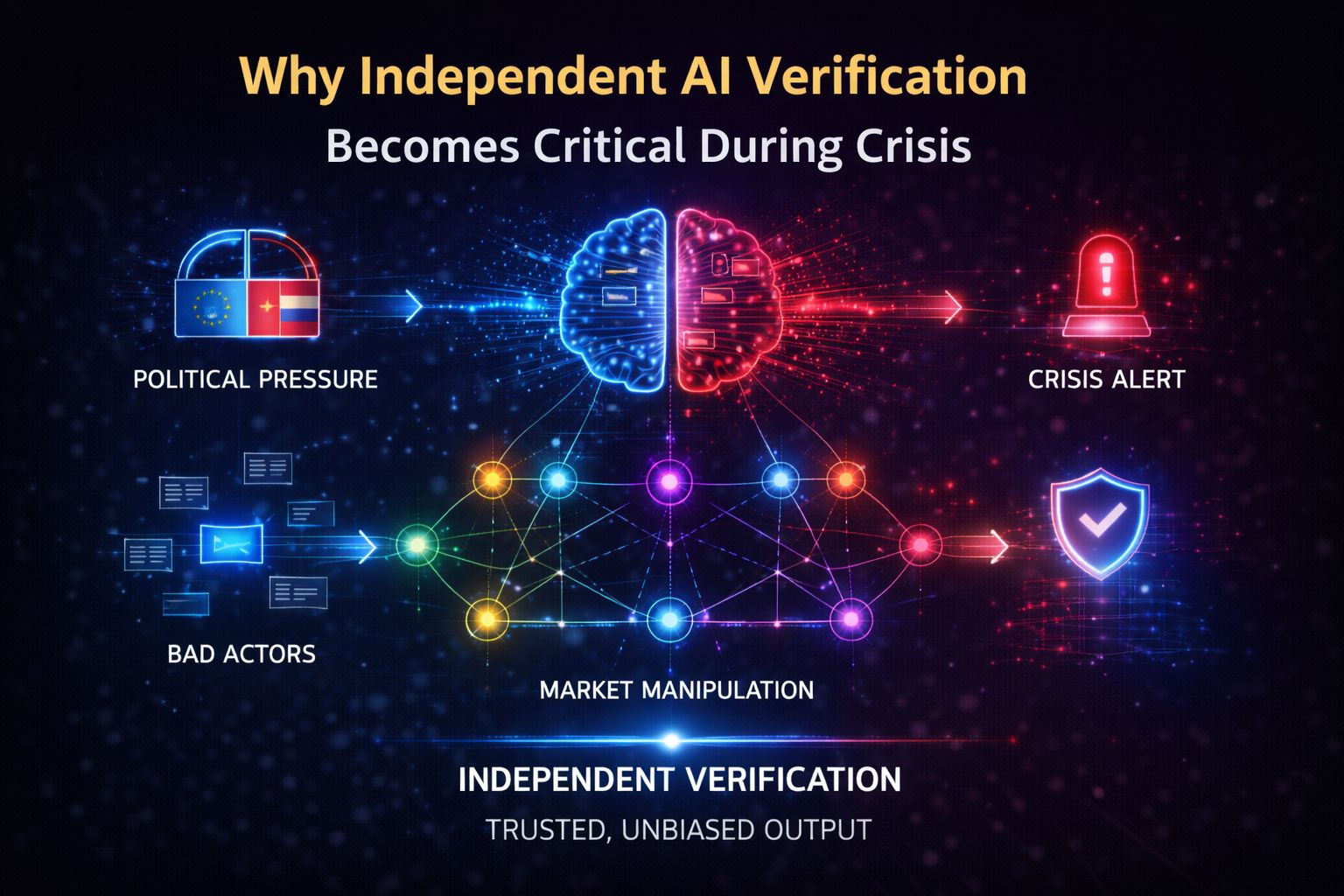

Informacja staje się strategicznym zasobem. Narracje kształtują rynki, opinię publiczną, a nawet postrzeganie pola bitwy. Jeśli systemy AI używane przez traderów, dziennikarzy, analityków lub decydentów odzwierciedlają skoncentrowane regionalne uprzedzenia, konsekwencje szybko się nasilają. Rynki finansowe mogą reagować na zniekształcone podsumowania. Oceny ryzyka mogą dziedziczyć nierównowagę narracyjną. Systemy autonomiczne mogą działać na podstawie niepełnych lub zniekształconych informacji.

Niebezpieczeństwo nie polega na tym, że AI celowo szerzy propagandę. Niebezpieczeństwo polega na tym, że może niezamierzenie wzmocnić dominujące narracje z powodu rozkładu treningu i mechanizmów wzmocnienia.

Niezależna weryfikacja faktów staje się niezbędna w tych warunkach.

To jest miejsce, w którym zdecentralizowana architektura weryfikacji staje się istotna. Zamiast ufać jednemu modelowi trenowanemu pod jednym instytucjonalnym kątem, wyniki mogą być dekomponowane na dyskretne twierdzenia faktograficzne. Każde twierdzenie może być następnie oceniane niezależnie przez różnorodne węzły weryfikujące działające z ekonomicznymi motywacjami skierowanymi ku dokładności, a nie lojalności narracyjnej.

@Mira - Trust Layer of AI dokładnie ten typ struktury.

Zamiast zakładać, że jeden model może wyeliminować swoje własne uprzedzenia, $MIRA wprowadza system, w którym wiele modeli uczestniczy w weryfikacji konsensusu. Weryfikatorzy stawiają wartość, aby uczestniczyć, co tworzy odpowiedzialność. Jeśli konsekwentnie różnią się w sposób sugerujący nieostrożną lub nieuczciwą weryfikację, narażają się na kary ekonomiczne.

Różnorodność odgrywa kluczową rolę. Zdecentralizowana sieć zachęca do heterogenicznych architektur modeli, zróżnicowanych zbiorów treningowych i geograficznie rozproszonych operatorów. Z biegiem czasu zmniejsza to prawdopodobieństwo, że jedna dominująca perspektywa kontroluje wynik.

Innym krytycznym czynnikiem w czasie kryzysu jest prywatność. Wrażliwe dokumenty, streszczenia wywiadowcze lub analizy finansowe nie mogą być szeroko ujawniane. Podejście Miry polegające na dzieleniu treści na granularne twierdzenia i rozkładaniu ich po węzłach oznacza, że żaden pojedynczy weryfikator nie rekonstruuje całego dokumentu, chroniąc poufność przy jednoczesnym zachowaniu integralności weryfikacji.

W czasie wojny lub w geopolitycznych sytuacjach wysokiego napięcia neutralne informacje stają się infrastrukturą. Rynki na tym polegają. Instytucje na tym polegają. Obywatele na tym polegają.

AI jest coraz bardziej wbudowane w procesy badawcze, systemy botów handlowych oraz zautomatyzowane przepływy decyzji i przepływy pracy. W miarę jak wzrasta zależność, wzrasta również potrzeba weryfikowalnej neutralności.

Niezależna weryfikacja faktów nie jest już opcjonalna. Staje się mechanizmem stabilności.

$MIRA oraz #Mira ramy weryfikacji mają na celu stworzenie warstwy zaufania zgodnej z motywacją, która redukuje strukturalne uprzedzenia i zwiększa zaufanie do wyników AI, gdy dokładność ma największe znaczenie.