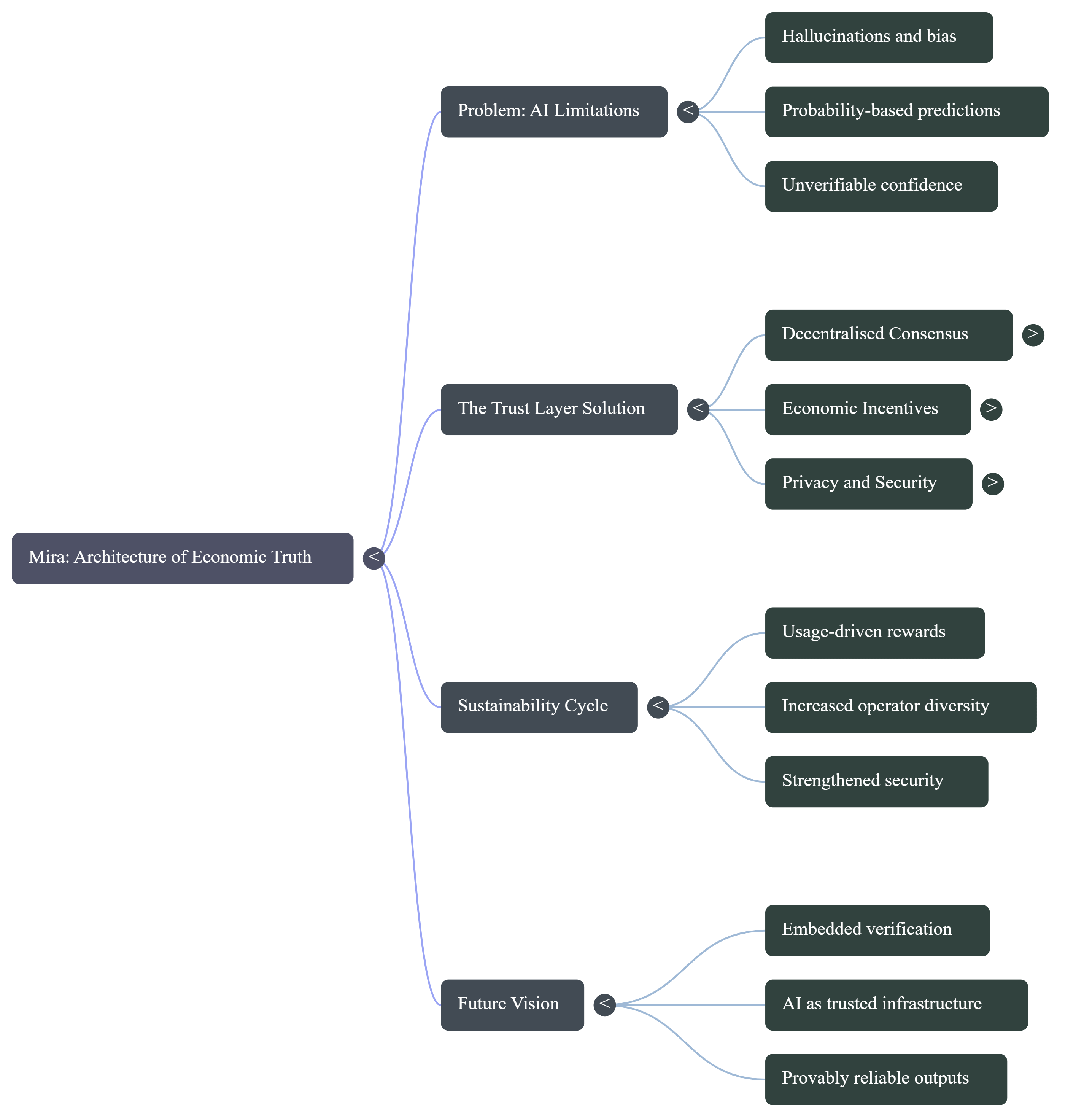

Większość dzisiejszych systemów AI ma jedną dużą słabość.

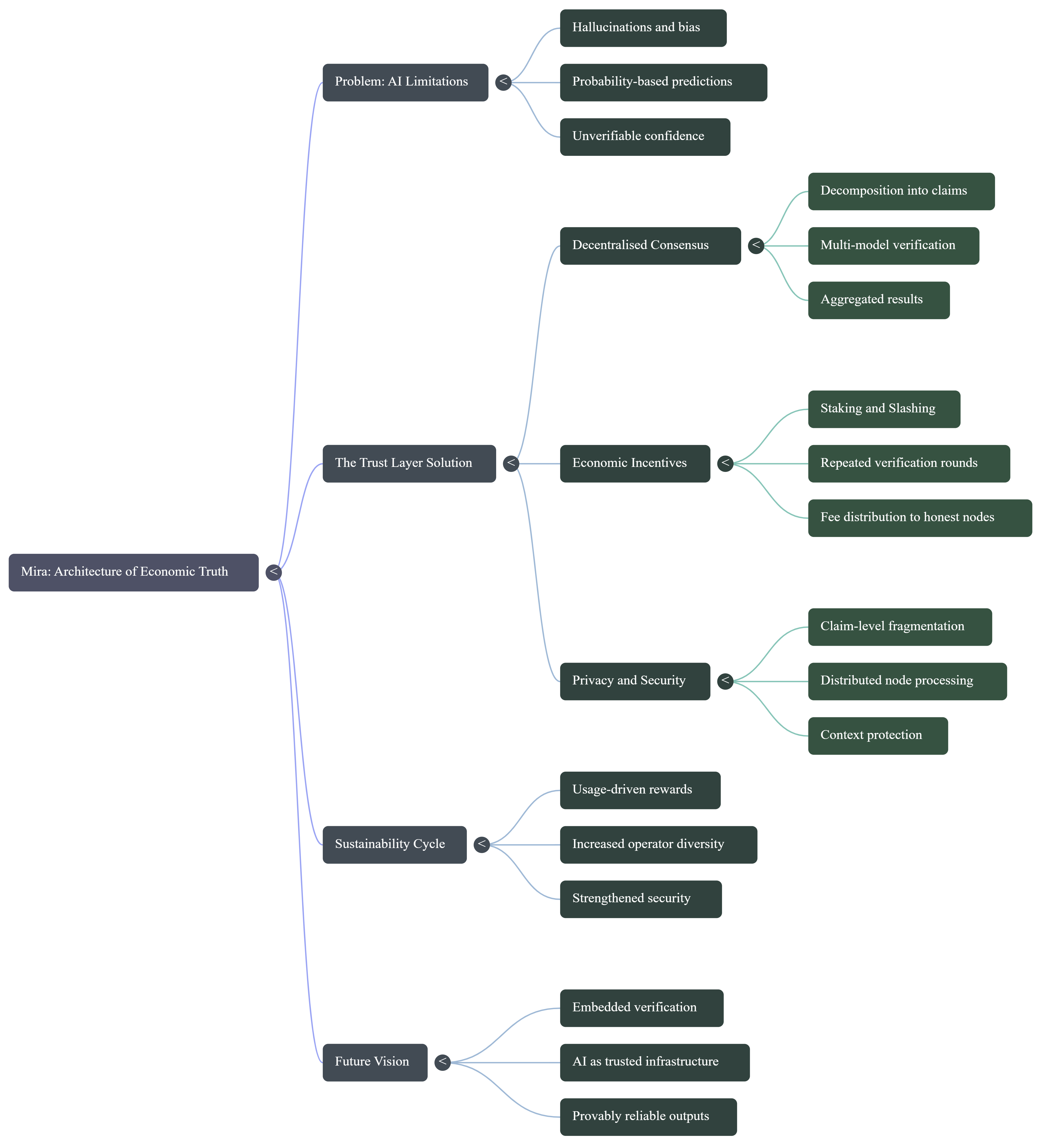

Generują odpowiedzi, które brzmią pewnie, ale nie mogą zagwarantować, że są poprawne. Halucynacje i stronniczość nie są rzadkimi błędami. Pochodzą z tego, jak duże modele są budowane. Te systemy przewidują prawdopodobieństwa, a nie zweryfikowane prawdy. Nawet gdy są dostrajane, wydaje się, że istnieje minimalna stopa błędów, której pojedynczy model nie może w pełni wyeliminować.

Mira zaczyna z innym przekonaniem.

Zamiast próbować zbudować jeden doskonały model, buduje system, w którym wiele modeli weryfikuje się nawzajem.

Zgodnie z @Mira - Trust Layer of AI białą księgą, $MIRA przekształca wyjście AI w mniejsze, niezależne roszczenia. Na przykład długi akapit jest dzielony na jasne stwierdzenia faktu. Każde stwierdzenie jest następnie wysyłane do różnych węzłów weryfikujących. Te węzły przeprowadzają własne wnioskowanie i przesyłają osąd. Sieć agreguje odpowiedzi i produkuje wynik konsensusu.

Ten proces redukuje zarówno halucynacje, jak i stronniczość, ponieważ żaden pojedynczy model nie kontroluje wyniku.

Ale sama weryfikacja nie wystarczy. Zachęty są ważne.

$MIRA łączy pracę opartą na wnioskowaniu z stakingiem. Weryfikatorzy muszą zablokować wartość, aby uczestniczyć w sieci. Jeśli spróbują oszukać system, zgadując odpowiedzi lub przesyłając niedbałe odpowiedzi, ryzykują utratę swojego wkładu poprzez slashing.

Biała księga nawet wyjaśnia, dlaczego to jest konieczne. Ponieważ pytania weryfikacyjne mogą czasami wyglądać jak zadania z wieloma wyborami, losowe zgadywanie może wydawać się atrakcyjne. Mira rozwiązuje to, wymagając powtarzających się rund weryfikacji i kar ekonomicznych. Prawdopodobieństwo ciągłego zgadywania poprawnych odpowiedzi spada gwałtownie przy wielu kontrolach, czyniąc nieuczciwe zachowanie statystycznie i ekonomicznie nierozsądnym.

W ten sposób buduje się zrównoważoność.

Użytkownicy płacą opłaty za zweryfikowane wyniki. Te opłaty są dystrybuowane do uczciwych operatorów węzłów, którzy wykonują prawdziwą pracę wnioskowania. W miarę wzrostu użycia, nagrody rosną. W miarę wzrostu nagród, więcej operatorów dołącza. W miarę wzrostu różnorodności operatorów, stronniczość maleje, a bezpieczeństwo się wzmacnia. Staje się to cyklem wzmacniającym.

Inną ważną warstwą jest prywatność. Zamiast wysyłać pełne dokumenty do jednego weryfikatora, treść dzielona jest na fragmenty na poziomie roszczeń i dystrybuowana węzłom. Żaden pojedynczy uczestnik nie widzi całego kontekstu. To chroni wrażliwe informacje, jednocześnie umożliwiając weryfikację.

Długoterminowa wizja sięga dalej. Mira ma na celu przejście od weryfikacji wyników po ich wygenerowaniu do osadzania weryfikacji bezpośrednio w procesie generacji. Oznacza to budowanie systemów AI, w których walidacja jest częścią tego, jak odpowiedź jest tworzona, a nie myślą dodatkową.

Prościej mówiąc, Mira traktuje prawdę jako coś, co musi być zabezpieczone ekonomicznie.

Nieprzyjęte.

Niecentralizowane.

Ale zweryfikowane przez zdecentralizowany konsensus i dostosowane zachęty.

W miarę jak AI staje się infrastrukturą dla finansów, opieki zdrowotnej, prawa i automatyzacji, zaufanie nie może opierać się tylko na pewności. Musi opierać się na systemach, które nagradzają uczciwość i karzą manipulację.

To jest fundament, który Mira próbuje zbudować.

Systemy takie jak $MIRA mają na celu zbudowanie warstwy zaufania, która sprawia, że wyniki AI są nie tylko przekonujące, ale i możliwe do udowodnienia.

#Mira #MİRA #AIToken #cforcrypto