AI nie brakuje pewności siebie, brakuje mu odpowiedzialności.

Każdego dnia modele generują ogromne ilości treści, analiz i wniosków. Problem nie leży w inteligencji. Leży w zaufaniu. Pewne wyniki nie równa się zweryfikowanej prawdzie.

To tam @Mira - Trust Layer of AI wprowadza strukturalną zmianę.

Zamiast prosić użytkowników o ślepe zaufanie do odpowiedzi AI, Mira koncentruje się na weryfikacji poprzez rozproszony konsensus. Twierdzenia nie są akceptowane na podstawie samego wyglądu — są weryfikowane. W cyfrowym środowisku coraz bardziej zalanym syntetycznymi treściami, zapewnienie staje się najrzadszym zasobem.

To zmienia równanie wartości.

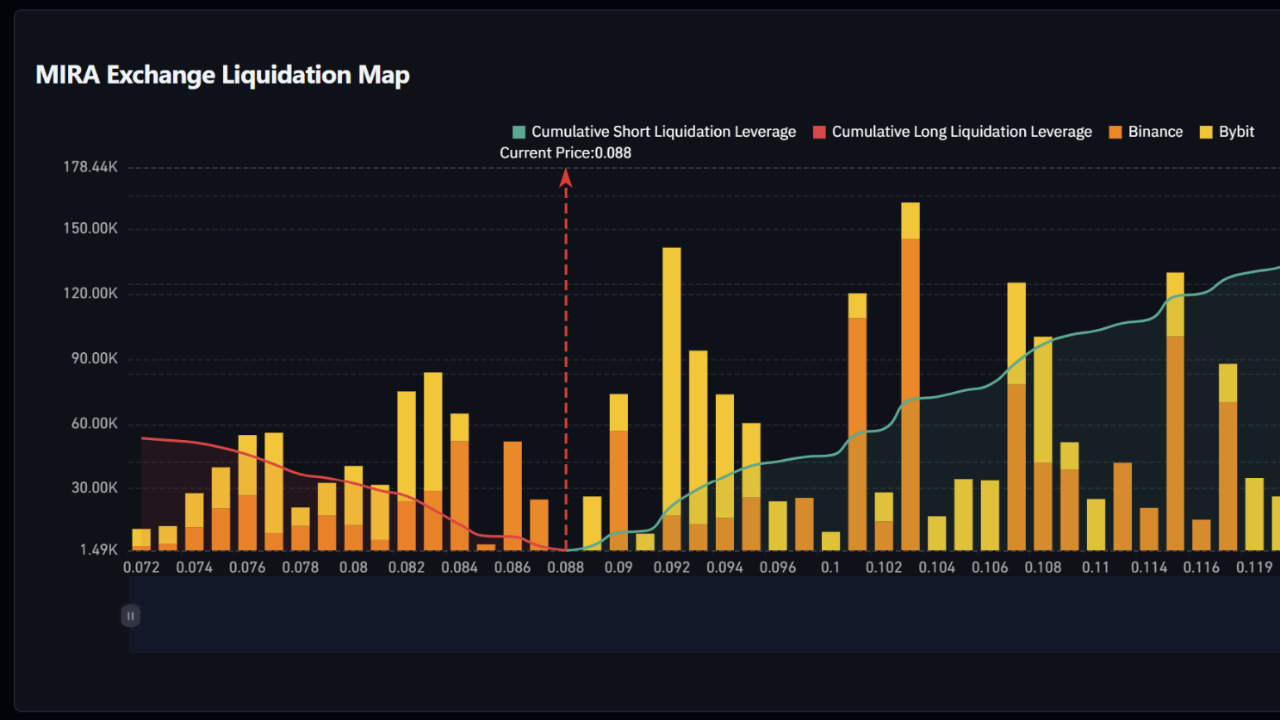

Jeśli AI stanie się dominującym interfejsem dla informacji, to infrastruktura weryfikacyjna stanie się kluczowa dla misji. To tutaj $MIRA derives swe strategiczne znaczenie nie jako hałas w narracji AI, ale jako warstwa ekonomiczna wspierająca mechanizmy zaufania i walidacji.

W następnej fazie ewolucji AI zwycięzcami nie będą najgłośniejsze modele.

Będą to systemy, które mogą udowodnić, co jest prawdą

Czy odpowiedzialność AI to następna wielka teza infrastrukturalna?

$MIRA

#Mira