Po spędzeniu trochę czasu na czytaniu dokumentacji Miri i śledzeniu aktualizacji z @Mira - Trust Layer of AI , zacząłem postrzegać Sieć Mira mniej jako „kolejny projekt AI”, a bardziej jako próbę rozwiązania bardzo specyficznego wąskiego gardła: jak możemy zweryfikować, co mówią systemy AI, nie ufając jednej firmie do zdefiniowania tego, co jest prawdą?

To pytanie staje się coraz trudniejsze do zignorowania.

Duże modele AI są potężne, ale wciąż halucynują. Mogą dostarczać pewne odpowiedzi, które są częściowo błędne, subtelnie stronnicze lub po prostu niemożliwe do zweryfikowania. Dziś walidacja zazwyczaj odbywa się wewnątrz scentralizowanych systemów. Firma szkoli model, buduje wewnętrzne procesy oceny i decyduje, kiedy wynik jest „wystarczająco dobry”. Użytkownicy tak naprawdę nie widzą, jak ta walidacja działa. W większości ufamy marce.

#MiraNetwork podchodzi do tego inaczej. Zamiast zakładać, że jeden model lub jedna organizacja może pełnić rolę ostatecznego autorytetu, traktuje wyniki AI jako roszczenia, które mogą być niezależnie sprawdzane.

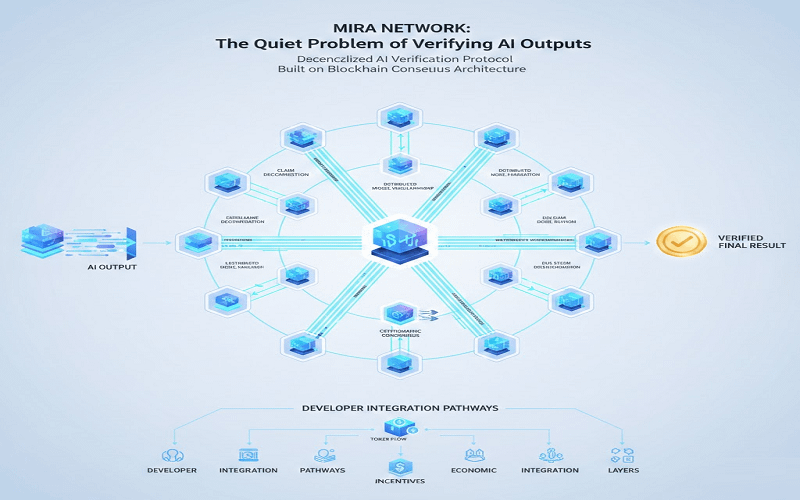

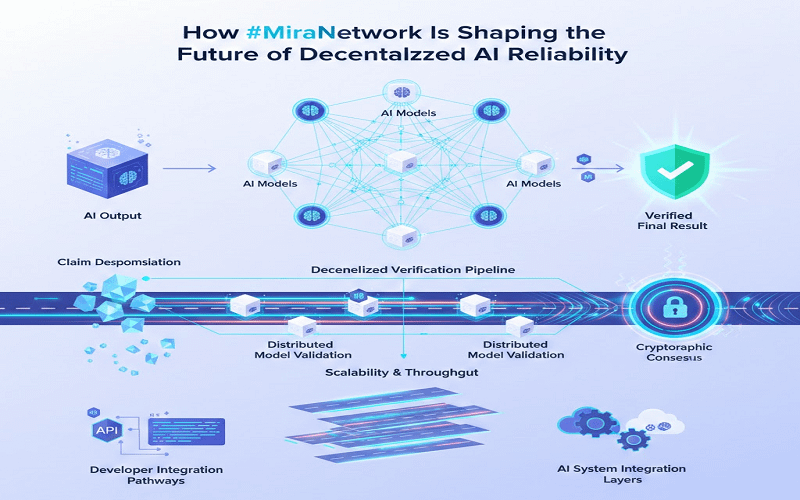

Sposób, w jaki to działa, w prostych słowach, polega na tym, że odpowiedź AI jest rozkładana na mniejsze, testowalne stwierdzenia. Zamiast pytać "Czy ta odpowiedź jest poprawna?" w szerokim sensie, system zadaje bardziej szczegółowe pytania, takie jak: czy to stwierdzenie faktu jest poparte, czy ta liczba zgadza się z danymi, czy ten sposób rozumowania jest sprzeczny sam w sobie?

Te roszczenia są następnie oceniane w wielu niezależnych modelach AI w sieci. Jeśli kilka modeli zbiega się na tym samym wyniku walidacji, ten konsensus jest rejestrowany. Jeśli się różnią, niezgodność staje się częścią sygnału. Idea jest bliższa rozproszonej warstwie weryfikacji faktów niż jednemu strażnikowi.

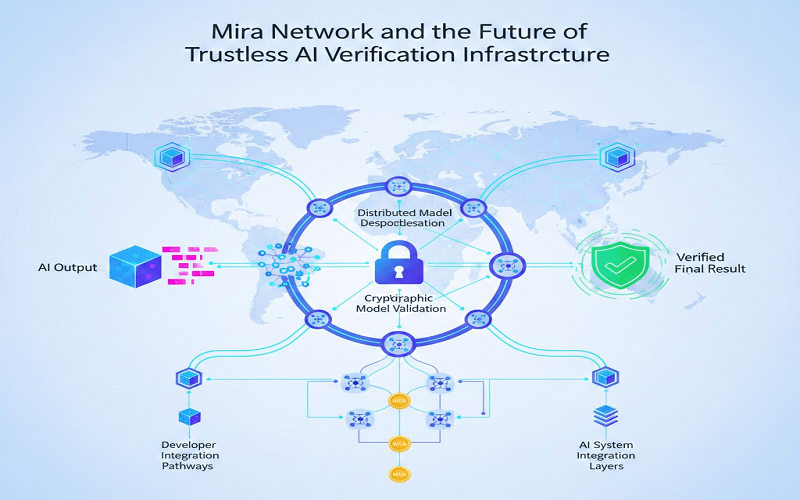

To jest miejsce, w którym blockchain odgrywa strukturalną rolę. Zamiast polegać na centralnym serwerze do rejestrowania, które wyniki przeszły walidację, Mira kotwiczy wyniki walidacji w łańcuchu. Konsensus oparty na blockchainie i weryfikacja kryptograficzna zapewniają, że gdy wynik weryfikacji roszczenia jest zarejestrowany, nie można go cicho zmienić. Zaufanie przesuwa się z "ufamy tej firmie" na "ufamy zasadom i kryptografii."

Przypomina mi to, jak dezinformacja rozprzestrzenia się w Internecie. Jeśli tylko jeden organ oznacza coś jako fałszywe, ludzie kwestionują ten organ. Ale jeśli wielu niezależnych analityków przegląda to samo roszczenie i dochodzi do podobnego wniosku, ma to większą wagę. Mira stara się sformalizować ten proces dla wyników AI.

Token, $MIRA , wpisuje się w tę strukturę jako narzędzie koordynacji ekonomicznej. Weryfikatorzy uczestniczący w sprawdzaniu roszczeń są motywowani do działania uczciwie. Jeśli zachowują się złośliwie lub niedbale, istnieją mechanizmy, aby zmniejszyć nagrody lub ukarać ich. To wprowadza koszt dla nieuczciwości, którego scentralizowane systemy AI nie zawsze ujawniają w przejrzysty sposób.

Z perspektywy systemowej interesującą częścią jest to, że Mira nie próbuje zbudować "najlepszego modelu." Buduje warstwę weryfikacyjną, która może być umieszczona na wielu modelach. To sprawia, że jest bardziej infrastrukturą niż aplikacją. Teoretycznie każdy system AI mógłby kierować swoje wyniki przez tę rozproszoną sieć weryfikacyjną przed przedstawieniem wyników użytkownikom końcowym.

Oczywiście, istnieją praktyczne ograniczenia.

Rozkładanie wyników AI na uporządkowane roszczenia wymaga obliczeń. Uruchamianie wielu modeli w celu krzyżowej walidacji tych roszczeń zwiększa koszty. Koordynacja między rozproszonymi weryfikatorami dodaje opóźnienia. A przestrzeń infrastruktury AI staje się konkurencyjna, z innymi protokołami badającymi podobne warstwy niezawodności.

Istnieje również kwestia dojrzałości. Sieć weryfikacyjna jest tylko tak silna, jak jej uczestnictwo weryfikatorów i różnorodność modeli. Na wczesnych etapach ekosystem wciąż się formuje. To oznacza, że poprawy niezawodności mogą być stopniowe, a nie natychmiastowe.

Ale konceptualnie, przesunięcie ma sens.

Zamiast prosić użytkowników o zaufanie dostawcy modelu, Mira wprowadza system, w którym walidacja jest przejrzysta, ekonomicznie zharmonizowana i rejestrowana w sposób odporny na manipulacje. To zmienia rozmowę na temat niezawodności AI z "Komu wierzymy?" na "Co pokazuje konsensus sieci?"

Jeśli spojrzysz na dyskusje pod #Mira , zauważysz, że skupienie często mniej dotyczy surowej wydajności modelu, a bardziej weryfikowalności i koordynacji. To wydaje się być bardziej realistycznym kierunkiem dla infrastruktury AI, szczególnie gdy modele stają się coraz bardziej autonomiczne.

W szerszym kontekście AI i blockchaina, Mira Network nie próbuje zastąpić inteligencji. Próbuje ją zweryfikować.

A ta różnica może być ważniejsza, niż sobie to uświadamiamy.